linux环境下kafka安装步骤

1 安装条件

1.Kafka依赖于zookeeper存活,所以要确保zk已经安装成功,可以正常启动,参考:linux环境下zookeeper安装步骤。

2.kafka安装包下载:Apache官网 http://kafka.apache.org/downloads.html ,选择Binary downloads,选择版本进行下载。也可以直接用以下命令下载: wget http://apache.01link.hk/kafka/2.0.0/kafka_2.11-2.0.0.tgz

2 安装kafka

1. 进入指定安装目录:cd /usr/local

解压安装包:tar -xzf kafka_2.11-2.0.0.tgz

进入解压后的目录:cd kafka_2.11-2.0.0

2. 启动kafka, 启动kafka首先要启动zk,启动zk有两种方式:

第一种使用kafka带的zk: bin/zookeeper-server-start.sh config/zookeeper.properties(不推荐)

第二种使用其他zookeeper(可以是本机zk,也可以位于其它地址的zk),这种情况需要修改/config/sercer.properties里面的zookeeper地址。

#########################参数解释##############################

broker.id=0 #当前机器在集群中的唯一标识,和zookeeper的myid性质一样

port=9092 #当前kafka对外提供服务的端口默认是9092

host.name=192.168.7.100 #这个参数默认是关闭的,在0.8.1有个bug,DNS解析问题,失败率的问题。

num.network.threads=3 #这个是borker进行网络处理的线程数

num.io.threads=8 #这个是borker进行I/O处理的线程数

log.dirs=/opt/kafka/kafkalogs/ #消息存放的目录,这个目录可以配置为“,”逗号分割的表达式,上面的num.io.threads要大于这个目录的个数这个目录,如果配置多个目录,新创建的topic他把消息持久化的地方是,当前以逗号分割的目录中,那个分区数最少就放那一个

socket.send.buffer.bytes=102400 #发送缓冲区buffer大小,数据不是一下子就发送的,先回存储到缓冲区了到达一定的大小后在发送,能提高性能

socket.receive.buffer.bytes=102400 #kafka接收缓冲区大小,当数据到达一定大小后在序列化到磁盘

socket.request.max.bytes=104857600 #这个参数是向kafka请求消息或者向kafka发送消息的请请求的最大数,这个值不能超过java的堆栈大小

num.partitions=1 #默认的分区数,一个topic默认1个分区数

log.retention.hours=168 #默认消息的最大持久化时间,168小时,7天

message.max.byte=5242880 #消息保存的最大值5M

default.replication.factor=2 #kafka保存消息的副本数,如果一个副本失效了,另一个还可以继续提供服务

replica.fetch.max.bytes=5242880 #取消息的最大直接数

log.segment.bytes=1073741824 #这个参数是:因为kafka的消息是以追加的形式落地到文件,当超过这个值的时候,kafka会新起一个文件

log.retention.check.interval.ms=300000 #每隔300000毫秒去检查上面配置的log失效时间(log.retention.hours=168 ),到目录查看是否有过期的消息如果有,删除

log.cleaner.enable=false #是否启用log压缩,一般不用启用,启用的话可以提高性能

zookeeper.connect=192.168.7.100:12181,192.168.7.101:12181,192.168.7.107:1218 #设置zookeeper的连接端口

#########################参数修改##############################

broker.id=0 #每台服务器的broker.id都不能相同

host.name=192.168.7.100 #hostname

#在log.retention.hours=169下面新增下面三项

message.max.byte=5242880

default.replication.factor=2

replica.fetch.max.bytes=5242880

#设置zookeeper的连接端口

zookeeper.connect=192.168.7.100:12181,192.168.7.101:12181,192.168.7.107:12181

(推荐)启动 kafka,启动kafka和对应的zk集群,进入bin目录下:

./kafka-server-start.sh -daemon ../config/server.properties

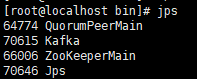

2.检查kafka是否启动成功: jps

3.创建topic,创建一个名为test的topic(一个副本,一个分区)

[root@bogon kafka_2.11-2.0.0]# ./kafka-topics.sh --zookeeper localhost:2181 --create --topic test --partitions 1 --replication-factor 1

4.查看topic: ./kafka-topics.sh --zookeeper localhost:2181 --list

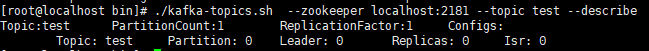

5.查看topic状态:[root@localhost bin]# ./kafka-topics.sh --zookeeper localhost:2181 --topic test --describe

[root@bogon kafka_2.11-2.0.0]# bin/kafka-console-producer.sh --broker-list localhost:9092 --topic test

启动之后就可以发送消息了,比如test:hello boy

7.启动consumer(另一个终端)

bin/kafka-console-consumer.sh --bootstrap-server localhost:9092 --topic test --from-beginning

启动consumer之后就可以在console中看到producer发送的消息了。