Python爬虫实战02:分析Ajax请求并抓取今日头条街拍

1 目标网站分析

首先我们打开今日头条网站,搜索 街拍,点击图集,这里每就是我们要爬取的目录,我们称为索引页。1

点开一个标题,进去,称为详情页。2这里面的图是我们所要爬取的。比如这里可以点击图片,共7张图。2

这里我们可以想到,可以先把详情页的每个标题URL爬取下来,再请求详情页得到每个图集。

分析详情页代码,打开谷歌浏览器开发工具,选择Network,刷新网页。发现第一个请求中返回的不含图片的任何信息。

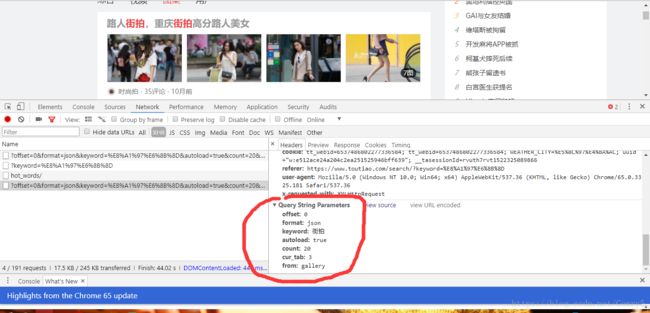

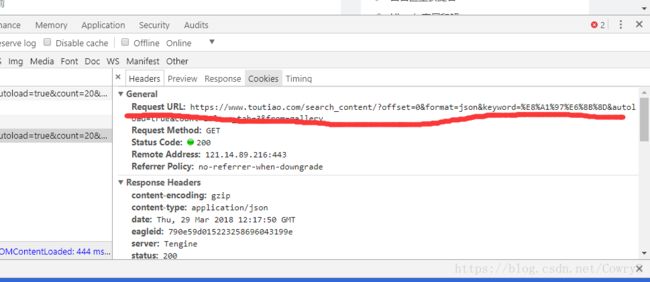

想到头条应该是Ajax请求,选择XHR,继续刷新,点击图集。发现我们点击图集发出的请求返回的代码中data中含有我们想要的图片信息,是Json格式。可以看到title信息,刚好符合。

3

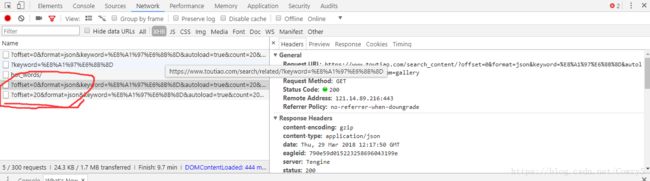

然后滑动网页,发现左边又多了个请求,offset=20,由此得知索引页可通过改变offset来换页。6

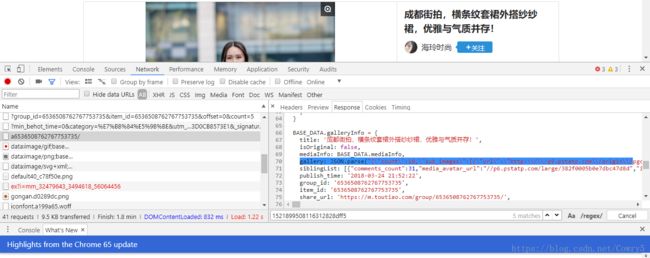

继续看详情页,我们想找到每个图集的内容。同样打开network工具,刷新网页。选择XHR,发现每个请求中都不包含图集信息。选择ALL查看,我们可以看到对应网址的请求返回了一段代码。我们右击图片,新窗口查看,得到图片的地址后面的数字。到前面的代码中搜索,发现图片信息恰好在gallery: JSON.parse(” “)中,是Json格式。其中’sub_image’的值包含的就是我们想要获取的图集的信息。7

理一下基本思路:

- 爬取索引页的信息。通过分析ajax请求,得到每个详情页的网址。(比如这里就返回了18个详情页)

- 爬取详情页的信息,分析网页代码,用正则表达式得到每个图集的信息。

- 将爬取的信息存到MongoDB,并下载图片。

- 通过改变offset爬取多页信息,利用多线程加快速度。

2 流程框架

抓取索引页内容

利用requests请求目标站点,得到索引网页HTML代码,返回结果。

抓取详情页内容

解析返回结果,得到详情页的链接,并进一步抓取详情页的信息。

下载图片与保存数据库

将下载的图片保存到本地,并把页面信息及图片URL保存至MongDB.

开启循环和多线程

对多页内容遍历,开启多线程提高抓取速度。

3 爬虫实战

使用pycharm。

3.1 抓取索引页内容

def get_page_index(offset, keyword):

"""抓取索引页的内容"""

data = { # 请求参数,offset和keyword我们设置成变量,方便改变。

'offset': offset,

'format': 'json',

'keyword': keyword,

'autoload': 'true',

'count': 20,

'cur_tab': 3,

'from': 'gallery'

}

# urlencode()可以把字典对象转化为url的请求参数

url = 'https://www.toutiao.com/search_content/?' + urlencode(data)

try: # 防止程序中断

response = requests.get(url)

if response.status_code == 200: # 如果访问成功则返回文本内容

return response.text

return None

except RequestException:

print('请求索引页出错')

return None3.2 解析索引数据

def parse_page_index(html):

""" 解析索引数据"""

# json.loads()对JSON数据进行解码,转换成一个字典

data = json.loads(html)

# 当data这个字典存在且'data'键名存在与data字典中。data.keys()返回data这个字典所有的键名

if data and 'data' in data.keys():

# get() 函数返回字典中指定键的值,在这里遍历data字典中键名为'data'的

# 值,每个元素分别为一个图集。

for item in data.get('data'):

# 对于'data'的值中的每个元素,建立一个生成器,得到每个网址

yield item.get('article_url') # 'article_url'中信息是每个图集的网址3.3 获取详情页信息

def get_page_detail(url):

""" 拿到详情页图的信息"""

try:

# 此处不加headers会导致访问详情页失败

headers = {'User-Agent': 'Mozilla/5.0 (Windows NT 10.0; Win64;x64)AppleWebKit/537.36(KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36'}

response = requests.get(url, headers=headers)

if response.status_code == 200:

return response.text

return None

except RequestException:

print('请求详情页出错', url)

return None3.4 解析详情页

def parse_page_detail(html, url):

""" 解析详情页"""

# 声明解析后的网页对象

soup = BeautifulSoup(html, 'lxml')

# 通过传入css选择器,选择第一个标签,获取文本内容,就是图集的标题。</span>

title = soup.select(<span class="hljs-string">'title'</span>)[<span class="hljs-number">0</span>].get_text()

<span class="hljs-comment"># 声明一个正则表达式对象,来匹配我们想要的Json语句。注意re.S使 . 能匹配任意字符。</span>

images_pattern = re.compile(<span class="hljs-string">'gallery: JSON.parse\("(.*?)"\),'</span>, re.S)

result = re.search(images_pattern, html)

<span class="hljs-comment"># 注意:这里的Json语句包含转义字符 \ ,不去掉会报错</span>

result = result.group(<span class="hljs-number">1</span>).replace(<span class="hljs-string">'\\'</span>, <span class="hljs-string">''</span>)

<span class="hljs-comment"># result = re.sub(r'\\', '', result.group(1))</span>

<span class="hljs-keyword">if</span> result: <span class="hljs-comment"># 结果存在则进行</span>

data = json.loads(result) <span class="hljs-comment"># 把Json转换为字典</span>

<span class="hljs-keyword">if</span> data <span class="hljs-keyword">and</span> <span class="hljs-string">'sub_images'</span> <span class="hljs-keyword">in</span> data.keys():

<span class="hljs-comment"># 'sub_images'这个键的值是一个列表,里面每个元素是字典,包含每个图集的地址。</span>

sub_images = data.get(<span class="hljs-string">'sub_images'</span>) <span class="hljs-comment"># 得到图集的地址</span>

images = [item.get(<span class="hljs-string">'url'</span>) <span class="hljs-keyword">for</span> item <span class="hljs-keyword">in</span> sub_images] <span class="hljs-comment"># 构造一个图集列表,包含每个图片的地址。</span>

<span class="hljs-keyword">for</span> image <span class="hljs-keyword">in</span> images:

download_image(image) <span class="hljs-comment"># 下载每张图片</span>

<span class="hljs-keyword">return</span> { <span class="hljs-comment"># 返回一个字典,格式化数据,准备存入MongoDB</span>

<span class="hljs-string">'title'</span>: title,

<span class="hljs-string">'url'</span>: url,

<span class="hljs-string">'images'</span>: images,

}</code></pre>

<h4 id="35-定义下载图片函数">3.5 定义下载图片函数</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-function"><span class="hljs-keyword">def</span> <span class="hljs-title">download_image</span><span class="hljs-params">(url)</span>:</span> <span class="hljs-comment"># 传入的是每张图片的地址</span>

<span class="hljs-string">""" 下载图片"""</span>

print(<span class="hljs-string">'正在下载'</span>, url) <span class="hljs-comment"># 调试信息</span>

<span class="hljs-keyword">try</span>:

headers = {<span class="hljs-string">'User-Agent'</span>: <span class="hljs-string">'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36'</span>

<span class="hljs-string">'(KHTML, like Gecko) Chrome/51.0.2704.103 Safari/537.36'</span>}

response = requests.get(url, headers=headers)

<span class="hljs-keyword">if</span> response.status_code == <span class="hljs-number">200</span>:

save_image(response.content) <span class="hljs-comment"># 保存图片,content返回二进制内容(当保存图片视频时)</span>

<span class="hljs-keyword">return</span> <span class="hljs-keyword">None</span>

<span class="hljs-keyword">except</span> RequestException:

print(<span class="hljs-string">'请求图片出错'</span>, url)

<span class="hljs-keyword">return</span> <span class="hljs-keyword">None</span></code></pre>

<h4 id="36-定义保存图片函数">3.6 定义保存图片函数</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-function"><span class="hljs-keyword">def</span> <span class="hljs-title">save_image</span><span class="hljs-params">(content)</span>:</span>

<span class="hljs-string">"""存图片"""</span>

<span class="hljs-comment"># 定义文件路径,文件名把图片信息md5加密,保证每个文件名不同。</span>

file_path = <span class="hljs-string">'{0}/{1}.{2}'</span>.format(os.getcwd() +

<span class="hljs-string">'\images'</span>, md5(content).hexdigest(), <span class="hljs-string">'jpg'</span>)

<span class="hljs-keyword">if</span> <span class="hljs-keyword">not</span> os.path.exists(file_path): <span class="hljs-comment"># 如果文件不存在</span>

<span class="hljs-keyword">with</span> open(file_path, <span class="hljs-string">'wb'</span>) <span class="hljs-keyword">as</span> f:

f.write(content)

<span class="hljs-string">'''

w 以写方式打开,不存在则创建

a 以追加模式打开 (从 EOF 开始, 必要时创建新文件)

r+ 以读写模式打开

w+ 以读写模式打开 (参见 w )

a+ 以读写模式打开 (参见 a )

rb 以二进制读模式打开

wb 以二进制写模式打开 (参见 w )

ab 以二进制追加模式打开 (参见 a )

rb+ 以二进制读写模式打开 (参见 r+ )

wb+ 以二进制读写模式打开 (参见 w+ )

ab+ 以二进制读写模式打开 (参见 a+ )'''</span></code></pre>

<h4 id="37-存储到数据库">3.7 存储到数据库</h4>

<pre class="prettyprint"><code class="language-python hljs ">client = pymongo.MongoClient(MONGO_URL)

db = client[MONGO_DB]

<span class="hljs-comment"># 其中MONGO_DB,MONGO_URL为配置文件中的参数</span>

<span class="hljs-function"><span class="hljs-keyword">def</span> <span class="hljs-title">save_to_mongo</span><span class="hljs-params">(result)</span>:</span>

<span class="hljs-string">"""存储文件到数据库"""</span>

<span class="hljs-keyword">if</span> db[MONGO_DB].insert(result):

print(<span class="hljs-string">'存储成功'</span>, result)

<span class="hljs-keyword">return</span> <span class="hljs-keyword">True</span>

<span class="hljs-keyword">return</span> <span class="hljs-keyword">False</span></code></pre>

<h4 id="38-主函数">3.8 主函数</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-function"><span class="hljs-keyword">def</span> <span class="hljs-title">main</span><span class="hljs-params">(offset)</span>:</span>

<span class="hljs-string">""" 主函数"""</span>

html = get_page_index(offset, KEYWORD) <span class="hljs-comment"># 获取索引页网页内容</span>

<span class="hljs-keyword">for</span> url <span class="hljs-keyword">in</span> parse_page_index(html): <span class="hljs-comment"># parse_page_index()返回一个生成器,生成每个图集的地址</span>

html = get_page_detail(url) <span class="hljs-comment"># 得到每个图集详情页的内容</span>

<span class="hljs-keyword">if</span> html: <span class="hljs-comment"># 如果内容返回成功</span>

result = parse_page_detail(html, url) <span class="hljs-comment"># 解析详情页,返回一个字典结果</span>

save_to_mongo(result) <span class="hljs-comment"># 存入数据库</span></code></pre>

<h4 id="39-运行">3.9 运行</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-keyword">if</span> __name__ == <span class="hljs-string">'__main__'</span>:

groups = [x * <span class="hljs-number">20</span> <span class="hljs-keyword">for</span> x <span class="hljs-keyword">in</span> range(GROUP_START, GROUP_END + <span class="hljs-number">1</span>)] <span class="hljs-comment"># 生成一个offset列表</span>

pool = Pool() <span class="hljs-comment"># 声明一个进程池</span>

pool.map(main, groups)

pool.close()

pool.join()</code></pre>

<h4 id="310-头文件">3.10 头文件</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-keyword">import</span> json

<span class="hljs-keyword">import</span> os

<span class="hljs-keyword">import</span> re

<span class="hljs-keyword">from</span> hashlib <span class="hljs-keyword">import</span> md5

<span class="hljs-keyword">from</span> multiprocessing <span class="hljs-keyword">import</span> Pool

<span class="hljs-keyword">from</span> urllib.parse <span class="hljs-keyword">import</span> urlencode

<span class="hljs-keyword">import</span> pymongo

<span class="hljs-keyword">import</span> requests

<span class="hljs-keyword">from</span> bs4 <span class="hljs-keyword">import</span> BeautifulSoup

<span class="hljs-keyword">from</span> requests.exceptions <span class="hljs-keyword">import</span> RequestException

<span class="hljs-keyword">from</span> ToutiaoJiepai.config <span class="hljs-keyword">import</span> *</code></pre>

<h4 id="311-创建配置文件configpy">3.11 创建配置文件config.py</h4>

<pre class="prettyprint"><code class="language-python hljs "><span class="hljs-comment"># config.py</span>

MONGO_URL = <span class="hljs-string">'localhost'</span>

MONGO_DB = <span class="hljs-string">'toutiao'</span>

MONGO_TABLE = <span class="hljs-string">'toutiao'</span>

GROUP_START = <span class="hljs-number">1</span>

GROUP_END = <span class="hljs-number">1</span>

KEYWORD = <span class="hljs-string">'街拍'</span>

</code></pre>

<p><strong>多用<code>if</code>语句的异常语句来保证程序的顺利进行。</strong></p>

</div>

</div>

</div>

</div>

</div>

<!--PC和WAP自适应版-->

<div id="SOHUCS" sid="1175165884788977664"></div>

<script type="text/javascript" src="/views/front/js/chanyan.js"></script>

<!-- 文章页-底部 动态广告位 -->

<div class="youdao-fixed-ad" id="detail_ad_bottom"></div>

</div>

<div class="col-md-3">

<div class="row" id="ad">

<!-- 文章页-右侧1 动态广告位 -->

<div id="right-1" class="col-lg-12 col-md-12 col-sm-4 col-xs-4 ad">

<div class="youdao-fixed-ad" id="detail_ad_1"> </div>

</div>

<!-- 文章页-右侧2 动态广告位 -->

<div id="right-2" class="col-lg-12 col-md-12 col-sm-4 col-xs-4 ad">

<div class="youdao-fixed-ad" id="detail_ad_2"></div>

</div>

<!-- 文章页-右侧3 动态广告位 -->

<div id="right-3" class="col-lg-12 col-md-12 col-sm-4 col-xs-4 ad">

<div class="youdao-fixed-ad" id="detail_ad_3"></div>

</div>

</div>

</div>

</div>

</div>

</div>

<div class="container">

<h4 class="pt20 mb15 mt0 border-top">你可能感兴趣的:(爬虫)</h4>

<div id="paradigm-article-related">

<div class="recommend-post mb30">

<ul class="widget-links">

<li><a href="/article/1943934034132398080.htm"

title="Python 爬虫实战:视频平台播放量实时监控(含反爬对抗与数据趋势预测)" target="_blank">Python 爬虫实战:视频平台播放量实时监控(含反爬对抗与数据趋势预测)</a>

<span class="text-muted">西攻城狮北</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E9%9F%B3%E8%A7%86%E9%A2%91/1.htm">音视频</a>

<div>一、引言在数字内容蓬勃发展的当下,视频平台的播放量数据已成为内容创作者、营销人员以及行业分析师手中极为关键的情报资源。它不仅能够实时反映内容的受欢迎程度,更能在竞争分析、营销策略制定以及内容优化等方面发挥不可估量的作用。然而,视频平台为了保护自身数据和用户隐私,往往会设置一系列反爬虫机制,对数据爬取行为进行限制。这就向我们发起了挑战:如何巧妙地突破这些限制,同时精准地捕捉并预测播放量的动态变化趋势</div>

</li>

<li><a href="/article/1943917893171343360.htm"

title="requests的使用" target="_blank">requests的使用</a>

<span class="text-muted"></span>

<div>一·概念requests作为爬虫的基础库,在我们快速爬取和反爬破解中起到很重要的作用,其中的知识点大概有以下几个方面:二·内容一,request:1-requests.get…get请求获取数据2-requests.post…post请求获取数据二,response:1-response.text.响应体str类型2-response.encoding从HTTPheader中获取响应内容的编码方式</div>

</li>

<li><a href="/article/1943915626644959232.htm"

title="Python爬虫实战:利用最新技术爬取B站直播数据" target="_blank">Python爬虫实战:利用最新技术爬取B站直播数据</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/html/1.htm">html</a><a class="tag" taget="_blank" href="/search/%E7%99%BE%E5%BA%A6/1.htm">百度</a>

<div>1.B站直播数据爬取概述B站(哔哩哔哩)是中国最大的年轻人文化社区和视频平台之一,其直播业务近年来发展迅速。爬取B站直播数据可以帮助我们分析直播市场趋势、热门主播排行、观众喜好等有价值的信息。常见的B站直播数据类型包括:直播间基本信息(标题、分类、主播信息)实时观看人数与弹幕数据礼物打赏数据直播历史记录分区热门直播数据本文将重点介绍如何获取直播间基本信息和分区热门直播数据。2.环境准备与工具选择2</div>

</li>

<li><a href="/article/1943915248591368192.htm"

title="基于Python的智能公示信息监控爬虫系统开发实战" target="_blank">基于Python的智能公示信息监控爬虫系统开发实战</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E9%9F%B3%E8%A7%86%E9%A2%91/1.htm">音视频</a><a class="tag" taget="_blank" href="/search/%E6%90%9C%E7%B4%A2%E5%BC%95%E6%93%8E/1.htm">搜索引擎</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a>

<div>摘要本文详细介绍了如何使用Python构建一个高效的公示信息监控爬虫系统。系统采用最新技术栈,包括异步爬取、智能解析、反反爬策略等,能够自动监控各类政府网站、企业公示平台的更新信息。文章从系统设计到具体实现,提供了完整的代码示例和详细的技术解析,帮助读者掌握大规模公示信息采集的核心技术。关键词:Python爬虫、公示监控、信息采集、异步爬取、智能解析1.引言在数字化时代,各类公示信息(如政府采购、</div>

</li>

<li><a href="/article/1943915122204405760.htm"

title="基于Python的Google Scholar学术论文爬虫实战:最新技术与完整代码解析" target="_blank">基于Python的Google Scholar学术论文爬虫实战:最新技术与完整代码解析</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E5%AD%A6%E4%B9%A0/1.htm">学习</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a>

<div>摘要本文详细介绍如何使用Python构建一个高效的GoogleScholar爬虫系统,包括代理设置、反反爬策略、数据解析与存储等核心技术。文章涵盖最新Python爬虫技术栈(如Playwright、异步IO等),提供完整可运行的代码示例,并讨论学术爬虫的伦理与法律问题。通过本教程,读者将掌握从GoogleScholar批量获取学术论文信息的高级爬虫技术。关键词:Python爬虫、GoogleSch</div>

</li>

<li><a href="/article/1943906923720011776.htm"

title="Python selenium 库" target="_blank">Python selenium 库</a>

<span class="text-muted">AI老李</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/selenium/1.htm">selenium</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a>

<div>关键要点PythonSelenium库用于自动化Web浏览器,适合测试和爬虫,中文教程资源丰富。推荐菜鸟教程、CSDN博客和Selenium-Python中文文档,涵盖基础到进阶。学习需注意浏览器驱动匹配和动态加载处理,可能需显式等待。资源推荐以下是适合初学者和中级学习者的中文教程:菜鸟教程:提供全面的Selenium教程,包括安装和示例,详见Selenium教程。Selenium-Python中</div>

</li>

<li><a href="/article/1943861034146131968.htm"

title="windows exe爬虫:exe抓包" target="_blank">windows exe爬虫:exe抓包</a>

<span class="text-muted">程序猿阿三</span>

<a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB%E9%A1%B9%E7%9B%AE%E5%AE%9E%E6%88%98/1.htm">爬虫项目实战</a><a class="tag" taget="_blank" href="/search/exe%E6%8A%93%E5%8C%85/1.htm">exe抓包</a>

<div>不论任何爬虫,抓包是获取数据最直接和最方便的方式,这章节我们一起看一下windowsexe是如何拦截数据的。用mitmproxy/Charles/Fiddler或Wireshark拦截它的HTTP/HTTPS/TCP流量。如果是HTTPS,安装并信任代理的根证书。由于exe大部分可能走的是自定义应用层协议。在不知情所拦截应用使用的流量时,所以建议用Wireshark。本文利用python代码,实现</div>

</li>

<li><a href="/article/1943819541721182208.htm"

title="Python爬虫实战:基于最新技术的定时签到系统开发全解析" target="_blank">Python爬虫实战:基于最新技术的定时签到系统开发全解析</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E4%BA%BA%E5%B7%A5%E6%99%BA%E8%83%BD/1.htm">人工智能</a><a class="tag" taget="_blank" href="/search/%E8%87%AA%E5%8A%A8%E5%8C%96/1.htm">自动化</a><a class="tag" taget="_blank" href="/search/%E7%9F%A5%E8%AF%86%E5%9B%BE%E8%B0%B1/1.htm">知识图谱</a>

<div>摘要本文详细介绍了如何使用Python开发一个功能完善的定时签到爬虫系统。文章从爬虫基础知识讲起,逐步深入到高级技巧,包括异步请求处理、浏览器自动化、验证码破解、分布式架构等最新技术。我们将通过一个完整的定时签到项目案例,展示如何构建一个稳定、高效且具有良好扩展性的爬虫系统。文中提供了大量可运行的代码示例,涵盖requests、aiohttp、selenium、playwright等多种技术方案,</div>

</li>

<li><a href="/article/1943819542761369600.htm"

title="Python爬虫实战:使用最新技术爬取新华网新闻数据" target="_blank">Python爬虫实战:使用最新技术爬取新华网新闻数据</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a><a class="tag" taget="_blank" href="/search/%E9%9F%B3%E8%A7%86%E9%A2%91/1.htm">音视频</a>

<div>一、前言在当今信息爆炸的时代,网络爬虫技术已经成为获取互联网数据的重要手段。作为国内权威新闻媒体,新华网每天发布大量高质量的新闻内容,这些数据对于舆情分析、市场研究、自然语言处理等领域具有重要价值。本文将详细介绍如何使用Python最新技术构建一个高效、稳定的新华网新闻爬虫系统。二、爬虫技术选型2.1技术栈选择在构建新华网爬虫时,我们选择了以下技术栈:请求库:httpx(支持HTTP/2,异步请求</div>

</li>

<li><a href="/article/1943758777144635392.htm"

title="Python爬虫:从图片或扫描文档中提取文字数据的完整指南" target="_blank">Python爬虫:从图片或扫描文档中提取文字数据的完整指南</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E6%95%B0%E6%8D%AE%E6%8C%96%E6%8E%98/1.htm">数据挖掘</a><a class="tag" taget="_blank" href="/search/c%2B%2B/1.htm">c++</a>

<div>1.引言随着大数据技术的不断进步,图像数据逐渐成为了许多行业中重要的数据源之一。图像中不仅包含了丰富的视觉信息,还可能蕴含着大量的文字数据。对于科研、企业、政府等多个领域而言,如何从图片或扫描文档中提取出有价值的文字信息是一个亟待解决的问题。在这一过程中,OCR(OpticalCharacterRecognition,光学字符识别)技术成为了解决这一问题的重要工具。在本文中,我们将探讨如何使用Py</div>

</li>

<li><a href="/article/1943721976522665984.htm"

title="爬虫技术:从基础到高级,探索数据抓取的奥秘" target="_blank">爬虫技术:从基础到高级,探索数据抓取的奥秘</a>

<span class="text-muted"></span>

<div>一、基础爬虫:揭开数据抓取的神秘面纱对于初学者来说,基础爬虫是入门的起点。基础爬虫的目标通常是静态网页,这些网页的内容在加载时就已经确定,不需要与服务器进行交互。通过简单的HTTP请求和HTML解析,就可以获取到网页中的数据。在基础爬虫中,最核心的技术是HTML解析。HTML是网页的结构语言,它定义了网页的布局和内容。爬虫程序需要通过解析HTML,找到其中的文本、图片、链接等元素。常用的HTML解</div>

</li>

<li><a href="/article/1943617842314276864.htm"

title="python 计算生态概览的概述" target="_blank">python 计算生态概览的概述</a>

<span class="text-muted"></span>

<div>文章目录前言python计算生态库的介绍1.网络爬虫2.数据分析3.文本处理4.数据可视化5.机器学习6.图形用户界面7.游戏开发8.网络应用开发前言python计算生态概览的解释Python计算生态概览是对Python作为一门强大而广泛使用的编程语言所拥有的庞大软件集合的整体描述和概述。这个生态体系不仅包含了Python的标准库(stdlib),即随Python解释器安装的基本模块,还涵盖了极其</div>

</li>

<li><a href="/article/1943604486769537024.htm"

title="Python生态全景图:8大主流框架优缺点及选型指南" target="_blank">Python生态全景图:8大主流框架优缺点及选型指南</a>

<span class="text-muted">Sammyyyyy</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/django/1.htm">django</a><a class="tag" taget="_blank" href="/search/fastapi/1.htm">fastapi</a><a class="tag" taget="_blank" href="/search/flask/1.htm">flask</a>

<div>引言:Python的“万能”生态Python为何能成为当今最流行的编程语言之一?答案并非其语法本身,而在于其强大且多样化的框架生态。这个生态系统如同一片繁荣的大陆,覆盖了从Web后端到人工智能的几乎所有技术领域,让开发者能用一种语言胜任多种截然不同的任务。本文将化作一张“技术地图”,快速带你游览Python在Web开发、数据科学和网络爬虫三大领域的8个标志性框架。我们的目标是迅速掌握它们的精髓,让</div>

</li>

<li><a href="/article/1943532751152017408.htm"

title="从零到一:王者荣耀英雄数据采集与技能图谱异步爬虫实战" target="_blank">从零到一:王者荣耀英雄数据采集与技能图谱异步爬虫实战</a>

<span class="text-muted">程序员威哥</span>

<a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E8%87%AA%E5%8A%A8%E5%8C%96/1.htm">自动化</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a>

<div>引言:随着游戏行业的迅猛发展,王者荣耀作为一款深受玩家喜爱的手游,其英雄数据和技能信息成为了爬虫开发者研究的热点之一。通过抓取英雄数据并对技能图谱进行可视化,我们不仅能够更好地理解游戏数据,还可以为游戏爱好者或数据分析师提供一个有价值的数据分析平台。本篇文章将带你一步步实现王者荣耀英雄数据的采集与技能图谱的可视化,并使用异步爬虫技术提高爬取效率。我们将结合实际开发中的需求,深入讲解如何使用异步爬虫</div>

</li>

<li><a href="/article/1943486727599484928.htm"

title="Python 网络爬虫中 robots 协议使用的常见问题及解决方法" target="_blank">Python 网络爬虫中 robots 协议使用的常见问题及解决方法</a>

<span class="text-muted"></span>

<div>在Python网络爬虫开发中,robots协议的正确应用是保证爬虫合规性的关键。然而,在实际使用过程中,开发者常会遇到各种问题,若处理不当,可能导致爬虫被封禁或引发法律风险。本文将梳理robots协议使用中的常见问题,并提供针对性的解决方法。一、协议解析不准确导致的合规性问题1.1误读User-agent通配符范围问题表现:将User-agent:*错误理解为适用于所有场景,忽略了特定爬虫的单独规</div>

</li>

<li><a href="/article/1943482818281664512.htm"

title="【网络与爬虫 24】爬虫数据存储方案:从文件到数据库的全面指南" target="_blank">【网络与爬虫 24】爬虫数据存储方案:从文件到数据库的全面指南</a>

<span class="text-muted">莫比乌斯@卷</span>

<a class="tag" taget="_blank" href="/search/%E6%8A%80%E6%9C%AF%E6%8A%80%E5%B7%A7/1.htm">技术技巧</a><a class="tag" taget="_blank" href="/search/%23/1.htm">#</a><a class="tag" taget="_blank" href="/search/%E7%BD%91%E7%BB%9C%E4%B8%8E%E7%88%AC%E8%99%AB/1.htm">网络与爬虫</a><a class="tag" taget="_blank" href="/search/%E7%BD%91%E7%BB%9C/1.htm">网络</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E6%95%B0%E6%8D%AE%E5%BA%93/1.htm">数据库</a>

<div>【网络与爬虫24】爬虫数据存储方案:从文件到数据库的全面指南关键词:爬虫数据存储、CSV、JSON、Excel、SQLite、MySQL、MongoDB、Redis、数据持久化、数据管理摘要:本文全面介绍爬虫数据存储的各种方案,从简单的文本文件、CSV、JSON到Excel表格,再到SQLite、MySQL等关系型数据库,以及MongoDB、Redis等NoSQL数据库。通过对比分析不同存储方式的</div>

</li>

<li><a href="/article/1943436808855547904.htm"

title="测试你的Python环境是否配置成功" target="_blank">测试你的Python环境是否配置成功</a>

<span class="text-muted">川星弦</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a>

<div>#导入需要的库importrequestsfrombs4importBeautifulSoup#目标网页URLurl='https://quotes.toscrape.com/'#这是一个专门用来练习爬虫的网站#设置请求头,模拟浏览器访问headers={'User-Agent':'Mozilla/5.0(WindowsNT10.0;Win64;x64)AppleWebKit/537.36(KHT</div>

</li>

<li><a href="/article/1943428617186897920.htm"

title="Go爬虫开发学习记录" target="_blank">Go爬虫开发学习记录</a>

<span class="text-muted">朱颜辞镜花辞树</span>

<a class="tag" taget="_blank" href="/search/golang/1.htm">golang</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%AD%A6%E4%B9%A0/1.htm">学习</a>

<div>Go爬虫开发学习记录基础篇:使用net/http库Go的标准库net/http提供了完善的HTTP客户端功能,是构建爬虫的基石:packagemainimport("fmt""io""net/http")funcfetchPage(urlstring)string{//创建自定义HTTP客户端client:=&http.Client{}//构建GET请求req,_:=http.NewRequest</div>

</li>

<li><a href="/article/1943363709900484608.htm"

title="Julia爬取数据能力及应用场景" target="_blank">Julia爬取数据能力及应用场景</a>

<span class="text-muted">q56731523</span>

<a class="tag" taget="_blank" href="/search/julia/1.htm">julia</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a>

<div>Julia是一种高性能编程语言,特别适合数值计算和数据分析。然而,关于数据爬取(即网络爬虫)方面,我们需要明确以下几点:虽然它是一门通用编程语言,但它的强项不在于网络爬取(WebScraping)这类任务。而且Julia的生态系统在爬虫方面还不够成熟和丰富。所以说Julia爬取数据后立即进行高性能的数据分析这点还是有一些优势。Julia虽然以高性能数值计算和数据分析见长,但它同样具备网络爬取(We</div>

</li>

<li><a href="/article/1943348447088275456.htm"

title="Lua嵌入式爬虫实现步骤" target="_blank">Lua嵌入式爬虫实现步骤</a>

<span class="text-muted">q56731523</span>

<a class="tag" taget="_blank" href="/search/lua/1.htm">lua</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/r%E8%AF%AD%E8%A8%80/1.htm">r语言</a>

<div>在Lua中实现嵌入式爬虫,通俗点说就是指在一个宿主程序(如Nginx/OpenResty、Redis等)中使用Lua脚本来完成网络爬取任务。由于Lua本身的标准库并不包含网络请求功能,因此我们需要依赖宿主环境提供的网络库。在Lua中实现嵌入式爬虫通常指在资源受限环境(如OpenResty/Nginx、Redis、IoT设备)中运行的轻量级网络爬取工具。以下是关键实现方案和示例:核心方案:基于Ope</div>

</li>

<li><a href="/article/1943348447679672320.htm"

title="Scala实现网页数据采集示例" target="_blank">Scala实现网页数据采集示例</a>

<span class="text-muted"></span>

<div>Scala可以轻松实现简单的数据采集任务,结合AkkaHTTP(高效HTTP客户端)和Jsoup(HTML解析库)是常见方案。Scala因为受众比较少,而且随着这两年python的热门语言,更让Scala不为人知,今天我将结合我所学的知识实现一个简单的Scala爬虫代码示例。以下就是我整理的一个完整示例,演示如何抓取网页标题和链接:示例代码importakka.actor.ActorSystemi</div>

</li>

<li><a href="/article/1943346808847659008.htm"

title="使用 Kotlin 编写的爬虫程序,用于爬取简历采集系统智联和无忧的内容" target="_blank">使用 Kotlin 编写的爬虫程序,用于爬取简历采集系统智联和无忧的内容</a>

<span class="text-muted"></span>

<div>这是一个使用Kotlin编写的爬虫程序,用于爬取简历采集系统智联和无忧的内容。使用代理信息proxy_host:www.duoip.cn,proxy_port:8000。以下是每行代码和步骤的详细解释:```kotlinimportorg.jsoup.Jsoupimportorg.jsoup.nodes.Documentimportorg.jsoup.nodes.Elementimportorg.</div>

</li>

<li><a href="/article/1943334204397907968.htm"

title="Scrapy分布式爬虫进阶:动态代理与并发优化实战" target="_blank">Scrapy分布式爬虫进阶:动态代理与并发优化实战</a>

<span class="text-muted">Kelaru</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/project/1.htm">project</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a><a class="tag" taget="_blank" href="/search/%E5%88%86%E5%B8%83%E5%BC%8F/1.htm">分布式</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a>

<div>写在前面。。。继“动态网页”“登录网站”“经验总结”“分布式爬虫”后,本篇献上Scrapy-Redis进阶实战,基于QuotestoScrape,聚焦动态代理池和并发优化,代码简洁,经验点燃智慧,适合新手到老兵。准备工作1.环境配置Python:3.8+(推荐3.10)。依赖安装:pipinstallscrapy==2.11.2scrapy-redis==0.7.4redis==5.0.8requ</div>

</li>

<li><a href="/article/1943294735238098944.htm"

title="Python 爬虫实战:电商商品评论深度爬取与用户情感分析系统搭建" target="_blank">Python 爬虫实战:电商商品评论深度爬取与用户情感分析系统搭建</a>

<span class="text-muted">西攻城狮北</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E7%94%B5%E5%95%86/1.htm">电商</a>

<div>引言在电商领域,商品评论是消费者决策的重要参考,也是商家优化产品和服务的关键依据。通过爬取和分析电商商品评论,可以深入了解用户需求、产品优缺点以及市场趋势。本文将详细介绍如何使用Python构建一个完整的电商商品评论爬取系统,并进行用户情感分析。我们将涵盖从爬虫设计、数据抓取、数据清洗、情感分析到可视化的全流程。1.项目背景与目标电商平台上,商品评论通常包含以下信息:用户名评论内容评论时间评分(星</div>

</li>

<li><a href="/article/1943217092643844096.htm"

title="Java基础学习笔记2" target="_blank">Java基础学习笔记2</a>

<span class="text-muted">qichi333</span>

<a class="tag" taget="_blank" href="/search/%E5%AD%A6%E4%B9%A0/1.htm">学习</a><a class="tag" taget="_blank" href="/search/%E7%AC%94%E8%AE%B0/1.htm">笔记</a><a class="tag" taget="_blank" href="/search/java/1.htm">java</a><a class="tag" taget="_blank" href="/search/eclipse/1.htm">eclipse</a>

<div>今天是Java基础学习第二天,加油!!!下面是我今天记的一些笔记。(有点懒惰了,爬虫今天没学,因为赖床了(bushi),但我会勤奋起来的^_^,一定一定!明天不能偷懒了天!!)一、运算符例子:inta=10;intb=20;intc=a+b;其中,“+”是运算符,且是算术运算符;“a+b”是表达式,且是算术表达式。1.算术运算符例1:publicclassdemo3{publicstaticvoi</div>

</li>

<li><a href="/article/1943178515046264832.htm"

title="Selenium使用指南" target="_blank">Selenium使用指南</a>

<span class="text-muted"></span>

<div>点击文末小卡片,免费获取软件测试全套资料,资料在手,涨薪更快Selenium是网页应用中最流行的自动化测试工具,可以用来做自动化测试或者浏览器爬虫等。官网地址为:相对于另外一款web自动化测试工具QTP来说有如下优点:免费开源轻量级,不同语言只需要一个体积很小的依赖包支持多种系统,包括Windows,Mac,Linux支持多种浏览器,包括Chrome,FireFox,IE,safari,opera</div>

</li>

<li><a href="/article/1943162636753498112.htm"

title="Python 网络爬虫的基本流程及 robots 协议详解" target="_blank">Python 网络爬虫的基本流程及 robots 协议详解</a>

<span class="text-muted">女码农的重启</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%BD%91%E7%BB%9C%E7%88%AC%E8%99%AB/1.htm">网络爬虫</a><a class="tag" taget="_blank" href="/search/JAVA/1.htm">JAVA</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a>

<div>数据驱动的时代,网络爬虫作为高效获取互联网信息的工具,其规范化开发离不开对基本流程的掌握和对robots协议的遵守。本文将系统梳理Python网络爬虫的核心流程,并深入解读robots协议的重要性及实践规范。一、Python网络爬虫的基本流程Python网络爬虫的工作过程可分为四个核心阶段,每个阶段环环相扣,共同构成数据采集的完整链路。1.1发起网络请求这是爬虫与目标服务器交互的第一步,通过发送H</div>

</li>

<li><a href="/article/1943140828532764672.htm"

title="爬虫小结" target="_blank">爬虫小结</a>

<span class="text-muted">Crescent_P</span>

<a class="tag" taget="_blank" href="/search/python%E5%B0%8F%E9%A1%B9%E7%9B%AE/1.htm">python小项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E6%95%B0%E6%8D%AE%E5%88%86%E6%9E%90/1.htm">数据分析</a>

<div>python爬虫小组作业上周布置了python的小组作业,每一组要求爬取老师指定的信息,本组抽到的题目如下:从中国银行网址:http://www.boc.cn/sourcedb/whpj/获取主要外汇(美元、欧元、英镑、加拿大元、澳大利亚元、日元、韩元、新台币、澳门元和港币)的牌价信息,计算出它们的每天平均价。要求把今年5月份每天平均价格保存到Excel文件中,每种外汇的数据保存在一个工作表中,并</div>

</li>

<li><a href="/article/1943138810095267840.htm"

title="Python 爬虫实战:抓取华尔街日报付费文章摘要的全方位指南" target="_blank">Python 爬虫实战:抓取华尔街日报付费文章摘要的全方位指南</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/%E4%BF%A1%E6%81%AF%E5%8F%AF%E8%A7%86%E5%8C%96/1.htm">信息可视化</a><a class="tag" taget="_blank" href="/search/%E6%95%B0%E6%8D%AE%E5%88%86%E6%9E%90/1.htm">数据分析</a>

<div>引言在全球化的信息时代,获取高质量的新闻内容对于研究、投资和决策具有重要意义。《华尔街日报》(TheWallStreetJournal,简称WSJ)作为国际知名的财经媒体,其文章内容备受关注。然而,WSJ的大部分内容属于付费订阅,普通用户无法直接访问。本文将深入探讨如何使用Python爬虫技术,结合最新的工具和方法,抓取WSJ的付费文章摘要。一、了解目标网站结构1.1WSJ网站结构分析WSJ的官方</div>

</li>

<li><a href="/article/1943138810887991296.htm"

title="Python爬虫实战:使用最新技术爬取头条新闻数据" target="_blank">Python爬虫实战:使用最新技术爬取头条新闻数据</a>

<span class="text-muted">Python爬虫项目</span>

<a class="tag" taget="_blank" href="/search/2025%E5%B9%B4%E7%88%AC%E8%99%AB%E5%AE%9E%E6%88%98%E9%A1%B9%E7%9B%AE/1.htm">2025年爬虫实战项目</a><a class="tag" taget="_blank" href="/search/python/1.htm">python</a><a class="tag" taget="_blank" href="/search/%E7%88%AC%E8%99%AB/1.htm">爬虫</a><a class="tag" taget="_blank" href="/search/%E5%BC%80%E5%8F%91%E8%AF%AD%E8%A8%80/1.htm">开发语言</a><a class="tag" taget="_blank" href="/search/scrapy/1.htm">scrapy</a><a class="tag" taget="_blank" href="/search/%E9%9F%B3%E8%A7%86%E9%A2%91/1.htm">音视频</a>

<div>一、前言:Python爬虫在现代数据获取中的重要性在当今信息爆炸的时代,数据已经成为最宝贵的资源之一。作为数据获取的重要手段,网络爬虫技术在各个领域发挥着越来越重要的作用。Python凭借其简洁的语法、丰富的库生态系统和强大的社区支持,已经成为网络爬虫开发的首选语言。本文将详细介绍如何使用Python及其最新的爬虫技术来爬取头条新闻数据。我们将从基础概念讲起,逐步深入到高级技巧,最后给出完整的爬虫</div>

</li>

<li><a href="/article/112.htm"

title="HQL之投影查询" target="_blank">HQL之投影查询</a>

<span class="text-muted">归来朝歌</span>

<a class="tag" taget="_blank" href="/search/HQL/1.htm">HQL</a><a class="tag" taget="_blank" href="/search/Hibernate/1.htm">Hibernate</a><a class="tag" taget="_blank" href="/search/%E6%9F%A5%E8%AF%A2%E8%AF%AD%E5%8F%A5/1.htm">查询语句</a><a class="tag" taget="_blank" href="/search/%E6%8A%95%E5%BD%B1%E6%9F%A5%E8%AF%A2/1.htm">投影查询</a>

<div> 在HQL查询中,常常面临这样一个场景,对于多表查询,是要将一个表的对象查出来还是要只需要每个表中的几个字段,最后放在一起显示?

针对上面的场景,如果需要将一个对象查出来:

HQL语句写“from 对象”即可

Session session = HibernateUtil.openSession();

</div>

</li>

<li><a href="/article/239.htm"

title="Spring整合redis" target="_blank">Spring整合redis</a>

<span class="text-muted">bylijinnan</span>

<a class="tag" taget="_blank" href="/search/redis/1.htm">redis</a>

<div>pom.xml

<dependencies>

<!-- Spring Data - Redis Library -->

<dependency>

<groupId>org.springframework.data</groupId>

<artifactId>spring-data-redi</div>

</li>

<li><a href="/article/366.htm"

title="org.hibernate.NonUniqueResultException: query did not return a unique result: 2" target="_blank">org.hibernate.NonUniqueResultException: query did not return a unique result: 2</a>

<span class="text-muted">0624chenhong</span>

<a class="tag" taget="_blank" href="/search/Hibernate/1.htm">Hibernate</a>

<div>参考:http://blog.csdn.net/qingfeilee/article/details/7052736

org.hibernate.NonUniqueResultException: query did not return a unique result: 2

在项目中出现了org.hiber</div>

</li>

<li><a href="/article/493.htm"

title="android动画效果" target="_blank">android动画效果</a>

<span class="text-muted">不懂事的小屁孩</span>

<a class="tag" taget="_blank" href="/search/android%E5%8A%A8%E7%94%BB/1.htm">android动画</a>

<div>前几天弄alertdialog和popupwindow的时候,用到了android的动画效果,今天专门研究了一下关于android的动画效果,列出来,方便以后使用。

Android 平台提供了两类动画。 一类是Tween动画,就是对场景里的对象不断的进行图像变化来产生动画效果(旋转、平移、放缩和渐变)。

第二类就是 Frame动画,即顺序的播放事先做好的图像,与gif图片原理类似。

</div>

</li>

<li><a href="/article/620.htm"

title="js delete 删除机理以及它的内存泄露问题的解决方案" target="_blank">js delete 删除机理以及它的内存泄露问题的解决方案</a>

<span class="text-muted">换个号韩国红果果</span>

<a class="tag" taget="_blank" href="/search/JavaScript/1.htm">JavaScript</a>

<div>delete删除属性时只是解除了属性与对象的绑定,故当属性值为一个对象时,删除时会造成内存泄露 (其实还未删除)

举例:

var person={name:{firstname:'bob'}}

var p=person.name

delete person.name

p.firstname -->'bob'

// 依然可以访问p.firstname,存在内存泄露</div>

</li>

<li><a href="/article/747.htm"

title="Oracle将零干预分析加入网络即服务计划" target="_blank">Oracle将零干预分析加入网络即服务计划</a>

<span class="text-muted">蓝儿唯美</span>

<a class="tag" taget="_blank" href="/search/oracle/1.htm">oracle</a>

<div>由Oracle通信技术部门主导的演示项目并没有在本月较早前法国南斯举行的行业集团TM论坛大会中获得嘉奖。但是,Oracle通信官员解雇致力于打造一个支持零干预分配和编制功能的网络即服务(NaaS)平台,帮助企业以更灵活和更适合云的方式实现通信服务提供商(CSP)的连接产品。这个Oracle主导的项目属于TM Forum Live!活动上展示的Catalyst计划的19个项目之一。Catalyst计</div>

</li>

<li><a href="/article/874.htm"

title="spring学习——springmvc(二)" target="_blank">spring学习——springmvc(二)</a>

<span class="text-muted">a-john</span>

<a class="tag" taget="_blank" href="/search/springMVC/1.htm">springMVC</a>

<div>Spring MVC提供了非常方便的文件上传功能。

1,配置Spring支持文件上传:

DispatcherServlet本身并不知道如何处理multipart的表单数据,需要一个multipart解析器把POST请求的multipart数据中抽取出来,这样DispatcherServlet就能将其传递给我们的控制器了。为了在Spring中注册multipart解析器,需要声明一个实现了Mul</div>

</li>

<li><a href="/article/1001.htm"

title="POJ-2828-Buy Tickets" target="_blank">POJ-2828-Buy Tickets</a>

<span class="text-muted">aijuans</span>

<a class="tag" taget="_blank" href="/search/ACM_POJ/1.htm">ACM_POJ</a>

<div>POJ-2828-Buy Tickets

http://poj.org/problem?id=2828

线段树,逆序插入

#include<iostream>#include<cstdio>#include<cstring>#include<cstdlib>using namespace std;#define N 200010struct</div>

</li>

<li><a href="/article/1128.htm"

title="Java Ant build.xml详解" target="_blank">Java Ant build.xml详解</a>

<span class="text-muted">asia007</span>

<a class="tag" taget="_blank" href="/search/build.xml/1.htm">build.xml</a>

<div>1,什么是antant是构建工具2,什么是构建概念到处可查到,形象来说,你要把代码从某个地方拿来,编译,再拷贝到某个地方去等等操作,当然不仅与此,但是主要用来干这个3,ant的好处跨平台 --因为ant是使用java实现的,所以它跨平台使用简单--与ant的兄弟make比起来语法清晰--同样是和make相比功能强大--ant能做的事情很多,可能你用了很久,你仍然不知道它能有</div>

</li>

<li><a href="/article/1255.htm"

title="android按钮监听器的四种技术" target="_blank">android按钮监听器的四种技术</a>

<span class="text-muted">百合不是茶</span>

<a class="tag" taget="_blank" href="/search/android/1.htm">android</a><a class="tag" taget="_blank" href="/search/xml%E9%85%8D%E7%BD%AE/1.htm">xml配置</a><a class="tag" taget="_blank" href="/search/%E7%9B%91%E5%90%AC%E5%99%A8/1.htm">监听器</a><a class="tag" taget="_blank" href="/search/%E5%AE%9E%E7%8E%B0%E6%8E%A5%E5%8F%A3/1.htm">实现接口</a>

<div>android开发中经常会用到各种各样的监听器,android监听器的写法与java又有不同的地方;

1,activity中使用内部类实现接口 ,创建内部类实例 使用add方法 与java类似

创建监听器的实例

myLis lis = new myLis();

使用add方法给按钮添加监听器

</div>

</li>

<li><a href="/article/1382.htm"

title="软件架构师不等同于资深程序员" target="_blank">软件架构师不等同于资深程序员</a>

<span class="text-muted">bijian1013</span>

<a class="tag" taget="_blank" href="/search/%E7%A8%8B%E5%BA%8F%E5%91%98/1.htm">程序员</a><a class="tag" taget="_blank" href="/search/%E6%9E%B6%E6%9E%84%E5%B8%88/1.htm">架构师</a><a class="tag" taget="_blank" href="/search/%E6%9E%B6%E6%9E%84%E8%AE%BE%E8%AE%A1/1.htm">架构设计</a>

<div> 本文的作者Armel Nene是ETAPIX Global公司的首席架构师,他居住在伦敦,他参与过的开源项目包括 Apache Lucene,,Apache Nutch, Liferay 和 Pentaho等。

如今很多的公司</div>

</li>

<li><a href="/article/1509.htm"

title="TeamForge Wiki Syntax & CollabNet User Information Center" target="_blank">TeamForge Wiki Syntax & CollabNet User Information Center</a>

<span class="text-muted">sunjing</span>

<a class="tag" taget="_blank" href="/search/TeamForge/1.htm">TeamForge</a><a class="tag" taget="_blank" href="/search/How+do/1.htm">How do</a><a class="tag" taget="_blank" href="/search/Attachement/1.htm">Attachement</a><a class="tag" taget="_blank" href="/search/Anchor/1.htm">Anchor</a><a class="tag" taget="_blank" href="/search/Wiki+Syntax/1.htm">Wiki Syntax</a>

<div>the CollabNet user information center http://help.collab.net/

How do I create a new Wiki page?

A CollabNet TeamForge project can have any number of Wiki pages. All Wiki pages are linked, and</div>

</li>

<li><a href="/article/1636.htm"

title="【Redis四】Redis数据类型" target="_blank">【Redis四】Redis数据类型</a>

<span class="text-muted">bit1129</span>

<a class="tag" taget="_blank" href="/search/redis/1.htm">redis</a>

<div>概述

Redis是一个高性能的数据结构服务器,称之为数据结构服务器的原因是,它提供了丰富的数据类型以满足不同的应用场景,本文对Redis的数据类型以及对这些类型可能的操作进行总结。

Redis常用的数据类型包括string、set、list、hash以及sorted set.Redis本身是K/V系统,这里的数据类型指的是value的类型,而不是key的类型,key的类型只有一种即string</div>

</li>

<li><a href="/article/1763.htm"

title="SSH2整合-附源码" target="_blank">SSH2整合-附源码</a>

<span class="text-muted">白糖_</span>

<a class="tag" taget="_blank" href="/search/eclipse/1.htm">eclipse</a><a class="tag" taget="_blank" href="/search/spring/1.htm">spring</a><a class="tag" taget="_blank" href="/search/tomcat/1.htm">tomcat</a><a class="tag" taget="_blank" href="/search/Hibernate/1.htm">Hibernate</a><a class="tag" taget="_blank" href="/search/Google/1.htm">Google</a>

<div>今天用eclipse终于整合出了struts2+hibernate+spring框架。

我创建的是tomcat项目,需要有tomcat插件。导入项目以后,鼠标右键选择属性,然后再找到“tomcat”项,勾选一下“Is a tomcat project”即可。具体方法见源码里的jsp图片,sql也在源码里。

补充1:项目中部分jar包不是最新版的,可能导</div>

</li>

<li><a href="/article/1890.htm"

title="[转]开源项目代码的学习方法" target="_blank">[转]开源项目代码的学习方法</a>

<span class="text-muted">braveCS</span>

<a class="tag" taget="_blank" href="/search/%E5%AD%A6%E4%B9%A0%E6%96%B9%E6%B3%95/1.htm">学习方法</a>

<div>转自:

http://blog.sina.com.cn/s/blog_693458530100lk5m.html

http://www.cnblogs.com/west-link/archive/2011/06/07/2074466.html

1)阅读features。以此来搞清楚该项目有哪些特性2)思考。想想如果自己来做有这些features的项目该如何构架3)下载并安装d</div>

</li>

<li><a href="/article/2017.htm"

title="编程之美-子数组的最大和(二维)" target="_blank">编程之美-子数组的最大和(二维)</a>

<span class="text-muted">bylijinnan</span>

<a class="tag" taget="_blank" href="/search/%E7%BC%96%E7%A8%8B%E4%B9%8B%E7%BE%8E/1.htm">编程之美</a>

<div>package beautyOfCoding;

import java.util.Arrays;

import java.util.Random;

public class MaxSubArraySum2 {

/**

* 编程之美 子数组之和的最大值(二维)

*/

private static final int ROW = 5;

private stat</div>

</li>

<li><a href="/article/2144.htm"

title="读书笔记-3" target="_blank">读书笔记-3</a>

<span class="text-muted">chengxuyuancsdn</span>

<a class="tag" taget="_blank" href="/search/jquery%E7%AC%94%E8%AE%B0/1.htm">jquery笔记</a><a class="tag" taget="_blank" href="/search/resultMap%E9%85%8D%E7%BD%AE/1.htm">resultMap配置</a><a class="tag" taget="_blank" href="/search/ibatis%E4%B8%80%E5%AF%B9%E5%A4%9A%E9%85%8D%E7%BD%AE/1.htm">ibatis一对多配置</a>

<div>1、resultMap配置

2、ibatis一对多配置

3、jquery笔记

1、resultMap配置

当<select resultMap="topic_data">

<resultMap id="topic_data">必须一一对应。

(1)<resultMap class="tblTopic&q</div>

</li>

<li><a href="/article/2271.htm"

title="[物理与天文]物理学新进展" target="_blank">[物理与天文]物理学新进展</a>

<span class="text-muted">comsci</span>

<div>

如果我们必须获得某种地球上没有的矿石,才能够进行某些能量输出装置的设计和建造,而要获得这种矿石,又必须首先进行深空探测,而要进行深空探测,又必须获得这种能量输出装置,这个矛盾的循环,会导致地球联盟在与宇宙文明建立关系的时候,陷入困境

怎么办呢?

</div>

</li>

<li><a href="/article/2398.htm"

title="Oracle 11g新特性:Automatic Diagnostic Repository" target="_blank">Oracle 11g新特性:Automatic Diagnostic Repository</a>

<span class="text-muted">daizj</span>

<a class="tag" taget="_blank" href="/search/oracle/1.htm">oracle</a><a class="tag" taget="_blank" href="/search/ADR/1.htm">ADR</a>

<div>Oracle Database 11g的FDI(Fault Diagnosability Infrastructure)是自动化诊断方面的又一增强。

FDI的一个关键组件是自动诊断库(Automatic Diagnostic Repository-ADR)。

在oracle 11g中,alert文件的信息是以xml的文件格式存在的,另外提供了普通文本格式的alert文件。

这两份log文</div>

</li>

<li><a href="/article/2525.htm"

title="简单排序:选择排序" target="_blank">简单排序:选择排序</a>

<span class="text-muted">dieslrae</span>

<a class="tag" taget="_blank" href="/search/%E9%80%89%E6%8B%A9%E6%8E%92%E5%BA%8F/1.htm">选择排序</a>

<div>

public void selectSort(int[] array){

int select;

for(int i=0;i<array.length;i++){

select = i;

for(int k=i+1;k<array.leng</div>

</li>

<li><a href="/article/2652.htm"

title="C语言学习六指针的经典程序,互换两个数字" target="_blank">C语言学习六指针的经典程序,互换两个数字</a>

<span class="text-muted">dcj3sjt126com</span>

<a class="tag" taget="_blank" href="/search/c/1.htm">c</a>

<div>示例程序,swap_1和swap_2都是错误的,推理从1开始推到2,2没完成,推到3就完成了

# include <stdio.h>

void swap_1(int, int);

void swap_2(int *, int *);

void swap_3(int *, int *);

int main(void)

{

int a = 3;

int b = </div>

</li>

<li><a href="/article/2779.htm"

title="php 5.4中php-fpm 的重启、终止操作命令" target="_blank">php 5.4中php-fpm 的重启、终止操作命令</a>

<span class="text-muted">dcj3sjt126com</span>

<a class="tag" taget="_blank" href="/search/PHP/1.htm">PHP</a>

<div>php 5.4中php-fpm 的重启、终止操作命令:

查看php运行目录命令:which php/usr/bin/php

查看php-fpm进程数:ps aux | grep -c php-fpm

查看运行内存/usr/bin/php -i|grep mem

重启php-fpm/etc/init.d/php-fpm restart

在phpinfo()输出内容可以看到php</div>

</li>

<li><a href="/article/2906.htm"

title="线程同步工具类" target="_blank">线程同步工具类</a>

<span class="text-muted">shuizhaosi888</span>

<a class="tag" taget="_blank" href="/search/%E5%90%8C%E6%AD%A5%E5%B7%A5%E5%85%B7%E7%B1%BB/1.htm">同步工具类</a>

<div>同步工具类包括信号量(Semaphore)、栅栏(barrier)、闭锁(CountDownLatch)

闭锁(CountDownLatch)

public class RunMain {

public long timeTasks(int nThreads, final Runnable task) throws InterruptedException {

fin</div>

</li>

<li><a href="/article/3033.htm"

title="bleeding edge是什么意思" target="_blank">bleeding edge是什么意思</a>

<span class="text-muted">haojinghua</span>

<a class="tag" taget="_blank" href="/search/DI/1.htm">DI</a>

<div>不止一次,看到很多讲技术的文章里面出现过这个词语。今天终于弄懂了——通过朋友给的浏览软件,上了wiki。

我再一次感到,没有辞典能像WiKi一样,给出这样体贴人心、一清二楚的解释了。为了表达我对WiKi的喜爱,只好在此一一中英对照,给大家上次课。

In computer science, bleeding edge is a term that </div>

</li>

<li><a href="/article/3160.htm"

title="c中实现utf8和gbk的互转" target="_blank">c中实现utf8和gbk的互转</a>

<span class="text-muted">jimmee</span>

<a class="tag" taget="_blank" href="/search/c/1.htm">c</a><a class="tag" taget="_blank" href="/search/iconv/1.htm">iconv</a><a class="tag" taget="_blank" href="/search/utf8%26gbk%E7%BC%96%E7%A0%81/1.htm">utf8&gbk编码</a>

<div>#include <iconv.h>

#include <stdlib.h>

#include <stdio.h>

#include <unistd.h>

#include <fcntl.h>

#include <string.h>

#include <sys/stat.h>

int code_c</div>

</li>

<li><a href="/article/3287.htm"

title="大型分布式网站架构设计与实践" target="_blank">大型分布式网站架构设计与实践</a>

<span class="text-muted">lilin530</span>

<a class="tag" taget="_blank" href="/search/%E5%BA%94%E7%94%A8%E6%9C%8D%E5%8A%A1%E5%99%A8/1.htm">应用服务器</a><a class="tag" taget="_blank" href="/search/%E6%90%9C%E7%B4%A2%E5%BC%95%E6%93%8E/1.htm">搜索引擎</a>

<div>1.大型网站软件系统的特点?

a.高并发,大流量。

b.高可用。

c.海量数据。

d.用户分布广泛,网络情况复杂。

e.安全环境恶劣。

f.需求快速变更,发布频繁。

g.渐进式发展。

2.大型网站架构演化发展历程?

a.初始阶段的网站架构。

应用程序,数据库,文件等所有的资源都在一台服务器上。

b.应用服务器和数据服务器分离。

c.使用缓存改善网站性能。

d.使用应用</div>

</li>

<li><a href="/article/3414.htm"

title="在代码中获取Android theme中的attr属性值" target="_blank">在代码中获取Android theme中的attr属性值</a>

<span class="text-muted">OliveExcel</span>

<a class="tag" taget="_blank" href="/search/android/1.htm">android</a><a class="tag" taget="_blank" href="/search/theme/1.htm">theme</a>

<div>Android的Theme是由各种attr组合而成, 每个attr对应了这个属性的一个引用, 这个引用又可以是各种东西.

在某些情况下, 我们需要获取非自定义的主题下某个属性的内容 (比如拿到系统默认的配色colorAccent), 操作方式举例一则:

int defaultColor = 0xFF000000;

int[] attrsArray = { andorid.r.</div>

</li>

<li><a href="/article/3541.htm"

title="基于Zookeeper的分布式共享锁" target="_blank">基于Zookeeper的分布式共享锁</a>

<span class="text-muted">roadrunners</span>

<a class="tag" taget="_blank" href="/search/zookeeper/1.htm">zookeeper</a><a class="tag" taget="_blank" href="/search/%E5%88%86%E5%B8%83%E5%BC%8F/1.htm">分布式</a><a class="tag" taget="_blank" href="/search/%E5%85%B1%E4%BA%AB%E9%94%81/1.htm">共享锁</a>

<div>首先,说说我们的场景,订单服务是做成集群的,当两个以上结点同时收到一个相同订单的创建指令,这时并发就产生了,系统就会重复创建订单。等等......场景。这时,分布式共享锁就闪亮登场了。

共享锁在同一个进程中是很容易实现的,但在跨进程或者在不同Server之间就不好实现了。Zookeeper就很容易实现。具体的实现原理官网和其它网站也有翻译,这里就不在赘述了。

官</div>

</li>

<li><a href="/article/3668.htm"

title="两个容易被忽略的MySQL知识" target="_blank">两个容易被忽略的MySQL知识</a>

<span class="text-muted">tomcat_oracle</span>

<a class="tag" taget="_blank" href="/search/mysql/1.htm">mysql</a>

<div>1、varchar(5)可以存储多少个汉字,多少个字母数字? 相信有好多人应该跟我一样,对这个已经很熟悉了,根据经验我们能很快的做出决定,比如说用varchar(200)去存储url等等,但是,即使你用了很多次也很熟悉了,也有可能对上面的问题做出错误的回答。 这个问题我查了好多资料,有的人说是可以存储5个字符,2.5个汉字(每个汉字占用两个字节的话),有的人说这个要区分版本,5.0</div>

</li>

<li><a href="/article/3795.htm"

title="zoj 3827 Information Entropy(水题)" target="_blank">zoj 3827 Information Entropy(水题)</a>

<span class="text-muted">阿尔萨斯</span>

<a class="tag" taget="_blank" href="/search/format/1.htm">format</a>

<div> 题目链接:zoj 3827 Information Entropy

题目大意:三种底,计算和。

解题思路:调用库函数就可以直接算了,不过要注意Pi = 0的时候,不过它题目里居然也讲了。。。limp→0+plogb(p)=0,因为p是logp的高阶。

#include <cstdio>

#include <cstring>

#include <cmath&</div>

</li>

</ul>

</div>

</div>

</div>

<div>

<div class="container">

<div class="indexes">

<strong>按字母分类:</strong>

<a href="/tags/A/1.htm" target="_blank">A</a><a href="/tags/B/1.htm" target="_blank">B</a><a href="/tags/C/1.htm" target="_blank">C</a><a

href="/tags/D/1.htm" target="_blank">D</a><a href="/tags/E/1.htm" target="_blank">E</a><a href="/tags/F/1.htm" target="_blank">F</a><a

href="/tags/G/1.htm" target="_blank">G</a><a href="/tags/H/1.htm" target="_blank">H</a><a href="/tags/I/1.htm" target="_blank">I</a><a

href="/tags/J/1.htm" target="_blank">J</a><a href="/tags/K/1.htm" target="_blank">K</a><a href="/tags/L/1.htm" target="_blank">L</a><a

href="/tags/M/1.htm" target="_blank">M</a><a href="/tags/N/1.htm" target="_blank">N</a><a href="/tags/O/1.htm" target="_blank">O</a><a

href="/tags/P/1.htm" target="_blank">P</a><a href="/tags/Q/1.htm" target="_blank">Q</a><a href="/tags/R/1.htm" target="_blank">R</a><a

href="/tags/S/1.htm" target="_blank">S</a><a href="/tags/T/1.htm" target="_blank">T</a><a href="/tags/U/1.htm" target="_blank">U</a><a

href="/tags/V/1.htm" target="_blank">V</a><a href="/tags/W/1.htm" target="_blank">W</a><a href="/tags/X/1.htm" target="_blank">X</a><a

href="/tags/Y/1.htm" target="_blank">Y</a><a href="/tags/Z/1.htm" target="_blank">Z</a><a href="/tags/0/1.htm" target="_blank">其他</a>

</div>

</div>

</div>

<footer id="footer" class="mb30 mt30">

<div class="container">

<div class="footBglm">

<a target="_blank" href="/">首页</a> -

<a target="_blank" href="/custom/about.htm">关于我们</a> -

<a target="_blank" href="/search/Java/1.htm">站内搜索</a> -

<a target="_blank" href="/sitemap.txt">Sitemap</a> -

<a target="_blank" href="/custom/delete.htm">侵权投诉</a>

</div>

<div class="copyright">版权所有 IT知识库 CopyRight © 2000-2050 E-COM-NET.COM , All Rights Reserved.

<!-- <a href="https://beian.miit.gov.cn/" rel="nofollow" target="_blank">京ICP备09083238号</a><br>-->

</div>

</div>

</footer>

<!-- 代码高亮 -->

<script type="text/javascript" src="/static/syntaxhighlighter/scripts/shCore.js"></script>

<script type="text/javascript" src="/static/syntaxhighlighter/scripts/shLegacy.js"></script>

<script type="text/javascript" src="/static/syntaxhighlighter/scripts/shAutoloader.js"></script>

<link type="text/css" rel="stylesheet" href="/static/syntaxhighlighter/styles/shCoreDefault.css"/>

<script type="text/javascript" src="/static/syntaxhighlighter/src/my_start_1.js"></script>

</body>

</html>