【Hadoop开发环境搭建】三、Hadoop集群搭建

三、Hadoop集群搭建

在上篇中记录了Hadoop安装与配置,在本篇中,介绍一下Hadoop集群的搭建

1.现有环境

三台云服务器(Linux系统、JDK1.8、Hadoop 2.2.7)

2.关闭防火墙、修改IP、修改hostname、修改host文件

(1)查看防火墙状态

systemctl status firewalld.service显示active状态

(2)关闭防火墙

systemctl stop firewalld

systemctl disable firewalld(3)关闭selinux

vi /etc/sysconfig/selinux修改结果如下:

(3)修改hostname

三台虚拟主机分别修改hostname为 master/slave1/slave2:

hostnamectl set-hostname master/slave1/slave2(4)修改host文件,配置IP地址和主机名之间的对应关系

vi /etc/hosts我修改的内容如图:

然后将修改后的文件复制到其它机器(用scp指令)

scp /etc/hosts 172.16.29.77:/etc/

scp /etc/hosts 172.16.29.210:/etc/3.设置ssh免密登录

(1)输入命令生成密钥:

ssh-keygen -t rsa(2)然后一直按回车,结果如下,会在root目录下生成一个ssh文件:

(3)进入.ssh文件目录下执行命令以合并公钥:

cd .ssh

cat ./id_rsa.pub>>authorized_keys

cat authorized_keys得到密钥:

(4)然后将密钥发给各节点,同时在修改本地的密钥文件信息:

vi authorized_keys三个虚拟机均配置好文件后保存,就可以实现免密登录啦~

4.相关配置文件修改

(1)core-site.xml

vi core-site.xml主要修改或添加的配置内容如下(IP填master的IP地址):

(2)hdfs-site.xml

vi hdfs-site.xml主要修改或添加的配置内容如下(这里把slave1当做secondary namenode,所以下面的ip地址填slave1的ip,端口不变):

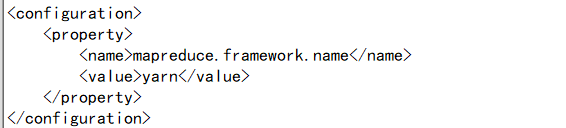

(3)mapred-site.xml

主要修改或添加的配置内容如下:

vi mapred-site.xml(4)yarn-site.xml

主要修改或添加的配置内容如下:

(5)slaves(创建新文件,并添加主从节点的ip地址)

vi slaves(6)hosts(直接创建新文件,添加以下内容即可)

127.0.0.1 localhost localhost.localdomain localhost4 localhost4.localdomain4

::1 localhost localhost.localdomain localhost6 localhost6.localdomain6

192.168.88.22 hadoop5.Hadoop启动与测试

(1)先格式化namenode,然后启动Hadoop

hdfs namenode -format

start-all.sh(2)然后输入网址(http://172.16.29.76:50070)查看启动信息:

(3)通过http://172.16.29.76:8088还可以看到节点运行状态

至此可以看到三个节点均处于运行状态,配置集群成功 ^_^ 。