西瓜书笔记—7.贝叶斯分类器

7.1贝叶斯决策论(如何基于已知概率和误判损失来选择最优的类别标记)

关键词:期望损失与条件风险,贝叶斯判定准则、贝叶斯最优分类器、贝叶斯风险,判别式与生成式,贝叶斯定理,类概率与类条件概率

1.(1)后验概率![]()

(2)期望损失与条件风险:基于后验概率P可获得样本x分类为ci所产生的期望损失,也即样本x上的‘条件风险’,![]() .λij

.λij

将一个真实样本标记为cj 的样本错误分类为ci所产生的损失。

(3)贝叶斯判定准则:我们要寻找一个判定准则h:X—>Y来最小化总体风险,若h能最小化每个样本x的条件风险,则总体风险也将被最小化。

贝叶斯判定准则为:为最小化总体风险,只需在每个样本上选择那个能使条件风险![]() 最小的类别标记,即

最小的类别标记,即![]() 。

。

此时,h*为贝叶斯最优分类器,与之对应的总体风险R(h*)成为贝叶斯风险。

若目标是最小化分类错误率,则误判损失可写为:

P(c)是类”先验“概率;P(x|c)是样本x相对于类标记c的类条件概率,或称为”似然“;

p(x)与类标记无关,因此估计p(c|x)的问题就转换成如何基于训练集D来估计先验P(c)和似然P(x|c)。

P(c)可以通过各类样本出现的概率来进行估计。对于类条件概率 P(x|c) 来说,由于它涉及关于x所有属性的联合概率,直接根据样本出现的概率来估计将会遇到严重的困难。

7.2极大似然估计

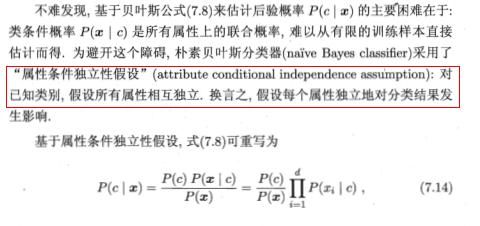

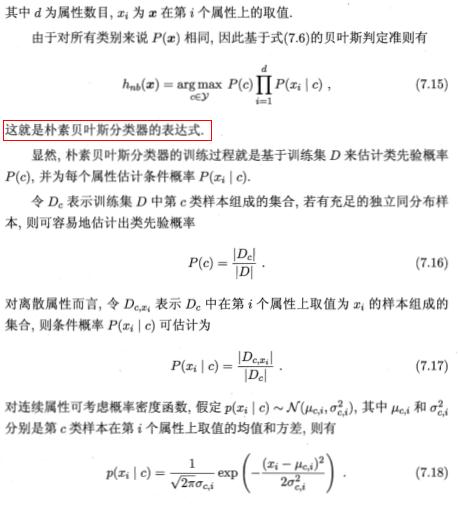

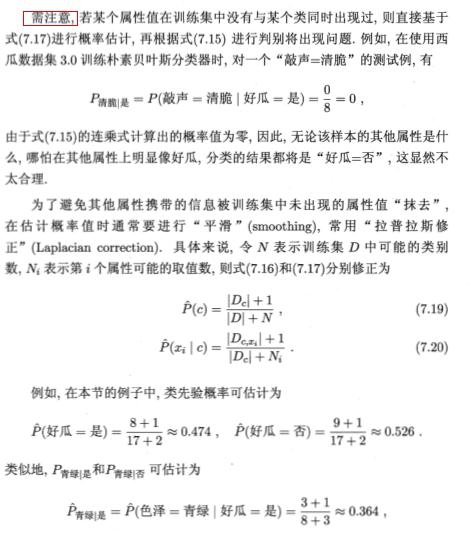

7.3朴素贝叶斯分类器

接着,

同时,也要注意,

最后,朴素贝叶斯分类器有多种使用方式:

若任务对预测速度要求较高,则给定训练集,可将涉及到的所有概率估计值先计算好存储起来,在进行预测时只需“查表”即可进行判别;

若任务数据更换频繁,可采用懒惰学习(lazy learning)方式,先不进行任何训练,待收到预测请求时再根据当前数据集进行概率估计值;

若数据不断增加,则可在现有估值基础上,仅对新样本的属性所涉及的概率估值进行计数修正,实现增量学习。

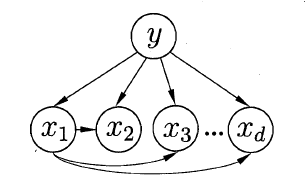

7.4半朴素贝叶斯分类器(与朴素贝叶斯相比,半朴素 适当考虑一部分属性间的相互依赖信息)

1.独依赖估计(One-Dependent Estimator,简称ODE)是半朴素贝叶斯分类器最常用的一种策略。

其中paipai为属性xixi所依赖的属性,称为xixi的父属性。

2.SPODE

假设所有属性都依赖于同一个属性,称为“超父”(super-parent),然后通过交叉验证等模型选择方法来确定超父属性。这个算法是每个属性值只与其他唯一 一个有依赖关系.

其中,xi为超父属性。

3.TAN

4.AODE

AODE是一种基于集成学习机制,更为强大的独依赖分类器,尝试将每个属性作为超父属性来构建SPODE,将具有足够训练数据支撑的SPODE集成起来作为最终结果。

7.5贝叶斯网络(信念网)

c

i

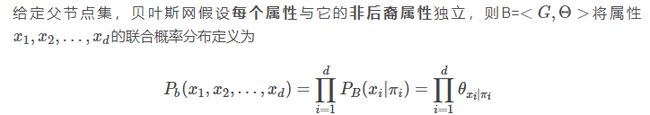

贝叶斯网:借助有向无环图来刻画属性之间的依赖关系,并使用条件概率表(Conditional Probability Table)来描述属性的联合概率分布。一个贝叶斯网B由结构G和参数Θ两部分构成,即B=<G,Θ>

网络结构G: 一个有向无环图,其每一个结点对应于一个属性,若两个属性有直接依赖关系,则它们由一条边连接起来。

参数Θ: 描述属性间的直接依赖关系,假设属性xixi在G中的父节点集为πiπi,则Θ包含了每个属性的条件概率表![]()

7.5.1结构

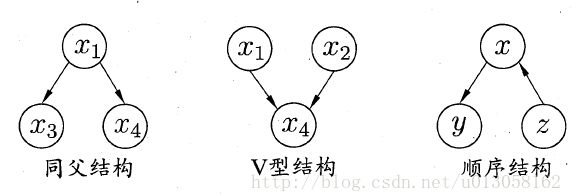

贝叶斯网中三个变量之间的典型依赖关系如下:

7.5.2学习

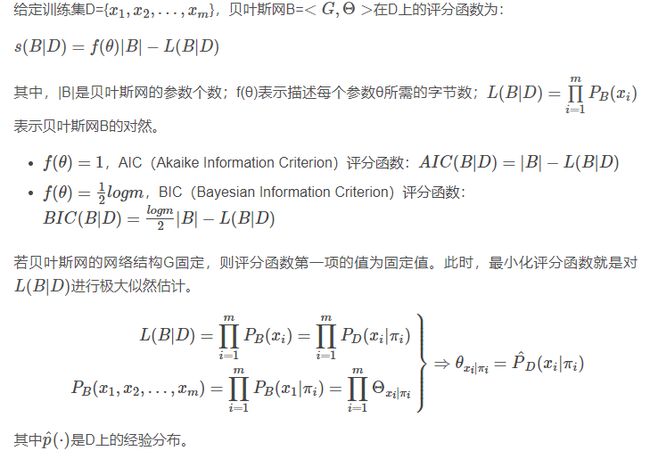

贝叶斯网学习的首要任务就是根据训练数据集找出结构最“恰当”的贝叶斯网。“评分搜索”是求解这一问题的常用办法:

(1)定义一个评分函数用于评估贝叶斯网与训练数据的契合程度;

(2)基于评分函数寻找结构最优的贝叶斯网

常用评分函数通常基于信息论准则,其将学习问题看作一个数据压缩任务,学习的目标是找到一个能以最短编码长度描述训练数据的模型,其中编码的长度包括描述模型自身所需的字节长度和使用该模型描述数据所需的字节长度。

对于贝叶斯网学习而言,模型就为一个贝叶斯网,每个贝叶斯网描述了一个在训练数据上的概率分布,其自由一套编码机制。因此,我们只需选择综合编码长度最短的贝叶斯网。这就是“最小描述长度”准则。

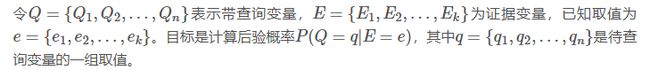

7.5.3推断

通过已知变量观测值来推测待查询变量的过程称为“推断”,其中已知变量观测值称为“证据”。在现实应用中,贝叶斯网的近似推断常使用吉布斯采样(Gibbs sampling)来完成。

吉布斯采样法(后续补充)

参考:

http://blog.csdn.net/u013058162/article/details/78499713?locationNum=10&fps=1

c通过已知变量观测值来推测待查询变量的过程称为“推断”,其中已知变量观测值称为“证据”。在现实应用中,贝叶斯网的近似推断常使用吉布斯采样(Gibbs sampling)来完成。参考:http://blog.csdn.net/w417950004/article/details/77602710

chttp://blog.csdn.net/u013058162/article/details/78499713?locationNum=10&fps=1