- Mybatis

微风粼粼

mybatistomcatjava

1、概述什么是mybatis?MyBatis是一个基于Java的持久层框架,它支持定制化SQL、存储过程以及高级映射。MyBatis消除了几乎所有的JDBC代码和参数的手动设置以及结果集的检索。MyBatis使用简单的XML或注解用于配置和原始映射,将接口和Java的POJOs(PlainOrdinaryJavaObjects,普通的Java对象)映射成数据库中的记录。它是一款半自动的ORM持久层

- html2Canvas不支持object-fit属性导致图片变形了

懒大王、

前端css3

html2Canvas是不支持object-fit属性data(){return{leftImageStyle:{position:'absolute',width:'1952px',height:'3600px',left:'0',top:'0'}};},mounted(){this.$nextTick(()=>{this.calculateImageDimensions();});},calc

- kotlin 读取json文件_Kotlin入门(31)JSON字符串的解析

weixin_39727743

kotlin读取json文件

json是App进行网络通信最常见的数据交互格式,Android也自带了json格式的处理工具包org.json,该工具包主要提供了JSONObject(json对象)与JSONArray(json数组)的解析处理。下面分别介绍这两个工具类的用法:1、JSONObjectJSONObject的常用方法如下所示:构造函数:从指定字符串构造出一个JSONObject对象。getJSONObject:获

- 如何使用单例模式保证全局唯一实例(复杂版本)

//////登录管理类(单例模式),负责用户登录、注销及用户信息管理///publicclassLoginMananger{//用于线程同步的锁对象staticobject_lockObj=newobject();//单例实例(延迟初始化)staticLoginManangerloginMananger=null;//用户数据库操作帮助类ELMeasure.Model.UserSqlHelpuse

- Set接口常用方法总结(Java:集合与泛型(二))

挺菜的

java集合与泛型Setjava

一、Set接口概述:Set接口继承Collection接口。Set接口的常用实现类有:HashSet,LinkedHashSet和TreeSet.Set和List一样是接口,不能直接实例化,只能通过其实现类来实例化.二、Set接口常用方法总结:注:该博客代码中引包代码均省略,eclipse用户可通过CTRL+shift+o来进行快捷引包add(Objectobj):向Set集合中添加元素,添加成功

- C#事件驱动编程:标准事件模式完全指南

钢铁男儿

C#图解教程c#开发语言

事件驱动是GUI编程的核心逻辑。当程序被按钮点击、按键或定时器中断时,如何规范处理事件?.NET框架通过EventHandler委托给出了标准答案。一、EventHandler委托:事件处理的基石publicdelegatevoidEventHandler(objectsender,EventArgse);参数解析:objectsender→事件源对象(任意类型)EventArgse→事件数据容器

- Spatie Laravel-Data 数据转换器深度解析

倪俪珍Phineas

SpatieLaravel-Data数据转换器深度解析laravel-dataPowerfuldataobjectsforLaravel项目地址:https://gitcode.com/gh_mirrors/la/laravel-data什么是数据转换器在SpatieLaravel-Data项目中,数据转换器(Transformers)扮演着将复杂数据类型转换为简单类型的关键角色。当我们需要将数据

- 20.XLD轮廓

Echo``

Halcon系统化学习计算机视觉人工智能算法

目录1.xld概念2.画轮廓3.区域转轮廓4.边缘提取算子5.xld特征提取6.提取任意线条7.提取最长的线条8.xld分割10.xld合并11.xld拟合12.xld几何变换13.xld变换14.xld集合运算15.区域和轮廓精度16.轮廓的保存读取17.halcon操作CAD文件18.轮廓测量算子19.同心度计算1.xld概念*图像处理*1.处理对象HObject*1.图像-image*2.区

- 解决部分机型浏览器 使用pdf.js 出现 undefined is not an object(evaluating ‘response.body.getReader‘) 报错问题

HHH 917

pdfjavascriptpdf前端

问题undefinedisnotanobject(evaluating‘response.body.getReader’)参考小王子的笔记本的技术博客仔细分析源码后发现,PDFjs的getDocument方法不仅可以接收URL作为参数,还可以接收多种类型:而fetch方法返回的Response对象恰恰拥有arrayBuffer方法,可以将数据转为ArrayBuffer对象解决PDF.getDocu

- [netty5: HttpServerCodec & HttpClientCodec]-源码分析

idolyXyz

netty5-源码阅读netty

在阅读该篇文章之前,推荐先阅读以下内容:[netty5:ChannelHandler&ChannelHandlerAdapter]-源码解析[netty5:HttpObjectEncoder&HttpObjectDecoder]-源码解析HttpServerCodecHttpServerCodec是一个Netty编解码器,结合HttpRequestDecoder和HttpResponseEncod

- spring面试题【持续更新ing】

spring面试题一、什么是循环依赖(高频)?二、Spring如何解决循环依赖?三、Spring都有哪些重要的模块?四、什么是SpringIOC?五、SpringIOC有什么好处?六、Spring中的DI是什么?七、什么是SpringBean?八、Spring中的BeanFactory是什么?九、Spring中的FactoryBean是什么?十、Spring中的ObjectFactory是什么?十

- AttributeError: ‘numpy.ndarray‘ object has no attribute ‘unsqueeze‘

ddfa1234

numpypython深度学习

z=z*pts_depth.unsqueeze(1)*0.1AttributeError:'numpy.ndarray'objecthasnoattribute'unsqueeze'这个错误是因为unsqueeze()方法是PyTorch张量的方法,而不是NumPy数组的方法。在这里,pts_depth是一个NumPy数组,因此不能使用unsqueeze()方法。如果要在NumPy中实现类似于un

- Python 基础入门第十三讲 魔法方法补充、单例模式、reflect反射(getattr、hasattr、__import__())

第十三讲一、特殊成员和魔法方法在之前的课程中已经学习过如__init__、__str__、__dir__等魔法方法,现补充一些常用的魔法方法:1.__doc__魔法方法该魔法方法的作用为打印类的说明文档,举个例子:print(str().__doc__)###输出结果为:str(object='')->strstr(bytes_or_buffer[,encoding[,errors]])->str

- 简述C++ nlohmann/json 库

ikkkkkkkl

jsonc++nlohmann

目录JSON概述nlohmann/json库的使用创建json数组/对象字符串解析(parse反序列化)数据访问序列化文件读写JSON概述JSON(JavaScripObjectNotation)是一种轻量级、跨语言的数据交换格式。它基于ECMAScript子集,以独立于编程语言的文本格式存储和表示数据,简洁清晰的结构使其成为理想的数据交换语言,易读、易写且便于机器解析生成,能提升网络传输效率。J

- YOLO学习笔记 | 从YOLOv5到YOLOv11:技术演进与核心改进

北斗猿

YOLO学习从零到1YOLO目标检测算法python计算机视觉

从YOLOv5到YOLOv11:技术演进与核心改进深度解析一、YOLO系列发展概述YOLO(YouOnlyLookOnce)目标检测算法自2016年诞生以来,凭借其"单次检测"的独特理念和卓越的实时性能,持续引领着计算机视觉领域的技术革新。从JosephRedmon的初代YOLO到AlexeyBochkovskiy的YOLOv4,再到Ultralytics团队的YOLOv5及后续系列,这一算法家族

- Zookeeper异常ConnectionLossException: KeeperErrorCode = ConnectionLoss for / 问题解决大全

takmehand

Javajavazookeeper

zookeeper报ConnectionLossException:KeeperErrorCode=ConnectionLossfor异常我的开发环境是Windows开发zookeeper客户端程序,zookeeper集群安装在本地虚拟机上centos7经过自己踩坑和查找博客,发现报此异常有三种原因一是:zookeeper服务没有启动,这是最low的错误二是:centos防火墙未关闭,导致连接不上

- Java SE入门及基础(62)& 线程池 & 执行器

卷到起飞的数分

JavaSEjava开发语言

线程池1.执行器Inallofthepreviousexamples,there'sacloseconnectionbetweenthetaskbeingdonebyanewthread,asdefinedbyitsRunnableobject,andthethreaditself,asdefinedbyaThreadobject.Thisworkswellforsmallapplications

- [netty5: MessageAggregator & HttpObjectAggregator]-源码解析

在阅读这篇文章前,推荐先阅读[netty5:ByteToMessageCodec&MessageToByteEncoder&ByteToMessageDecoder]-源码分析[netty5:HttpObject]-源码解析100-continue100-continue是HTTP/1.1协议中的一种机制,用于客户端在发送大体积请求体(如文件上传)前,先向服务器发送一个带有Expect:100-c

- mediapipe流水线分析 三

江太翁

AndroidNDK人工智能mediapipeandroid

目标检测Graph一流水线上游输入处理1TfLiteConverterCalculator将输入的数据转换成tensorflowapi支持的TensorTfLiteTensor并初始化相关输入输出节点,该类的业务主要通过interpreterstd::unique_ptrtflite::Interpreterinterpreter_=nullptr;实现类完成数据在cpu/gpu上的推理1.1Tf

- React与Vue的区别?

扎西_德勒

vue.jsreact.jsjavascript

一、区别:1.语法Vue采用自己特有的模板语法;React是单向的,采用jsx语法创建react元素。2.监听数据变化的实现原理不同Vue2.0通过Object.defineproperty()方法的getter/setter属性,实现数据劫持,每次修改完数据会触发diff算法(双端对比)React默认是通过shouldComponentUpdata生命周期来决定是否需要渲染更新,再触发它的dif

- C# Cefsharp 获取cookie 和设置cookie

Little_Code

cookiecefsharp

设置cookievarcook=Cef.GetGlobalCookieManager();cook.SetCookieAsync(url,newCefSharp.Cookie{Domain="",Name="",Value="",});读取cookieprivatevoidBrowser_FrameLoadEnd(objectsender,FrameLoadEndEventArgse){Cooki

- python优先队列使用_Python优先队列实现方法示例

本文实例讲述了Python优先队列实现方法。分享给大家供大家参考,具体如下:1.代码importQueueimportthreadingclassJob(object):def__init__(self,priority,description):self.priority=priorityself.description=descriptionprint'Newjob:',description

- 初始CNN(卷积神经网络)

超龄超能程序猿

机器学习cnn人工智能神经网络

卷积神经网络(ConvolutionalNeuralNetwork,简称CNN)作为深度学习的重要分支,在图像识别、目标检测、语义分割等领域大放异彩。无论是手机上的人脸识别解锁,还是自动驾驶汽车对道路和行人的识别,背后都离不开CNN的强大能力一、CNN诞生的背景与意义在CNN出现之前,传统的图像识别方法主要依赖人工提取特征,例如使用SIFT(尺度不变特征变换)、HOG(方向梯度直方图)等算法。这些

- 深度学习相关指标工作笔记

Victor Zhong

AI框架深度学习笔记人工智能

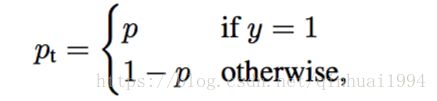

这里写目录标题检测指标iou/Gou/Diou/CiouMSE(MeanSquaredError)(均方误差)(回归问题)交叉熵损失函数(CrossEntropyErrorFunction)(分类问题)检测指标iou/Gou/Diou/CiouIntersectionoverUnion(IoU)是目标检测里一种重要的评价值交并比令人遗憾的是IoU无法优化无重叠的bboxes如果用IoU作为loss

- 前端手写题(二)

目录一、new二、call三、apply四、bind五、create一、newnew的核心作用:基于构造函数创建实例,绑定原型链,初始化对象属性。底层四步:创建空对象→绑定原型→执行构造函数→处理返回值functionobjectFactory(constructor,...args){ //严格校验构造函数 if(typeofconstructor!=='function'){ throwne

- JavaScript浅拷贝与深拷贝

旺代

JavaScript前端javascript开发语言

目录浅拷贝(ShallowCopy)一、浅拷贝的定义二、直接赋值vs浅拷贝1.直接赋值2.浅拷贝三、数组的浅拷贝方法1.slice()2.concat()3.扩展运算符(...)四、对象的浅拷贝方法1.Object.assign()2.扩展运算符(...)五、浅拷贝的局限性六、总结深拷贝(DeepCopy)一、深拷贝的定义二、深拷贝的常见实现方式1.JSON.parse(JSON.stringif

- Java学习第三部分——面向对象基础

慕y274

java学习开发语言

目录一.简介二.类和对象(一)类(Class)(二)对象(Object)三.构造方法(Constructor)四.封装(Encapsulation)五.继承(Inheritance)六.多态(Polymorphism)(一)方法重载(MethodOverloading)(二)方法覆盖(MethodOverriding)七.抽象类和接口(一)抽象类(AbstractClass)(二)接口(Inter

- 介绍Flutter

一、Flutter的核心优势:不止于跨平台高性能原生渲染自研引擎Skia:直接调用GPU绘制UI,绕过原生控件依赖,消除JavaScript桥接性能损耗,实现60fps流畅动画。三棵树渲染机制(Widget-Element-RenderObject):通过差异化更新最小化重绘范围,效率远超传统WebView方案。极速开发体验热重载(HotReload):代码修改后毫秒级生效,保留应用状态调试,开发

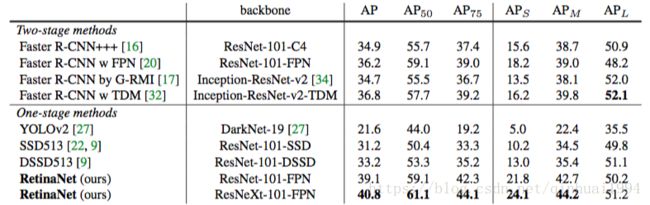

- 目标检测:从基础原理到前沿技术全面解析

随机森林404

计算机视觉目标检测人工智能计算机视觉

引言在计算机视觉领域,目标检测是一项核心且极具挑战性的任务,它不仅要识别图像中有什么物体,还要确定这些物体在图像中的具体位置。随着人工智能技术的快速发展,目标检测已成为智能监控、自动驾驶、医疗影像分析等众多应用的基础技术。本文将全面介绍目标检测的基础概念、发展历程、关键技术、实践应用以及未来趋势,为读者提供系统性的知识框架。第一章目标检测概述1.1目标检测的定义与重要性目标检测(ObjectDet

- Oracle DB和PostgreSQL,OpenGauss主外键一致性的区别

__风__

数据库oraclepostgresql

针对于unique索引在主外键上的表现,o和PG的行为确实不一致,测试样例:PG:测试1:test=#CREATETABLEgdb_editingtemplates(objectidINTEGERNOTNULL,globalidVARCHAR(38)DEFAULT'{00000000-0000-0000-0000-000000000000}'NOTNULL,typeSMALLINTNOTNULL,

- java的(PO,VO,TO,BO,DAO,POJO)

Cb123456

VOTOBOPOJODAO

转:

http://www.cnblogs.com/yxnchinahlj/archive/2012/02/24/2366110.html

-------------------------------------------------------------------

O/R Mapping 是 Object Relational Mapping(对象关系映

- spring ioc原理(看完后大家可以自己写一个spring)

aijuans

spring

最近,买了本Spring入门书:spring In Action 。大致浏览了下感觉还不错。就是入门了点。Manning的书还是不错的,我虽然不像哪些只看Manning书的人那样专注于Manning,但怀着崇敬 的心情和激情通览了一遍。又一次接受了IOC 、DI、AOP等Spring核心概念。 先就IOC和DI谈一点我的看法。IO

- MyEclipse 2014中Customize Persperctive设置无效的解决方法

Kai_Ge

MyEclipse2014

高高兴兴下载个MyEclipse2014,发现工具条上多了个手机开发的按钮,心生不爽就想弄掉他!

结果发现Customize Persperctive失效!!

有说更新下就好了,可是国内Myeclipse访问不了,何谈更新...

so~这里提供了更新后的一下jar包,给大家使用!

1、将9个jar复制到myeclipse安装目录\plugins中

2、删除和这9个jar同包名但是版本号较

- SpringMvc上传

120153216

springMVC

@RequestMapping(value = WebUrlConstant.UPLOADFILE)

@ResponseBody

public Map<String, Object> uploadFile(HttpServletRequest request,HttpServletResponse httpresponse) {

try {

//

- Javascript----HTML DOM 事件

何必如此

JavaScripthtmlWeb

HTML DOM 事件允许Javascript在HTML文档元素中注册不同事件处理程序。

事件通常与函数结合使用,函数不会在事件发生前被执行!

注:DOM: 指明使用的 DOM 属性级别。

1.鼠标事件

属性

- 动态绑定和删除onclick事件

357029540

JavaScriptjquery

因为对JQUERY和JS的动态绑定事件的不熟悉,今天花了好久的时间才把动态绑定和删除onclick事件搞定!现在分享下我的过程。

在我的查询页面,我将我的onclick事件绑定到了tr标签上同时传入当前行(this值)参数,这样可以在点击行上的任意地方时可以选中checkbox,但是在我的某一列上也有一个onclick事件是用于下载附件的,当

- HttpClient|HttpClient请求详解

7454103

apache应用服务器网络协议网络应用Security

HttpClient 是 Apache Jakarta Common 下的子项目,可以用来提供高效的、最新的、功能丰富的支持 HTTP 协议的客户端编程工具包,并且它支持 HTTP 协议最新的版本和建议。本文首先介绍 HTTPClient,然后根据作者实际工作经验给出了一些常见问题的解决方法。HTTP 协议可能是现在 Internet 上使用得最多、最重要的协议了,越来越多的 Java 应用程序需

- 递归 逐层统计树形结构数据

darkranger

数据结构

将集合递归获取树形结构:

/**

*

* 递归获取数据

* @param alist:所有分类

* @param subjname:对应统计的项目名称

* @param pk:对应项目主键

* @param reportList: 最后统计的结果集

* @param count:项目级别

*/

public void getReportVO(Arr

- 访问WEB-INF下使用frameset标签页面出错的原因

aijuans

struts2

<frameset rows="61,*,24" cols="*" framespacing="0" frameborder="no" border="0">

- MAVEN常用命令

avords

Maven库:

http://repo2.maven.org/maven2/

Maven依赖查询:

http://mvnrepository.com/

Maven常用命令: 1. 创建Maven的普通java项目: mvn archetype:create -DgroupId=packageName

- PHP如果自带一个小型的web服务器就好了

houxinyou

apache应用服务器WebPHP脚本

最近单位用PHP做网站,感觉PHP挺好的,不过有一些地方不太习惯,比如,环境搭建。PHP本身就是一个网站后台脚本,但用PHP做程序时还要下载apache,配置起来也不太很方便,虽然有好多配置好的apache+php+mysq的环境,但用起来总是心里不太舒服,因为我要的只是一个开发环境,如果是真实的运行环境,下个apahe也无所谓,但只是一个开发环境,总有一种杀鸡用牛刀的感觉。如果php自己的程序中

- NoSQL数据库之Redis数据库管理(list类型)

bijian1013

redis数据库NoSQL

3.list类型及操作

List是一个链表结构,主要功能是push、pop、获取一个范围的所有值等等,操作key理解为链表的名字。Redis的list类型其实就是一个每个子元素都是string类型的双向链表。我们可以通过push、pop操作从链表的头部或者尾部添加删除元素,这样list既可以作为栈,又可以作为队列。

&nbs

- 谁在用Hadoop?

bingyingao

hadoop数据挖掘公司应用场景

Hadoop技术的应用已经十分广泛了,而我是最近才开始对它有所了解,它在大数据领域的出色表现也让我产生了兴趣。浏览了他的官网,其中有一个页面专门介绍目前世界上有哪些公司在用Hadoop,这些公司涵盖各行各业,不乏一些大公司如alibaba,ebay,amazon,google,facebook,adobe等,主要用于日志分析、数据挖掘、机器学习、构建索引、业务报表等场景,这更加激发了学习它的热情。

- 【Spark七十六】Spark计算结果存到MySQL

bit1129

mysql

package spark.examples.db

import java.sql.{PreparedStatement, Connection, DriverManager}

import com.mysql.jdbc.Driver

import org.apache.spark.{SparkContext, SparkConf}

object SparkMySQLInteg

- Scala: JVM上的函数编程

bookjovi

scalaerlanghaskell

说Scala是JVM上的函数编程一点也不为过,Scala把面向对象和函数型编程这两种主流编程范式结合了起来,对于熟悉各种编程范式的人而言Scala并没有带来太多革新的编程思想,scala主要的有点在于Java庞大的package优势,这样也就弥补了JVM平台上函数型编程的缺失,MS家.net上已经有了F#,JVM怎么能不跟上呢?

对本人而言

- jar打成exe

bro_feng

java jar exe

今天要把jar包打成exe,jsmooth和exe4j都用了。

遇见几个问题。记录一下。

两个软件都很好使,网上都有图片教程,都挺不错。

首先肯定是要用自己的jre的,不然不能通用,其次别忘了把需要的lib放到classPath中。

困扰我很久的一个问题是,我自己打包成功后,在一个同事的没有装jdk的电脑上运行,就是不行,报错jvm.dll为无效的windows映像,如截图

最后发现

- 读《研磨设计模式》-代码笔记-策略模式-Strategy

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

/*

策略模式定义了一系列的算法,并将每一个算法封装起来,而且使它们还可以相互替换。策略模式让算法独立于使用它的客户而独立变化

简单理解:

1、将不同的策略提炼出一个共同接口。这是容易的,因为不同的策略,只是算法不同,需要传递的参数

- cmd命令值cvfM命令

chenyu19891124

cmd

cmd命令还真是强大啊。今天发现jar -cvfM aa.rar @aaalist 就这行命令可以根据aaalist取出相应的文件

例如:

在d:\workspace\prpall\test.java 有这样一个文件,现在想要将这个文件打成一个包。运行如下命令即可比如在d:\wor

- OpenJWeb(1.8) Java Web应用快速开发平台

comsci

java框架Web项目管理企业应用

OpenJWeb(1.8) Java Web应用快速开发平台的作者是我们技术联盟的成员,他最近推出了新版本的快速应用开发平台 OpenJWeb(1.8),我帮他做做宣传

OpenJWeb快速开发平台以快速开发为核心,整合先进的java 开源框架,本着自主开发+应用集成相结合的原则,旨在为政府、企事业单位、软件公司等平台用户提供一个架构透

- Python 报错:IndentationError: unexpected indent

daizj

pythontab空格缩进

IndentationError: unexpected indent 是缩进的问题,也有可能是tab和空格混用啦

Python开发者有意让违反了缩进规则的程序不能通过编译,以此来强制程序员养成良好的编程习惯。并且在Python语言里,缩进而非花括号或者某种关键字,被用于表示语句块的开始和退出。增加缩进表示语句块的开

- HttpClient 超时设置

dongwei_6688

httpclient

HttpClient中的超时设置包含两个部分:

1. 建立连接超时,是指在httpclient客户端和服务器端建立连接过程中允许的最大等待时间

2. 读取数据超时,是指在建立连接后,等待读取服务器端的响应数据时允许的最大等待时间

在HttpClient 4.x中如下设置:

HttpClient httpclient = new DefaultHttpC

- 小鱼与波浪

dcj3sjt126com

一条小鱼游出水面看蓝天,偶然间遇到了波浪。 小鱼便与波浪在海面上游戏,随着波浪上下起伏、汹涌前进。 小鱼在波浪里兴奋得大叫:“你每天都过着这么刺激的生活吗?简直太棒了。” 波浪说:“岂只每天过这样的生活,几乎每一刻都这么刺激!还有更刺激的,要有潮汐变化,或者狂风暴雨,那才是兴奋得心脏都会跳出来。” 小鱼说:“真希望我也能变成一个波浪,每天随着风雨、潮汐流动,不知道有多么好!” 很快,小鱼

- Error Code: 1175 You are using safe update mode and you tried to update a table

dcj3sjt126com

mysql

快速高效用:SET SQL_SAFE_UPDATES = 0;下面的就不要看了!

今日用MySQL Workbench进行数据库的管理更新时,执行一个更新的语句碰到以下错误提示:

Error Code: 1175

You are using safe update mode and you tried to update a table without a WHERE that

- 枚举类型详细介绍及方法定义

gaomysion

enumjavaee

转发

http://developer.51cto.com/art/201107/275031.htm

枚举其实就是一种类型,跟int, char 这种差不多,就是定义变量时限制输入的,你只能够赋enum里面规定的值。建议大家可以看看,这两篇文章,《java枚举类型入门》和《C++的中的结构体和枚举》,供大家参考。

枚举类型是JDK5.0的新特征。Sun引进了一个全新的关键字enum

- Merge Sorted Array

hcx2013

array

Given two sorted integer arrays nums1 and nums2, merge nums2 into nums1 as one sorted array.

Note:You may assume that nums1 has enough space (size that is

- Expression Language 3.0新特性

jinnianshilongnian

el 3.0

Expression Language 3.0表达式语言规范最终版从2013-4-29发布到现在已经非常久的时间了;目前如Tomcat 8、Jetty 9、GlasshFish 4已经支持EL 3.0。新特性包括:如字符串拼接操作符、赋值、分号操作符、对象方法调用、Lambda表达式、静态字段/方法调用、构造器调用、Java8集合操作。目前Glassfish 4/Jetty实现最好,对大多数新特性

- 超越算法来看待个性化推荐

liyonghui160com

超越算法来看待个性化推荐

一提到个性化推荐,大家一般会想到协同过滤、文本相似等推荐算法,或是更高阶的模型推荐算法,百度的张栋说过,推荐40%取决于UI、30%取决于数据、20%取决于背景知识,虽然本人不是很认同这种比例,但推荐系统中,推荐算法起的作用起的作用是非常有限的。

就像任何

- 写给Javascript初学者的小小建议

pda158

JavaScript

一般初学JavaScript的时候最头痛的就是浏览器兼容问题。在Firefox下面好好的代码放到IE就不能显示了,又或者是在IE能正常显示的代码在firefox又报错了。 如果你正初学JavaScript并有着一样的处境的话建议你:初学JavaScript的时候无视DOM和BOM的兼容性,将更多的时间花在 了解语言本身(ECMAScript)。只在特定浏览器编写代码(Chrome/Fi

- Java 枚举

ShihLei

javaenum枚举

注:文章内容大量借鉴使用网上的资料,可惜没有记录参考地址,只能再传对作者说声抱歉并表示感谢!

一 基础 1)语法

枚举类型只能有私有构造器(这样做可以保证客户代码没有办法新建一个enum的实例)

枚举实例必须最先定义

2)特性

&nb

- Java SE 6 HotSpot虚拟机的垃圾回收机制

uuhorse

javaHotSpotGC垃圾回收VM

官方资料,关于Java SE 6 HotSpot虚拟机的garbage Collection,非常全,英文。

http://www.oracle.com/technetwork/java/javase/gc-tuning-6-140523.html

Java SE 6 HotSpot[tm] Virtual Machine Garbage Collection Tuning

&

![]()