XGB算法梳理

转自:https://blog.csdn.net/qq_20412595/article/details/82621744

1、回顾下GB、GBDT

GBDT和xgboost在竞赛和工业界使用都非常频繁,能有效的应用到分类、回归、排序问题,因此这里尝试一步一步梳理GB、GBDT、xgboost,它们之间有非常紧密的联系,GBDT是以决策树(CART)为基学习器的GB算法,xgboost扩展和改进了GDBT,xgboost算法更快,准确率也相对高一些。

1.1、Gradient boosting(GB)

机器学习中的学习算法的目标是为了优化或者说最小化loss Function, Gradient boosting的思想是迭代生多个(M个)弱的模型,然后将每个弱模型的预测结果相加,后面的模型![]() 基于前面学习模型的

基于前面学习模型的![]() 的效果生成的,关系如下:

的效果生成的,关系如下:

![]()

GB算法的思想很简单,关键是怎么生成![]() ?

?

如果目标函数是回归问题的均方误差,很容易想到最理想的![]() 应该是能够完全拟合

应该是能够完全拟合 ![]() ,这就是常说基于残差的学习。残差学习在回归问题中可以很好的使用,但是为了一般性(分类,排序问题),实际中往往是基于loss Function 在函数空间的的负梯度学习,对于回归问题

,这就是常说基于残差的学习。残差学习在回归问题中可以很好的使用,但是为了一般性(分类,排序问题),实际中往往是基于loss Function 在函数空间的的负梯度学习,对于回归问题![]() 残差和负梯度也是相同的。

残差和负梯度也是相同的。![]() 中的f,不要理解为传统意义上的函数,而是一个函数向量

中的f,不要理解为传统意义上的函数,而是一个函数向量![]() ,向量中元素的个数与训练样本的个数相同,因此基于Loss Function函数空间的负梯度的学习也称为“伪残差”。

,向量中元素的个数与训练样本的个数相同,因此基于Loss Function函数空间的负梯度的学习也称为“伪残差”。

GB算法的步骤:

1.初始化模型为常数值:

2.迭代生成M个基学习器

1)计算伪残差

2.基于![]() 生成基学习器

生成基学习器![]()

3.计算最优的![]()

4.更新模型

1.2、Gradient boosting Decision Tree(GBDT)

GBDT的原理篇在上一篇已经阐述过,这里稍微总结性下,GBDT是GB和DT的结合。要注意的是这里的决策树是分类回归树(是一种二叉树),GBDT中的决策树是个弱模型,有些GBDT的实现加入了随机抽样(subsample 0.5<=f <=0.8)提高模型的泛化能力。通过交叉验证的方法选择最优的参数。

因此GBDT实际的核心问题变成怎么基于![]() 使用CART回归树生成

使用CART回归树生成![]() ?

?

2、Xgboost算法

前面已经说过,xgboost可以说集成思想达到顶峰的一个模型,至少目前是这样,所以我们学习机器学习算法, 掌握这个是很有必要的。顺带提一下,Xgboost目前scikit-learn中没有实现,需要我们自行安装Xgboost,可以通过python调用,我自己也记录了一个纯小白都能安装好的方法。

- 全称:eXtreme Gradient Boosting(极值梯度提升算法)

- 作者:陈天奇(华盛顿大学博士)

- 基础:GBDT

- 所属:boosting迭代型、树类算法。

- 适用范围:分类、回归等

- 优点:速度快、效果好、能处理大规模数据、支持多种语言、支持自定义损失函数等等。

2.1、与GBDT的区别:

首先我们先在大体上对xgboost有个大致的印象,然后我们在对其原理做详细的阐述。

• XGBoost的基学习器除了可以是CART(这个时候就是GBDT)也可以是线性分类器,而GBDT只能是CART。

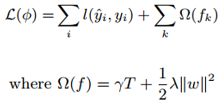

• XGBoost在代价函数中加入了正则项,用于控制模型的复杂度(正则项的方式不同,如果你仔细点话,GBDT是一种类似于缩 减系数,而XGBoost类似于L2正则化项)。

• XGBoost借鉴了随机森林的做法,支持特征抽样,不仅防止过拟合,还能减少计算

• XGBoost工具支持并行化

• 综合来说Xgboost的运算速度和算法精度都会优于GBDT

2.2 Xgboost算法原理

Xgboost是GB算法的高效实现,xgboost中的基学习器除了可以是CART也可以是线性分类器(gblinear)。下面所有的内容来自原始paper,包括公式。

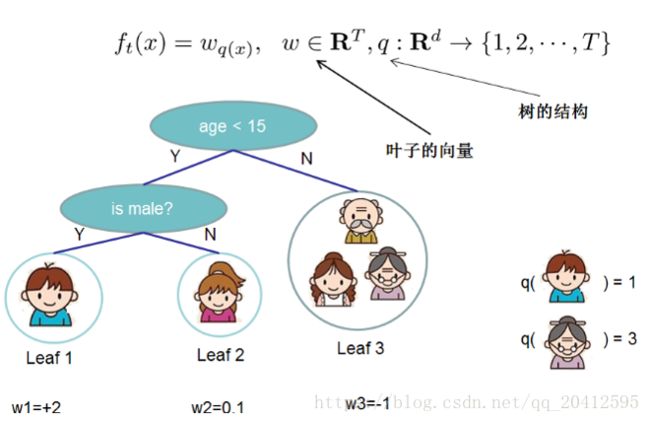

1)树的结构

我们从单一的树来考虑。对于其中每一棵回归树,其模型可以写成:![]()

其中![]() 为叶子节点的得分值,

为叶子节点的得分值,![]() 表示样本

表示样本![]() 对应的叶子节点。

对应的叶子节点。![]() 为该树的叶子节点个数。

为该树的叶子节点个数。

其中,γγ为L1L1正则的惩罚项,λλ为L2L2正则的惩罚项

复杂度计算例子如下:

2) 损失函数

前面已经说过,为了一般性,实际中往往是基于loss Function ![]() 在函数空间的的负梯度学习,对于回归问题

在函数空间的的负梯度学习,对于回归问题![]() 残差和负梯度也是相同的。和传统的boosting tree模型一样,xgboost的提升模型也是采用的残差(或梯度负方向),不同的是分裂结点选取的时候不一定是最小平方损失。

残差和负梯度也是相同的。和传统的boosting tree模型一样,xgboost的提升模型也是采用的残差(或梯度负方向),不同的是分裂结点选取的时候不一定是最小平方损失。

对目标函数的改写:

最终的目标函数只依赖于每个数据点的在误差函数上的一阶导数和二阶导数。这么写的原因很明显,由于之前的目标函数求最优解的过程中只对平方损失函数时候方便求,对于其他的损失函数变得很复杂,通过二阶泰勒展开式的变换,这样求解其他损失函数变得可行了。

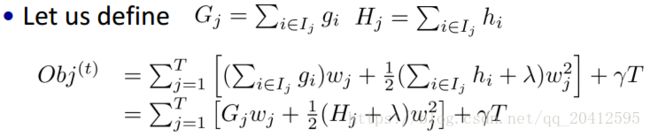

我相信到这里肯定都没有问题,接下来的理解是整个损失函数的难点,我自己开始学的时候想了一些时间,接下来我尽量用白话来叙述。

1)对![]() 的理解:在上面我们已经说了,当一个样本进来的时候,不管是回归问题还是分类问题,你最终都会掉到叶子结点上,而每颗树的每个叶子节点都会对应有一个得分(想象一下回归问题,每个叶子节点对应的是落入该叶子结点的所有训练样本的均值),所以

的理解:在上面我们已经说了,当一个样本进来的时候,不管是回归问题还是分类问题,你最终都会掉到叶子结点上,而每颗树的每个叶子节点都会对应有一个得分(想象一下回归问题,每个叶子节点对应的是落入该叶子结点的所有训练样本的均值),所以![]() 可以理解为一个样本在t轮最终的得分函数。

可以理解为一个样本在t轮最终的得分函数。

2)对![]() 的理解:其实这个的理解,我最初钻了牛角尖,其实只要当我们的损失函数一旦确定下来(理解的前提),这个求导就和我们高数中的求导一回事啦,只不过表达式看起来很唬人。

的理解:其实这个的理解,我最初钻了牛角尖,其实只要当我们的损失函数一旦确定下来(理解的前提),这个求导就和我们高数中的求导一回事啦,只不过表达式看起来很唬人。

3)目标函数全部转换成在第t棵树叶子节点的形式。从求和符号我们可以看出,是在对每个样本求损失,我们在第一点就已经说了,第i个样本最终都会落到树的叶子结点中去的,只是不同的叶子节点,你会取不同的值罢了。那我们能不能讲对样本的损失转移到对叶子结点中再求损失呢(后话,这个就是这么做的),![]() 可以看做是每个样本在第t棵树的叶子节点得分值相关函数的结果之和,所以我们也能从第t棵树的叶子节点上来表示。

可以看做是每个样本在第t棵树的叶子节点得分值相关函数的结果之和,所以我们也能从第t棵树的叶子节点上来表示。

这里也在解释下,![]() 描述了一整颗树的模型,他当然能分解成每个叶子结点的集合啦,而

描述了一整颗树的模型,他当然能分解成每个叶子结点的集合啦,而![]() 刚好是每个叶子节点的得分函数,这两个于是就可以相互转化了。

刚好是每个叶子节点的得分函数,这两个于是就可以相互转化了。

其中![]() 为第t棵树中总叶子节点的个数,

为第t棵树中总叶子节点的个数,![]() 表示

表示![]() 样本落在第

样本落在第![]() 个叶子节点上,

个叶子节点上,![]() 为第

为第![]() 个叶子节点的得分值。

个叶子节点的得分值。

在这里,令

对![]() 求偏导,并使其导函数等于0,则有:

求偏导,并使其导函数等于0,则有:

到此,损失函数的推导完成。

3)树结构的打分函数

Obj代表了当指定一个树的结构的时候,在目标上面最多减少多少。结构分数(structure score)

xgboost算法的步骤和GB基本相同,都是首先初始化为一个常数,gb是根据一阶导数ri,xgboost是根据一阶导数gi和二阶导数hi,迭代生成基学习器,相加更新学习器。

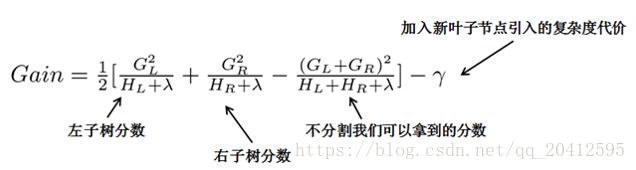

对于每一次尝试去对已有的叶子加入一个分割

这样就可以在建树的过程中动态的选择是否要添加一个结点。 联想决策树中信息增益,这里的原理类似。这一步实质上是为了寻找分裂结点的候选集。

如何高效地枚举所有的分割呢?我假设我们要枚举所有x < a 这样的条件,对于某个特定的分割a我们要计算a左边和右边的导数和。

我们可以发现对于所有的a,我们只要做一遍从左到右的扫描就可以枚举出所有分割的梯度和![]() 和

和![]() 。然后用上面的公式计算每个分割方案的分数就可以了。

。然后用上面的公式计算每个分割方案的分数就可以了。

xgboost算法伪代码如下:

3、Xgboost算法参数

XGBoost的作者把所有的参数分成了三类:

- 通用参数:宏观函数控制。

- Booster参数:控制每一步的booster(tree/regression)。

- 学习目标参数:控制训练目标的表现。

3.1通用参数

这些参数用来控制XGBoost的宏观功能。

1、booster[默认gbtree]

- 选择每次迭代的模型,有两种选择:

gbtree:基于树的模型

gbliner:线性模型

2、silent[默认0]

- 当这个参数值为1时,静默模式开启,不会输出任何信息。

- 一般这个参数就保持默认的0,因为这样能帮我们更好地理解模型。

3、nthread[默认值为最大可能的线程数]

- 这个参数用来进行多线程控制,应当输入系统的核数。

- 如果你希望使用CPU全部的核,那就不要输入这个参数,算法会自动检测它。

还有两个参数,XGBoost会自动设置,目前你不用管它。接下来咱们一起看booster参数。

3.2 booster参数

尽管有两种booster可供选择,我这里只介绍tree booster,因为它的表现远远胜过linear booster,所以linear booster很少用到。

1、eta[默认0.3]

- 和GBM中的 learning rate 参数类似。

- 通过减少每一步的权重,可以提高模型的鲁棒性。

- 典型值为0.01-0.2。

2、min_child_weight[默认1]

- 决定最小叶子节点样本权重和。

- 和GBM的 min_child_leaf 参数类似,但不完全一样。XGBoost的这个参数是最小样本权重的和,而GBM参数是最小样本总数。

- 这个参数用于避免过拟合。当它的值较大时,可以避免模型学习到局部的特殊样本。

- 但是如果这个值过高,会导致欠拟合。这个参数需要使用CV来调整。

3、max_depth[默认6]

- 和GBM中的参数相同,这个值为树的最大深度。

- 这个值也是用来避免过拟合的。max_depth越大,模型会学到更具体更局部的样本。

- 需要使用CV函数来进行调优。

- 典型值:3-10

4、max_leaf_nodes

- 树上最大的节点或叶子的数量。

- 可以替代max_depth的作用。因为如果生成的是二叉树,一个深度为n的树最多生成n2n2个叶子。

- 如果定义了这个参数,GBM会忽略max_depth参数。

5、gamma[默认0]

- 在节点分裂时,只有分裂后损失函数的值下降了,才会分裂这个节点。Gamma指定了节点分裂所需的最小损失函数下降值。

- 这个参数的值越大,算法越保守。这个参数的值和损失函数息息相关,所以是需要调整的。

6、max_delta_step[默认0]

- 这参数限制每棵树权重改变的最大步长。如果这个参数的值为0,那就意味着没有约束。如果它被赋予了某个正值,那么它会让这个算法更加保守。

- 通常,这个参数不需要设置。但是当各类别的样本十分不平衡时,它对逻辑回归是很有帮助的。

- 这个参数一般用不到,但是你可以挖掘出来它更多的用处。

7、subsample[默认1]

- 和GBM中的subsample参数一模一样。这个参数控制对于每棵树,随机采样的比例。

- 减小这个参数的值,算法会更加保守,避免过拟合。但是,如果这个值设置得过小,它可能会导致欠拟合。

- 典型值:0.5-1

8、colsample_bytree[默认1]

- 和GBM里面的max_features参数类似。用来控制每棵随机采样的列数的占比(每一列是一个特征)。

- 典型值:0.5-1

9、colsample_bylevel[默认1]

- 用来控制树的每一级的每一次分裂,对列数的采样的占比。

- 我个人一般不太用这个参数,因为subsample参数和colsample_bytree参数可以起到相同的作用。但是如果感兴趣,可以挖掘这个参数更多的用处。

10、lambda[默认1]

- 权重的L2正则化项。(和Ridge regression类似)。

- 这个参数是用来控制XGBoost的正则化部分的。虽然大部分数据科学家很少用到这个参数,但是这个参数在减少过拟合上还是可以挖掘出更多用处的。

11、alpha[默认1]

- 权重的L1正则化项。(和Lasso regression类似)。

- 可以应用在很高维度的情况下,使得算法的速度更快。

12、scale_pos_weight[默认1]

- 在各类别样本十分不平衡时,把这个参数设定为一个正值,可以使算法更快收敛。

3.3学习目标参数

这个参数用来控制理想的优化目标和每一步结果的度量方法。

1、objective[默认reg:linear]

- 这个参数定义需要被最小化的损失函数。最常用的值有:

- binary:logistic 二分类的逻辑回归,返回预测的概率(不是类别)。

- multi:softmax 使用softmax的多分类器,返回预测的类别(不是概率)。 在这种情况下,你还需要多设一个参数:num_class(类别数目)。

- multi:softprob 和multi:softmax参数一样,但是返回的是每个数据属于各个类别的概率。

2、eval_metric[默认值取决于objective参数的取值]

- 对于有效数据的度量方法。

- 对于回归问题,默认值是rmse,对于分类问题,默认值是error。

- 典型值有:

- rmse 均方根误差(∑Ni=1ϵ2N−−−−−√∑i=1Nϵ2N)

- mae 平均绝对误差(∑Ni=1|ϵ|N∑i=1N|ϵ|N)

- logloss 负对数似然函数值

- error 二分类错误率(阈值为0.5)

- merror 多分类错误率

- mlogloss 多分类logloss损失函数

- auc 曲线下面积

python的Xgbosoost调参实例:推荐看 https://blog.csdn.net/han_xiaoyang/article/details/52665396

除此以外,xgboost除了原生版的调用以外,sklearn还为我们封装了一个sklearn版本调用的方法,from xgboost import XGBClassifier,调参同样可以借用网格搜索的方法,这是一篇xgboost的网格搜索的案例

4、小结

xgboost与gdbt除了上述的不同,xgboost在实现时还做了许多优化:(以下转载于 机器学习系列(12)_XGBoost参数调优完全指南(附Python代码))

1)并行处理

- XGBoost可以实现并行处理,相比GBM有了速度的飞跃。

- 不过,众所周知,Boosting算法是顺序处理的,它怎么可能并行呢?每一课树的构造都依赖于前一棵树,那具体是什么让我们能用多核处理器去构造一个树呢?我希望你理解了这句话的意思。如果你希望了解更多,点击这个链接。

- XGBoost 也支持Hadoop实现。

2)高度的灵活性

- XGBoost 允许用户定义自定义优化目标和评价标准

3)缺失值处理

- XGBoost内置处理缺失值的规则。

- 用户需要提供一个和其它样本不同的值,然后把它作为一个参数传进去,以此来作为缺失值的取值。XGBoost在不同节点遇到缺失值时采用不同的处理方法,并且会学习未来遇到缺失值时的处理方法。

4)剪枝

5)内置交叉验证

- XGBoost允许在每一轮boosting迭代中使用交叉验证。因此,可以方便地获得最优boosting迭代次数。

- 而GBM使用网格搜索,只能检测有限个值。

参考资料:

https://www.cnblogs.com/wxquare/p/5541414.html

https://blog.csdn.net/a1b2c3d4123456/article/details/52849091

陈天奇的boosting tree的ppt:http://homes.cs.washington.edu/~tqchen/pdf/BoostedTree.pdf

sklearn版本调用的方法:XGBoost Python API Reference (official guide)

XGBoost 参数:http://xgboost.apachecn.org/cn/latest/parameter.html#

XGBoost-Python完全调参指南-参数解释篇https://blog.csdn.net/wzmsltw/article/details/50994481

XGBoost参数调优完全指南(附Python代码)https://blog.csdn.net/han_xiaoyang/article/details/52665396

python 下实现xgboost 调参演示https://blog.csdn.net/weixin_41370083/article/details/79276887

XGBoost调参技巧(二)Titanic实战Top9%https://blog.csdn.net/c2a2o2/article/details/77646025