一、背景

在当前信息空前爆炸的时代,人们不再担心信息的匮乏,而是为筛选有用的信息付出大量的代价。那么如何采集有用的信息呢?现在有RSS、博客等服务,但是并不能完全满足我们的需求,因为很多信息并不是以格式化的数据形式提供出来,于是聪明的工程师想出了精确搜索的方法,从而出现大量的垂直搜索网站(比如酷讯),确实火了一把。当然我们无法得知他们是怎么实现的,但是我们也可以实现这种精确采集,开源的Web-Harvest就是类似的技术,之前曾经接触过,故写出来分享给大家。

二、WebHarvest简介

Web-Harvest 是一个用Java 写的开源的Web 数据提取工具。它提供了一种从所需的页面上提取有用数据的方法。为了达到这个目的,你可能需要用到如XSLT,XQuery,和正则表达式等操作text/xml 的相关技术。Web-Harvest 主要着眼于目前仍占大多数的基于HMLT/XML 的页面内容。另一方面,它也能通过写自己的Java 方法来轻易扩展其提取能力。

Web-Harvest

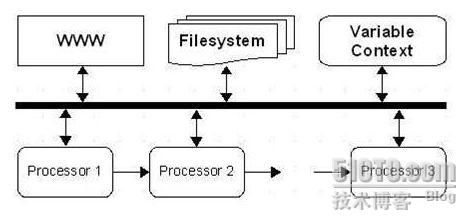

的主要目的是加强现有数据提取技术的应用。它的目标不是创造一种新方法,而是提供一种更好地使用和组合现有方法的方式。它提供了一个处理器集用于处理数据和控制流程,每一个处理器被看作是一个函数,它拥有参数和执行后同样有结果返回。而且处理是被组合成一个管道的形式,这样使得它们可以以链式的形式来执行,此外为了更易于数据操作和重用,

Web-Harvest

还提供了变量上下方用于存储已经声明的变量。以下的图表就描述了这种管道式处理器的执行情况

:

一、

配置语言

每个提取过程都被定义在了一个或多个基于

XML

的配置文件中,而且被描述为特定的或是结构化的

XML

元素中。为了更好地说明,下面列举了一个配置文件来进行说明:

页面爬取开始

,

按照关键词:“玩具”来搜索

–>

获取竞价排名的企业网站列表

–>

循环

urlList

,并把结果写入到

XML

文件中

–>

]]>

declare variable $item as node() external;

let $name := data($item//span/font[1]/text()[1])

let $url := data($item//span/font[2]/text())

return

]]>

]]>

上述的配置文件包含了三段。

第一段的执行步骤:

1.

下载

http://www.baidu.com/s?wd=玩具

里面的内容;

2.

清除下载内容里面的

HTML

以产生

XHTML;

3.

第二段的执行步骤:

1.

用

XPath

表达式从所给的

URL

里面提取搜索结果;

2.

用一个新的变量“

urlList

”来保存上面的搜索结果;

第三段是利用上一段的搜索结果来提取相应的信息:

1.

循环里面迭代每一个

item

;

2.

获取每个

item

的

name

和

url

;

3.

将其保存在文件系统里;

有了配置文件(把该配置文件保存为

:baidu.xml

),我们再往前一步,写几行代码:

import java.io.IOException;

import org.webharvest.definition.ScraperConfiguration;

import org.webharvest.runtime.Scraper;

import org.webharvest.definition.ScraperConfiguration;

import org.webharvest.runtime.Scraper;

public class Test {

public static void main(String[] args) throws IOException {

ScraperConfiguration config = new ScraperConfiguration(”c:/baidu.xml”);

Scraper scraper = new Scraper(config, “c:/tmp/”);

scraper.setDebug(true);

long startTime = System.currentTimeMillis();

scraper.execute();

System.out.println(”time elapsed: ” + (System.currentTimeMillis() - startTime));

}

}

Scraper scraper = new Scraper(config, “c:/tmp/”);

scraper.setDebug(true);

long startTime = System.currentTimeMillis();

scraper.execute();

System.out.println(”time elapsed: ” + (System.currentTimeMillis() - startTime));

}

}

让我们执行一下,看看结果:

是不是很酷。爬虫就这么简单。

二、

深入考虑

不知道大家看到上面的配置、代码和结果是否感觉很熟悉。是否和

Java

通过

Ibatis

读取数据库数据的方式类似。

那我们是否可以实现这样的机制呢,把整个互联网作为我们的庞大的数据库,我们随意的读取。

Web-Harvest

提供了一个

ScraperContext ,

可以在该上下文中设置

Java

对象,可以通过

Java

对象收集相应的结果数据,(比如:设置

Map,

可以通过

Map

收集数据)

Scraper

提供了这样的方法:

scraper.getContext().put(“resDataSet”, new ResultDataSet());

ResultDataSet

是收集数据的

Java

对象。

那么我们就可以这么做:

a)

首先设置要访问的网页的路径

scraper.getContext().put(“startPageHref”, “http://www.baidu.com/s?cl=3&wd=

儿童玩具

“);

b)

第二步,设置要收集返回数据的容器

scraper.getContext().put(“resDataSet”, new ResultDataSet());

c)

在配置文件中就可以这样设置数据

${resDataSet.addRecord(“searchResult”,“totalSearchResult”,totalSearchResult)};

d)

爬取操作执行完毕后,即可返回数据:

ResultDataSet resultDataSet = (ResultDataSet)scraper.getContext().get(“resDataSet”);

Ok

,我们就可以随心所欲的使用这些数据,详细请看附件。

三、

分页机制处理

a)

来由介绍

现在的信息量很大,在展示的时候都是通过分页处理的。比如:

那我们怎么处理呢?分页提取数据我们得明确几件事情

1.

分页器的处理,比如:页码、页大小、记录数或页数。

2.

“下一页”的地址的构造

3.

每页数据的爬取

不同的网站的分页机制都不一样,我们如何处理呢?当然我们不能通过硬编码的方式来处理,我们就通过Web-Harvest的配置文件来实现。

Web-Harvest 本身的配置文件结构为:

配置信息

对这个结构进行扩展:

生成分页器配置 –>

配置信息

组装下一页地址 –>

配置信息

抓取列表数据 –>

配置信息

我们就可以通过三个config项来处理

l

第一步,通过 id=”pagination” 的配置生成分页器

l

第二步,通过已经生成的分页器加上 id=”urlnav” 的配置构造下一页的URL

l

第三步,通过 id=”listData” 的配置提取需要的数据

一、Web-Harvest的优缺点

优点:

l

Web-Harvest是一个使用比较方便的抓取信息的API库,目前是1.0版本

l

扩展性好,只要修改配置文件即可

l

上手较快,使用方便。

l

缺点:

l

处理过程比较多,对应的速度较慢

二、其他使用过或者正在尝试的精确抓取数据的方式

a)

使用HTMLParser

HTMLParser可以分析HTML 源码中的TAG(比如Table,DIV等),还可以自己定义TAG(比如:ENET),通过查找特定的Tag,提取相应的数据。由于没有很多的中间处理过程,速度较快,缺点是有很多的硬编码,难以扩展。或许能找出一个特定的表达式可以快速的提取数据。

b)

使用HTMLClean

该方式还是走HTML->XML的路线,首先通过HtmlClean把抓取的网页内容转化为XML格式数据,然后通过XPATH、XSL等方式对XML数据进行转化,达到收集数据的目的。Web-Harvest是类似的方式,但是我们可以精简化,提高抓取的效率。

三、使用爬虫碰到的问题

a)

网站对频繁抓取数据的爬虫进行IP限制问题

考虑使用IP代理,但是速度难以忍受,故现在在考虑分布式的抓取数据的方式

四、相关参考

http://web-harvest.sourceforge.net