1. 概率分布的基本概念

1.1 随机事件

随机事件(random event)。在同一组条件下,每次试验可能出现也可能出现的事件,也叫偶然事件

必然事件(certain event)。在同一组条件下,每次试验一定出现的事件

不可能事件(impossible event)。在同一组条件下,每次试验一定不出现的事件

基本事件:不能分解为更多个事件

简单事件的集合称为样本空间

1.2. 古典概率

设一个试验有N个等可能性的结果,而事件A包含了M个结果,那么事件E的概率,记为P(A)定义为:P(A)=M/N;

因为每个等可能基本事件概率为1/N,因此M个自然就是M/N

1.3. 条件概率

条件概率是指事件A在另外一个事件B已经发生条件下的发生概率。条件概率表示为:P(A|B),读作“在B的条件下A的概率:P(A|B)=P(A∩B)/P(B),条件概率有时候也称为后验概率

统计独立性:当且仅当两个随机事件 A 与 B 满足 P(A∩B)=P(A)P(B),它们是统计独立的,这样联合概率可以表示为各自概率的简单乘积。同样的,对于两个独立事件 A 与 B 有 P(A|B)=P(A),P(B|A)=P(B)。

互斥性:当且仅当 A 与 B 满足 P(A∩B)=0,且 P(A)≠0,P(B)≠0 的时候,A 与 B 是互斥的。因此 P(A|B)=0,P(B|A)=0

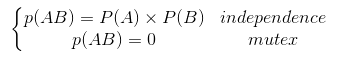

互斥事件一定不独立(因为一件事的发生导致了另一件事不能发生);独立事件一定不互斥,(如果独立事件互斥, 那么根据互斥事件一定不独立,那么就矛盾了),但是在概率形式上具有一些巧合性,一般地:

但是,对于两个独立事件,依然可以等于0,因为事件A或者事件B发生的概率可能为0.所以,并不是一定表示互斥。互斥和独立的理解还是要究其真正意义,而不是表达形式。

1.4. 随机变量

随机变量和随机事件密切相关。随机变量可以进一步分为离散变量和连续变量

离散随机变量:随机变量X的取值是有限的或者是可数无穷尽的值,例如:企业个数,职工人数,设备台数等,只能按计量单位数计数,这种变量的数值一般用计数方法取得

连续随机变量:X由全部实数或者由一部分区间组成,连续随机变量的取值是不可数及无穷尽的。例如灯泡的寿命,从0到正无穷(理论上)都有可能。人体测量的身高,体重,胸围等为连续变量,其数值只能用测量或计量的方法取得

1.5. 期望 方差和标准差

数学期望(mean)(或均值,亦简称期望)是试验中每次可能结果的概率乘以其结果的总和,是最基本的数学特征之一。它反映随机变量平均取值的大小。

方差和标准差:

2. 离散变量概率分布

离散型概率分布的概率函数被称为概率质量函数,离散型概率分布的种类有很多,比较常见的有二项分布、多项分布、超几何分布和泊松分布等

2.1. 伯努利分布

0-1分布又名两点分布,或叫伯努利分布

进行一次伯努利试验, 成功(X=1)概率为p(0<=p<=1), 失败(X=0)的概率1-p, 则称随机变量X服从伯努利分布,其概率质量函数为:

2.2. 二项分布(n重伯努利分布)

2.3. 泊松分布

泊松概率分布是考虑在连续时间和空间单位上发生的随机事件的概率。

通俗解释:基于过去的经验,预测该随机事件在新的同样长的时间或同样大的空间中发生N次的概率。

3. 连续变量概率分布

3.1. 均匀分布

均匀概率分布是古典概率分布的连续形式,是指随机事件的可能结果是连续型数据变量,所有的连续型数据结果所对应的概率相等

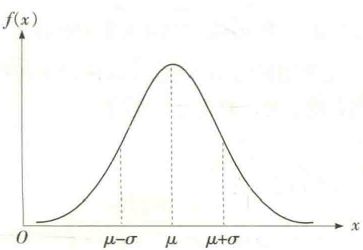

3.1. 正态分布

3.1. 指数分布

指数分布描述的是两次随机事件发生的时间间隔的概率分布情况,这里的时间间隔指的是一次随机事件发生到下一次随机事件再发生的时间间隔。例如,某医院过去平均每10分钟出生一个婴儿,求接下来5分钟内有婴儿出生的概率

与泊松分布的区别:

指数分布与泊松分布正好互补,泊松分布能够根据过去单位时间内随机事件的平均发生次数,推断未来相同的单位时间内随机事件发生不同次数的概率。而指数分布的作用是根据随机事件发生一次的平均等待时间来推断某个时间段内,随机事件发生的概率