当这位70岁的Hinton老人还在努力推翻自己积累了30年的学术成果时,我才知道什么叫做生命力(附Capsule最全解析)

Hinton以“深度学习之父”和“神经网络先驱”响彻AI领域。

这几日,Hinton被刊进各大媒体的头版头条,是因为他的那篇Capsule论文,终于揭下了神秘的面纱。

在论文中,Capsule被Hinton大神定义为这样一组神经元:其活动向量所表示的是特定实体类型的实例化参数。他的实验表明,鉴别式训练的多层Capsule系统,在MNIST手写数据集上表现出目前最先进的性能,并且在识别高度重叠数字的效果要远好于CNN。

一个月前,在多伦多接受媒体采访时,Hinton大神断然宣称要放弃反向传播,让整个人工智能从头再造。不明就里的媒体们顿时蒙圈不少。

8月份的时候,Hinton大神还用一场“卷积神经网络都有哪些问题?”的演讲来介绍他手中的Capsule研究,他认为“CNN的特征提取层与次抽样层交叉存取,将相同类型的相邻特征检测器的输出汇集到一起”是大有问题的。当时的演讲中,Hinton大神可没少提CNN之父Yann LeCun的不同观点。

毕竟,当前的CNN一味追求识别率,对于图像内容的“理解”帮助有限。而要进一步推进人工智能,让它能像人脑一样理解图像内容、构建抽象逻辑,仅仅是认出像素的排序肯定是不够的,必须要找到方法来对其中的内容进行良好的表示……这就意味着新的方法和技术。

而当前的深度学习理论,自从Hinton大神在2007年(先以受限玻尔兹曼机进行训练、再用有监督的反向传播算法进行调优)确立起来后,除了神经网络结构上的小修小改,很多进展都集中在梯度流上,正如知乎大V“SIY.Z”在《浅析Hinton最近提出的Capsule计划》(https://zhuanlan.zhihu.com/p/29435406)时所举的例子(为了方便大家阅读这篇文章,营长将具体内容附在文章末尾):

sigmoid会饱和,造成梯度消失。于是有了ReLU。

ReLU负半轴是死区,造成梯度变0。于是有了LeakyReLU,PReLU。

强调梯度和权值分布的稳定性,由此有了ELU,以及较新的SELU。

太深了,梯度传不下去,于是有了highway。

干脆连highway的参数都不要,直接变残差,于是有了ResNet。

强行稳定参数的均值和方差,于是有了BatchNorm。

在梯度流中增加噪声,于是有了 Dropout。

RNN梯度不稳定,于是加几个通路和门控,于是有了LSTM。

LSTM简化一下,有了GRU。

GAN的JS散度有问题,会导致梯度消失或无效,于是有了WGAN。

WGAN对梯度的clip有问题,于是有了WGAN-GP。

而本质上的变革,特别是针对当前CNN所无力解决的动态视觉内容、三维视觉等难题……进行更为基础的研究,或许真有可能另辟蹊径。

这当然是苦力活,Hinton大神亲自操刀的话,成功了会毁掉自己赖以成名的反向传播算法和深度学习理论,失败了则将重蹈爱因斯坦晚年“宇宙常数”的覆辙。所以,李飞飞对他在这里的勇气大为赞赏:

!drfeifei

如今Capsule的论文刚刚出来,深度学习的各路大神并没有贸然对其下评论,深夜中的外媒亦尚未就此发稿,甚至就连技术圈内一向口水不断的Hacker News,今天也是静悄悄地一片。

不过,可以肯定的一点是,一个月后的NIPS大会,Capsule更进一步的效果必定会有所显现,AI科技大本营也一定会继续跟进这里的进展。

至于Hinton此举对于深度学习和整个人工智能界的后续影响,包括Yann LeCun在内的各路大神恐怕都不敢冒下结论,以营长的水平,在这里连翻译和解析论文都显得多余(论文在这里https://arxiv.org/abs/1710.09829,感兴趣的话可自取)。咱们还是静等时间来验证Hinton大神的苦心孤诣到底值不值得吧。

这正如Hinton大神在接受吴恩达采访时所说的:

如果你的直觉很准,那你就应该坚持,最终必能有所成就;反过来你直觉不好,那坚不坚持也就无所谓了。反正你从直觉里也找不到坚持它们的理由。

当然,营长肯定是相信Hinton大神的直觉的,更是期待人工智能能在当前的水平上更进一步。

尽管意义不同,Hinton大神此举却让营长想到了同在古稀之年的开尔文勋爵,他1900年那场关于物理学“两朵乌云”的演讲可是“预言”得贼准:“紫外灾难”让年近不惑的普朗克为量子力学开创了先河,“以太漂移”让刚刚毕业的爱因斯坦开始思考狭义相对论,经典物理学的大厦就此崩塌。

那么,人工智能上空所飘荡的到底是一朵“乌云”呢?还是一个新的时代?让我们拭目以待。

我们来看看Hinton的学术历程,这篇是来自知乎的文章:《浅析 Hinton 最近提出的 Capsule 计划》虽然发表已有一个多月,但值得一读

作者:SIY.Z

原文:https://zhuanlan.zhihu.com/p/29435406

这有可能也是知乎上面分析介绍深度学习最为全面的文章之一。希望做物理的,做数学的,做生物的,做化学的,做计算机,包括做科幻的都能看的很开心。

Hinton 以“深度学习之父” 和 “神经网络先驱” 闻名于世,其对深度学习及神经网络的诸多核心算法和结构(包括“深度学习”这个名称本身,反向传播算法,受限玻尔兹曼机,深度置信网络,对比散度算法,ReLU激活单元,Dropout防止过拟合,以及深度学习早期在语音方面突破)做出了基础性的贡献。尽管已经将大半辈子的时间投入到神经网络之上,这位老人却丝毫没有想退休的意思。

Hinton 近几年以 “卷积神经网络有什么问题?” 为主题做了多场报道 [1] [2],提出了他的 Capsule 计划。Hinton似乎毫不掩饰要推翻自己盼了30多年时间才建立起来的深度学习帝国的想法 [3]。他的这种精神也获得了同行李飞飞(ImageNet创始者)等人肯定 [4]。

Hinton** 为什么突然想要推倒重来**?这肯定不是出于巧合或者突然心血来潮,毕竟作为一个领域的先驱,质疑自己亲手建立的理论,不是谁都愿意做的事情。(试想一下,如果你到处做报告,说自己的领域有各种各样的问题,就算不会影响到自己,也让做这个领域的同行和靠这个领域吃饭的人不是很舒服)

说推倒重来有点过分,Hinton并没有否定一切,并且他的主要攻击目标是深度学习在计算机视觉方面的理论。但是从几次演讲来看,他的 Capsule 计划确实和以前的方法出入比较大。Hinton 演讲比较风趣,但是也存在思维跳跃,难度跨度太大等问题。这些问题在他的关于 Capsule 的报告中还是比较突出的。可以说仅仅看报告很难理解完全 Hinton 的想法。我这几天结合各类资料,整理了一下 Hinton 的思路和动机,和大家分享一下。

Hinton 与神经网络

(以下用NN指代人工神经网络,CNN指代(深度)卷积神经网络,DNN指代深度神经网络)

要深入理解Hinton的想法,就必须了解神经网络发展的历史,这也几乎是Hinton的学术史。

人工智能才起步的时候,科学家们很自然的会有模拟人脑的想法(被称为连接主义),因为人脑是我们唯一知道的拥有高级智能的实体。

NN 起源于对神经系统的模拟,最早的形式是感知机,学习方法是神经学习理论中著名的 Hebb's rule 。NN最初提出就成为了人工智能火热的研究方向。不过 Hebb's rule 只能训练单层NN,而单层NN甚至连简单的“异或”逻辑都不能学会,而多层神经网络的训练仍然看不到希望,这导致了NN的第一个冬天。

Hinton 意识到,人工神经网络不必非要按照生物的路子走。在上世纪80年代, Hinton 和 LeCun 奠定和推广了可以用来训练多层神经网络的反向传播算法(back-propagation)。NN再次迎来了春天。

反向传播算法,说白了就是一套快速求目标函数梯度的算法。

对于最基本的梯度下降(Gradient Descent):

反向传播就是一种高效计算的方式

不过在那时,NN就埋下了祸根。

首先是,反向传播算法在生物学上很难成立,很难相信神经系统能够自动形成与正向传播对应的反向传播结构(这需要精准地求导数,对矩阵转置,利用链式法则,并且解剖学上从来也没有发现这样的系统存在的证据)。反向传播算法更像是仅仅为了训练多层NN而发展的算法。失去了生物学支持的NN无疑少了很多底气,一旦遇到问题,人们完全有更多理由抛弃它(历史上上也是如此)

其次是,反向传播算法需要SGD等方式进行优化,这是个高度非凸的问题,其数学性质是堪忧的,而且依赖精细调参。相比之下,(当时的)后起之秀SVM等等使用了凸优化技术,这些都是让人们远离NN的拉力。当那时候的人们认为DNN的训练没有希望(当时反向传播只能训练浅层网络)的时候,NN再次走向低谷。

深度学习时代的敲门砖——RBM

第二次NN低谷期间,Hinton没有放弃,转而点了另外一个科技树:热力学统计模型。

Hinton由玻尔兹曼统计相关的知识,结合马尔科夫随机场等图学习理论,为神经网络找到了一个新的模型:玻尔兹曼机(BM)。Hinton用能量函数来描述NN的一些特性,期望这样可以带来更多的统计学支持。

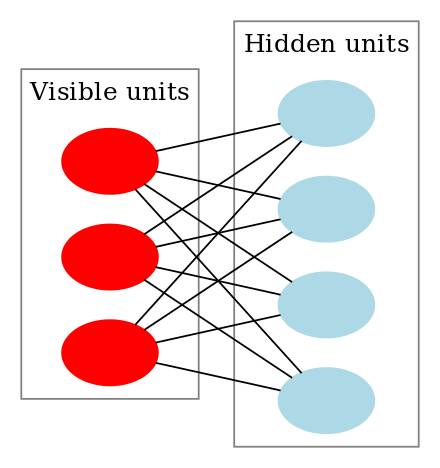

不久Hinton发现,多层神经网络可以被描述为玻尔兹曼机的一种特例——受限玻尔兹曼机(RBM)。Hinton 在 Andrew Ng 近期对他的采访中 (https://www.youtube.com/watch?v=-eyhCTvrEtE),称其为 "most beautiful work I did"。

当年我第一次看到 RBM 的相关数学理论的时候,真的非常激动,觉得这样的理论不work有点说不过去。这里我给出相关的数学公式,以展示NN可以有完全不同于生物的诠释方式。

在统计力学中,玻尔兹曼分布(或称吉布斯分布)可以用来描述量子体系的量子态的分布,有着以下的形式:

其中是某个量子态,为这个状态的能量, 为这个状态出现的概率。

是玻尔兹曼常数。是系统温度,在具体问题中也是一个常数。于是我们不妨让原来的表达式可以简化为

也就是

这不就是 softmax 吗?居然自然地在统计力学分布里面出现了(难怪之前 LeCun 让大家学物理)。

为了再次简化,我们定义

于是就有

(因为这时候公式里面只有一个s,就没有必要写下标了)

下面问题来了,** E **是什么? s又应该是什么?

Hinton 看了看神经网络的一层,其分为可见层(输入层)和隐含层(中间层)。按照经典网络的定义,神经元有激活和未激活两个状态。那么干脆让 s 等于可见层 v 并上隐含层 h神经元的状态吧(默认都用向量的方式表示):于是

那么E又是什么呢?

非常巧合的是,量子物理学里面有个模型极其像神经网络,以至于只要了解过几乎都会惊叹两者的相似度。这个模型就是著名 易辛模型(Ising model)。易辛模型(物理学界常见调侃:你3维 Ising 模型会解了吗?)描述了晶格系统中的相变,解释了铁磁性问题(你可能好奇过,为啥这么多金属,就铁等少数金属特别敏感,而且还能被磁化。这个模型给出了解释)。

Hinton 把神经元的偏置(对于可见层记作a, 对于隐含层记作b ) 作为 Ising model 的 “外场”,NN的权重W作为 Ising Model 的“内部耦合系数”(两个神经元之间的权重越大,代表它们的耦合越强,关联越强),于是能量就可以写作非常简单的形式: