在TF03程序的基础上修改。

1 命名空间

https://www.cnblogs.com/salan668/p/6994928.html

在Tensorflow中, 为了区别不同的变量(例如TensorBoard显示中), 会需要命名空间对不同的变量进行命名. 其中常用的两个函数为: tf.variable_scope, tf.name_scope.

#定义命名空间

with tf.name_scope('input'):

#定义两个placeholder

x = tf.placeholder(tf.float32,[None,784],name='x-input')

y = tf.placeholder(tf.float32,[None,10],name='y-input')

2 把graph结构写入文件

writer = tf.summary.FileWriter('logs/',sess.graph)

with tf.Session() as sess:

sess.run(init)

writer = tf.summary.FileWriter('logs/',sess.graph)

for epoch in range(1):

for batch in range(n_batch):

batch_xs,batch_ys = mnist.train.next_batch(batch_size)

sess.run(train_step,feed_dict={x:batch_xs,y:batch_ys})

acc = sess.run(accracy,feed_dict={x:mnist.test.images,y:mnist.test.labels})

print("iter "+str(epoch)+",Testing Accuracy "+str(acc))

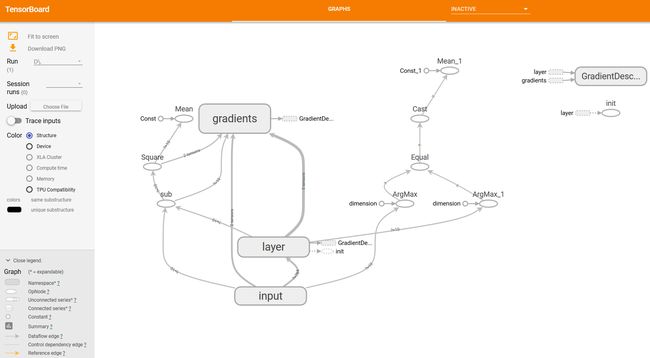

3 打开tensorboard

在命令行输入:

D:\>tensorboard --logdir=D:\Documents\logs

TensorBoard 0.1.8 at http://ww-1:6006 (Press CTRL+C to quit)

复制http://ww-1:6006,在浏览器打开

3.1 tensorboard基本操作

按住左键拖动;滚轮放大缩小;

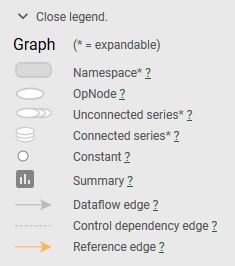

页面左下角是图例说明:

右键可以把节点移出或加入

4 改进代码

with tf.name_scope('layer'):

#创建一个简单神经网络

with tf.name_scope('weights'):

w = tf.Variable(tf.zeros([784,10]),name='W')

with tf.name_scope('biases'):

b = tf.Variable(tf.zeros([10]),name='b')

with tf.name_scope('wx_plus_b'):

wx_plus_b = tf.matmul(x,w)+b

with tf.name_scope('softmax'):

prediction = tf.nn.softmax(wx_plus_b)

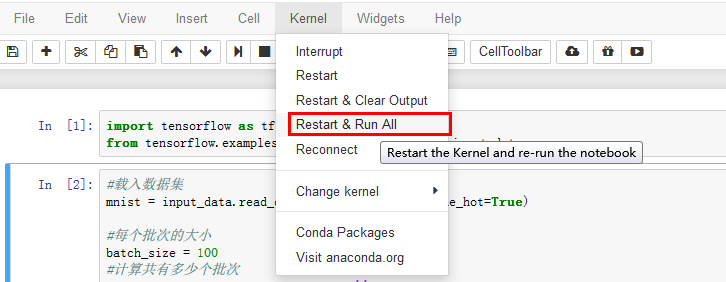

运行程序kernel->Restart&run all重新生成graph文件

注:如果直接运行程序,则第一次生成的图也会存在,这样页面中会有两幅图,上述操作的目的是清空第一幅图。

刷新页面

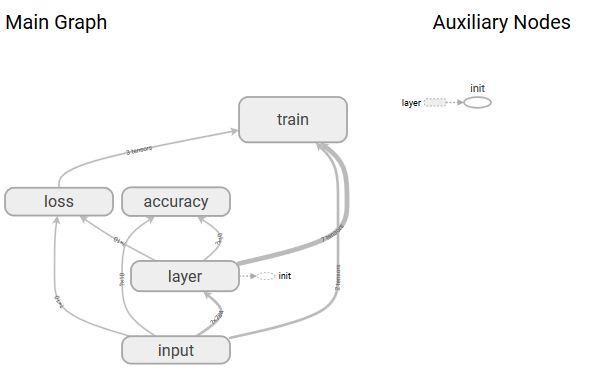

继续完善程序

with tf.name_scope('loss'):

#代价函数

loss = tf.reduce_mean(tf.square(y-prediction))

with tf.name_scope('train'):

#定义一个梯度下降法来进行训练的优化器 学习率为0.2

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

#变量初始化

init = tf.global_variables_initializer()

with tf.name_scope('accuracy'):

with tf.name_scope('correct_prediction'):

#结果存放在一个布尔型列表中;#argmax返回一维张量中最大的值所在的位置

correct_prediction = tf.equal(tf.argmax(y,1),tf.argmax(prediction,1))

with tf.name_scope('accracy'):

#求准确率

accracy = tf.reduce_mean(tf.cast(correct_prediction,tf.float32))

重复上面的操作,刷新浏览器页面

这样的话,显示的图形就比较整齐了,大概可以看出网络的走向。