原创:机器学习代码练习(一、回归)

吴恩达老师在coursea上的机器学习课程的作业是OCTAVE(matlab)做的,当时python还不怎么流行,现在吴恩达老师也用python了,我把原课程作业用python重新写了一遍,并放在我的github上。(黄海广)

本文是第一部分,回归作业的重构。

机器学习练习 1 - 回归

单变量线性回归

代码修改并注释:黄海广,[email protected]

import numpy as np

import pandas as pd

import matplotlib.pyplot as pltpath = 'data/ex1data1.txt'#这里读取原始作业的数据

data = pd.read_csv(path, header=None, names=['Population', 'Profit'])

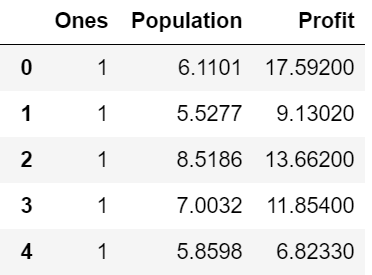

data.head()数据长这样:

看下数据长什么样子:

data.plot(kind='scatter', x='Population', y='Profit', figsize=(8,6))

plt.show()现在让我们使用梯度下降来实现线性回归,以最小化成本函数。

首先,我们将创建一个代价函数:

其中:

def computeCost(X, y, theta):

inner = np.power(((X * theta.T) - y), 2)# (m,n) @ (n, 1) -> (n, 1)

# return np.sum(inner) / (2 * len(X))

return np.sum(inner) / (2 * X.shape[0])让我们在训练集中添加一列,以便我们可以使用向量化的解决方案来计算代价和梯度。

data.insert(0, 'Ones', 1)

data.head()# set X (training data) and y (target variable)

cols = data.shape[1]

X = data.iloc[:,:cols-1]#X是所有行,去掉最后一列

y = data.iloc[:,cols-1:]#X是所有行,最后一列代价函数是应该是numpy矩阵,所以我们需要转换X和Y,然后才能使用它们。我们还需要初始化theta。

X = np.matrix(X.values)

y = np.matrix(y.values)

theta = np.matrix(np.array([0,0]))看下维度:

X.shape, theta.shape, y.shape输出:

((97, 2), (1, 2), (97, 1))计算代价函数 (theta初始值为0).

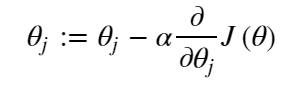

computeCost(X, y, theta)32.072733877455676batch gradient decent(批量梯度下降)

def gradientDescent(X, y, theta, alpha, iters):

temp = np.matrix(np.zeros(theta.shape))

parameters = int(theta.ravel().shape[1])

cost = np.zeros(iters)

for i in range(iters):

error = (X * theta.T) - y

for j in range(parameters):

term = np.multiply(error, X[:,j])

temp[0,j] = theta[0,j] - ((alpha / len(X)) * np.sum(term))

theta = temp

cost[i] = computeCost(X, y, theta)

return theta, cost初始化一些附加变量 - 学习速率alpha和要执行的迭代次数。

alpha = 0.01

iters = 1000现在让我们运行梯度下降算法来将我们的参数theta合于训练集。

g, cost = gradientDescent(X, y, theta, alpha, iters)

gmatrix([[-3.24140214, 1.1272942 ]])最后,我们可以使用我们拟合的参数计算训练模型的代价函数(误差)。

computeCost(X, y, g)4.515955503078912现在我们来绘制线性模型以及数据,直观地看出它的拟合。

x = np.linspace(data.Population.min(), data.Population.max(), 100)

#np.linspace在指定的间隔内返回均匀间隔的数字。

f = g[0, 0] + (g[0, 1] * x)

fig, ax = plt.subplots(figsize=(10,6))

ax.plot(x, f, 'r', label='Prediction')

ax.scatter(data.Population, data.Profit, label='Traning Data')

ax.legend(loc=2)

ax.set_xlabel('Population')

ax.set_ylabel('Profit')

ax.set_title('Predicted Profit vs. Population Size')

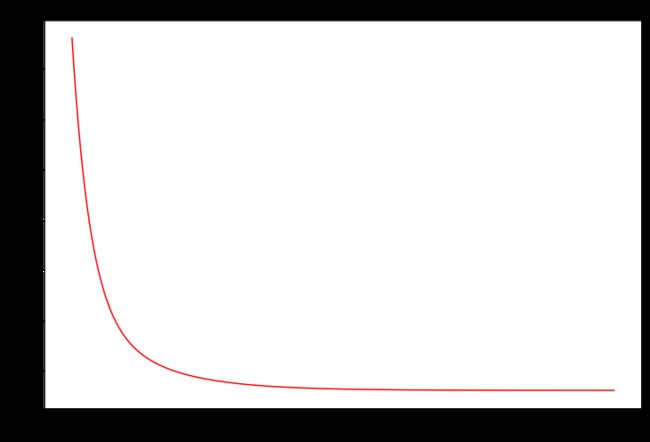

plt.show()由于梯度方程式函数也在每个训练迭代中输出一个代价的向量,所以我们也可以绘制。请注意,代价总是降低 - 这是凸优化问题的一个例子。

fig, ax = plt.subplots(figsize=(12,8))

ax.plot(np.arange(iters), cost, 'r')

ax.set_xlabel('Iterations')

ax.set_ylabel('Cost')

ax.set_title('Error vs. Training Epoch')

plt.show()多变量线性回归

练习1还包括一个房屋价格数据集,其中有2个变量(房子的大小,卧室的数量)和目标(房子的价格)。我们使用我们已经应用的技术来分析数据集。

path = 'data/ex1data2.txt'

data2 = pd.read_csv(path, header=None, names=['Size', 'Bedrooms', 'Price'])

data2.head()对于此任务,我们添加了另一个预处理步骤 - 特征归一化。这个对于pandas来说很简单

data2 = (data2 - data2.mean()) / data2.std()

data2.head()现在我们重复第1部分的预处理步骤,并对新数据集运行线性回归程序。

# 添加一列

data2.insert(0, 'Ones', 1)

# 设置X和y

cols = data2.shape[1]

X2 = data2.iloc[:,0:cols-1]

y2 = data2.iloc[:,cols-1:cols]

# 转为矩阵并且初始化theta

X2 = np.matrix(X2.values)

y2 = np.matrix(y2.values)

theta2 = np.matrix(np.array([0,0,0]))

g2, cost2 = gradientDescent(X2, y2, theta2, alpha, iters)

# 得到模型误差

computeCost(X2, y2, g2)0.13070336960771892我们也可以快速查看这一个的训练进程。

fig, ax = plt.subplots(figsize=(12,8))

ax.plot(np.arange(iters), cost2, 'r')

ax.set_xlabel('Iterations')

ax.set_ylabel('Cost')

ax.set_title('Error vs. Training Epoch')

plt.show()normal equation(正规方程)

正规方程是通过求解下面的方程来找出使得代价函数最小的参数的: 。 假设我们的训练集特征矩阵为 X(包含了 )并且我们的训练集结果为向量 y,则利用正规方程解出向量 。 上标 T 代表矩阵转置,上标-1 代表矩阵的逆。设矩阵 ,则:

梯度下降与正规方程的比较:

梯度下降:需要选择学习率 α,需要多次迭代,当特征数量 n 大时也能较好适用,适用于各种类型的模型

正规方程:不需要选择学习率 α,一次计算得出,需要计算 ,如果特征数量 n 较大则运算代价大,因为矩阵逆的计算时间复杂度为 ,通常来说当 小于 10000 时还是可以接受的,只适用于线性模型,不适合逻辑回归模型等其他模型。

# 正规方程

def normalEqn(X, y):

theta = np.linalg.inv(X.T@X)@X.T@y#X.T@X等价于X.T.dot(X)

return thetafinal_theta2=normalEqn(X, y)#感觉和批量梯度下降的theta的值有点差距

final_theta2输出:

matrix([[-3.89578088],

[ 1.19303364]])备注:

代码和数据都在:

https://github.com/fengdu78/Coursera-ML-AndrewNg-Notes/tree/master/code/ex1-linear%20regression

参考:

https://www.coursera.org/course/ml

![]()

人工智能常识和干货,适合收藏

《统计学习方法》(李航)读书笔记(完结)

良心推荐:机器学习入门资料汇总及学习建议

网红少年编程书,AI自学不再难

【B站免费教程】2W 收藏!火爆 B 站的计算机科学速成教程发布,全中文版

良心推荐:机器学习入门资料汇总及学习建议(2018版)

机器学习必备宝典-《统计学习方法》的python代码实现、电子书及课件

软件下载和Python,AI,资料

【送书PDF】Python编程从入门到实践

Python从入门到精通,深度学习与机器学习资料大礼包!

【免费】某机构最新3980元机器学习/大数据课程高速下载,限量200份

长按扫码撩海归

![]()

觉得不错, 请随意转发,麻烦点个在看!