CVPR 2020丨基于并行点检测和点匹配的单阶段实时HOI Detection方法

![]()

本文转载自知乎,为商汤科技CVPR 2020最新论文解读。

https://zhuanlan.zhihu.com/p/144238209

在CVPR2020上,商汤团队联合北京航空航天大学Colab(可乐实验室)提出了基于并行点检测和点匹配的单阶段HOI Detection(人-物交互检测)方法,为学术界首次在HOI Detection领域达到实时性能的深度学习算法,并且在公开数据集HICO-DET上性能取得了大幅度提升。同时本文还构建了一个以实际应用场景为导向的HOI Detection数据库HOI-A。

动机与背景

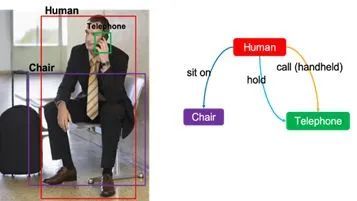

问题定义: HOI Detection (人和物体的动作交互检测) 是一个针对静态图片对人体动作的精细化理解,任务要求检测出图片中产生动作的人以及和他产生动作交互的物体,同时还要将二者的动作关系预测出来并关联起来。

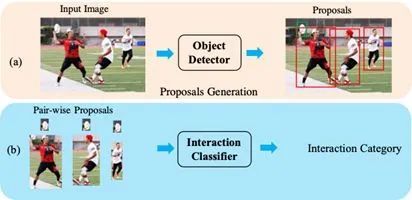

传统两阶段HOI Detection方法:

第一阶段,通过一个预训练好的目标检测网络检测出图片中的人和物体,然后把人和物体框一一配对得到一系列的<人,物体>候选对 (HO Proposals)。

第二阶段,把每一个HO Proposal逐一送入到一个动作关系分类网络,得到对应的预测出对应动作关系类别。

两阶段方法的局限性:从性能上,两阶段模型的结构是序列化和分离化的,第二阶段分类的性能会依赖于第一阶段检测的性能。而第一阶段在生成Proposals时仅考虑检测置信度较高的人/物体,而忽视一个人/物体产生交互关系的可能性,从而会导致有交互关系的人/物体会被漏掉,或者在第二阶段受到“轻视“。

此外,一一组队产生proposals的方式会生成大量负样本,增大搜索空间,增加正样本被检出并赋予高置信度的难度。从效率上,第一阶段产生的所有样本,包括大量的负样本,都要逐个串行的输入到第二阶段的关系预测网络,线性的增加了时间复杂度。此外,为了取得较好的性能,第一阶段往往会采用性能更好的检测模型,也会增加时间开销。

主要贡献

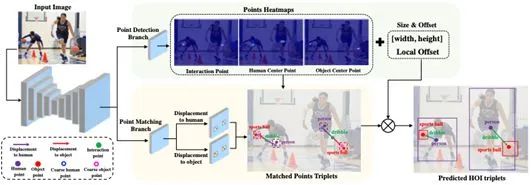

基于两阶段方法的局限性,我们重新定义了HOI Detection为一个并行点检测和并行点匹配的问题,并提出全新的单阶段HOI Detection框架(PPDM)。

我们提出的PPDM框架不仅在公开数据集HICO-DET以及我们构建的HOI-A数据集上取得了最优的性能,还成为第一个在HOI Detection领域达到实时性能的深度学习框架。

我们构建了一个以实际应用为导向的HOI Detection数据库。

方法介绍

问题重定义:

人/物体检测框:检测框的中心点+检测框长宽以及中心点的偏差;

交互关系点:人和物体检测框中心点连线的中点。为一个连接人和物体的锚点,也在此点来预测对应人和物体之间的关系。

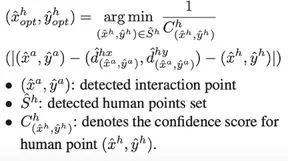

匹配规则:首先定义了两个偏差,分别从交互关系点到人和物体框的中心点。结合交互关系点和对应的偏差找到最符合匹配规则的人和物体中心点。匹配到同一个关系点的人和物体即可组成一个HOI三元组。

网络结构:基于以上定义我们提出一个由并行双支路组成的单阶段框架。首先通过一个特征提取网络,得到图片的特征,然后经由两条支路得到HOI三元组。第一条支路为“点检测“支路,输入图片的特征,输出人/物体/交互关系点的热力图以及对应人/物体检测框的长宽。第二条支路为“点匹配” 支路,输入图片特征,输出交互关系点到人/物体检测框中点的偏差。

点匹配详解:我们首先挑选出置信度最高个k个交互关系点以及对应的偏差,基于此,我们可以生成一系列“coarse human/object point”。然后,我们基于“离‘coarse point’最近且具有较高置信度”的匹配规则,找到每个交互关系点所匹配的人和物体中心点。最后结合人和物体中心点对应位置预测出来的长宽便可得到最后的HOI三元组。

HOI-A数据集

以实际落地应用场景为导向,我们选取了非常有限但极具实用价值的10种动作关系,通过摄像头采集以及网络爬取的方式,采集了将近4万张以人为中心的场景图片,并对所有图片进行了精细的HOI Detection标注。为了增大类间差异,图片包含丰富的场景(室内,室外,车内灯),不同的光照强度,不同的人物着装,和同一类物体的不同形态,并采用两种摄像头来采集,RGB和IR。

实验结果

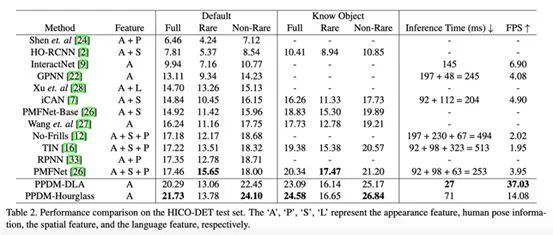

我们选取了两种不同的主干网络DLA-34和Hourglass-104在两个数据库HICO-DET和HOI-A上对我们的方法PPDM进行一系列实验。

从定量结果上可以得到,在HICO-DET数据库上,我们在不采用额外信息,如人体姿态,语言特征等的情况下,取得了最优的性能,并且速度远远快于之前的方法,其中基于DLA-34的框架,为在HICO-DET上第一个达到实时性能的算法。

在下图中我们对比了经典的两阶段方法iCAN,其中我们对每张图片top-3得分HOI三元组进行了可视化,其中第一行为iCAN的结果,第二行为PPDM的结果。从定性结果可以分析得到,我们的算法可以检测出真正具有关系的人和物体对并给出较高的置信度得分,而iCAN往往会偏向于给易于检测但实际没有实际关系的人和物体对较高的得分,从而产生误检。

总结与展望

在本文中,我们提出一套单阶段实时的HOI Detection解决方案,并构建了一个以实际应用为导向的HOI Detection数据库。希望我们提出的方法和数据库可以缩小HOI Detection学术界和产业界的鸿沟。在方法层面,如何在我们的框架下高效合理的利用更加细粒度的人体姿态信息来提高动作识别的准确性是一个改进方向。在数据库层面,在未来我们会不断的扩大和丰富我们的HOI-A数据库,来推动领域发展。

论文链接:

https://arxiv.org/abs/1912.12898

代码链接:

https://github.com/YueLiao/PPDM

END

![]()

备注:检测

检测交流群

2D、3D目标检测、人物交互检测等最新资讯,若已为CV君其他账号好友请直接私信。

我爱计算机视觉

微信号:aicvml

QQ群:805388940

微博知乎:@我爱计算机视觉

网站:www.52cv.net

![]()

在看,让更多人看到 ![]()