IJCAI2018 | SFP软剪枝通道裁剪算法

论文:Soft Filter Pruning for Accelerating Deep Convolutional Neural Networks

论文:Asymptotic Soft Filter Pruning for Deep Convolutional Neural Networks

论文链接:https://arxiv.org/pdf/1808.06866.pdf

论文链接:https://arxiv.org/pdf/1808.07471.pdf

代码链接:https://github.com/he-y/soft-filter-pruning

1.硬剪枝 and 软剪枝

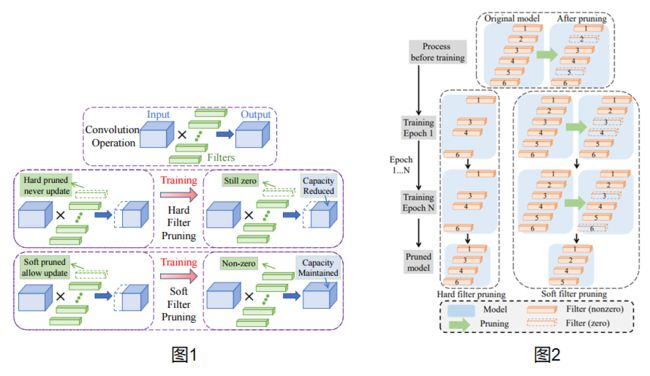

Hard Filter Pruning(HFP):硬滤波器裁减方法,Soft Filter Pruning (SFP):软滤波器裁减方法。如下图所示,所谓硬剪枝滤波器方法即每次进行滤波器裁减操作时会直接将需要裁减的滤波器移除网络之外。而软滤波器剪枝方法在每次进行滤波器裁减操作时仅仅将需要被裁减的滤波器参数置零,且该滤波器并不会被移除网络之外,还会以完整的网络形态继续下一个epoch的训练,这种方式使得利用软剪枝法的网络的学习能力更加强大。如下图二所示,在裁剪比例相同的情况下,软剪枝方法裁剪的适应性更强,也更加灵活,使得网络尽可能的不降低性能。

更加具体来说,本文提出的SFP和HFP的不同点在于裁减掉的滤波器依然参与下一次迭代更新,SFP在每个epoch结束后会进行剪枝操作,剪枝完成后就会再训一个epoch,然后继续剪枝。之所以要采用SFP,很重要的一个原因是为了提高模型的效果,因为HFP那种方式相当于直接丢掉剪掉的滤波器,而SFP相对而言没那么极端,每次裁减的方式仅仅是将这些滤波器参数置零,这些滤波器仍然会参与下一个epoch的学习,知道最终训练完成才真正将这些滤波器剪除,这也是这两种剪枝方式名称中soft和hard的含义。概念上的代码示意如下所示。

for epoch in range(args.start_epoch, args.epochs):

m.model = model

m.if_zero()

m.init_mask(args.rate)

m.do_mask()

m.if_zero()

model = m.model

2. SFP and ASFP

为了使得软剪枝的训练过程变得更加稳定,作者提出了一种渐近软滤波器剪枝(ASFP)方法来加速深度神经网络的推理过程。该方法在软剪枝的基础上,渐近地修剪网络。在训练过程中,先删除几个少量滤波器,然后随着迭代的进行渐近地删除更多的滤波器。在渐近剪枝的情况下,训练集的信息会逐渐集中在剩余的滤波器中,从而使后续的训练和剪枝过程保持稳定。HFP,SFP和ASFP的整体概念如下图所示。

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-2EcieSAD-1589968954125)(https://upload-images.jianshu.io/upload_images/5529997-653364843e065825.png?imageMogr2/auto-orient/strip%7CimageView2/2/w/1240)]

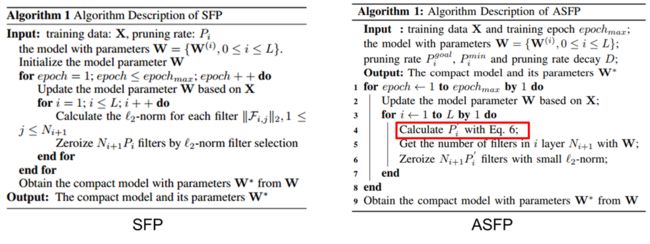

如下图所示为SFP算法的训练过程,每次训完一个epoch就要开始执行剪枝操作。在每次剪枝操作时,遍历网络的每一层,计算每一层的每个滤波器的L2-norm(L2范数),剪枝概率Pi和第i层的滤波器数量Ni+1相乘表示一个网络层中被剪枝的滤波器个数,将滤波器的L2范数最低的Ni+1*Pi个滤波器剪枝,剪枝是通过将该滤波器的值置为0来实现,从而完成第i层滤波器的剪枝操作。这样随着epoch的迭代,最终得到的模型会包含一些值为0的滤波器,这些滤波器就可以直接去掉从而得到最终的模型。而ASFP与SFP的区别在于每次迭代时,滤波器的裁剪率会随着迭代次数的增加,而由低到高的变化,直到增加到和SFP预设的裁剪率一致为止。

3.结果分析

如下图1展示的结果,显示了软剪枝方法相较于硬剪枝方法对网络的性能保留能力更强。而下图二展示的结果,显示了渐进式软剪枝方法的优越性。

[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-Y2viAyFn-1589968954212)(https://upload-images.jianshu.io/upload_images/5529997-c80567ec86fa32c2.png?imageMogr2/auto-orient/strip%7CimageView2/2/w/1240)]