ELK 企业搭建实战(1)

ELK+kafka+filebeat企业内部日志分析系统

elk:日志搜集平台

ELK由ElasticSearch、Logstash和Kiabana三个开源工具组成:

1、组件介绍

1、Elasticsearch:

ElasticSearch是一个基于Lucene的开源分布式搜索服务器。只搜索和分析日志

特点:分布式,零配置,自动发现,索引自动分片,索引副本机制等。它提供了一个分布式多用户能力的全文搜索引擎。Elasticsearch是用Java开发的,并作为Apache许可条款下的开放源码发布,设计用于云计算中,能够达到实时搜索,稳定,可靠,快速,安装使用方便。

在elasticsearch中,所有节点的数据是均等的。

2、Logstash:

Logstash是一个完全开源工具,可以对你的日志进行收集、过滤、分析,并将其存储供以后使用只收集和过滤日志,和改格式

简单来说logstash就是一根具备实时数据传输能力的管道,负责将数据信息从管道的输入端传输到管道的输出端;与此同时这根管道还可以让你根据自己的需求在中间加上滤网,Logstash提供里很多功能强大的滤网以满足你的各种应用场景。

② Logstash的事件(logstash将数据流中等每一条数据称之为一个event)处理流水线有三个主要角色完成:inputs –> filters –> outputs:

logstash整个工作流分为三个阶段:输入、过滤、输出。每个阶段都有强大的插件提供支持:

Input 必须,负责产生事件(Inputs generate events),常用的插件有

- file 从文件系统收集数据

- syslog 从syslog日志收集数据

- redis 从redis收集日志

- beats 从beats family收集日志(如:Filebeats)

Filter常用的插件有, 可选,负责数据处理与转换(filters modify )

- grok是logstash中最常用的日志解释和结构化插件。:grok是一种采用组合多个预定义的正则表达式,用来匹配分割文本并映射到关键字的工具。

- mutate 支持事件的变换,例如重命名、移除、替换、修改等

- drop 完全丢弃事件

- clone 克隆事件

output 输出,必须,负责数据输出(outputs ship elsewhere),常用的插件有

- elasticsearch 把数据输出到elasticsearch

- file 把数据输出到普通的文件

3、Kibana:

Kibana 是一个基于浏览器页面的Elasticsearch前端展示工具,也是一个开源和免费的工具,Kibana可以为 Logstash 和 ElasticSearch 提供的日志分析友好的 Web 界面,可以帮你汇总、分析和搜索重要数据日志。

2、环境介绍

| 安装软件 | 主机名 | IP地址 | 系统版本 |

|---|---|---|---|

| Elasticsearch/ | mes-1-zk | 192.168.246.234 | centos7.4–3G |

| zookeeper/kafka/Logstash | es-2-zk-log | 192.168.246.231 | centos7.4–2G |

| head/Kibana | es-3-head-kib-zk-File | 192.168.246.235 | centos7.4—2G |

所有机器关闭防火墙,selinux

3、版本说明

Elasticsearch: 6.5.4 #https://artifacts.elastic.co/downloads/elasticsearch/elasticsearch-6.5.4.tar.gz

Logstash: 6.5.4 #https://artifacts.elastic.co/downloads/logstash/logstash-6.5.4.tar.gz

Kibana: 6.5.4 #https://artifacts.elastic.co/downloads/kibana/kibana-6.5.4-linux-x86_64.tar.gz

Kafka: 2.11-2.1 #https://archive.apache.org/dist/kafka/2.1.0/kafka_2.11-2.1.0.tgz

Filebeat: 6.5.4

相应的版本最好下载对应的插件

相关地址:

官网地址:https://www.elastic.co

官网搭建:https://www.elastic.co/guide/index.html

实施部署

1、 Elasticsearch部署

Elasticsearch最关键的就是提供强大的索引能力。

Elasticsearch索引的精髓:一切设计都是为了提高搜索的性能

Elasticsearch优势

1.横向可扩展性:只需要增加服务器,做一点儿配置,启动一下Elasticsearch就可以并入集群。

2.分片机制提供更好的分布性:同一个索引分成多个分片, 分而治之的方式可提升处理效率。

3.高可用:提供复制( replica) 机制,一个分片可以设置多个复制,使得某台服务器在宕机的情况下,集群仍旧可以照常运行,并会把服务器宕机丢失的数据信息复制恢复到其他可用节点上。

4.使用简单:共需一条命令就可以下载文件,然后很快就能搭建一一个站内搜索引擎。

Elasticsearch存储结构

Elasticsearch是文件存储,Elasticsearch是面向文档型数据库,一条数据在这里就是一个文档

系统类型:Centos7.5

节点IP:172.16.246.234

软件版本:jdk-8u191-linux-x64.tar.gz、elasticsearch-6.5.4.tar.gz

示例节点:172.16.246.234

1、安装配置jdk8

ES运行依赖jdk8 -----三台机器都操作,先上传jdk1.8

[root@mes-1 ~]# tar xzf jdk-8u191-linux-x64.tar.gz -C /usr/local/

[root@mes-1 ~]# cd /usr/local/

[root@mes-1 local]# mv jdk1.8.0_191/ java

[root@mes-1 local]# echo '

JAVA_HOME=/usr/local/java

PATH=$JAVA_HOME/bin:$PATH

export JAVA_HOME PATH

' >>/etc/profile

[root@mes-1 ~]# source /etc/profile

2、安装配置ES----只在第一台操作操作下面的部分

(1)创建运行ES的普通用户

[root@mes-1 ~]# useradd elsearch

[root@mes-1 ~]# echo "123456" | passwd --stdin "elsearch"

(2)安装配置ES

[root@mes-1 ~]# tar xzf elasticsearch-6.5.4.tar.gz -C /usr/local/

[root@mes-1 ~]# cd /usr/local/elasticsearch-6.5.4/config/

[root@mes-1 config]# ls

elasticsearch.yml log4j2.properties roles.yml users_roles

jvm.options role_mapping.yml users

[root@mes-1 config]# cp elasticsearch.yml elasticsearch.yml.bak

[root@mes-1 config]# vim elasticsearch.yml ----找个地方添加如下内容

cluster.name: elk

node.name: elk01

node.master: true

node.data: true

path.data: /data/elasticsearch/data

path.logs: /data/elasticsearch/logs

bootstrap.memory_lock: false

bootstrap.system_call_filter: false

network.host: 0.0.0.0

http.port: 9200

#discovery.zen.ping.unicast.hosts: ["192.168.246.234", "192.168.246.231","192.168.246.235"]

#discovery.zen.minimum_master_nodes: 2

#discovery.zen.ping_timeout: 150s

#discovery.zen.fd.ping_retries: 10

#client.transport.ping_timeout: 60s

http.cors.enabled: true

http.cors.allow-origin: "*"

配置项含义:

cluster.name 集群名称,各节点配成相同的集群名称。

node.name 节点名称,各节点配置不同。

node.master 指示某个节点是否符合成为主节点的条件。

node.data 指示节点是否为数据节点。数据节点包含并管理索引的一部分。

path.data 数据存储目录。

path.logs 日志存储目录。

bootstrap.memory_lock

bootstrap.system_call_filter

network.host 绑定节点IP。

http.port 端口。

discovery.zen.ping.unicast.hosts 提供其他 Elasticsearch 服务节点的单点广播发现功能。

discovery.zen.minimum_master_nodes 集群中可工作的具有Master节点资格的最小数量,具有master资格的节点的数量。

discovery.zen.ping_timeout 节点在发现过程中的等待时间。

discovery.zen.fd.ping_retries 节点发现重试次数。

http.cors.enabled 用于允许head插件访问ES。

http.cors.allow-origin 允许的源地址。

(3)设置JVM堆大小

[root@mes-1 config]# vim jvm.options ----将

-Xms1g ----修改成 -Xms2g

-Xmx1g ----修改成 -Xms2g

或者:

推荐设置为4G,请注意下面的说明:

sed -i 's/-Xms1g/-Xms4g/' /usr/local/elasticsearch-6.5.4/config/jvm.options

sed -i 's/-Xmx1g/-Xmx4g/' /usr/local/elasticsearch-6.5.4/config/jvm.options

注意:

确保堆内存最小值(Xms)与最大值(Xmx)的大小相同,防止程序在运行时改变堆内存大小。

堆内存大小不要超过系统内存的50%

(4)创建ES数据及日志存储目录

[root@mes-1 ~]# mkdir -p /data/elasticsearch/data (/data/elasticsearch)

[root@mes-1 ~]# mkdir -p /data/elasticsearch/logs (/log/elasticsearch)

(5)修改安装目录及存储目录权限

[root@mes-1 ~]# chown -R elsearch:elsearch /data/elasticsearch

[root@mes-1 ~]# chown -R elsearch:elsearch /usr/local/elasticsearch-6.5.4

3、系统优化

(1)增加最大文件打开数

永久生效方法:

echo “* - nofile 65536” >> /etc/security/limits.conf

(2)增加最大进程数

[root@mes-1 ~]# vim /etc/security/limits.conf ---在文件最后面添加如下内容

* soft nofile 65536

* hard nofile 131072

* soft nproc 2048

* hard nproc 4096

更多的参数调整可以直接用这个

(3)增加最大内存映射数

[root@mes-1 ~]# vim /etc/sysctl.conf ---添加如下

vm.max_map_count=262144

vm.swappiness=0

[root@mes-1 ~]# sysctl -p

启动如果报下列错误

memory locking requested for elasticsearch process but memory is not locked

elasticsearch.yml文件

bootstrap.memory_lock : false

/etc/sysctl.conf文件

vm.swappiness=0

错误:

max file descriptors [4096] for elasticsearch process is too low, increase to at least [65536]

意思是elasticsearch用户拥有的客串建文件描述的权限太低,知道需要65536个

解决:

切换到root用户下面,

vim /etc/security/limits.conf

在最后添加

* hard nofile 65536

* hard nofile 65536

重新启动elasticsearch,还是无效?

必须重新登录启动elasticsearch的账户才可以,例如我的账户名是elasticsearch,退出重新登录。

另外*也可以换为启动elasticsearch的账户也可以,* 代表所有,其实比较不合适

启动还会遇到另外一个问题,就是

max virtual memory areas vm.max_map_count [65530] is too low, increase to at least [262144]

意思是:elasticsearch用户拥有的内存权限太小了,至少需要262114。这个比较简单,也不需要重启,直接执行

# sysctl -w vm.max_map_count=262144

就可以了

4、启动ES

[root@mes-1 ~]# su - elsearch

Last login: Sat Aug 3 19:48:59 CST 2019 on pts/0

[root@mes-1 ~]$ cd /usr/local/elasticsearch-6.5.4/

[root@mes-1 elasticsearch-6.5.4]$ ./bin/elasticsearch #先启动看看报错不,需要多等一会

终止之后

[root@mes-1 elasticsearch-6.5.4]$ nohup ./bin/elasticsearch & #放后台启动

[1] 11462

nohup: ignoring input and appending output to ‘nohup.out’

[root@mes-1 elasticsearch-6.5.4]$ tail -f nohup.out #看一下是否启动

或者:

su - elsearch -c "cd /usr/local/elasticsearch-6.5.4 && nohup bin/elasticsearch &"

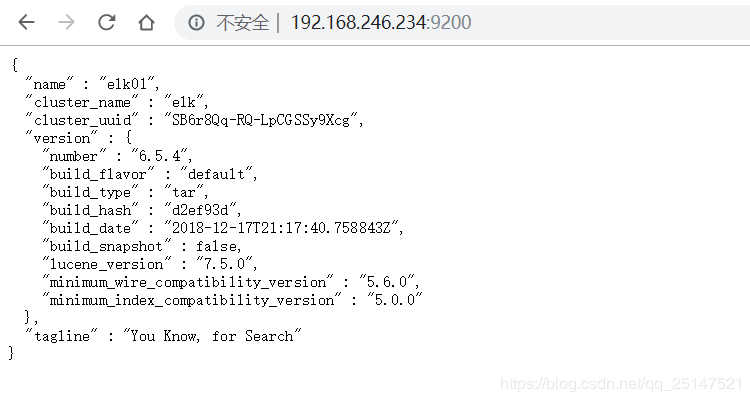

测试:浏览器访问http://172.16.246.234:9200

9200与9300端口号的区别

9300端口: ES节点之间通讯使用,是TCP协议端口号,ES集群之间通讯端口号。

9200端口: ES节点和外部通讯使用,暴露接口端口号。浏览器访问时使用

5.安装配置head监控插件(Web前端)----只需要安装一台就可以了。192.168.246.235

(1)安装node

[root@es-3-head-kib ~]# wget https://npm.taobao.org/mirrors/node/latest-v4.x/node-v4.4.7-linux-x64.tar.gz

[root@es-3-head-kib ~]# tar -zxf node-v4.4.7-linux-x64.tar.gz –C /usr/local

[root@es-3-head-kib ~]# vim /etc/profile #添加如下变量

NODE_HOME=/usr/local/node-v4.4.7-linux-x64

PATH=$NODE_HOME/bin:$PATH

export NODE_HOME PATH

[root@es-3-head-kib ~]# source /etc/profile

[root@es-3-head-kib ~]# node --version #检查node版本号

v4.4.7

(2)下载head插件

[root@es-3-head-kib ~]# wget https://github.com/mobz/elasticsearch-head/archive/master.zip

[root@es-3-head-kib ~]# cp master.zip /usr/local/

[root@es-3-head-kib ~]# unzip -d /usr/local/ master.zip

[root@es-3-head-kib ~]# cd /usr/local

或者

unzip –d /usr/local elasticsearch-head-master.zip

(3)安装grunt

[root@es-3-head-kib ~]# cd elasticsearch-head-master/

[root@mes-3-head-kib elasticsearch-head-master]# npm config set registry https://registry.npm.taobao.org #更换一个镜像,如果不更换下载会很慢

[root@mes-3-head-kib elasticsearch-head-master]# npm install -g grunt-cli #时间会很长

[root@es-3-head-kib elasticsearch-head-master]# grunt --version #检查grunt版本号

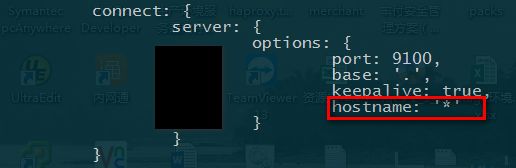

(4)修改head源码

[root@es-3-head-kib elasticsearch-head-master]# vim /usr/local/elasticsearch-head-master/Gruntfile.js (95左右)

添加hostname,注意在上一行末尾添加逗号,hostname 不需要添加逗号

[root@es-3-head-kib elasticsearch-head-master]# vim /usr/local/elasticsearch-head-master/_site/app.js (4359左右)

如果在一台机器上面可以不修改下面的操作。保持原来的就可以了

如果是集群需要修改如下信息:

原本是http://localhost:9200 ,如果head和ES不在同一个节点,注意修改成ES的IP地址

(5)下载head必要的文件

[root@es-3-head-kib ~]# wget https://github.com/Medium/phantomjs/releases/download/v2.1.1/phantomjs-2.1.1-linux-x86_64.tar.bz2

[root@es-3-head-kib ~]# yum -y install bzip2

[root@es-3-head-kib ~]# tar -jxf phantomjs-2.1.1-linux-x86_64.tar.bz2 -C /tmp/ #解压

(6)运行head

[root@es-3-head-kib ~]# cd /usr/local/elasticsearch-head-master/

[root@es-3-head-kib elasticsearch-head-master]# npm config set registry https://registry.npm.taobao.org #先执行这条命令更换一个镜像

[root@es-3-head-kib elasticsearch-head-master]# npm install

...

[email protected] node_modules/grunt-contrib-jasmine

├── [email protected]

├── [email protected]

├── [email protected]

├── [email protected] ([email protected], [email protected], [email protected], [email protected], [email protected])

├── [email protected]

├── [email protected] ([email protected])

└── [email protected] ([email protected], [email protected], [email protected], phan

[root@es-3-head-kib elasticsearch-head-master]# nohup grunt server &

(7)测试

访问http://172.16.246.235:9100

主节点:首先要将节点设置为候选主节点,候选主节点的设置方法是设置node.mater为true,默认情况下,node.mater和node.data的值都为true。在集群启动后各个节点会在候选节点中选举一个主节点。主节点负责创建索引、删除索引、分配分片、追踪集群中的节点状态等工作。

数据节点:负责数据的存储和相关具体操作,比如搜索.所以,数据节点对机器配置要求比较高,首先需要有足够的磁盘空间来存储数据,其次数据操作对系统CPU、Memory和IO的性能消耗都很大。通常随着集群的扩大,需要增加更多的数据节点来提高可用性。

客户端节点:负责请求的分发和汇总,本身并不存储数据。从而更好的实现负载均衡。

协调节点:这是一个节点的角色,不管是主节点、数据节点还是客户端节点,只要请求是由哪个节点进行分发和汇总,那么该节点就是承担了协调节点的角色。协调节点对处理器和运行内存要求比较高,客户端节点只能作为协调节点。

分片

主分片(Primary Shard):是elasticsearch的最小存储单元,一个index中的数据通常会存储在多个分片中。默认情况下,elasticsearch会为每个index分为5个分片.分片并不是越多越好,虽然分片查询时并行的,但是请求的分发和结果的合并都需要消耗时间和性能的,所以在数据量比较少的情况下,分片太多反而会降低效率。分片在创建index的时候就已经分配好,并且无法修改。

复制分片(Replica Shard):主要是进行数据冗余来提高系统的可靠性。

集群状态

Red,表示有主分片没有分配,某些数据不可用。

Yellow,表示主分片都已分配,数据都可用,但是有复制分片没有分配。

Green,表示主分片和复制分片都已分配,一切正常。

2、 Kibana部署

系统类型:Centos7.5

节点IP:192.168.246.235 D

软件版本:nginx-1.14.2、kibana-6.5.4-linux-x86_64.tar.gz

1. 安装配置Kibana

(1)安装

[root@es-3-head-kib ~]# tar zvxf kibana-6.5.4-linux-x86_64.tar.gz -C /usr/local/

(2)配置

[root@es-3-head-kib ~]# cd /usr/local/kibana-6.5.4-linux-x86_64/config/

[root@es-3-head-kib config]# vim kibana.yml

server.port: 5601

server.host: "192.168.246.235"

elasticsearch.url: "http://192.168.246.234:9200"

kibana.index: ".kibana"

配置项含义:

server.port kibana服务端口,默认5601

server.host kibana主机IP地址,默认localhost

elasticsearch.url 用来做查询的ES节点的URL,默认http://localhost:9200

kibana.index kibana在Elasticsearch中使用索引来存储保存

dashboards,默认.kibana

其他配置项可参考:

https://www.elastic.co/guide/en/kibana/6.5/settings.html

(3)启动

[root@es-3-head-kib config]# cd ..

[root@es-3-head-kib kibana-6.5.4-linux-x86_64]# nohup ./bin/kibana &

[1] 12054

[root@es-3-head-kib kibana-6.5.4-linux-x86_64]# nohup: ignoring input and appending output to ‘nohup.out’

2. 安装配置Nginx反向代理

(1)配置YUM源:

[root@es-3-head-kib ~]# rpm -ivh http://nginx.org/packages/centos/7/noarch/RPMS/nginx-release-centos-7-0.el7.ngx.noarch.rpm

(2)安装:

[root@es-3-head-kib ~]# yum install -y nginx

注意:httpd-tools用于生成nginx认证访问的用户密码文件

(3)配置反向代理

[root@es-3-head-kib ~]# cd /etc/nginx/conf.d/

[root@es-3-head-kib conf.d]# cp default.conf nginx.conf

[root@es-3-head-kib conf.d]# mv default.conf default.conf.bak

[root@es-3-head-kib conf.d]# vim nginx.conf

[root@es-3-head-kib conf.d]# cat nginx.conf

server {

listen 80;

server_name 192.168.246.235;

#charset koi8-r;

# access_log /var/log/nginx/host.access.log main;

# access_log off;

location / {

proxy_pass http://192.168.246.235:5601;

proxy_set_header Host $host:5601;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Via "nginx";

}

location /head/{

proxy_pass http://192.168.246.235:9100;

proxy_set_header Host $host:9100;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header Via "nginx";

}

}

(4)配置nginx

1.将原来的log_format注释掉,添加json格式的配置信息,如下:

[root@es-3-head-kib conf.d]# vim /etc/nginx/nginx.conf

log_format json '{"@timestamp":"$time_iso8601",'

'"@version":"1",'

'"client":"$remote_addr",'

'"url":"$uri",'

'"status":"$status",'

'"domain":"$host",'

'"host":"$server_addr",'

'"size":$body_bytes_sent,'

'"responsetime":$request_time,'

'"referer": "$http_referer",'

'"ua": "$http_user_agent"'

'}';

2.引用定义的json格式的日志:

access_log /var/log/nginx/access_json.log json;

(5)启动nginx

root@es-3-head-kib ~]# systemctl start nginx

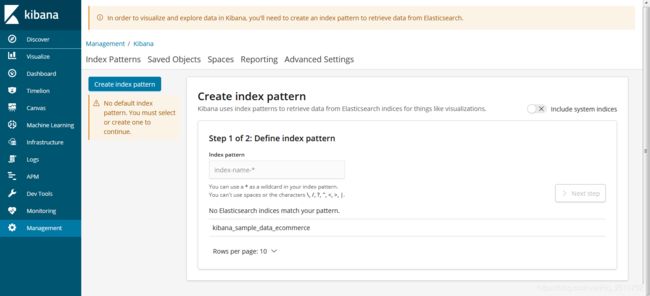

浏览器访问http://192.168.246.235 刚开始没有任何数据,会提示你创建新的索引。