- Scrapy分布式爬虫进阶:动态代理与并发优化实战

Kelaru

pythonprojectscrapy分布式爬虫python

写在前面。。。继“动态网页”“登录网站”“经验总结”“分布式爬虫”后,本篇献上Scrapy-Redis进阶实战,基于QuotestoScrape,聚焦动态代理池和并发优化,代码简洁,经验点燃智慧,适合新手到老兵。准备工作1.环境配置Python:3.8+(推荐3.10)。依赖安装:pipinstallscrapy==2.11.2scrapy-redis==0.7.4redis==5.0.8requ

- Python爬虫实战:爬取ETF基金持仓变化

Python爬虫项目

python爬虫开发语言信息可视化数据分析

1.项目背景ETF(Exchange-TradedFund,交易型开放式指数基金)作为一种在交易所上市交易的基金,其持仓信息对于投资者具有重要参考价值。了解ETF的持仓变化,可以帮助投资者判断市场趋势和资金流向。本文将通过Python爬虫技术,自动化地获取ETF基金的持仓变化数据,进行存储和分析。2.技术选型与环境准备2.1技术选型编程语言:Python3.8+爬虫框架:Scrapy数据解析:Be

- UA池和代理IP池

itLaity

Python基础知识讲解与总结中间件httppy代理模式

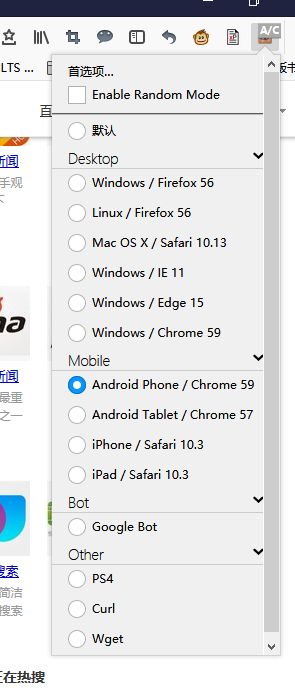

scrapy中中间件:位于scrapy引擎和下载器之间的一层组件作用:(1)引擎将请求传递给下载器过程中,下载中间件可以对请求进行一系列处理。比如设置请求的User-Agent,设置代理等(2)在下载器完成将Response传递给引擎中,下载中间件可以对响应进行一系列处理。比如进行gzip解压等。middlewares(中间件py文件)spider:从这里开始--->作用:产生一个或者一批url/

- Scrapy与分布式开发(2.3):lxml+xpath基本指令和提取方法详解

九月镇灵将

打造高效爬虫系统scrapy分布式xpathlxml

lxml+xpath基本指令和提取方法详解一、XPath简介XPath,全称为XMLPathLanguage,是一种在XML文档中查找信息的语言。它允许用户通过简单的路径表达式在XML文档中进行导航。XPath不仅适用于XML,还常用于处理HTML文档。二、基本指令和提取方法选择节点使用XPath,你可以轻松地选择XML文档中的节点。*选择根节点:/*选择子节点:/parent/child*选择所

- Python爬虫实战:使用Scrapy和Selenium高效爬取USPTO美国专利数据

Python爬虫项目

2025年爬虫实战项目python爬虫scrapy开发语言selenium测试工具

引言在当今的知识经济时代,专利数据蕴含着巨大的商业和技术价值。美国专利商标局(USPTO)作为全球最大的专利数据库之一,收录了数百万项专利信息,这些数据对于企业竞争分析、技术趋势预测和学术研究都具有重要意义。本文将详细介绍如何使用Python构建一个高效、稳定的USPTO专利数据爬虫系统。一、USPTO专利数据库概述1.1USPTO数据库结构USPTO提供了多种访问专利数据的途径:专利全文和图像数

- Python Scrapy的爬虫中间件开发

AI天才研究院

pythonscrapy爬虫ai

PythonScrapy爬虫中间件开发:从原理到实战的深度解析关键词Scrapy中间件、爬虫扩展、请求响应处理、反爬绕过、中间件生命周期、钩子函数、分布式爬取摘要本文系统解析Scrapy爬虫中间件(SpiderMiddleware)的开发方法论,覆盖从基础概念到高级实践的全链路知识。通过第一性原理推导中间件的核心机制,结合层次化架构分析(理论→设计→实现→应用),提供生产级代码示例与可视化流程模型

- Python 爬虫入门(九):Scrapy安装及使用「详细介绍」

blues_C

Python爬虫实战python爬虫scrapy

Python爬虫入门(九):Scrapy安装及使用「详细介绍」前言1.Scrapy简介2.Scrapy的安装2.1环境准备2.2安装Scrapy3.创建Scrapy项目3.1创建项目3.2项目结构简介4.编写爬虫4.1创建爬虫4.2解析数据4.3运行爬虫5.存储数据5.1存储为JSON文件5.2存储到数据库5.2.1MongoDB6.处理请求和响应6.1请求头设置6.2处理响应7.高级功能7.1使

- 数据分析全流程:从收集到可视化的高效实战

晨曦543210

python

1.数据收集来源:数据库、API、传感器、日志文件、社交媒体、问卷调查等。工具:Python(requests、Scrapy)、SQL、Excel、Kafka(实时流数据)。2.数据清洗处理缺失、重复、错误或不一致的数据:缺失值:删除、填充(均值/中位数/众数)、插值或预测。异常值:使用箱线图、Z-score或IQR方法检测并处理。格式标准化:统一日期、单位、文本格式(如大小写、去除空格)。去重:

- R语言初学者爬虫简单模板

q56731523

r语言爬虫开发语言iphone

习惯使用python做爬虫的,反过来使用R语言可能有点不太习惯,正常来说R语言好不好学完全取决于你的学习背景以及任务复杂情况。对于入门学者来说,R语言使用rvest+httr组合,几行代码就能完成简单爬取(比Python的Scrapy简单得多),R语言数据处理优势明显,爬取后可直接用dplyr/tidyr清洗,小打小闹用R语言完全没问题,如果是企业级大型项目还是有限考虑python,综合成本还是p

- Python爬虫:Scrapy报错:ModuleNotFoundError: No module named ‘scrapy.contrib‘

濯一一

#爬虫bugscrapypython爬虫

项目场景:今天,又开始自学Python爬虫Scrapy框架辽,爬爬爬于是又导包报错辽,,,问题描述:提示:第一行导入scrapy.contrib时报错了。原因分析:百度:找到类似的问题和解决方式:#bug:fromscrapytest.NewsItemsimportNewsItem#改为#debug:fromscrapytest.scrapytest.itemsimportNewsItem思考:重

- Ubuntu 22.04 修改默认 Python 版本为 Python3 笔记

笑衬人心。

ubuntupython笔记

Ubuntu系统默认使用的是Python2.x作为python命令的映射,而现代开发(如pip、Django、Flask、Scrapy等)大多基于Python3。本笔记将教你如何将默认python命令指向Python3(如Python3.8、3.10)。背景说明在Ubuntu22.04中:系统默认安装了Python2和Python3;运行python命令默认启动的是Python2;运行python

- Web爬虫编程语言选择指南

q56731523

前端爬虫开发语言

刚学爬虫的小伙伴常常为选择那种语言来写爬虫而烦恼,今天我将总结几种语言的优劣势,然后选择适合编写Web爬虫的编程语言。这就需要我们考虑开发效率、生态库支持、并发性能等因素。以下是主流选择及特点跟着一起看看吧:1.Python(推荐首选)优势:丰富库支持:Requests(HTTP请求)、BeautifulSoup/lxml(HTML解析)、Scrapy(全功能框架)、Selenium(模拟浏览器)

- Python 爬虫实战:知乎热榜趋势分析(话题生命周期 + 影响力评估)

Python核芯

Python爬虫实战项目python爬虫开发语言

一、引言知乎作为国内知名的问答社区,其热榜功能汇聚了当下最受关注的话题。这些话题的热度变化反映了公众兴趣的动态,对于内容创作者、市场营销人员和数据分析师等具有极高的参考价值。本文将详细介绍如何通过Python和Scrapy技术实现知乎热榜数据的自动化爬取,并结合数据分析手段进行话题热度分析和趋势预测。二、目标网站分析(一)知乎热榜页面结构知乎热榜页面(https://www.zhihu.com/h

- python爬虫爬百度云盘的资源

oaa608868

百度云爬虫python

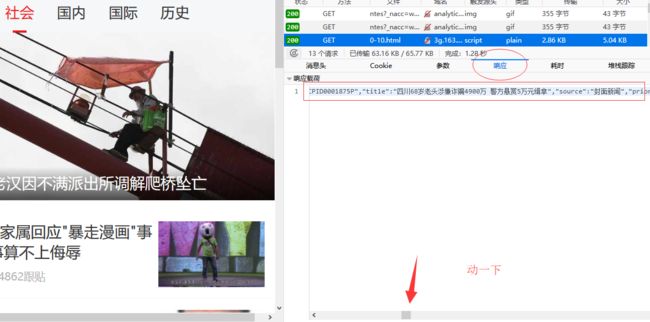

最近百度云盘不知道为啥不提供资源检索,正好最近看了一下python,正好来练练手,写歌爬虫爬一下百度云盘的资源。分析了一下百度云盘的网友源码和js文件,里面有大量ajax的东西,利用json传输数据,前端显示。话说,这样数据爬去就方便多了,也不要用scrapy啥的,直接解析json数据就好。分析js文件提炼了下面三个链接:URL_SHARE='http://yun.baidu.com/pclo

- Python - 爬虫;Scrapy框架之插件Extensions(四)

MinggeQingchun

PythonPython爬虫Scrapyextensions

阅读本文前先参考https://blog.csdn.net/MinggeQingchun/article/details/145904572在Scrapy中,扩展(Extensions)是一种插件,允许你添加额外的功能到你的爬虫项目中。这些扩展可以在项目的不同阶段执行,比如启动、关闭、处理请求、处理响应等。Extensions官网文档:Extensions—Scrapy2.12.0document

- Python3爬虫笔记 -- urllib

Alst0n

PythonPython3urlliburllib.request

urllib库是Python内置的HTTP请求库,不需要额外安装。它包含如下4个模块:request:HTTP请求模块error:异常处理模块parse:提供URL处理方法,包括拆分、解析、合并等robotparser:识别网站等robot.txt文件1、urllib.request发送请求连接URL,获取返回页面的源代码;默认请求方式为GETimporturllib.requestrespons

- Python爬虫实战:使用Scrapy+Selenium+Playwright高效爬取Stack Overflow问答数据

Python爬虫项目

2025年爬虫实战项目python爬虫scrapy微信开发语言科技selenium

摘要本文将详细介绍如何使用Python生态中最先进的爬虫技术组合(Scrapy+Selenium+Playwright)来爬取StackOverflow的问答数据。我们将从基础爬虫原理讲起,逐步深入到分布式爬虫、反反爬策略、数据存储等高级话题,并提供完整的可运行代码示例。本文适合有一定Python基础,想要掌握专业级网络爬虫技术的开发者阅读。1.爬虫技术概述1.1为什么选择StackOverflo

- Python爬虫实战:使用Scrapy+Selenium+Playwright高效爬取Coursera课程信息

Python爬虫项目

2025年爬虫实战项目python爬虫scrapy微信开发语言科技selenium

前言在当今信息爆炸的时代,在线教育平台如Coursera提供了海量的高质量课程资源。对于学习者、教育研究者和数据分析师来说,获取这些平台的课程信息具有重要价值。本文将详细介绍如何使用Python爬虫技术高效爬取Coursera课程信息,并分析其中的技术难点与解决方案。1.Coursera网站分析Coursera是一个典型的现代Web应用,具有以下特点:采用React/Vue等前端框架构建,大量内容

- Python爬虫实战:研究Bleach库相关技术

ylfhpy

爬虫项目实战python爬虫php开发语言Bleach

1.引言在大数据时代,网络内容采集已成为信息获取的重要手段。Python凭借其丰富的爬虫库(如Requests、Scrapy)和灵活的数据处理能力,成为网页爬虫开发的首选语言。然而,从互联网获取的内容往往包含恶意脚本、不安全标签等安全隐患,直接使用可能导致XSS(跨站脚本攻击)、数据泄露等风险。Bleach作为专业的HTML净化库,通过白名单机制提供了可靠的内容安全过滤方案。本文将结合实际案例,详

- Python爬虫实战:研究untangle库相关技术

ylfhpy

爬虫项目实战python爬虫php开发语言untangle

1.引言在大数据时代,网络数据已成为重要的信息资源。XML和HTML作为互联网上最常用的数据表示格式,广泛应用于API接口、网站结构和数据交换等场景。Python凭借其丰富的爬虫库(如Requests、Scrapy)和灵活的数据处理能力,成为网络数据采集的首选语言。然而,从复杂的XML/HTML文档中提取结构化数据仍然面临诸多挑战,如文档结构多样性、动态内容渲染和数据格式转换等问题。Untangl

- Python个人学习基础笔记-3.爬虫(1)

孜宸润泽

python学习笔记

一.爬虫的定义爬虫(crawler/spider)是模拟浏览器行为,按照编写规则,自动接收网页信息的工具。通常而言爬虫首先从初始URL集选择URL,向目标网页发起请求,获取网页的HTML源码,然后将获取的数据进行解析过滤,保存我们所需要的标题、内容等,最后提取新的URL加入待爬序列。爬虫常见所需要的库包括Request库、BeautifulSoup4库、Scrapy库和Selenium库等。二.R

- python爬虫框架scrapy学习记录

苏州向日葵

pythonpython爬虫scrapy

一爬虫简介爬虫这种技术听说好多年了,知道它从互联网抓取数据非常厉害,但由于不是专门从事相关工作,了解也就是听听。最近有些空闲,打算实际学习一下,这里做个小小记录。二常用框架介绍通用性框架类型说明scrapy最流行的爬虫框架,功能全面,扩展性强,社区支持完善,适用于中大型爬虫项目pySpider国产爬虫框架,自带web界面,方便监控和管理轻量级框架beautifulSoup+Requests经典的轻

- 基于Python的智能招聘信息聚合爬虫开发实战:Scrapy+Selenuim+AI解析

Python爬虫项目

2025年爬虫实战项目python爬虫开发语言seleniumscrapy人工智能

摘要本文将详细介绍如何使用Python构建一个功能强大的智能招聘信息聚合爬虫系统。我们将结合Scrapy框架、Selenium自动化、反反爬技术、自然语言处理和数据存储等多项技术,实现从多个招聘网站高效抓取、清洗和存储招聘数据。文章包含完整的代码实现和架构设计,适合中高级Python开发者学习现代爬虫开发技术。关键词:Python爬虫、招聘信息聚合、Scrapy、Selenium、反反爬技术、数据

- Python爬虫进阶必看!Scrapy框架实战:从架构解析到反爬突破的完整指南

小张在编程

python爬虫scrapy

引言你是否遇到过这样的场景?想爬取豆瓣电影Top250的完整数据(电影名、评分、导演、上映时间),用requests+BeautifulSoup写了200行代码,却被以下问题困扰:手动管理请求队列,并发效率低;频繁请求被封IP,需手动切换代理;数据提取逻辑分散,清洗和存储代码混杂;遇到JS动态加载的页面,无法直接解析。这些问题的解决方案,藏在Python爬虫的“瑞士军刀”——Scrapy框架中。它

- 基于Python的智能宠物用品信息爬虫实战:Scrapy+Playwright+AI解析

Python爬虫项目

2025年爬虫实战项目python爬虫scrapy开发语言人工智能

摘要本文将详细介绍如何使用Python构建一个高效的宠物用品信息爬虫系统,结合Scrapy框架、Playwright无头浏览器和AI解析技术,实现对各大电商平台宠物用品数据的自动化采集与分析。文章包含6000余字的技术解析和完整代码实现,适合中高级Python开发者学习现代爬虫技术。1.爬虫技术选型与架构设计现代网络爬虫面临三大挑战:动态内容加载、反爬虫机制和数据结构化。我们的解决方案采用分层架构

- 基于Python的智能家电参数爬虫与比对系统开发实战

Python爬虫项目

2025年爬虫实战项目python爬虫开发语言scrapy人工智能

摘要本文将详细介绍如何使用Python最新技术栈构建一个高效、智能的家电参数爬取与比对系统。我们将使用异步爬虫框架、机器学习辅助解析、大数据存储等技术,实现从多个电商平台自动采集家电参数,并进行智能比对分析。文章包含完整的代码实现和架构设计,适合中高级Python开发者学习现代爬虫开发的最佳实践。关键词:Python爬虫、异步IO、家电参数比对、Scrapy、Playwright、机器学习解析一、

- Python爬虫(六):Scrapy框架

随机森林404

Pythonpython爬虫scrapy

"Scrapy到底该怎么学?"今天,我将用这篇万字长文,带你从零开始掌握Scrapy框架的核心用法,并分享我在实际项目中的实战经验!建议收藏⭐!一、Scrapy简介:为什么选择它?1.1ScrapyvsRequests+BeautifulSoup很多新手会问:“我已经会用Requests+BeautifulSoup了,为什么还要学Scrapy?”对比项Requests+BS4Scrapy性能同步请

- Python网络爬虫:Scrapy框架的全面解析

4.0啊

Python网络爬虫pythonscrapyipython

Python网络爬虫:Scrapy框架的全面解析一、引言在当今互联网的时代,数据是最重要的资源之一。为了获取这些数据,我们经常需要编写网络爬虫来从各种网站上抓取信息。Python作为一种强大的编程语言,拥有许多用于网络爬虫的工具和库。其中,Scrapy是一个功能强大且灵活的开源网络爬虫框架,它提供了一种高效的方式来爬取网站并提取所需的数据。本文将深入探讨Scrapy框架的核心概念、使用方法以及高级

- Python爬虫进阶:Scrapy+Playwright+智能解析高效爬取B站游戏实况视频数据

Python爬虫项目

2025年爬虫实战项目python爬虫scrapy笔记开发语言游戏音视频

摘要本文将深入讲解如何构建一个高性能B站游戏实况视频爬虫系统,涵盖从逆向工程到分布式部署的全流程。项目采用Scrapy框架作为核心,集成Playwright处理动态渲染,使用智能解析技术应对B站反爬机制,结合MongoDB和Elasticsearch构建数据存储与检索系统,最终实现每小时可处理10万+视频数据的专业级采集方案。1.B站数据生态分析1.1游戏区数据价值热门游戏实时监测UP主影响力评估

- Python 爬虫实战:英雄联盟赛事数据爬取(Scrapy+Playwright + 多源数据融合)

Python核芯

Python爬虫实战项目python爬虫scrapy

引言在电竞数据分析领域,英雄联盟(LeagueofLegends)赛事数据具有极高的商业价值。本文将通过一个完整的实战案例,演示如何使用Scrapy框架结合Playwright库,实现多源赛事数据的爬取与融合。项目涵盖动态渲染页面处理、分布式爬虫架构、数据清洗整合等核心技术点,最终构建一个可扩展的电竞数据采集平台。一、技术选型分析1.1为什么选择Scrapy+Playwright组合?Scrapy

- java解析APK

3213213333332132

javaapklinux解析APK

解析apk有两种方法

1、结合安卓提供apktool工具,用java执行cmd解析命令获取apk信息

2、利用相关jar包里的集成方法解析apk

这里只给出第二种方法,因为第一种方法在linux服务器下会出现不在控制范围之内的结果。

public class ApkUtil

{

/**

* 日志对象

*/

private static Logger

- nginx自定义ip访问N种方法

ronin47

nginx 禁止ip访问

因业务需要,禁止一部分内网访问接口, 由于前端架了F5,直接用deny或allow是不行的,这是因为直接获取的前端F5的地址。

所以开始思考有哪些主案可以实现这样的需求,目前可实施的是三种:

一:把ip段放在redis里,写一段lua

二:利用geo传递变量,写一段

- mysql timestamp类型字段的CURRENT_TIMESTAMP与ON UPDATE CURRENT_TIMESTAMP属性

dcj3sjt126com

mysql

timestamp有两个属性,分别是CURRENT_TIMESTAMP 和ON UPDATE CURRENT_TIMESTAMP两种,使用情况分别如下:

1.

CURRENT_TIMESTAMP

当要向数据库执行insert操作时,如果有个timestamp字段属性设为

CURRENT_TIMESTAMP,则无论这

- struts2+spring+hibernate分页显示

171815164

Hibernate

分页显示一直是web开发中一大烦琐的难题,传统的网页设计只在一个JSP或者ASP页面中书写所有关于数据库操作的代码,那样做分页可能简单一点,但当把网站分层开发后,分页就比较困难了,下面是我做Spring+Hibernate+Struts2项目时设计的分页代码,与大家分享交流。

1、DAO层接口的设计,在MemberDao接口中定义了如下两个方法:

public in

- 构建自己的Wrapper应用

g21121

rap

我们已经了解Wrapper的目录结构,下面可是正式利用Wrapper来包装我们自己的应用,这里假设Wrapper的安装目录为:/usr/local/wrapper。

首先,创建项目应用

&nb

- [简单]工作记录_多线程相关

53873039oycg

多线程

最近遇到多线程的问题,原来使用异步请求多个接口(n*3次请求) 方案一 使用多线程一次返回数据,最开始是使用5个线程,一个线程顺序请求3个接口,超时终止返回 缺点 测试发现必须3个接

- 调试jdk中的源码,查看jdk局部变量

程序员是怎么炼成的

jdk 源码

转自:http://www.douban.com/note/211369821/

学习jdk源码时使用--

学习java最好的办法就是看jdk源代码,面对浩瀚的jdk(光源码就有40M多,比一个大型网站的源码都多)从何入手呢,要是能单步调试跟进到jdk源码里并且能查看其中的局部变量最好了。

可惜的是sun提供的jdk并不能查看运行中的局部变量

- Oracle RAC Failover 详解

aijuans

oracle

Oracle RAC 同时具备HA(High Availiablity) 和LB(LoadBalance). 而其高可用性的基础就是Failover(故障转移). 它指集群中任何一个节点的故障都不会影响用户的使用,连接到故障节点的用户会被自动转移到健康节点,从用户感受而言, 是感觉不到这种切换。

Oracle 10g RAC 的Failover 可以分为3种:

1. Client-Si

- form表单提交数据编码方式及tomcat的接受编码方式

antonyup_2006

JavaScripttomcat浏览器互联网servlet

原帖地址:http://www.iteye.com/topic/266705

form有2中方法把数据提交给服务器,get和post,分别说下吧。

(一)get提交

1.首先说下客户端(浏览器)的form表单用get方法是如何将数据编码后提交给服务器端的吧。

对于get方法来说,都是把数据串联在请求的url后面作为参数,如:http://localhost:

- JS初学者必知的基础

百合不是茶

js函数js入门基础

JavaScript是网页的交互语言,实现网页的各种效果,

JavaScript 是世界上最流行的脚本语言。

JavaScript 是属于 web 的语言,它适用于 PC、笔记本电脑、平板电脑和移动电话。

JavaScript 被设计为向 HTML 页面增加交互性。

许多 HTML 开发者都不是程序员,但是 JavaScript 却拥有非常简单的语法。几乎每个人都有能力将小的

- iBatis的分页分析与详解

bijian1013

javaibatis

分页是操作数据库型系统常遇到的问题。分页实现方法很多,但效率的差异就很大了。iBatis是通过什么方式来实现这个分页的了。查看它的实现部分,发现返回的PaginatedList实际上是个接口,实现这个接口的是PaginatedDataList类的对象,查看PaginatedDataList类发现,每次翻页的时候最

- 精通Oracle10编程SQL(15)使用对象类型

bijian1013

oracle数据库plsql

/*

*使用对象类型

*/

--建立和使用简单对象类型

--对象类型包括对象类型规范和对象类型体两部分。

--建立和使用不包含任何方法的对象类型

CREATE OR REPLACE TYPE person_typ1 as OBJECT(

name varchar2(10),gender varchar2(4),birthdate date

);

drop type p

- 【Linux命令二】文本处理命令awk

bit1129

linux命令

awk是Linux用来进行文本处理的命令,在日常工作中,广泛应用于日志分析。awk是一门解释型编程语言,包含变量,数组,循环控制结构,条件控制结构等。它的语法采用类C语言的语法。

awk命令用来做什么?

1.awk适用于具有一定结构的文本行,对其中的列进行提取信息

2.awk可以把当前正在处理的文本行提交给Linux的其它命令处理,然后把直接结构返回给awk

3.awk实际工

- JAVA(ssh2框架)+Flex实现权限控制方案分析

白糖_

java

目前项目使用的是Struts2+Hibernate+Spring的架构模式,目前已经有一套针对SSH2的权限系统,运行良好。但是项目有了新需求:在目前系统的基础上使用Flex逐步取代JSP,在取代JSP过程中可能存在Flex与JSP并存的情况,所以权限系统需要进行修改。

【SSH2权限系统的实现机制】

权限控制分为页面和后台两块:不同类型用户的帐号分配的访问权限是不同的,用户使

- angular.forEach

boyitech

AngularJSAngularJS APIangular.forEach

angular.forEach 描述: 循环对obj对象的每个元素调用iterator, obj对象可以是一个Object或一个Array. Iterator函数调用方法: iterator(value, key, obj), 其中obj是被迭代对象,key是obj的property key或者是数组的index,value就是相应的值啦. (此函数不能够迭代继承的属性.)

- java-谷歌面试题-给定一个排序数组,如何构造一个二叉排序树

bylijinnan

二叉排序树

import java.util.LinkedList;

public class CreateBSTfromSortedArray {

/**

* 题目:给定一个排序数组,如何构造一个二叉排序树

* 递归

*/

public static void main(String[] args) {

int[] data = { 1, 2, 3, 4,

- action执行2次

Chen.H

JavaScriptjspXHTMLcssWebwork

xwork 写道 <action name="userTypeAction"

class="com.ekangcount.website.system.view.action.UserTypeAction">

<result name="ssss" type="dispatcher">

- [时空与能量]逆转时空需要消耗大量能源

comsci

能源

无论如何,人类始终都想摆脱时间和空间的限制....但是受到质量与能量关系的限制,我们人类在目前和今后很长一段时间内,都无法获得大量廉价的能源来进行时空跨越.....

在进行时空穿梭的实验中,消耗超大规模的能源是必然

- oracle的正则表达式(regular expression)详细介绍

daizj

oracle正则表达式

正则表达式是很多编程语言中都有的。可惜oracle8i、oracle9i中一直迟迟不肯加入,好在oracle10g中终于增加了期盼已久的正则表达式功能。你可以在oracle10g中使用正则表达式肆意地匹配你想匹配的任何字符串了。

正则表达式中常用到的元数据(metacharacter)如下:

^ 匹配字符串的开头位置。

$ 匹配支付传的结尾位置。

*

- 报表工具与报表性能的关系

datamachine

报表工具birt报表性能润乾报表

在选择报表工具时,性能一直是用户关心的指标,但是,报表工具的性能和整个报表系统的性能有多大关系呢?

要回答这个问题,首先要分析一下报表的处理过程包含哪些环节,哪些环节容易出现性能瓶颈,如何优化这些环节。

一、报表处理的一般过程分析

1、用户选择报表输入参数后,报表引擎会根据报表模板和输入参数来解析报表,并将数据计算和读取请求以SQL的方式发送给数据库。

2、

- 初一上学期难记忆单词背诵第一课

dcj3sjt126com

wordenglish

what 什么

your 你

name 名字

my 我的

am 是

one 一

two 二

three 三

four 四

five 五

class 班级,课

six 六

seven 七

eight 八

nince 九

ten 十

zero 零

how 怎样

old 老的

eleven 十一

twelve 十二

thirteen

- 我学过和准备学的各种技术

dcj3sjt126com

技术

语言VB https://msdn.microsoft.com/zh-cn/library/2x7h1hfk.aspxJava http://docs.oracle.com/javase/8/C# https://msdn.microsoft.com/library/vstudioPHP http://php.net/manual/en/Html

- struts2中token防止重复提交表单

蕃薯耀

重复提交表单struts2中token

struts2中token防止重复提交表单

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 2015年7月12日 11:52:32 星期日

ht

- 线性查找二维数组

hao3100590

二维数组

1.算法描述

有序(行有序,列有序,且每行从左至右递增,列从上至下递增)二维数组查找,要求复杂度O(n)

2.使用到的相关知识:

结构体定义和使用,二维数组传递(http://blog.csdn.net/yzhhmhm/article/details/2045816)

3.使用数组名传递

这个的不便之处很明显,一旦确定就是不能设置列值

//使

- spring security 3中推荐使用BCrypt算法加密密码

jackyrong

Spring Security

spring security 3中推荐使用BCrypt算法加密密码了,以前使用的是md5,

Md5PasswordEncoder 和 ShaPasswordEncoder,现在不推荐了,推荐用bcrpt

Bcrpt中的salt可以是随机的,比如:

int i = 0;

while (i < 10) {

String password = "1234

- 学习编程并不难,做到以下几点即可!

lampcy

javahtml编程语言

不论你是想自己设计游戏,还是开发iPhone或安卓手机上的应用,还是仅仅为了娱乐,学习编程语言都是一条必经之路。编程语言种类繁多,用途各 异,然而一旦掌握其中之一,其他的也就迎刃而解。作为初学者,你可能要先从Java或HTML开始学,一旦掌握了一门编程语言,你就发挥无穷的想象,开发 各种神奇的软件啦。

1、确定目标

学习编程语言既充满乐趣,又充满挑战。有些花费多年时间学习一门编程语言的大学生到

- 架构师之mysql----------------用group+inner join,left join ,right join 查重复数据(替代in)

nannan408

right join

1.前言。

如题。

2.代码

(1)单表查重复数据,根据a分组

SELECT m.a,m.b, INNER JOIN (select a,b,COUNT(*) AS rank FROM test.`A` A GROUP BY a HAVING rank>1 )k ON m.a=k.a

(2)多表查询 ,

使用改为le

- jQuery选择器小结 VS 节点查找(附css的一些东西)

Everyday都不同

jquerycssname选择器追加元素查找节点

最近做前端页面,频繁用到一些jQuery的选择器,所以特意来总结一下:

测试页面:

<html>

<head>

<script src="jquery-1.7.2.min.js"></script>

<script>

/*$(function() {

$(documen

- 关于EXT

tntxia

ext

ExtJS是一个很不错的Ajax框架,可以用来开发带有华丽外观的富客户端应用,使得我们的b/s应用更加具有活力及生命力。ExtJS是一个用 javascript编写,与后台技术无关的前端ajax框架。因此,可以把ExtJS用在.Net、Java、Php等各种开发语言开发的应用中。

ExtJs最开始基于YUI技术,由开发人员Jack

- 一个MIT计算机博士对数学的思考

xjnine

Math

在过去的一年中,我一直在数学的海洋中游荡,research进展不多,对于数学世界的阅历算是有了一些长进。为什么要深入数学的世界?作为计算机的学生,我没有任何企图要成为一个数学家。我学习数学的目的,是要想爬上巨人的肩膀,希望站在更高的高度,能把我自己研究的东西看得更深广一些。说起来,我在刚来这个学校的时候,并没有预料到我将会有一个深入数学的旅程。我的导师最初希望我去做的题目,是对appe