AutoX创始人肖健雄来信:无人车量产的4大技术储备

作者:肖健雄教授

量子位 报道 | 公众号 QbitAI

2016年春,普林斯顿大学助理教授肖健雄从“Professor X”,成为了AutoX创始人,正式开启自动驾驶创业旅程。

在此之前,肖健雄教授在学术研究领域留下了一份光鲜履历:

香港科技大学本硕,从那时起就开始三维重建和街景分析研究;

其后博士学于MIT,期间拿到2012年Google Research 最佳论文奖。

博士毕业后受聘普林斯顿大学计算机系,出任助理教授,搭建起计算机视觉和机器人实验室,专注于三维计算机视觉在机器人领域的应用,并在2014、2015年连获Google Research Awards。

江湖人称“Professor X”。

但创立自动驾驶公司AutoX后,对外分享和披露进展的时候并不多。

而这篇投稿,就是Professor X关于无人车量产的最新思考,同时也举例披露了AutoX的最新进展。

量子位微微编辑,原文刊发如下:

《四大核心技术突破,推动无人驾驶量产》

AutoX自成立之初,技术开发就以量产为导向,在过去两年里获得了若干个重大突破。

本文将从四个方面——感知、地图、仿真、工程——介绍AutoX为实现无人驾驶量产而做的技术储备。

这四大技术突破,既是量产必不可少需要的,也是百度阿波罗等开源系统所没有涉及的,帮助AutoX在同行里建立了强大的技术壁垒。

正是因此,我希望通过本文,给无人驾驶技术爱好者提供一些对于最新技术发展的参考资料,同时帮助投资界的朋友总结出一个技术清单,在进行相关领域投资时作为技术DD的指南。

摄像头为主的视觉感知

AutoX自创始以来,主打“Camera First”以摄像为主的感知方案。

以摄像头为主有多方面优势:一)分辨率高所以更加安全,二)价格便宜,容易落地,三)可快速实现量产,容易规模化。

其中,最为重要的一点是摄像头的高分辨率。 现有最高端的量产激光雷达的垂直分辨率最高也仅有64,而普通摄像头的垂直分辨率最低也有720,有一个数量级以上的差别。

高分辨率可以为感知系统带来更高的安全系数。对于城市道路的无人驾驶而言,分辨率极为重要,因为路况更为复杂,行人、车辆等障碍物数量多,小孩、小狗、滑板车等小物体也很可能出现。所以高分辨率对保障无人驾驶的安全系数极为重要。

高分辨率和颜色信息也让摄像头对物体的种类识别也远超过激光雷达的性能,从而保障了运动预测和行为决策的准确性。

在摄像头感知方面,AutoX过去两年深耕算法,有多项突破。

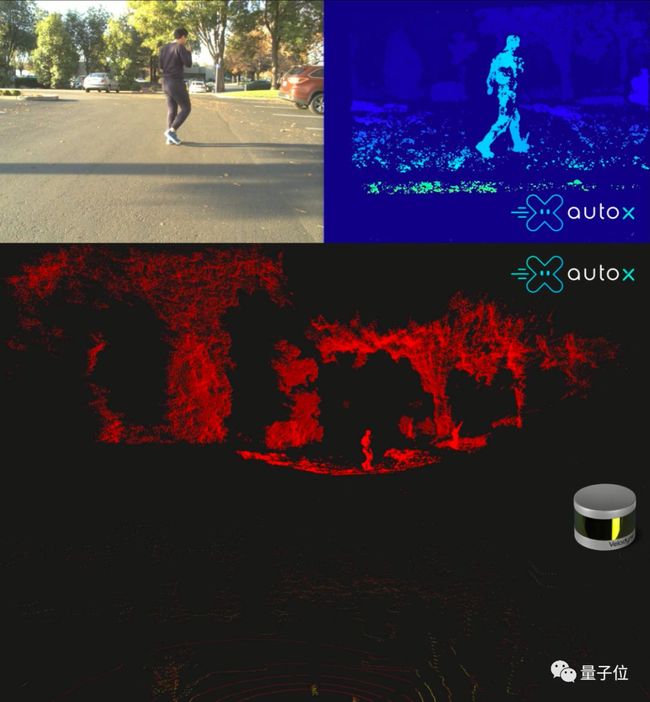

第一项突破是基于双目的三维视觉,也就是模仿人眼,使用两个摄像头测算出场景的三维深度。

目前的无人驾驶系统,在深度感知上一般以激光雷达为主,因为这种传感器在测量距离上都有一定的优势。

但我们用更廉价的双目摄像头生成的三维点云图,相比起机械式激光雷达分辨率有一个数量级以上的提升,相比起固态激光雷达其噪声也更小。

△ AutoX用双目摄像头生成的深度图

AutoX用摄像头形成的三维点云非常密集,将前景里的人和80米以外背景中的树木的三维点云都清晰计算出来。

当然,我并不是想表达我们不使用激光雷达,而是指出摄像头在高级算法处理后能达成更好的深度感知效果。

AutoX的方案中也融合激光雷达和其他传感器,比如我们已经可以实现量产的无人送货小车使用了一颗16线的激光雷达和超声波雷达。我们的方案使用多传感器融合提供多层冗余,让系统更安全。

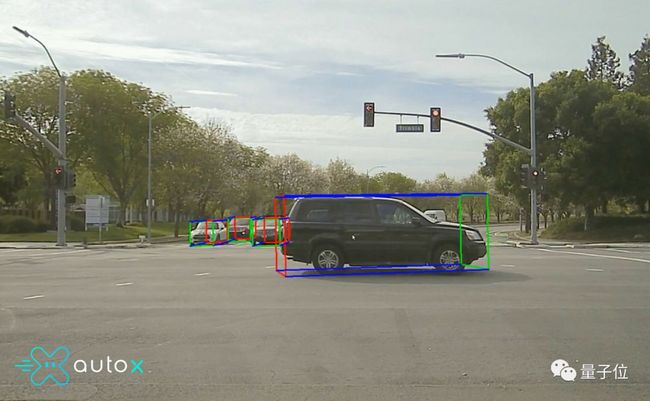

我们在摄像头感知上的第二个突破,是基于单目摄像头的三维物体识别。我们用单个摄像头即可实时计算出车辆周边物体的位置,角度等三维信息,主要得益于我们领先的深度学习算法。

第三个突破在实时的语义分析。所谓语义分析,是指自动分割并识别出图像、视频中物体的类别。

我们的感知系统实时地区分出视频中的汽车、天空、树木、地面、车道线等。现在业内很多方案的语义分析效果不错,但还无法做到对高分辨率视频的实时分析,无法满足无人驾驶的要求。

摄像头高分辨率也对复杂场景的语义分析有明显优势,下面这张图是我们在旧金山闹市区的复杂道路上进行实时语义分析的结果。

旧金山是北美最为繁忙的城市之一,错综复杂的路况对无人驾驶来说是极大的挑战。这种细致的语义识别能力可以很好的利用摄像头高密度的信息量补偿激光雷达在语义识别上的缺陷。

除上面提到了三项突破外,AutoX的摄像头感知技术在极端天气和意外场景中仍有很强的稳定性。比如,在暴雨天气、阳光直射、夜间等环境下,系统依然能感知道路状况,做出精确的检测与识别。

△ 大雨:车辆检查

△ 强逆光:地面和车道线检查

△ 夜间测试全视觉无人驾驶

我们甚至还测试过在无人驾驶车辆行驶中,将激光雷达遮盖住,在深夜测试,结果证明我们的系统仍可以安全地运行。

正如上文所说,AutoX并不单纯依靠激光雷达,而是用它提升安全与冗余。

我们与上汽集团合作,把我们的系统安装在了一款上汽名爵的车型上,进行了大量的白天和黑夜的压力测试:

总所周知,感知系统的实时性水平对自动驾驶系统的性能和安全有着巨大的影响。在时速120公里的情况下,0.1s的延时产生的位置误差接近一个完整的车身长度。正是由于这样的原因,业内很多同行会对以图像为基本的感知系统的安全性产生质疑。

AutoX的图像感知系统在设计过程中保持了一贯的对实时性的高要求。以上介绍的感知系统运行的速度全都高于20FPS,两倍于激光雷达的常用采样速率。

大规模区域状高清地图

为保证无人驾驶的安全,高精度地图能提供非常可靠的冗余,也可以为系统提供基本的道路信息,降低一部分车载实时的计算量。现在一些开发无人驾驶系统的公司也独立开发了自己的高精度地图,而AutoX具备的优势有两点。

首先,AutoX已掌握了大规模区块状建立高清地图的技术实力。相比一些仍然只能进行一个loop的自动驾驶演示,区块状地图是实现点到点的必备前提。

下图是我们构建的硅谷多个街区的高精度地图:

地图范围规模越大,技术要求也越高。

大规模高精度地图的建立,需要做到地图的闭环,算法上叫做loop closure和bundle adjustment,也就是同一个路口扫描两次后可以识别出两次扫描是一样的,而非两个不同的路口。

这是众所周知的三维几何视觉的难题。这在地图范围扩大时会带来很大的挑战,并影响地图的效果。

这却恰恰是我们团队的强项之一:我个人在十多年前就师从三维几何视觉始祖权龙教授从事大规模街景重建,AutoX的团队中也有众多世界顶级名校的博士团队专门从事这方面的工作。过去两年,我们在多年深度研发技术背景的基础上,做了大量的新算法研发,实现了全自动检测重复扫描的区域,并通过优化算法消除重影,全自动完成地图loop closure。

地图范围越大,对计算量的要求越高,为此我们在云端进行并行计算,做了大量的工程优化,让高精度地图满足实际需求。

这得益于我们来自美国科技巨头(FAAMG: Facebook、Amazon、Apple、Microsoft以及Google)的最优秀工程和架构师,把软件工程能力发挥到极致。这帮杰出的工程师不仅仅会刷题、会编程竞赛,更重要的是经过美国顶级技术公司的大规模工程化实战训练,对系统架构工程有深刻的见解。

我们高精度地图的第二个特点是多传感器融合。普通的高精度地图主要靠激光雷达数据生成,只有物体的反射率信息,因而是黑白的。AutoX则融合了摄像头、激光雷达、GPS、IMU的数据生成地图,地图是彩色的,信息也更为丰富。不仅仅局限于硬件,以下图片是我们自己研发设计的多传感器融合组合:

多传感器三维仿真器

我们知道,要让无人驾驶实现安全可靠,需要数十亿英里的路测,这会耗费大量的财力及时间。

仿真器则是一种变通的方法,它可以在虚拟世界中测量无人驾驶系统。Waymo对外展示了其仿真系统,也让这一技术为外界所熟知,数据显示,它已经在仿真系统中测试数十亿英里。

百度阿波罗也多次强调,其仿真平台是其主要的核心技术,不开源,而将其列为阿波罗主要变现途径,通过给阿波罗合作伙伴提供仿真云服务来创收。

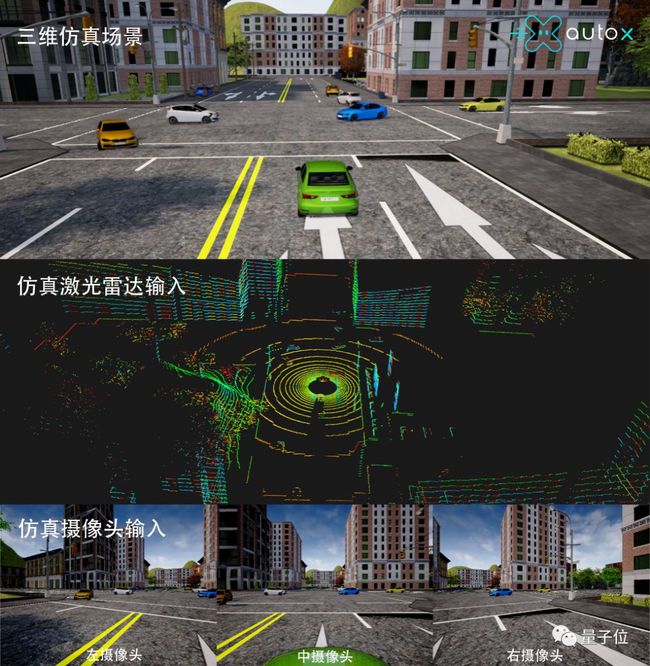

AutoX不只完全从零开始独立研发了自己的仿真器,而且这款仿真器也有了更高层次上的突破。

Waymo和百度的仿真器都是基于二维仿真的场景或者提前录好的数据进行的回放,而不是真正意义上的全三维虚拟环境的仿真,其缺陷在于无法仿真感知系统闭环,同时也有很多不在数据集里的场景无法覆盖到。

AutoX的三维仿真器可以从无到有地产生出全虚拟的数字化环境,是真正意义上的仿真器,可以随机产生出各种场景,从而覆盖各种无穷种组合。

另外一个特点是AutoX的仿真器是基于多传感器的三维仿真,我们可以模拟出摄像头、激光雷达等传感器的输入,以及仿真世界中各个物体(车辆、地面、墙壁等)的物理特性和车辆运动学模型,让测试更真实,可以把全套无人驾驶AI,包括感知模块,都通通放在仿真器进行最真实的仿真。

同时我们还会根据仿真数据构建高精度地图,完全模拟无人驾驶的运行环境。

而不是像Waymo或百度一样只能主要针对决策规划方面进行仿真。高效、实时和逼真的模拟器不仅能加快人工智能模块的开发,同时也能增强”长尾场景”的处理能力。

△ AutoX三维仿真器中建立的三维高精地图

软硬件一体化集成

实现无人驾驶车辆的量产,至关重要的一点是实现软硬件的一体化。

有人说,百度的Apollo无人驾驶平台已经部分开源了,只需要在它的平台上开发就可以了。

但就目前来说,无人驾驶仍是一项复杂的系统工程,很多技术没有统一的标准,开源平台在对接不同合作方的计算和硬件平台时,会占用大量的人力资源,导致开发精力分散,进展缓慢。

所以AutoX采用的是类似于苹果iPhone的软硬件一体模式,提供整套的无人驾驶服务。

我们这么做的目标,是希望尽早实现量产化的无人驾驶。如果仅做软件开发,没有硬件设计能力,往往会受制于人。

比如当前很多自动驾驶公司是纯软件公司,不具备硬件工程能力(包括电子与机械),这对产品化极度不利。

无人驾驶人命关天,产品化对系统的集成度和稳定性要求极高,包括散热、耐晒、防雨、防尘、寿命、是否接触不良,都有极高要求。

小如几百条线路如何稳定地进行高速信号传输;中如传感器支架长时间保持低振动无形变,和电子器械的电源电压保证稳定低噪声;大到计算平台的嵌入式看门狗系统和VCU的冗余:都对硬件工程提出了很高的要求。

又比如,现在很多乘用车辆以及几乎所有的货运车辆是没有线控系统的,而它又是让计算机控制车辆所必需的。

有的公司会与AS/Dataspeed这样的公司合作,让后者帮助改装车辆。这样做在仅有数十辆原型车时是可行的,但要实现大规模的量产,会导致成本剧增,技术也达不到品化级别。

与此同时,使用类似AS/Dataspeed的黑盒线控系统会限制自动驾驶公司对车辆底层系统安全性的提升,从而无法从根本上提高自动驾驶系统的稳定性。

AutoX独立研发了车辆线控系统,现在主要用在我们的无人驾驶货车上。我们是少数拥有独立线控系统的公司,这也是为了量产与产品落地所必须准备的。

△ 工程师测试AutoX自主研发的线控原型系统

软件方面,AutoX在2016年成立早期,由我个人带头写了第一版本代码,自主研发了自己独立的进程通讯系统(被一些同行称之为“无人驾驶的操作系统”)BinaryFlow,实现了共享内存的高效率沟通,确保进程间的稳定和实时通讯,大大降低了计算资源的要求。

为了内部开发调试,我们的工程师有强大的软件工程能力,设计了大量的二维的和三维的可视化工具,还有自己的数据整理工具。

为了实现大规模自动驾驶部署,我们也设计了自己的软件部署工具,车队管理系统,远程实施监控系统和应急遥控系统,发明了基于UDP改进的特殊视频传送协议,确保实时视频的传送。

为了安全,我们也设计了我们的多冗余AEB系统,同时通过超声波雷达和低线数激光雷达等主动传感器,在嵌入式底层提供最后一道防线的保护。

我们希望通过软硬件的高度结合,能尽量保证无人驾驶的高安全性、高性能及高性价比。对于创业公司而言,这样的模式更适合,见效也更快。

△ AutoX自主研发的VCU和嵌入式冗余系统

以上就是AutoX为实现量产化的无人驾驶而做的部分技术储备。

无论是感知、地图、仿真器,还是软硬一体的开发模式,我们本着以产品为导向的技术研发,因为只有这样才能更快实现量产,让更多人享受到无人驾驶的乐趣与便利。

抛砖引玉,也渴望与同行进行技术上的切磋,共同进步,一起为人类交通安全尽自己的一份力。

作者系网易新闻·网易号“各有态度”签约作者

— 完 —

活动报名

诚挚招聘

量子位正在招募编辑/记者,工作地点在北京中关村。期待有才气、有热情的同学加入我们!相关细节,请在量子位公众号(QbitAI)对话界面,回复“招聘”两个字。

量子位 QbitAI · 头条号签约作者

վ'ᴗ' ի 追踪AI技术和产品新动态