车道线定位及拟合:直方图确定车道线位置

日萌社

日萌社

人工智能AI:Keras PyTorch MXNet TensorFlow PaddlePaddle 深度学习实战(不定时更新)

CNN:RCNN、SPPNet、Fast RCNN、Faster RCNN、YOLO V1 V2 V3、SSD、FCN、SegNet、U-Net、DeepLab V1 V2 V3、Mask RCNN

车道线检测

相机校正、张氏标定法、极大似然估计/极大似然参数估计、牛顿法、高斯牛顿法、LM算法、sin/cos/tan/cot

相机校正和图像校正:图像去畸变

车道线提取:Sobel边缘提取算法

透视变换

车道线定位及拟合:直方图确定车道线位置

车道曲率和中心点偏离距离计算

在视频中检测车道线

5.4. 车道线定位及拟合

学习目标

- 了解直方图确定车道线位置的思想

我们根据前面检测出的车道线信息,利用直方图和滑动窗口的方法,精确定位车道线,并进行拟合。

1. 定位思想

下图是我们检测到的车道线结果:

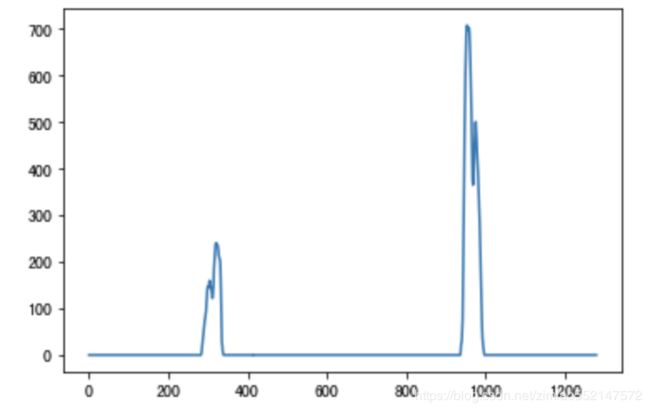

沿x轴方向统计每一列中白色像素点的个数,横坐标是图像的列数,纵坐标表示每列中白色点的数量,那么这幅图就是“直方图”,如下图所示:

对比上述两图,可以发现直方图左半边最大值对应的列数,即为左车道线所在的位置,直方图右半边最大值对应的列数,是右车道线所在的位置。

确定左右车道线的大致位置后,使用”滑动窗口“的方法,在图中对左右车道线的点进行搜索。

滑动窗口的搜索过程:

-

设置搜索窗口大小(width和height):一般情况下width为手工设定,height为图片大小除以设置搜索窗口数目计算得到。

-

以搜寻起始点作为当前搜索的基点,并以当前基点为中心,做一个网格化搜索。

-

对每个搜索窗口分别做水平和垂直方向直方图统计,统计在搜索框区域内非零像素个数,并过滤掉非零像素数目小于50的框。

-

计算非零像素坐标的均值作为当前搜索框的中心,并对这些中心点做一个二阶的多项式拟合,得到当前搜寻对应的车道线曲线参数。

2.实现

使用直方图和滑动窗口检测车道线的代码如下:

def cal_line_param(binary_warped):

# 1.确定左右车道线的位置

# 统计直方图

histogram = np.sum(binary_warped[:, :], axis=0)

# 在统计结果中找到左右最大的点的位置,作为左右车道检测的开始点

# 将统计结果一分为二,划分为左右两个部分,分别定位峰值位置,即为两条车道的搜索位置

midpoint = np.int(histogram.shape[0] / 2)

leftx_base = np.argmax(histogram[:midpoint])

rightx_base = np.argmax(histogram[midpoint:]) + midpoint

# 2.滑动窗口检测车道线

# 设置滑动窗口的数量,计算每一个窗口的高度

nwindows = 9

window_height = np.int(binary_warped.shape[0] / nwindows)

# 获取图像中不为0的点

nonzero = binary_warped.nonzero()

nonzeroy = np.array(nonzero[0])

nonzerox = np.array(nonzero[1])

# 车道检测的当前位置

leftx_current = leftx_base

rightx_current = rightx_base

# 设置x的检测范围,滑动窗口的宽度的一半,手动指定

margin = 100

# 设置最小像素点,阈值用于统计滑动窗口区域内的非零像素个数,小于50的窗口不对x的中心值进行更新

minpix = 50

# 用来记录搜索窗口中非零点在nonzeroy和nonzerox中的索引

left_lane_inds = []

right_lane_inds = []

# 遍历该副图像中的每一个窗口

for window in range(nwindows):

# 设置窗口的y的检测范围,因为图像是(行列),shape[0]表示y方向的结果,上面是0

win_y_low = binary_warped.shape[0] - (window + 1) * window_height

win_y_high = binary_warped.shape[0] - window * window_height

# 左车道x的范围

win_xleft_low = leftx_current - margin

win_xleft_high = leftx_current + margin

# 右车道x的范围

win_xright_low = rightx_current - margin

win_xright_high = rightx_current + margin

# 确定非零点的位置x,y是否在搜索窗口中,将在搜索窗口内的x,y的索引存入left_lane_inds和right_lane_inds中

good_left_inds = ((nonzeroy >= win_y_low) & (nonzeroy < win_y_high) &

(nonzerox >= win_xleft_low) & (nonzerox < win_xleft_high)).nonzero()[0]

good_right_inds = ((nonzeroy >= win_y_low) & (nonzeroy < win_y_high) &

(nonzerox >= win_xright_low) & (nonzerox < win_xright_high)).nonzero()[0]

left_lane_inds.append(good_left_inds)

right_lane_inds.append(good_right_inds)

# 如果获取的点的个数大于最小个数,则利用其更新滑动窗口在x轴的位置

if len(good_left_inds) > minpix:

leftx_current = np.int(np.mean(nonzerox[good_left_inds]))

if len(good_right_inds) > minpix:

rightx_current = np.int(np.mean(nonzerox[good_right_inds]))

# 将检测出的左右车道点转换为array

left_lane_inds = np.concatenate(left_lane_inds)

right_lane_inds = np.concatenate(right_lane_inds)

# 获取检测出的左右车道点在图像中的位置

leftx = nonzerox[left_lane_inds]

lefty = nonzeroy[left_lane_inds]

rightx = nonzerox[right_lane_inds]

righty = nonzeroy[right_lane_inds]

# 3.用曲线拟合检测出的点,二次多项式拟合,返回的结果是系数

left_fit = np.polyfit(lefty, leftx, 2)

right_fit = np.polyfit(righty, rightx, 2)

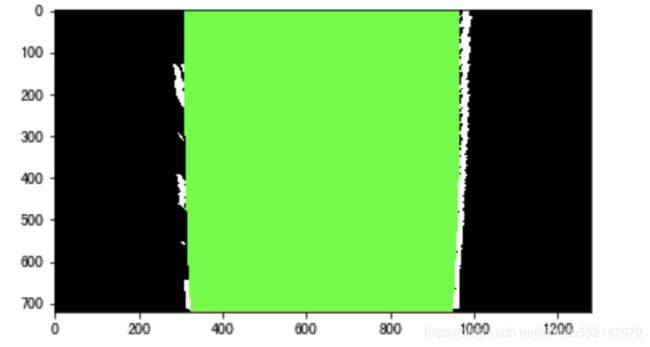

return left_fit, right_fit车道线的检测的拟合结果如下图所示:

其中绿色的方框是滑动窗口的结果,中间的黄线是车道线拟合的结果。

下面我们将车道区域绘制处理,即在检测出的车道线中间绘制多边形,代码如下:

def fill_lane_poly(img, left_fit, right_fit):

# 获取图像的行数

y_max = img.shape[0]

# 设置输出图像的大小,并将白色位置设为255

out_img = np.dstack((img, img, img)) * 255

# 在拟合曲线中获取左右车道线的像素位置

left_points = [[left_fit[0] * y ** 2 + left_fit[1] * y + left_fit[2], y] for y in range(y_max)]

right_points = [[right_fit[0] * y ** 2 + right_fit[1] * y + right_fit[2], y] for y in range(y_max - 1, -1, -1)]

# 将左右车道的像素点进行合并

line_points = np.vstack((left_points, right_points))

# 根据左右车道线的像素位置绘制多边形

cv2.fillPoly(out_img, np.int_([line_points]), (0, 255, 0))

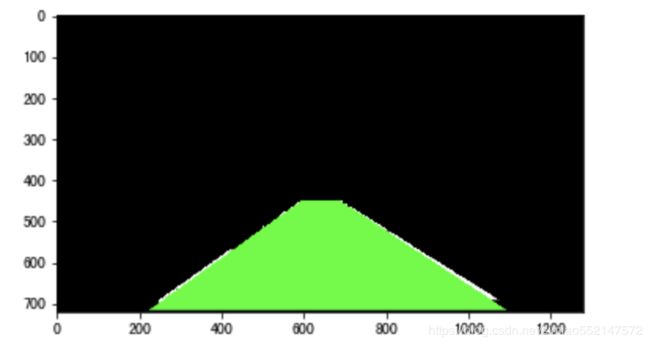

return out_img效果如下图所示:

其中两个方法给大家介绍下:

np.vstack:按垂直方向(行顺序)堆叠数组构成一个新的数组

np.dstack:按水平方向(列顺序)堆叠数组构成一个新的数组

示例如下:

将检测出的车道逆投影到原始图像,直接调用透视变换的方法即可:

transform_img_inverse = img_perspect_transform(result, M_inverse)

效果如下图所示:

最后将其叠加在原图像上,则有:

总结:

知道车道线精确定位的思想:

首先利用直方图的方法确定左右车道线的位置,然后利用滑动窗口的方法,搜索车道线位置,并进行拟合,然后绘制车道区域,并进行反投影,得到原始图像中的车道区域。