机器学习之简单实战-共享单车

注:本篇文章旨在对机器学习处理流程进行梳理,不代表结果如何,只为熟悉实战中处理流程以及对各种概念理解,不过接下来的实例,会对此实例问题进行修正

此实例存在问题:

1)normalize是标准化,另外你这里分别对训练和测试数据标准化是有问题的。分别处理会导致数据分布变得不一样。

2)数据特征工程做的少,类别型特征没有处理。

3)模型跑出来之后,完全没有结果的解析

1.项目名称:

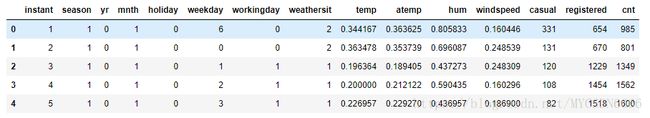

某自行车数据探索该数据集共731个数据点,涵盖14种特征和房价信息。本项目将原始数据集存为csv格式,

方便调用pandas做数据分析。

2.导入必要的工具包

import numpy as np # 用来存储和处理大型矩阵;NumPy和稀疏矩阵运算包SciPy配合使用更加方便

import pandas as pd # 数据处理,CSV文件输入输出

import matplotlib.pyplot as plt #数据可视化工具

import seaborn as sns #基于Matplotlib的Python可视化工具包,提供更高层次的用户接口,可以给

#出漂亮的数据统计图

color = sns.color_palette()#返回一个颜色定义颜色调色板

#将matplotlib的图表直接嵌入到Notebook之中,或者使用指定的界面库显示图表,

#它有一个参数指定matplotlib图表的显示方式

%matplotlib inline 3.读取数据

# 数据集的文件路径

data = pd.read_csv("day.csv")#读取数据文件存储到data中

data.head() #显示数据集的前5行4.数据基本信息

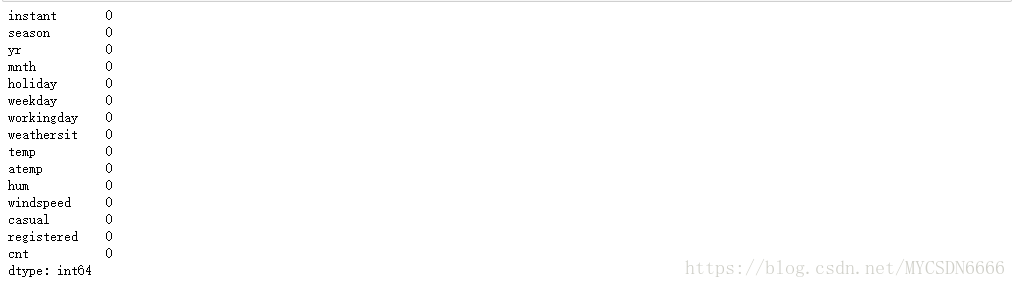

data.info()#各属性的统计特性;数据集731;共15列(仅展示数值型数据);无空值 ### 查看是否有空值

data.isnull().sum() 查看数据各特征的分布,以及特征之间是否存在相关关系等冗余。

在Python中,有很多数据可视化途径。

Matplotlib非常强大,也很复杂,不易于学习。

Seaborn是在matplotlib的基础上进行了更高级的API封装,从而使得作图更加容易,

大多数情况下使用seaborn就能做出很具有吸引力的图,而使用matplotlib就能制作具有更多特色的图。

## 各属性的统计特性;

# 观测数据,初步估测个特征分布:

# 1:searn--mean值在25%-59%分位数之间;特征方差均较小;

# 2:casual registered cnt为需要预测的y值(本实例只考虑cnt);

# 3.大部分特征均值在1/4-1/2分位数之间噪声值较少基本不存在;少数在1/2-3/4分位数之间噪声值存在;

data.describe()

此处得到各属性的样本数目、均值、标准差、最小值、1/4分位数(25%)、中位数(50%)、3/4分位数(75%)、最大值 可初步了解各特征的分布

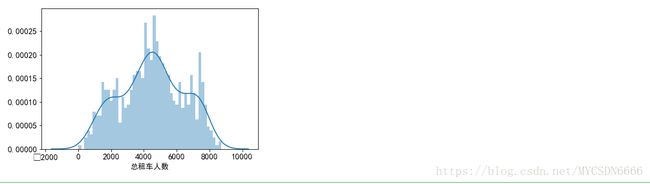

5.1单变量分布分析

# 目标y(总租车人数cnt)的直方图/分布

# 解决中文乱码;

plt.rc('font', family='SimHei', size=13)

# 创建一个新图形

fig = plt.figure()

# 灵活的单变量分布的曲线图

# data.cnt.values:观察数据。如果这一系列目标的属性的名称,该名称将用于标签的数据;

# bins:直方图中箱子个数

# kda:是否为高斯核密度估计

sns.distplot(data.cnt.values, bins=50, kde=True)

# 设置当前轴的x轴标签

plt.xlabel('总租车人数', fontsize=12)

# 展示生成的图形

plt.show()

# 观测一下数据还算符合正态分布# 单个特征散点图

# 散点图中的x与y不同大小和/或颜色标记

# 1.range(data.shape[0]):数据位置

# 2.data["cnt"].values:

plt.scatter(range(data.shape[0]), data["cnt"].values,color='purple')

# 解决中文乱码;

plt.rc('font', family='SimHei', size=13)

plt.title("租车总数");#直方图 不连续

fig = plt.figure()

#工作日

sns.countplot(data.workingday.values, order=[0, 1]);

#解决中文乱码;

plt.rc('font', family='SimHei', size=13)

plt.xlabel('工作日');

plt.ylabel('出现次数');#直方图 连续

fig = plt.figure()

#风速

sns.distplot(data.windspeed.values, bins=30, kde=False)

#解决中文乱码;

plt.rc('font', family='SimHei', size=13)

plt.xlabel('风速', fontsize=12)

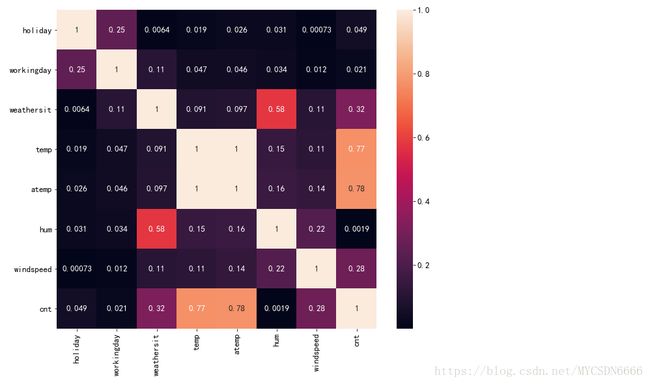

plt.show()5.2两两特征之间的相关性

#获得所有需要的列值

cols=data.columns

#cols=data[["holiday","workingday","weathersit","temp","atemp","hum","windspeed","cnt"]]

#data=data[["holiday","workingday","weathersit","temp","atemp","hum","windspeed","cnt"]]

# Calculates pearson co-efficient for all combinations,通常认为相关系数大于0.5的为强相关

data_corr = data.corr().abs()

#独热图

plt.subplots(figsize=(11, 9))

sns.heatmap(data_corr,annot=True)

# Mask unimportant features

sns.heatmap(data_corr, mask=data_corr < 2, cbar=False)

plt.savefig('day_coor.png' )

plt.show()#设置阈值只选择高度相关的属性

threshold = 0.5

# 成对与以上阈值相关的列表

corr_list = []

#size = data.shape[1]

size = data_corr.shape[0]

#搜索高相关对

for i in range(0, size): #特性的数量

for j in range(i+1,size): #避免重复

if (data_corr.iloc[i,j] >= threshold and data_corr.iloc[i,j] < 1) or (data_corr.iloc[i,j] < 0 and data_corr.iloc[i,j] <= -threshold):

corr_list.append([data_corr.iloc[i,j],i,j]) #存储相关性和列索引

#首先显示高级的

s_corr_list = sorted(corr_list,key=lambda x: -abs(x[0]))

#打印相关性和列名

for v,i,j in s_corr_list:

print ("%s and %s = %.2f" % (cols[i],cols[j],v))分析(图与代码只是辅助,最重要的是进行分析数据):temp 和atemp相关度为1,则选择任意以特征,

达到 降维,本例留下temp特征

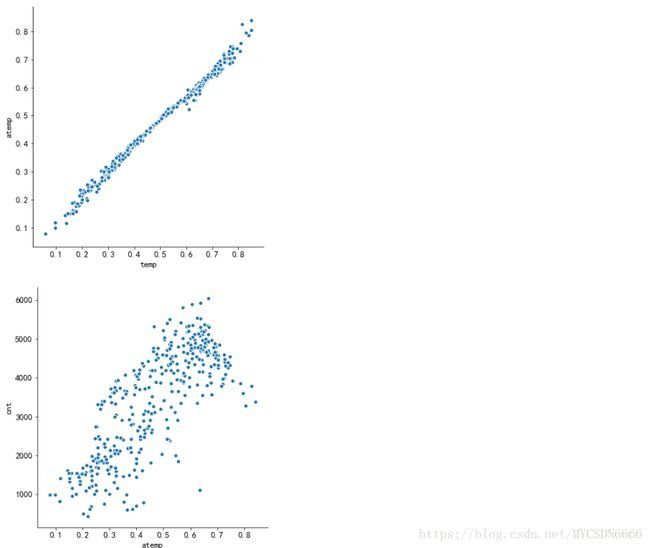

# 仅高相关对的散射图

for v,i,j in s_corr_list:

sns.pairplot(data, size=6, x_vars=cols[i],y_vars=cols[j] )

plt.show()

# temp and atemp,天气温度和人体感温直接关系

# atemp and cnt人体感温与租车数相关很大,温度合适租车会比较多,同理天气温度也是如此

# weathersit and hum 天气情况会直接影响适度,因此关联度较高6.分割数据集

##### #将数据分割训练数据与测试数据

from sklearn.model_selection import train_test_split

# # 随机采样20%的数据构建测试样本,其余作为训练样本

# X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=0, test_size=0.20)

# X_train.shape

# print(X_train)

#训练集,本例人为指定

X_train=X

X_train.shape

y_train=y

columns =X_train.columns

# print(X_test)

X_test = X_test

X_test.shape

y_test = y_test

# print(X_test)

# X_test=data1.drop(0)

columns =X_test.columns7.数据预处理/特征工程

特征工程是实际任务中特别重要的环节

注:**(根据不同使用场景,使用不同的特征工程,本实例用了两种,

但是并不一定合适,大家可自行学习特征工程种类以及使用方法)**。

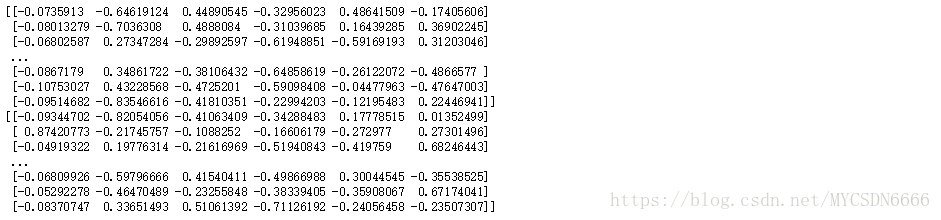

# 数据标准化

#标准化的目的在于避免原始特征值差异过大,导致训练得到的参数权重不归一,无法比较各特征的重要性

from sklearn.preprocessing import StandardScaler

# 分别初始化对特征和目标值的标准化器

ss_X = StandardScaler()

ss_y = StandardScaler()

# 分别对训练和测试数据的特征以及目标值进行标准化处理

X_train = ss_X.fit_transform(X_train)

# print(X_test)

X_test = ss_X.transform(X_test)

#对y做标准化不是必须

#对y标准化的好处是不同问题的w差异不太大,同时正则参数的范围也有限

y_train = ss_y.fit_transform(y_train.reshape(-1, 1))

y_test = ss_y.transform(y_test.reshape(-1, 1))

# print(y_train)# 数据归一化:

from sklearn import preprocessing

X_train = preprocessing.normalize(X_train, norm='l2')

print(X_train)

X_test = preprocessing.normalize(X_test, norm='l2')

print(X_test)

8.定模型类型

8.1缺省参数的线性回归

# 线性回归

#class sklearn.linear_model.LinearRegression(fit_intercept=True, normalize=False, copy_X=True, n_jobs=1)

from sklearn.linear_model import LinearRegression

# 使用默认配置初始化

lr = LinearRegression()

# 训练模型参数

lr.fit(X_train, y_train)

# 预测

y_test_pred_lr = lr.predict(X_test)

y_train_pred_lr = lr.predict(X_train)

# 看看各特征的权重系数,系数的绝对值大小可视为该特征的重要性

fs = pd.DataFrame({"columns":list(columns), "coef":list((lr.coef_.T))})

fs.sort_values(by=['coef'],ascending=False)

# temp windspeed weathersit 相关度很高# 使用r2_score评价模型在测试集和训练集上的性能,并输出评估结果

#测试集

print ('线性回归的R2测试-test得分 ', r2_score(y_test, y_test_pred_lr))

#训练集

print ('线性回归的R2测试-train得分 ', r2_score(y_train, y_train_pred_lr))

# test是负数表明选取特征不合适,不能很好代表实际特征#在训练集上观察预测残差的分布,看是否符合模型假设:噪声为0均值的高斯噪声

f, ax = plt.subplots(figsize=(7, 5))

f.tight_layout()

ax.hist(y_train - y_train_pred_lr,bins=40, label='Residuals Linear', color='b', alpha=.5);

ax.set_title("Capital Bikeshare of Residuals")

ax.legend(loc='best');#还可以观察预测值与真值的散点图

plt.figure(figsize=(4, 3))

plt.scatter(y_train, y_train_pred_lr)

plt.plot([-3, 3], [-3, 3], '--k') #数据已经标准化,3倍标准差即可

plt.axis('tight')

plt.xlabel('True ')

plt.ylabel('Predicted ')

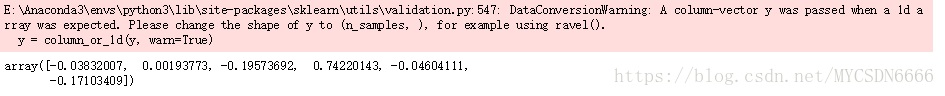

plt.tight_layout()# 线性模型,随机梯度下降优化模型参数

# 随机梯度下降一般在大数据集上应用,其实本项目不适合用

from sklearn.linear_model import SGDRegressor

# 使用默认配置初始化线

sgdr = SGDRegressor(max_iter=1000)

# 训练:参数估计

sgdr.fit(X_train, y_train)

# 预测

#sgdr_y_predict = sgdr.predict(X_test)

sgdr.coef_# 使用SGDRegressor模型自带的评估模块(评价准则为r2_score),并输出评估结果

print ('对sgdregressor默认的测量测试的test价值 ',sgdr.score(X_test, y_test))

print ('对sgdregressor默认的测量测试的train价值 ', sgdr.score(X_train, y_train))

# 同样为负数#岭回归/L2正则

#class sklearn.linear_model.RidgeCV(alphas=(0.1, 1.0, 10.0), fit_intercept=True,

# normalize=False, scoring=None, cv=None, gcv_mode=None,

# store_cv_values=False)

from sklearn.linear_model import RidgeCV

#设置超参数(正则参数)范围

alphas = [ 0.01, 0.1, 1, 10,100]

#n_alphas = 20

#alphas = np.logspace(-5,2,n_alphas)

#生成一个RidgeCV实例

ridge = RidgeCV(alphas=alphas, store_cv_values=True)

#模型训练

ridge.fit(X_train, y_train)

#预测

y_test_pred_ridge = ridge.predict(X_test)

y_train_pred_ridge = ridge.predict(X_train)

# 评估,使用r2_score评价模型在测试集和训练集上的性能

print ('对ridgecv测试R2-test评分', r2_score(y_test, y_test_pred_ridge))

print ('对ridgecv测试R2-test评分', r2_score(y_train, y_train_pred_ridge))

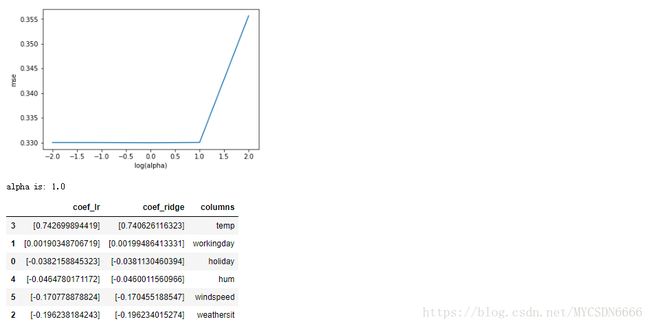

# 同样为负数mse_mean = np.mean(ridge.cv_values_, axis = 0)

plt.plot(np.log10(alphas), mse_mean.reshape(len(alphas),1))

#这是为了标出最佳参数的位置,不是必须

#plt.plot(np.log10(ridge.alpha_)*np.ones(3), [0.28, 0.29, 0.30])

plt.xlabel('log(alpha)')

plt.ylabel('mse')

plt.show()

print ('alpha is:', ridge.alpha_)

# 看看各特征的权重系数,系数的绝对值大小可视为该特征的重要性

fs = pd.DataFrame({"columns":list(columns), "coef_lr":list((lr.coef_.T)), "coef_ridge":list((ridge.coef_.T))})

fs.sort_values(by=['coef_lr'],ascending=False)

# 超参数alpha为1时最合适#### Lasso/L1正则

# class sklearn.linear_model.LassoCV(eps=0.001, n_alphas=100, alphas=None, fit_intercept=True,

# normalize=False, precompute=’auto’, max_iter=1000,

# tol=0.0001, copy_X=True, cv=None, verbose=False, n_jobs=1,

# positive=False, random_state=None, selection=’cyclic’)

from sklearn.linear_model import LassoCV

#设置超参数搜索范围

#alphas = [ 0.01, 0.1, 1, 10,100]

#生成一个LassoCV实例

#lasso = LassoCV(alphas=alphas)

lasso = LassoCV()

#训练(内含CV)

lasso.fit(X_train, y_train)

#测试

y_test_pred_lasso = lasso.predict(X_test)

y_train_pred_lasso = lasso.predict(X_train)

# 评估,使用r2_score评价模型在测试集和训练集上的性能

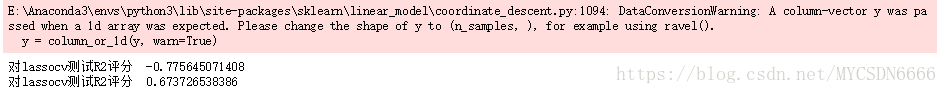

print ('对lassocv测试R2评分 ',r2_score(y_test, y_test_pred_lasso))

print ('对lassocv测试R2评分 ', r2_score(y_train, y_train_pred_lasso))

# 同样为负数mses = np.mean(lasso.mse_path_, axis = 1)

plt.plot(np.log10(lasso.alphas_), mses)

#plt.plot(np.log10(lasso.alphas_)*np.ones(3), [0.3, 0.4, 1.0])

plt.xlabel('log(alpha)')

plt.ylabel('mse')

plt.show()

print ('alpha is:', lasso.alpha_)

# 看看各特征的权重系数,系数的绝对值大小可视为该特征的重要性

fs = pd.DataFrame({"columns":list(columns), "coef_lr":list((lr.coef_.T)), "coef_ridge":list((ridge.coef_.T)), "coef_lasso":list((lasso.coef_.T))})

fs.sort_values(by=['coef_lr'],ascending=False)mses = np.mean(lasso.mse_path_, axis = 1)

plt.plot(np.log10(lasso.alphas_), mses)

#plt.plot(np.log10(lasso.alphas_)*np.ones(3), [0.3, 0.4, 1.0])

plt.xlabel('log(alpha)')

plt.ylabel('mse')

plt.show()

print ('alpha =:', lasso.alpha_)