深度神经网络总结

通用分类:LeNet,AlexNet,ZFNet,VGG,GoogleNet,ResNet,SENet

通用目标检测:SPP,Overfeat,Faster R-CNN,FPN,Yolo-v1/2/3,SSD,RetinaNet

通用语义分割:FCN,U-Net,SegNet

多功能:Mask RCNN

需要精通的应用网络:MTCNN,FaceNet,HopeNet,FCHD,Inception-ResNet-v2,Faster R-CNN

生成对抗网络:TP-GAN

分类的难点:照明,变形,遮挡,杂乱混乱,旋转,类内差异大/类间差异小,数据不均衡,

目标检测的难点:小目标,目标重叠,物体部分遮挡,旋转,不是前景,猫狗相似度高问题,

语义分割的难点:

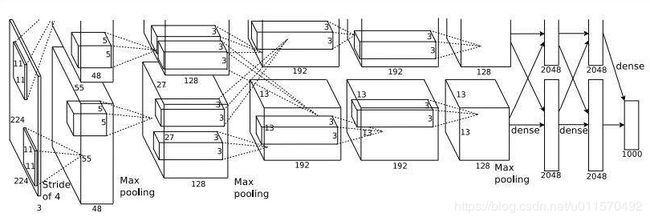

AlexNet

网络结构:深度卷积网络CNN雏形,拥有完整的卷积、池化和全连接层。

改进:使用了ReLu函数、dropout机制和LRN。

思想启发:Dropout仿生。

ZFNet

网络结构:和AlexNet结构差不多,改变了第一层卷积滤波大小从11*11变为7*7步长从4变为2,引入了可视化

改进:引入了可视化,使用了反卷积和反池化实现了近似对每一层的可视化,并采用了GPU进行训练。

实验结论:对于图像的平移、尺度、旋转的变化来说,底层特征图影响大,高层特征图影响小。

思想启发:通过遮挡不同部位看可视化图和最后分类结果了解网络的关注点是否正确。

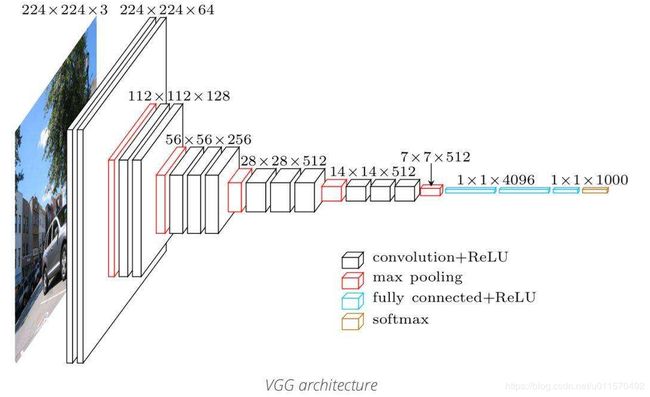

VGG

网络结构:16层或19层,没有LRN和1*1卷积NIN,5层卷积池化,3层全连接,最后softmax。

改进:网络结构做得更深以提高性能;舍弃LRN。

思想启发:更深的网络。

GoogleNet

网络结构:底层使用传统卷积池化,中间层使用Inception块,v1有22层,v3有47层,去掉全连接层,使用全局均值池化接在分类前,增加了两个loss保证梯度回传不消失,有三个softmax输出,最深一层softmax前接FC方便做Fine-tune迁移学习。

改进:更深更宽,v1使用Inception模块,增加网络对尺度的适应性;使用全局均值池化替换全连接层来减少网络参数量。v2使用了BN层减少Internal Covariate Shift;两个3*3替换一个5*5减少参数量;卷积分解1*n和n*1替换n*n卷积核。v3使用了卷积分解,并应用到了v2版本上。v4结合resnet。

思想启发:通过改造堆叠结构提升拟合能力。

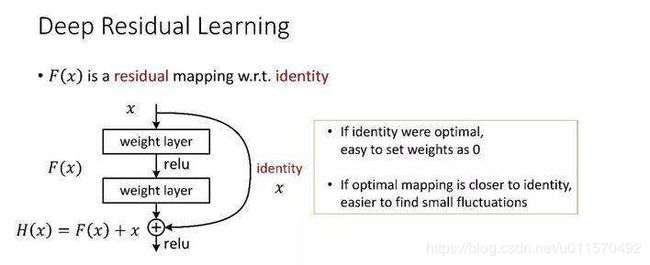

ResNet

网络结构:101层/152层,Residual block构成,最后平均池化和全连接层。

改进:利用了short-cut/skip-connection解决网络深度太大导致梯度弥散问题。

思想启发:从网络结构本身解决梯度消失问题。

Inception-v4和Inception-ResNet-v1/v2

网络结构:Inception-v4(steam-4*IncptionA-ReductionA-7*InceptionB-ReductionB-3*InceptionC-Average Pooling-Dropout-softmax);Inception-ResNet-v1/v2(steam-5*IRA-ReductionA-10*IRB-ReductionB-5*IRC-Average Pooling-Dropout-softmax)

改进:inception block+residual block。

思想启发:新技术就是多种技术的结合。

SPP

网络结构:conv--spactial pyramid pooling--fc。

改进:解决输入图像大小固定的问题。

思想启发:把金字塔多尺寸适应性从输入层放到卷积特征层来做;对特征图进行大小均分可以解决输入图像大小不固定问题。

缺点:无法进行卷积层的fine-tune,原因是spp层图像合并梯度无法正常传递。

Overfeat

网络结构:conv--pooling。

改进:同时用一个CNN网络解决分类,定位和检测问题,用CNN解决定位检测问题的雏形。解决输入图像大小固定的问题;多尺度滑窗,测试时输入不同尺度大小的图片进行预测,最后取平均;累积预测回归框替代nms。

思想启发:全卷积+池化可以解决输入图像大小不固定问题。

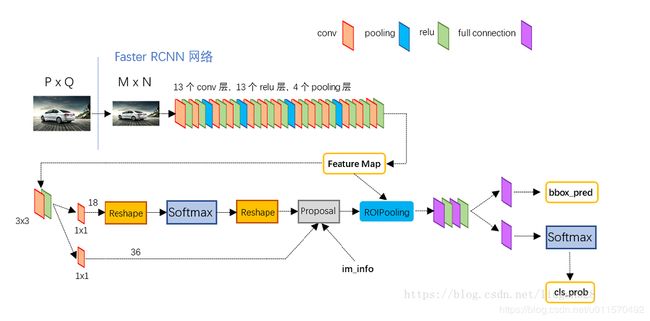

Faster R-CNN

网络结构:conv--RPN--softmax,conv--ROI pooling--fc--softmax。

损失函数:交叉熵分类损失+smoothL1回归损失

改进:two stage,SS改成RPN,引入了ROI pooling层,提高了检测效率和精度。

思想启发:候选框从原图移到特征图去做。

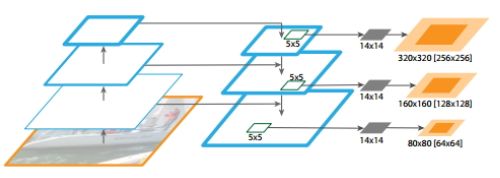

FPN

网络结构:不同的conv层后feature map上进行上行采样然后相加最后分别预测,bottom-up+top-down。

改进:结合不同大小尺寸的特征图,提高小目标检测能力。具有很好的通用性,可以用在各种目标检测和语义分割的模型上,如Faster R-CNN+FPN。

思想启发:特征金字塔,架构灵活。

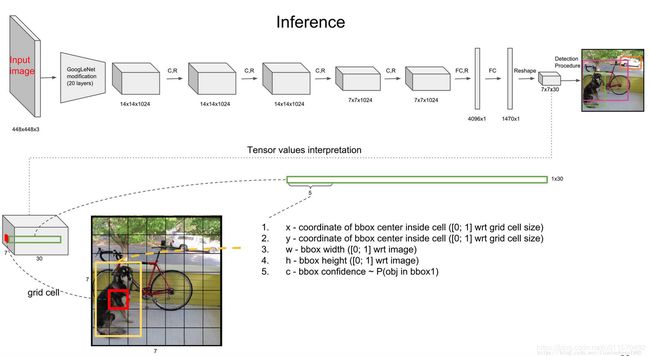

Yolo

网络结构:darknet--conv--fc

改进:one stage,提高了检测速度。v3版本使用sigmoid函数替代softmax函数做多标签分类,借鉴FPN使用了多尺度预测,更换了backbone网络架构(darknet19-->darknet53)

思想启发:不做窗口滑动,把图片分割成互不重合的小方块,然后给出每个小方块的各类置信度。

SSD

网络结构:vgg16--conv--gap--nms

损失函数:交叉熵分类损失函数(正类+背景负类)+SmoothL1定位损失函数

改进:速度比Faster RCNN快,精度比YOLO高,end-to-end训练方式,难例挖掘,比例1:3。

思想启发:每个特征单元使用对应的default box,借鉴了Faster RCNN,也达到end-to-end的效果。

缺点:小目标检测能力不足,需要输入固定大小图片。

RetinaNet

网络结构:ResNet101+FPN+focal loss

改进:克服目标检测正负样本不均衡问题。

思想启发:指出问题比解决问题意义更大,洞察到one-stage准确率不高的根源在类别不平衡。

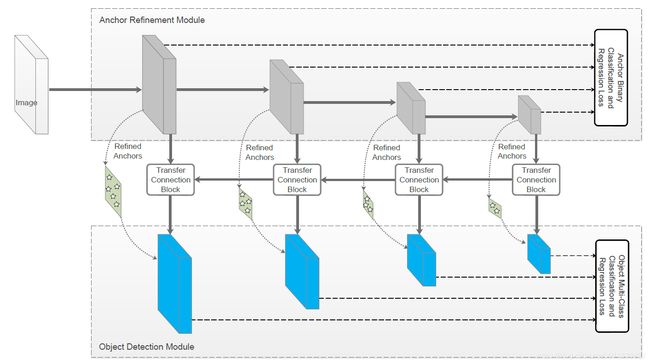

RefineDet

网络结构:ARM--TCB--ODM

改进:基于SSD的改进,把one-stage和two-stage两个有点结合起来达到精度和速度都很好。

思想启发:技术的结合。

M2Det

网络结构:MLFPN(特征融合模块FFM,细化U型模块TUM,尺度特征聚合模块SFAM)。

改进:结合SSD,提出多级特征金字塔模型。

思想启发:多级特征金字塔模型感觉是多级中的多级。

FCN

网络结构:conv+deconv

改进:利用反卷积实现语义分割,语义分割雏形。

思想启发:反卷积的使用。

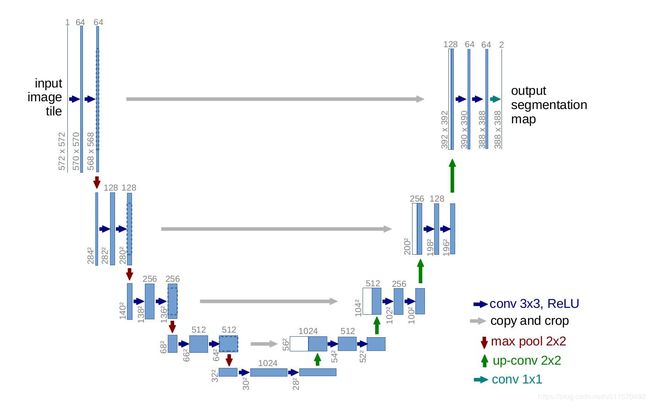

U-Net

网络结构:U型结构

改进:把扩展路径完善了许多,多通道卷积类似于FPN,利用少量数据集做扩充为医学图像分割做出很大贡献。

思想启发:网络的改善有助于减少对数据的需求量

segNet

网络结构:encoder--decoder

改进:致力解决上采样中回复信息不足问题,借鉴pooling indces比DeconvNet快,因为没有FC层,加快了速度。

思想启发:concat与add的区别,

Mask RCNN

网络结构:conv--RPN,conv--ROI pooling--fc

改进:结合FCN和faster R-CNN,使其同时具有物体检测和语义分割功能。

思想启发:技术组合,模型组合,功能组合,利用浮点数和双性插值解决池化和ROI pooling时的位置精度丢失,达到语义分割精确像素分类。

MTCNN

网络结构:三个网络级联(P-NET+R-NET+O-NET),P-Net是proposal网络,浅层网络快速筛选,通过FCN进行特征提取和边框标定,然后NMS合并过滤大部分的窗口;R-Net具有全连接层,比P-Net效果好去滤除效果差的候选框;O-Net网络使用更复杂的网络选出更好的候选框,并做关键点检测。

损失函数:交叉熵分类损失函数+欧氏距离定位损失函数

改进:兼顾性能和准确率,通过级联的方式,使用PRelu,保留更多的拟合能力。

思想启发:多功能模型组合思想

可调参数:最小检测大小,三个网络置信度阈值,IOU合并比例

FaceNet

网络结构:stream--10个blockA--reductionA--20个blockB--reudcutionB--9个blockC--AP--Dropout--FC--欧式向量Embedding--triple loss

损失函数:triple Loss,center Loss

改进:引入归一化特征向量,triple loss

思想启发:通过欧式距离判断是否为陌生人,而不是直接分类

可调参数:引入不同结构网络,embedding维度大小

HopeNet

网络结构:resnet50+3fc+3softmax+CEloss+MSEloss

改进:一体化网络,不依赖关键点精度或图像清晰度,也不做昂贵的深度数据重建3DMM模型

思想启发:利用大数据的力量

FCHD

网络结构:vgg16+rpn

改进:检测人体目标改为检测头部,减少拥挤重叠的遮挡问题

思想启发:头部的特征比人脸更一致;网络可以改善,出现的头部框比较多

可调参数:检测大小

TP-GAN

网络结构:G(local_pathway+global_pathway,generator(conv)+decoder(deconv)),D(),损失函数(对称性损失+像素偏差+对抗损失+身份保留损失)

改进:利用正脸生成侧脸,损失函数加入对称性损失

思想启发:特征融合