论文中提到的池化方法的总结

下面是论文中遇到的池化方法的总结

池化层是卷积神经网络中比较重要的一个层,他主要是为了降低与卷积层之间连接数所带来的计算负担。

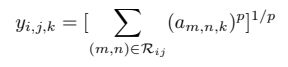

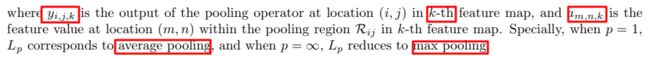

1、Lp Pooling

它是以复杂细胞为模型的生物启发的池化过程。这个主要来源于论文[1],并且通过实验证明他的效果比max pooling效果好。

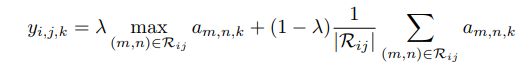

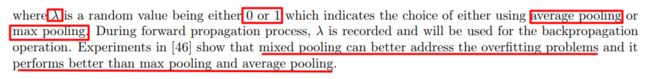

2、Mixed pooling(混合池化)

来源于论文[2],主要是结合了max pooling 和average pooling。

3、Stochastic pooling(随机池化)

论文来源于[3]。

4、Spectral pooling(光谱池化)

论文来源于[4]。

5、空间金字塔池化

主要来源于[5]。

6、Multi-scale Orderless Pooling(多尺度无序池化)

论文来源于[6]。

参考文献:

[1]A. Hyv¨arinen, U. K¨oster, Complex cell pooling and the statistics of natural images, Network: Computation in Neural Systems 18 (2) (2007) 81–100.

[2]D. Yu, H. Wang, P. Chen, Z. Wei, Mixed pooling for convolutional neural networks, in: Proceedings of the Rough Sets and Knowledge Technology (RSKT), 2014, pp. 364–375.

[3]M. D. Zeiler, R. Fergus, Stochastic pooling for regularization of deep convolutional neural networks, in: Proceedings of the International Conference on Learning Representations (ICLR), 2013.

[4]O. Rippel, J. Snoek, R. P. Adams, Spectral representations for convolutional neural networks, in: Proceedings of the Advances in Neural Information Processing Systems (NIPS), 2015, pp. 2449–2457.

[5]K. He, X. Zhang, S. Ren, J. Sun, Spatial pyramid pooling in deep convolutional networks for visual recognition, IEEE Transactions on Pattern Analysis and Machine Intelligence (PAMI) 37 (9) (2015) 1904–1916.

[6]Y. Gong, L. Wang, R. Guo, S. Lazebnik, Multi-scale orderless pooling of deep convolutional activation features, in: Proceedings of the European Conference on Computer Vision (ECCV), 2014, pp. 392–407.