Java网络爬虫之Webmagic快速入门

Webmagic简介

WebMagic是一个简单灵活的Java爬虫框架。基于WebMagic,你可以快速开发出一个高效、易维护的爬虫。

以上是webmagic的官方简介,webmagic是一个用于开发网络爬虫的Java框架,底层是httpclient和jsoup,相比httpclient和jsoup开发,webmagic具有以下优点:

- 简单的API,可快速上手

- 模块化的结构,可轻松扩展

- 提供多线程和分布式支持

Webmagic官网:http://webmagic.io/

Webmagic官方文档:http://webmagic.io/docs/zh/

Webmagic架构

WebMagic的结构分为Downloader、PageProcessor、Scheduler、Pipeline四大组件,并由Spider将它们彼此组织起来。这四大组件对应爬虫生命周期中的下载、处理、管理和持久化等功能。WebMagic的设计参考了Scapy,但是实现方式更Java化一些。

而Spider则将这几个组件组织起来,让它们可以互相交互,流程化的执行,可以认为Spider是一个大的容器,它也是WebMagic逻辑的核心。

WebMagic总体架构图如下:

![]()

1.Downloader

Downloader负责从互联网上下载页面,以便后续处理。WebMagic默认使用了Apache HttpClient作为下载工具。

2.PageProcessor

PageProcessor负责解析页面,抽取有用信息,以及发现新的链接。WebMagic使用Jsoup作为HTML解析工具,并基于其开发了解析XPath的工具Xsoup。

在这四个组件中,PageProcessor对于每个站点每个页面都不一样,是需要使用者定制的部分。

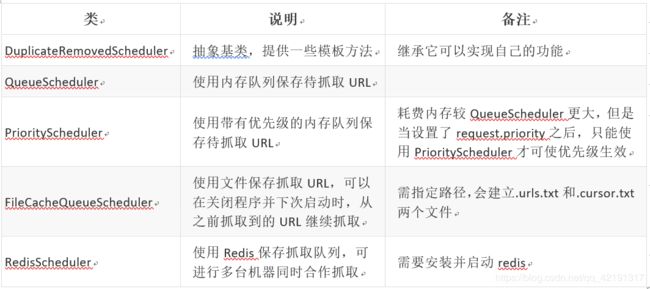

3.Scheduler

Scheduler负责管理待抓取的URL,以及一些去重的工作。WebMagic默认提供了JDK的内存队列来管理URL,并用HashSet集合来进行去重。也支持使用Redis进行分布式管理。

除非项目有一些特殊的分布式需求,否则无需自己定制Scheduler。

4.Pipeline

Pipeline负责抽取结果的处理,包括计算、持久化到文件、数据库等。WebMagic默认提供了“输出到控制台”和“保存到文件”两种结果处理方案。

Pipeline定义了结果保存的方式,如果你要保存到指定数据库,则需要编写对应的Pipeline。对于一类需求一般只需编写一个Pipeline。

用于数据流转的对象

1. Request

Request是对URL地址的一层封装,一个Request对应一个URL地址。

它是PageProcessor与Downloader交互的载体,也是PageProcessor控制Downloader唯一方式。

除了URL本身外,它还包含一个Key-Value结构的字段extra。你可以在extra中保存一些特殊的属性,然后在其他地方读取,以完成不同的功能。例如附加上一个页面的一些信息等。

2. Page

Page代表了从Downloader下载到的一个页面——可能是HTML,也可能是JSON或者其他文本格式的内容。

Page是WebMagic抽取过程的核心对象,它提供一些方法可供抽取、结果保存等。

3. ResultItems

ResultItems相当于一个Map,它保存PageProcessor处理的结果,供Pipeline使用。它的API与Map很类似,值得注意的是它有一个字段skip,若设置为true,则不应被Pipeline处理。

控制爬虫运转的引擎--Spider

Spider是WebMagic内部流程的核心。Downloader、PageProcessor、Scheduler、Pipeline都是Spider的一个属性,这些属性是可以自由设置的,通过设置这个属性可以实现不同的功能。Spider也是WebMagic操作的入口,它封装了爬虫的创建、启动、停止、多线程等功能。

爬虫配置Site

Site可以对爬虫进行一些配置配置,包括编码、抓取间隔、超时时间、重试次数等。

一般来说,对于编写一个爬虫,PageProcessor是需要编写的部分,而Spider则是创建和控制爬虫的入口。

快速入门Demo

1. 创建maven工程,添加如下依赖

us.codecraft

webmagic-core

0.7.3

us.codecraft

webmagic-extension

0.7.3

2. 编写代码,测试webmagic

编写一个页面解析器PageProcessor,实现Processor接口

package cn.lzx.magic;

import us.codecraft.webmagic.Page;

import us.codecraft.webmagic.Site;

import us.codecraft.webmagic.processor.PageProcessor;

public class MyPageProcessor implements PageProcessor {

//爬虫配置信息设置

private Site site = new Site()

.setCharset("utf-8") //设置编码

.setSleepTime(1) //设置抓取间隔

.setTimeOut(10) //设置超时时间

.setRetrySleepTime(3) //设置重试时间

.setRetryTimes(3); //设置重试次数

@Override

public void process(Page page) {

//对抓取到的页面进行处理

page.putField("title",page.getHtml().css(".c44380").all());

}

@Override

public Site getSite() {

return this.site;

}

}

开启爬虫

package cn.lzx.magic;

import us.codecraft.webmagic.Spider;

import us.codecraft.webmagic.pipeline.ConsolePipeline;

import us.codecraft.webmagic.pipeline.FilePipeline;

import us.codecraft.webmagic.pipeline.JsonFilePipeline;

public class WebMagicDemo {

public static void main(String[] args) {

//创建爬虫

Spider.create(new MyPageProcessor()) //将创建好的PageProcessor页面处理器交给Spider

.addUrl("http://www.xiyou.edu.cn/xwzx/zhxw.htm") //输入url

//.addPipeline(new FilePipeline()) //设置结果 保存到文件

//.addPipeline(new ConsolePipeline()) //设置结果 控制台输出

//.addPipeline(new JsonFilePipeline()) //设置结果 以Json格式输出

//当没有设置结果输出时 默认控制台输出

.thread(5) //设置5个线程同时执行

.run(); //启动爬虫

}

}

至此,一个简单的爬虫入门程序已经完成,下面我们来看一下webmagic各组件的详细API

各组件详解

PageProcessor获取元素方式:

WebMagic里主要使用了三种抽取技术:XPath、正则表达式和CSS选择器。另外,对于JSON格式的内容,可使用JsonPath进行解析。

1. XPath

以下是获取属性class=mt的div标签,里面的h1标签的内容

page.getHtml().xpath("//div[@class=mt]/h1/text()")

2. CSS选择器

CSS选择器是与XPath类似的语言。它比XPath写起来要简单一些,但是如果写复杂一点的抽取规则,就相对要麻烦一点。

div.mt>h1表示class为mt的div标签下的直接子元素h1标签

page.getHtml().css("div.mt>h1").toString()

可是使用:nth-child(n)选择第几个元素,如下选择第一个元素

page.getHtml().css("div#news_div > ul > li:nth-child(1) a").toString()注意:需要使用>,就是直接子元素才可以选择第几个元素

3. 正则表达式

正则表达式则是一种通用的文本抽取语言。在这里一般用于获取url地址。

抽取元素API

Selectable相关的抽取元素链式API是WebMagic的一个核心功能。使用Selectable接口,可以直接完成页面元素的链式抽取,也无需去关心抽取的细节。

在刚才的例子中可以看到,page.getHtml()返回的是一个Html对象,它实现了Selectable接口。这个接口包含的方法分为两类:抽取部分和获取结果部分。

获取结果API

当链式调用结束时,我们一般都想要拿到一个字符串类型的结果。这时候就需要用到获取结果的API了。

我们知道,一条抽取规则,无论是XPath、CSS选择器或者正则表达式,总有可能抽取到多条元素。WebMagic对这些进行了统一,可以通过不同的API获取到一个或者多个元素。

Pipeline结果保存

WebMagic用于保存结果的组件叫做Pipeline。可以通过在splider里进行设置来选择不同的结果输出,webmagic提供了控制台输出和文件输出,如果不设置,默认采用控制台输出,如果需要结果保存到数据库,需要自己写一个类去实现Pipeline接口。

Site配置信息

网页去重

在解析页面的时候,很可能会解析出相同的url地址,如果不进行处理,同样的url会解析处理多次,浪费资源。

所以我们需要有一个url去重的功能

WebMagic提供了Scheduler可以帮助我们解决以上问题。

Scheduler是WebMagic中进行URL管理的组件。一般来说,Scheduler包括两个作用:

- 对待抓取的URL队列进行管理。

- 对已抓取的URL进行去重。

WebMagic内置了几个常用的Scheduler。如果你只是在本地执行规模比较小的爬虫,那么基本无需定制Scheduler。

去重部分被单独抽象成了一个接口:DuplicateRemover,从而可以为同一个Scheduler选择不同的去重方式,以适应不同的需要,目前提供了两种去重方式。

RedisScheduler是使用Redis的set进行去重,其他的Scheduler默认都使用HashSetDuplicateRemover来进行去重。

三种URL去重方式对比:

- HashSet

使用java中的HashSet不能重复的特点去重。优点是容易理解。使用方便。

缺点:占用内存大,性能较低。

- Redis去重

使用Redis的set进行去重。优点是速度快(Redis本身速度就很快),而且去重不会占用爬虫服务器的资源,可以处理更大数据量的数据爬取。

缺点:需要准备Redis服务器,增加开发和使用成本。

- 布隆过滤器(BloomFilter)

使用布隆过滤器也可以实现去重。优点是占用的内存要比使用HashSet要小的多,也适合大量数据的去重操作。

缺点:有误判的可能。没有重复可能会判定重复,但是重复数据一定会判定重复。