Linux网络编程 - 异步 I/O 的探讨

概念

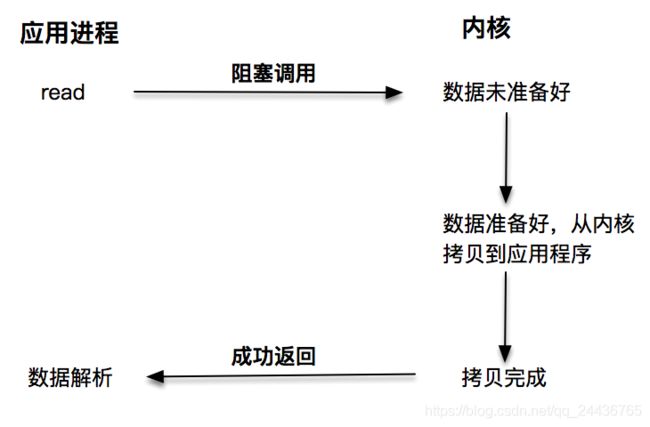

第一种是阻塞 I/O。阻塞 I/O 发起的 read 请求,线程会被挂起,一直等到内核数据准备好,并把数据从内核区域拷贝到应用程序的缓冲区中,当拷贝过程完成,read 请求调用才返回。接下来,应用程序就可以对缓冲区的数据进行数据解析。

第二种是非阻塞 I/O。非阻塞的 read 请求在数据未准备好的情况下立即返回,应用程序可以不断轮询内核,直到数据准备好,内核将数据拷贝到应用程序缓冲,并完成这次 read 调用。注意,这里最后一次 read 调用,获取数据的过程,是一个同步的过程。这里的同步指的是内核区域的数据拷贝到缓存区这个过程。

每次让应用程序去轮询内核的 I/O 是否准备好,是一个不经济的做法,因为在轮询的过程中应用进程啥也不能干。于是,像 select、poll 这样的 I/O 多路复用技术就隆重登场了。通过 I/O 事件分发,当内核数据准备好时,再通知应用程序进行操作。这个做法大大改善了应用进程对 CPU 的利用率,在没有被通知的情况下,应用进程可以使用 CPU 做其他的事情。

注意,这里 read 调用,获取数据的过程,也是一个同步的过程。

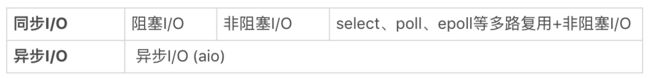

第一种阻塞 I/O ,应用程序会被挂起,直到获取数据。第二种非阻塞 I/O 和第三种基于非阻塞 I/O 的多路复用技术,获取数据的操作不会被阻塞。这里,它们都是同步调用技术。为什么这么说呢?因为同步调用、异步调用的说法,是对于获取数据的过程而言的,前面几种最后获取数据的 read 操作调用,都是同步的,在 read 调用时,内核将数据从内核空间拷贝到应用程序空间,这个过程是在 read 函数中同步进行的,如果内核实现的拷贝效率很差,read 调用就会在这个同步过程中消耗比较长的时间。

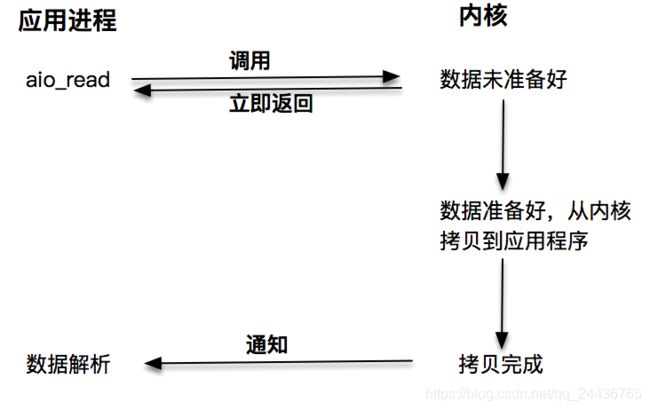

而真正的异步调用则不用担心这个问题,我们接下来就来介绍第四种 I/O 技术,当我们发起 aio_read 之后,就立即返回,内核自动将数据从内核空间拷贝到应用程序空间,这个拷贝过程是异步的,内核自动完成的,和前面的同步操作不一样,应用程序并不需要主动发起拷贝动作。

这里放置了一张表格,总结了以上几种 I/O 模型。

aio_read 和 aio_write 的用法

先上一个程序事例:

const int BUF_SIZE = 512;

int main() {

int err;

int result_size;

// 创建一个临时文件

char tmpname[256];

snprintf(tmpname, sizeof(tmpname), "/tmp/aio_test_%d", getpid());

unlink(tmpname);

int fd = open(tmpname, O_CREAT | O_RDWR | O_EXCL, S_IRUSR | S_IWUSR);

if (fd == -1) {

error(1, errno, "open file failed ");

}

char buf[BUF_SIZE];

struct aiocb aiocb;

//初始化buf缓冲,写入的数据应该为0xfafa这样的,

memset(buf, 0xfa, BUF_SIZE);

memset(&aiocb, 0, sizeof(struct aiocb));

aiocb.aio_fildes = fd;

aiocb.aio_buf = buf;

aiocb.aio_nbytes = BUF_SIZE;

//开始写

if (aio_write(&aiocb) == -1) {

printf(" Error at aio_write(): %s\n", strerror(errno));

close(fd);

exit(1);

}

//因为是异步的,需要判断什么时候写完

while (aio_error(&aiocb) == EINPROGRESS) {

printf("writing... \n");

}

//判断写入的是否正确

err = aio_error(&aiocb);

result_size = aio_return(&aiocb);

if (err != 0 || result_size != BUF_SIZE) {

printf(" aio_write failed() : %s\n", strerror(err));

close(fd);

exit(1);

}

//下面准备开始读数据

char buffer[BUF_SIZE];

struct aiocb cb;

cb.aio_nbytes = BUF_SIZE;

cb.aio_fildes = fd;

cb.aio_offset = 0;

cb.aio_buf = buffer;

// 开始读数据

if (aio_read(&cb) == -1) {

printf(" air_read failed() : %s\n", strerror(err));

close(fd);

}

//因为是异步的,需要判断什么时候读完

while (aio_error(&cb) == EINPROGRESS) {

printf("Reading... \n");

}

// 判断读是否成功

int numBytes = aio_return(&cb);

if (numBytes != -1) {

printf("Success.\n");

} else {

printf("Error.\n");

}

// 清理文件句柄

close(fd);

return 0;

}这里,主要用到的函数有:

- aio_write:用来向内核提交异步写操作;

- aio_read:用来向内核提交异步读操作;

- aio_error:获取当前异步操作的状态;

- aio_return:获取异步操作读、写的字节数。

这个程序一开始使用 aio_write 方法向内核提交了一个异步写文件的操作。结构体 aiocb 是应用程序向操作系统内核传递的异步申请数据结构,这里我们使用了文件描述符、缓冲区指针 aio_buf 以及需要写入的字节数 aio_nbytes。

struct aiocb {

int aio_fildes; /* File descriptor */

off_t aio_offset; /* File offset */

volatile void *aio_buf; /* Location of buffer */

size_t aio_nbytes; /* Length of transfer */

int aio_reqprio; /* Request priority offset */

struct sigevent aio_sigevent; /* Signal number and value */

int aio_lio_opcode; /* Operation to be performed */

};紧接着,我们使用了 aio_read 从文件中读取这些数据。为此,我们准备了一个新的 aiocb 结构体,告诉内核需要把数据拷贝到 buffer 这个缓冲区中,和异步写一样,发起异步读之后一直查询异步读动作的结果。

接下来运行这个程序,我们看到屏幕上打印出一系列的字符,显示了这个操作是有内核在后台帮我们完成的。

./aio01

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

writing...

Reading...

Reading...

Reading...

Reading...

Reading...

Reading...

Reading...

Reading...

Reading...

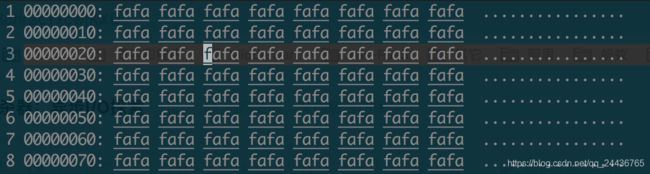

Success.打开 /tmp 目录下的 aio_test_xxxx 文件,可以看到,这个文件成功写入了我们期望的数据。

Linux 下 socket 套接字的异步支持

aio 系列函数是由 POSIX 定义的异步操作接口,可惜的是,Linux 下的 aio 操作,不是真正的操作系统级别支持的,它只是由 GNU libc 库函数在用户空间借由 pthread 方式实现的,而且仅仅针对磁盘类 I/O,套接字 I/O 不支持。

也有很多 Linux 的开发者尝试在操作系统内核中直接支持 aio,例如一个叫做 Ben LaHaise 的人,就将 aio 实现成功 merge 到 2.5.32 中,这部分能力是作为 patch 存在的,但是,它依旧不支持套接字。

Solaris 倒是有真正的系统系别的 aio,不过还不是很确定它在套接字上的性能表现,特别是和磁盘 I/O 相比效果如何。

综合以上结论就是,Linux 下对异步操作的支持非常有限,这也是为什么使用 epoll 等多路分发技术加上非阻塞 I/O 来解决 Linux 下高并发高性能网络 I/O 问题的根本原因。

和 Linux 不同,Windows 下实现了一套完整的支持套接字的异步编程接口,这套接口一般被叫做 IOCompletetionPort(IOCP)。这样,就产生了基于 IOCP 的所谓 Proactor 模式。无论是 Reactor 模式,还是 Proactor 模式,都是一种基于事件分发的网络编程模式。Reactor 模式是基于待完成的 I/O 事件,而 Proactor 模式则是基于已完成的 I/O 事件,两者的本质,都是借由事件分发的思想,设计出可兼容、可扩展、接口友好的一套程序框架。

总之, 异步 I/O 的读写动作由内核自动完成,不过,在 Linux 下目前仅仅支持简单的基于本地文件的 aio 异步操作,这也使得我们在编写高性能网络程序时,首选 Reactor 模式,借助 epoll 这样的 I/O 分发技术完成开发;而 Windows 下的 IOCP 则是一种异步 I/O 的技术,并由此产生了和 Reactor 齐名的 Proactor 模式,借助这种模式,可以完成 Windows 下高性能网络程序设计。

温故而知新 !