自然场景文本处理论文整理(3)Mask TextSpotter

这篇论文是2018年7月6号出来的,对于任意形状的自然文本检测识别效果非常好。

paper:https://arxiv.org/abs/1807.02242

目前无相关源码

1.摘要简介

在本文中,我们提出了一个名为Mask TextSpotter的文本监视器,它可以检测和识别任意形状的文本实例。 这里,任意形状意味着现实世界中可能呈现的各种形式的文本实例。 受Mask R-CNN [9]的启发,它可以生成对象的形状蒙版,我们通过分段实例文本区域来检测文本。 因此,我们的探测器能够检测任意形状的文本。 此外,与以前基于序列的识别方法[10,11,12]不同,我们通过二维空间中的语义分割识别文本,解决了阅读不规则文本实例的问题。 此外,该方法的另一个优点是它不需要准确的识别位置。 因此,检测任务和识别任务可以完全端到端地训练,并受益于特征共享和联合优化。。

效果:

在ICDAR2015上,在单一尺度上进行评估,我们的方法在检测任务上实现了0.86的F-测量,并且在端到端识别任务上优于先前的最佳表现者13.2%-25.3%。

本文的主要贡献

(1)我们提出了一种用于文本定位的端到端可训练模型,它具有简单,流畅的训练方案。

(2)所提出的方法可以检测和识别各种形状的文本,包括水平,定向和弯曲文本。

(3)与以前的方法相比,我们的方法中的精确文本检测和识别是通过语义分割完成的。

(4)我们的方法在各种基准测试中实现了文本检测和文本定位的最先进性能。

2.相关工作

我们框架中提议的文本识别组件可以归类为基于字符的方法。 然而,与之前基于字符的方法相比,我们使用FCN [40]来同时对字符进行本地化和分类。此外,与基于序列的方法相比,我们的方法更适合处理不规则文本(多向导向)

文本,弯曲文本等。我们提出的文本识别器不仅可以完全端到端地进行训练,而且还具有检测和识别任意形状(水平,定向和弯曲)场景文本的能力。

一般对象检测和语义分割

具体来说,我们的方法改编自通用对象实例分割模型Mask R-CNN [9]。 但是,我们的方法的掩码分支与Mask R-CNN中的掩码分支之间存在关键差异。 我们的掩码分支不仅可以分割文本区域,还可以预测字符概率图,这意味着我们的方法可以用于识别字符映射中的实例序列,而不仅仅是预测对象掩码

3、实现

3.1框架

它由基于实例分割的文本检测器和基于字符分割的文本识别器组成。

Backbone

自然图像中的骨干文本大小各异。 为了在所有尺度上构建高级语义特征映射,我们应用了深度为50的ResNet [50]的特征金字塔结构[46]骨干.FPN使用自上而下的架构来融合不同分辨率的特征来自单个 - 输入,可以提高边际成本的准确性。

RPN

RPN用于为后续的Fast-R-CNN生成文本提议和Mask分支。在[46]之后,我们根据锚点大小在不同阶段分配锚点。 具体来说,锚点的面积分别设置为五个阶段{P 2,P 3,P 4,P 5,P 6}上的{32 2,64 2,128 2,256 2,512 2}像素。在[33]中的每个阶段也采用不同的宽高比{0.5,1,2}。这样,RPN可以处理各种大小和宽高比的文本。 RoI Align [9]适用于提取提案的区域特征。 与RoI Pooling [44]相比,RoI Align保留了更准确的位置信息,这对掩码分支中的分段任务非常有利。 请注意,没有采用特殊的文本设计,例如文本锚的特殊宽高比或方向,如之前的作品[1,24,23]。

Fast-R-CNN

Fast-R-CNN分支包括分类任务和回归任务。 该分支的主要功能是提供更准确的检测边界框。 Fast-R-CNN的输入为7×7分辨率,由RoI Align根据RPN提出的提议生成。

掩码分支

掩码分支中有两个任务,包括全局文本实例分段任务和字符分段任务。 如图3所示,通过四个卷积层和一个去卷积层给出一个输入RoI,其大小固定为16 * 64,掩码分支预测38个映射(大小为32 * 128),包括全局文本 实例映射,36个字符映射和字符的背景映射。 无论文本实例的形状如何,全局文本实例映射都可以提供文本区域的准确定位。字符映射是36个字符的映射,包括26个字母和10个阿拉伯数字。 后处理也需要排除字符区域的字符背景图。

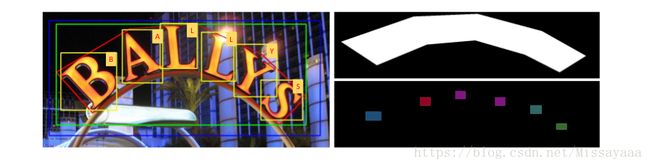

图3:掩模分支的图示。 随后,有四个卷积层,一个去卷积层和一个最终卷积层,它预测38个通道的映射(1个用于全局文本实例映射; 36个用于字符映射; 1个用于字符的背景映射)。

3.2标签生成

图4:掩模分支的标签生成。 左:蓝框是由RPN产生的建议,红色多边形和黄色框是地面真实多边形和字符框,绿色框是水平矩形,覆盖多边形区域。 右:全局地图(顶部)和角色地图(底部)。

我们首先将多边形转换为水平矩形,以最小的面积覆盖多边形。 然后我们在[44,33,46]之后生成RPN和Fast-R-CNN的目标。 为掩模分支生成两种类型的目标图,其具有基础事实P,C(可能不存在)以及由RPN产生的提议:用于文本实例分割的全局图和用于字符语义分割的字符图。。 给定一个积极的提议r,我们首先使用[44,33,46]的匹配机制来获得最佳匹配的水平矩形。 可以进一步获得相应的多边形以及字符(如果有的话)。 接下来,匹配的多边形和字符框isMask TextSpotter 7移位并调整大小以使提案与H×W的目标地图对齐,如下面的公式:

其中(B x,B y)和(B x 0,B y 0)是多边形和所有字符框的更新和原始顶点; (r x,r y)是提议r的顶点。

3.3优化

文本实例分段损失

文本实例分段任务的输出是单个映射。 设N是全局映射中的像素数,y n是像素标签(yn∈0,1),x n是输出像素,我们定义L全局

如下:

字符分段损失

字符分割的输出由37个映射组成,对应于37个类(36个字符类和背景类)。 令T为类的数量,N为每个地图中的像素数。 输出映射X可以被视为N×T矩阵。 这样,加权空间 - 最大损失可以定义如下:

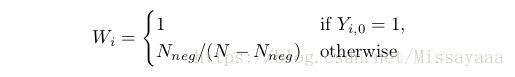

其中Y是X的相应基本事实。权重W用于平衡积极(字符类)和背景类的损失值。 设背景像素的数量为N neg,背景类索引为0,权重可以计算为:

注意,在推理中,应用sigmoid函数和soft-max函数分别生成全局映射和字符分割映射。

3.4推理

与掩模分支的输入RoI来自RPN的训练过程不同,在推理阶段,我们使用Fast-R-CNN的输出作为生成预测的全局地图和字符映射的建议,因为Fast-R-CNN输出是 更准确。 特别地,推理过程如下:首先,输入测试图像,我们获得快速R-CNN的输出[33]并通过NMS过滤掉冗余候选框; 然后,将保留的提议输入掩码分支以生成全局映射和字符映射; 最后,通过计算全局地图上文本区域的轮廓可以直接获得预测的多边形,可以通过我们提出的像素生成字符序列字符映射的投票算法。

像素投票

我们通过我们提出的像素投票算法将预测的字符映射解码为字符序列。 我们首先将背景图二进制二值化为0到255,阈值为192.然后我们根据二值化地图中的连通区域获取所有字符区域。 我们计算所有字符映射的每个区域的平均值。 这些值可以看作该区域的字符类概率。 具有最大平均值的字符类将分配给该区域。 算法1中显示了具体的过程。之后,我们根据英语的写作习惯将所有字符从左到右分组。 详细的计算在本文的算法1中描述。

加权编辑距离

编辑距离可用于查找具有给定词典的预测序列的最佳匹配单词。 但是,可能存在多个与最小编辑距离同时匹配的单词,并且算法无法确定哪个单词是最佳的。 上述问题的主要原因是原始编辑距离算法中的所有操作(删除,插入,替换)具有相同的成本,实际上没有意义。

图6:编辑距离和我们建议的加权编辑距离的图示。红色字符是将被删除,插入和替换的字符。绿色字符表示候选字符。 p cindex是字符概率,index是字符索引,c是当前字符。

受[51]的启发,我们提出了一种加权编辑距离算法。 如图6所示,与编辑距离不同,编辑距离为不同的操作分配相同的成本,我们提出的加权编辑距离的成本取决于像素投票产生的字符概率p cindex。 数学上,两个字符串a和b之间的加权编辑距离,其长度为| a | 和| b | 分别可以描述为D a,b(| a |,| b |),其中: