sklearn.decomposition.PCA主要参数讲解、对鸢尾花数据集进行PCA降维处理

1.scikit-learn PCA类介绍

class sklearn.decomposition.PCA(n_components=None, copy=True, whiten=False, svd_solver=’auto’, tol=0.0, iterated_power=’auto’, random_state=None)[source]¶

官方文档:https://scikit-learn.org/stable/modules/generated/sklearn.decomposition.PCA.html#sklearn.decomposition.PCA

主成成分分析(Principal Component analysis, PCA)

利用数据的奇异值分解进行线性降维,将数据投影到低维空间。

它采用了基于LAPACK实现的完全SVD方法或者Halko等在2009年提出的随机截断SVD方法,这主要取决于输入数据的形状和提取成分的数量。

也可以采用基于scipy.sparse.linalg ARPACK实现的随机截断SVD方法。

需要注意的是本类不支持稀疏数据作为输入。如果要处理稀疏数据,可以参考TruncatedSVD类。

更多使用说明参考User Guide。

输入

n_components : int, float, None or string。降维后的主成成分数量。

-

如果

n_components没有设置,使用所有维度。n_components == min(n_samples, n_features)

-

如果

n_components == 'mle'且svd_solver == 'full',将采用Minka’s MLE方法得出最终的维度. 而使用n_components == 'mle'时将把svd_solver == 'auto'编译为svd_solver == 'full'. -

如果

0 < n_components < 1且svd_solver == 'full',则方差和需要大于n_components所指定的阈值,PCA会自动地选择下降维数。 -

如果

svd_solver == 'arpack', 主城成分的数量必须严格小于n_features和n_samples之间的最小值.因此,n_components=None的结果为:n_components == min(n_samples, n_features) - 1

svd_solver : string {‘auto’, ‘full’, ‘arpack’, ‘randomized’}。

-

auto : 基于X.shape和n_components采用默认方法的svd solver:如果输入数据大于500x500且提取的维数小鱼数据最小维数的80%,那么将采用更加有效的

randomized方法。其他情况下将计算精确完整的svd,并选择性的截断。 -

full : 通过scipy.linalg.svd,调用标准的LAPACK solver计算精确完整的svd然后选择主成成分。

-

arpack : 通过solver via scipy.sparse.linalg.svds 调用ARPACK solver计算svd并截断成n_components个主成成分。n_components严格满足0 < n_components < min(X.shape)。

-

randomized : 通过Halko等的方法计算随机svd。

-

除了以上参数外,有两个PCA类的成员值得关注。第一个是explained_variance_,它代表降维后的各主成分的方差值。方差值越大,则说明越是重要的主成分。第二个是explained_variance_ratio_,它代表降维后的各主成分的方差值占总方差值的比例,这个比例越大,则越是重要的主成分

2.iris数据集PCA降维实例(利用Jupyter开发工具)

import pandas as pd

import numpy as np

from sklearn.datasets import load_iris

from sklearn.decomposition import PCA

from sklearn.model_selection import cross_val_score

iris = load_iris()

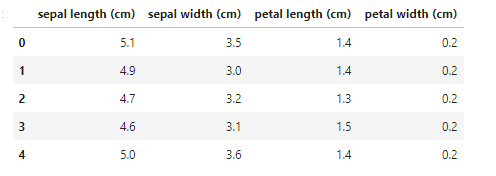

df_iris = pd.DataFrame(data=iris.data, columns=iris.feature_names)

df_iris.head()

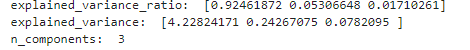

# n_components=1

pca = PCA(n_components=1)

pca.fit(df_iris)

print('explained_variance_ratio: ', pca.explained_variance_ratio_)

print('explained_variance: ', pca.explained_variance_)

print('n_components: ', pca.n_components_)

# n_components=2

pca = PCA(n_components=2)

pca.fit(df_iris)

print('explained_variance_ratio: ', pca.explained_variance_ratio_)

print('explained_variance: ', pca.explained_variance_)

print('n_components: ', pca.n_components_)# mle_pca

mle_pca = PCA(n_components='mle', svd_solver='full')

mle_pca.fit(df_iris)

print('explained_variance_ratio: ', mle_pca.explained_variance_ratio_)

print('explained_variance: ', mle_pca.explained_variance_)

print('n_components: ', mle_pca.n_components_)

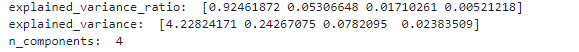

# n_components=4

pca = PCA(n_components=4)

pca.fit(df_iris)

print('explained_variance_ratio: ', pca.explained_variance_ratio_)

print('explained_variance: ', pca.explained_variance_)

print('n_components: ', pca.n_components_)