统计学习方法概论

1、统计学习

统计学习是基于数据构建统计模型从而对数据进行预测和分析,统计学习由监督学习(有用于学习的训练数据)、无监督学习、半监督学习和强化学习组成。

统计学习三要素:模型+策略+算法(MSA)。

实现统计学习方法的步骤:

1. 得到一个有限的训练数据集合;

2. 确定包含所有可能模型的假设空间,即学习模型的集合;

3. 确定模型选择的准则,即学习的策略;

4. 实现求解最优模型的算法,取出学习的算法;

5. 通过学习方法选择最优模型;

6. 利用学习的最优模型对新数据进行预测和分析。

2、监督学习

输入空间是指输入的所有可能取值的集合。,输出空间是指输出的所有可能取值的集合,每个具体的输入一个实例通常是特征向量来表示,所有特征向量存在的空间成为特征空间。

输入实例x的特征向量记作:x=(x(1),x(2),···,x(i),···,x(n))T;

训练集:T={(x1,y1),(x2,y2),···,(xn,yn)};

【Note】:

(1)输入变量与输出变量均为连续变量的预测问题称为回归问题;

(2)输出变量为有限个离散变量的预测问题称为分类问题;

(3)输入变量与输出变量均为变量序列的预侧问题称为标注问题。

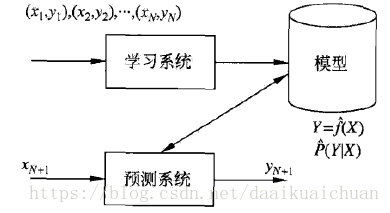

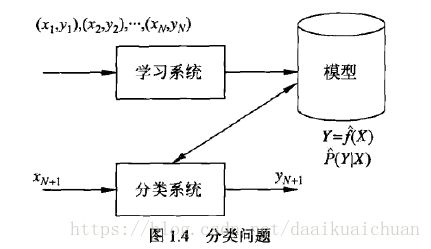

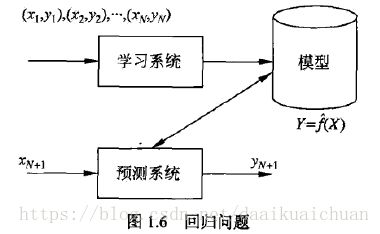

监督学习假设输入与输出的随机变量X和Y遵循联合概率分布P (X,Y)。监督学习问题的模型如图:

3、统计学习三要素

统计学习方法包括模型的假设空间、模型选择的准则以及模型的学习算法,称其为统计学习方法的三要素,简称为模型、策略、算法。

(1)模型

(2)策略

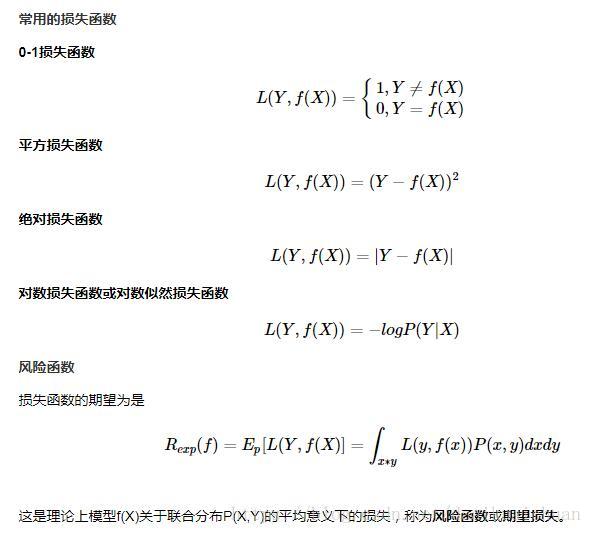

首先引入损失函数与风险函数的概念。损失函数度量模型一次预测的好坏,风险函数度量平均意义下模型预测的好坏。

这是理论上模型f(X)关于联合分布P(X,Y)的平均意义下的损失,称为风险函数或期望损失。

学习的目标就是选择期望风险最小的模型。由于联合分布p(X,Y)是未知的,Rexpf(x)不能直接计算。实际上,如果知道联合分布P(X,Y),可以从联合分布直接求出条件概率分布P(X,Y),也就不需要学习了。正因为不知道联合概率分布,所以才需要学习。一方面根据期望风险最小学习模型要用到联合分布,另一方面联合分布又是未知的,所以监督学习就成为一个病态问题。

监督学习有两个基本策略:经验风险最小化和结构风险最小化。

(3)算法

算法是指学习模型的具体计算方法。统计学习基于训练数据集,根据学习策略,从假设空间中选择最优模,最后考虑用什么样的计算方法来求解最优模型。这时统计学习问题归结为最优化问题,统计学习的算法成国求解最优化问题的算法。

4、模型评估与模型选择

统计学习的目的是使学到的模型不仅对已知数据而且对未知数据都能有很好的预测能力。不同的学习方法会给出不同的模型。当损失函数给定时,基于缺失函数的模型的训练误差和模型的测试误差就自然成为学习方法评估的标准。注意,统计学习方法具体采用的损失函数未必是评估时使用的损失函数。

(1)训练误差与测试误差

训练误差的大小,对判断给定的问题是不是一个容易学习的问题是有意义的,但本质上不重要。测试误差反映了学习方法对于未知的测试数据集的预测能力,是学习中的重要概念。显然,给定两种学习方法,测试误差小的方法具有更好的预测能力,是更有效的方法。通常学习方法对未知数据折预测能力称为泛化能力。

(2)过拟合与模型选择

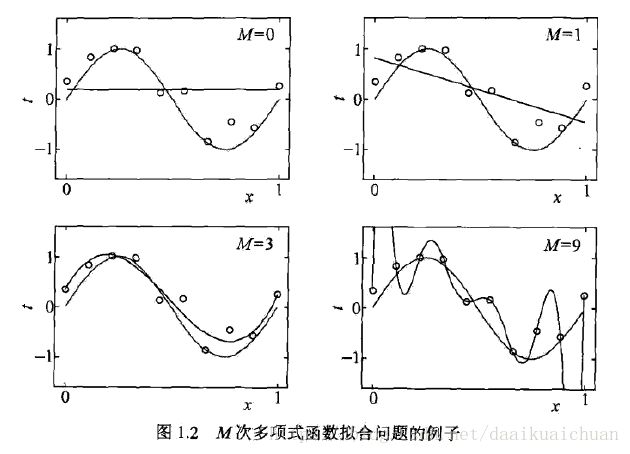

过拟合(over-fitting):如果一味追求提高对训练数据的预侧能力,所选模型的复杂度则往往会比真模型更高。这种现象称为过拟合(over-fitting)。过拟合是指学习时选择的模型所包含的参数过多,以致于出现这一模型对己知数据预测得很好,但对未知数据预测得很差的现象。

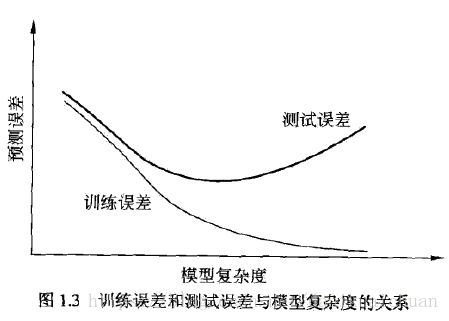

在多项式函数拟合中可以看到,随着多项式次数(模型复杂度)的增加,训练误差会减小,直至趋向于0,但是测试误差却不如此,它会随着多项式次数(模型复杂度)的增加先减小而后增大。要防止过拟合,进行最优的模型选择,即选择复杂度适当的模型,以达到使测试误差最小的学习目的。

5、正则化与交叉验证

(1)正则化

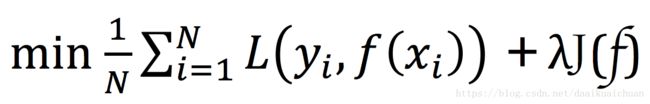

模型选择的典型方法是正则化。正则化是结构风险最小化策略的实现,在经验风险上加一个正则化项或罚项。正则化项一般是模型复杂度的单调递增函数,模型越复杂正则化值就越大。如正则化项可以是模型参数向量的范数。正则化一般有如下形式:

其中,第一项式经验风险,第二项式正则化项λ≥0为调整两者之间关系的系数。正则化可以取不同的形式,例如回归问题中损失函数为平方损失,正则化项可以是参数向量的L2范数:

第一项经验风险较小的模型可能较复杂(有多个非零参数),这时第二项的模型复杂度会较大,正则化的作用是选择经验风险与模型复杂度同时较小的模型。正则化符合奥卡姆剃刀原理。该原理应用于模型选择时变为一下想法:在所有可能选择的模型中,能够很好的解释已知数据集并且十分简单才是最好的模型。从贝叶斯估计的角度看,正则化对应于模型的先验概率,可以假设复杂的模型有较小的先验概率,简单的模型有较大的先验概率。

(2)交叉验证

简单交叉验证将数据分为训练集(70%)和测试集(30%),然后用训练集在各种条件下训练模型,从而得到不同的模型,在测试集上评价各个模型的测试误差,选出测试误差最小的模型。S折交叉验证是应用最多的,该方法首先将集合划分为S个互不相交的大小相同的子集,然后利用S-1个子集的数据训练模型,利用余下的子集测试模型,将这一过程对可能的S种选择重复进行,最后选出S次评测中平均测试误差最小的模型。留一交叉验证是S折交叉验证的特例,其S=N,N是给定数据集的容量,通常在数据缺乏的情况下使用。

6、泛化能力

学习方法的泛化能力是指由该方法学习到的模型对未知数据的预测能力。现实中采用最多的是通过测试误差来评价学习方法的泛化能力。这种评价依赖于测试数据集,如果测试数据集有限,评价结果则不太可靠。统计学习理论试图从理论上对学习方法的泛化能力进行分析。首先给出泛化误差的定义,如果学到的模型是,那么用这个模型对未知数据预测的误差即为泛化误差:

泛化误差反映了学习方法的泛化能力,如果一种方法学习的模型比另一种方法学习的模型具有更小的泛化误差,那么这种方法就更有效,实际上泛化误差就是学习到的模型的期望风险。

7、生成模型与判别模型

监督学习的目的就是学习一个模型,应用这一模型,对给定的输入预测相应的输出。这一模型的一般形式为决策函数或者条件概率分布。监督学习方法可以分为生成方法和判别方法,所学到的模型分别为生成模型和判别模型。生成方法由数据学习联合概率分布,然后求出条件概率分布P(Y|X)作为预测的模型,即生成模型:

这样的方法之所以称之为生成方法,是因为模型表示了给定输入X产生输出Y的生成关系。典型的生成模型有:朴素贝叶斯法和隐形马尔可夫模型。

判别方法由数据直接学习决策函数f(X)或者条件概率分布P(Y|X)作为预测的模型,即判别模型。判别方法关心的是对给定的输入X,应该预测什么样的输出Y。典型的判别模型包括:k近邻法、感知机、决策树、逻辑斯蒂回归模型、最大熵模型、支持向量机、提升方法和条件随机场等。

8、分类问题

分类是监督学习的一个核心问题。在监督学习中,当输出变量Y有有限个离散值时,预测问题便成为分类问题。这时,输入变量可以时离散的也可以是连续的,监督学习从数据中学习一个分类模型或分类决策函数,称为分类器。分类器对新的数据进行输出的预测,称为分类。可能的输出称为类,分类的类别有多个时,称为多类分类问题。如下主要讨论二类分类问题。

评价分类器性能的指标一般是分类准确率,其定义是:对于给定的测试数据集,分类器正确分类的样本数与总样本数之比。也就是损失函数是0-1损失时测试数据集上的准确率。对于二类分类问题常用的评价指标是精确率和召回率。通常关注的类称为正类,其它类称为负类,分类器在测试数据集上的预测或正确或不正确。4种情况出现的总数分别记作:

9、标注问题

标注问题也是一类监督学习问题。可以认为标注问题是分类问题的一个推广。标注问题是更复杂的结构预测问题的简单形式。标注问题的输入是一个观测序列,输出是一个标记序列或状态序列。标注问题的目标在于学习一个模型,使它能够对观测序列给出标记序列作为预测,可能的标记序列是有限的,但其组合所成的标记序列的格式是依序列长度呈指数级增长的。

10、回归问题

回归是监督学习中的一个重要问题。回归用于预测输入变量和输出变量之间的关系,特别是输入变量的值发生变化时,输出变量的值随之发生变化。回归模型正是表示从输入变量到输出变量之间映射的函数。回归问题的学习等价于函数拟合,选择一条函数曲线使其很好的拟合已知数据且对未知数据的预测有较准确的预测。

回归问题按照输入变量的个数,分为一元回归和多元回归;按照输入变量和输出变量之间关系的类型即模型的类型,分为线性回归和非线性回归。回归学习最常用的损失函数是平方损失函数,在此情况下,回归问题可以由著名的最小二乘法(least squares)求解。