- 人脸识别实战:使用Python OpenCV 和深度学习进行人脸识别(2)

先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!因此收集整理了一份《2024年最新Python全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课

- TensorFlow深度学习实战——DCGAN详解与实现

盼小辉丶

深度学习tensorflow生成对抗网络

TensorFlow深度学习实战——DCGAN详解与实现0.前言1.DCGAN架构2.构建DCGAN生成手写数字图像2.1生成器与判别器架构2.2构建DCGAN相关链接0.前言深度卷积生成对抗网络(DeepConvolutionalGenerativeAdversarialNetwork,DCGAN)是一种基于生成对抗网络(GenerativeAdversarialNetwork,GAN)的深度学

- 基于cnn和resnet和mobilenet对比实现驾驶员分心检测

深度学习乐园

cnn人工智能神经网络

演示效果及获取项目源码点击文末名片本项目旨在通过深度学习技术,结合卷积神经网络(CNN)模型、ResNet模型和MobileNet模型,实现对驾驶员分心行为的自动检测。我们通过训练这些模型来识别不同的驾驶员分心行为,包括如发短信、通话、喝水等行为。使用的数据集包含驾驶员行为的图片,并且针对每个行为标注了相应的标签(例如"正常驾驶"、"右手发短信"等)。MobileNetV2是Google于2018

- opencv 4.12.0版本发布详解:核心优化与新特性全解析

Risehuxyc

#opencvopencv人工智能计算机视觉

OpenCV4.12.0夏季更新带来核心模块优化、图像处理增强、深度学习支持扩展及新兴硬件适配,全面提升计算机视觉开发效率与性能。引言OpenCV(开源计算机视觉库)作为计算机视觉领域最受欢迎的开源库之一,在2025年7月发布了4.12.0版本。这个夏季更新带来了大量性能优化、新功能和错误修复,覆盖了核心模块、图像处理、3D校准、深度学习等多个领域。本文将详细介绍OpenCV4.12.0的主要更新

- 如何用深度学习实现图像风格迁移

最近研学过程中发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击链接跳转到网站人工智能及编程语言学习教程。读者们可以通过里面的文章详细了解一下人工智能及其编程等教程和学习方法。下面开始对正文内容的介绍。前言图像风格迁移是人工智能领域中一个非常有趣且富有创意的应用。它能够让一张普通的照片瞬间变成梵高笔下的《星月夜》风格,或者像莫奈的《睡莲》一样充满艺术感。这种技术不仅在

- AI人工智能领域TensorFlow的模型训练策略

AIGC应用创新大全

人工智能tensorflowpythonai

AI人工智能领域TensorFlow的模型训练策略关键词:TensorFlow、模型训练、深度学习、神经网络、优化策略、分布式训练、迁移学习摘要:本文将深入探讨TensorFlow框架下的模型训练策略,从基础概念到高级技巧,全面解析如何高效训练深度学习模型。我们将从数据准备、模型构建、训练优化到部署应用,一步步揭示TensorFlow模型训练的核心技术,并通过实际代码示例展示最佳实践。背景介绍目的

- ROS2 通过相机确定物品坐标位置

要实现通过相机确定物品坐标位置,通常需要相机标定、物体检测和坐标转换几个步骤。下面我将提供一个完整的解决方案,包括相机标定、物体检测和3D坐标估计。1.系统架构相机标定-获取相机内参和畸变系数物体检测-使用OpenCV或深度学习模型检测物品坐标转换-将2D图像坐标转换为3D世界坐标ROS2集成-将上述功能集成到ROS2节点中2.实现步骤2.1创建功能包bashros2pkgcreateobject

- 【机器学习&深度学习】什么是量化?

一叶千舟

深度学习【理论】机器学习深度学习人工智能

目录前言一、量化的基本概念1.1量化对比示例1.2量化是如何实现的?二、为什么要进行量化?2.1解决模型体积过大问题2.2降低对算力的依赖2.3加速模型训练和推理2.4优化训练过程2.5降低部署成本小结:量化的应用场景三、量化的类型与实现3.1权重量化(WeightQuantization)3.2激活量化(ActivationQuantization)3.3梯度量化(GradientQuantiz

- 基于AutoCut实现在文档中按照片段剪辑视频

Mr数据杨

Python音频技术音视频

本项目致力于通过构建一个具备深度学习支持的多功能视频处理环境,为用户提供高效、智能的视频编辑和字幕生成工具。依托Anaconda环境管理工具和PyTorch的GPU加速能力,用户能够迅速搭建一个符合项目需求的Python环境。结合FunClip的源代码以及相关插件的安装和配置,用户可充分利用项目所支持的图像、音频识别功能,并以极少的配置便获得理想的视频裁剪效果。项目的核心在于简化深度学习项目的环境

- 基于深度学习的和平精英(吃鸡)内置锁头训练

摆烂仙君

深度学习人工智能

前言本教程以和平精英为例,主要讲解如何构建深度学习模型对游戏中角色进行头部标注,并控制鼠标对其进行锁定射击,同时围绕其游戏防作弊系统进行算法攻防讲解,该方案对于csgo,cf等游戏也同样适用。请注意,该教程仅供娱乐教学,若本教程评论超过100,将会开源相关代码并对实际的代码部署进行进一步分析。一、和平精英伤害机制分析在《刺激战场》(现为《和平精英》)中,击中头部的伤害远高于身体其他部位,这是由游戏

- 迁移学习让深度学习更容易

城市中迷途小书童

摘要:一文读懂迁移学习及其对深度学习发展的影响!深度学习在一些传统方法难以处理的领域有了很大的进展。这种成功是由于改变了传统机器学习的几个出发点,使其在应用于非结构化数据时性能很好。如今深度学习模型可以玩游戏,检测癌症,和人类交谈,自动驾驶。深度学习变得强大的同时也需要很大的代价。进行深度学习需要大量的数据、昂贵的硬件、甚至更昂贵的精英工程人才。在ClouderaFastForward实验室,我们

- 股票基金量化开源平台对比

Mr.小海

开源开源金融

股票基金量化开源平台对比分析报告引言研究背景与意义在金融科技快速发展的背景下,量化交易已成为现代金融市场中投资者追求高效与精准交易的核心工具。通过程序化方式,投资者能够迅速处理海量市场数据,制定并执行复杂交易策略,其高效性、低情绪干扰及策略多样性等优势显著[1]。特别是随着人工智能技术的深化,2025年基于深度学习与机器学习的开源量化工具持续涌现,推动行业向数据驱动转型——量化交易将决策逻辑从经验

- 开源基金/股票量化平台调研报告

Mr.小海

金融

开源基金/股票量化平台调研报告引言调研背景与目的近年来,随着人工智能技术的持续深化,量化交易领域迎来了深刻变革。2025年,基于深度学习和机器学习的开源工具不断涌现,不仅在技术层面实现突破,更在实际应用中展现出强大竞争优势,推动行业创新与升级[1].作为融合数学、统计与计算机技术的科技驱动型金融策略,量化交易通过自动化与数据驱动方法提升投资决策效率与准确性,已成为金融机构与投资者追求超额收益的重要

- Python Gradio:快速搭建人脸识别应用

Python编程之道

Python人工智能与大数据Python编程之道python开发语言ai

PythonGradio:快速搭建人脸识别应用关键词:Python,Gradio,人脸识别,深度学习,计算机视觉,交互式应用,模型部署摘要:本文详细介绍了如何使用Python的Gradio库快速搭建一个交互式的人脸识别应用。我们将从基础概念出发,逐步讲解人脸识别的核心算法原理、Gradio的界面设计方法,并通过完整的项目实战演示如何将深度学习模型部署为可交互的Web应用。文章包含详细的代码实现、数

- DataWhale 二月组队学习-深入浅出pytorch-Task04

-273.15K

DataWhale组队学习学习pytorch人工智能

一、自定义损失函数1.损失函数的作用与自定义意义在深度学习中,损失函数(LossFunction)用于衡量模型预测结果与真实标签之间的差异,是模型优化的目标。PyTorch内置了多种常用损失函数(如交叉熵损失nn.CrossEntropyLoss、均方误差nn.MSELoss等)。但在实际任务中,可能需要针对特定问题设计自定义损失函数,例如:处理类别不平衡问题(如加权交叉熵)实现特殊业务需求(如对

- 大模型核心概念 | 嵌入模型(Embedding)、向量模型(Vector Model)

一、核心概念解析1.1嵌入模型(Embedding)作为AI领域的核心基础技术,嵌入模型通过将非结构化数据映射为低维稠密向量,实现语义特征的深度捕捉:文本嵌入:如将语句转换为1536维向量,使"机器学习"与"深度学习"的向量余弦相似度达0.92跨模态嵌入:支持图像与文本的联合向量空间映射,如CLIP模型实现文图互搜1.2向量模型(VectorModel)作为嵌入技术的下游应用体系,主要包含两大方向

- Python实现神经网络算法指南

代码编织匠人

python神经网络算法

Python实现神经网络算法指南神经网络是一种模拟人脑神经元结构进行信息处理的机器学习算法。在深度学习领域中,神经网络是最为强大的算法之一。Python作为一门简单易学的编程语言,也成为了许多人选择实现神经网络算法的首选语言。在本篇文章中,我们将通过Python代码来实现神经网络算法。导入必要的库为了实现神经网络算法,我们需要导入一些必要的Python库,包括numpy和matplotlib。其中

- 基于DTLC-AEC与DTLN的轻量级实时语音增强系统设计与实现

神经网络15044

仿真模型神经网络机器学习图像处理cnn人工智能机器人

基于DTLC-AEC与DTLN的轻量级实时语音增强系统设计与实现前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。1.引言在当今的互联网通信时代,实时语音通信已成为人们日常生活中不可或缺的一部分。然而,语音通信质量常常受到回声、背景噪声等因素的严重影响。为了解决这些问题,我们需要高效的语音增强技术。本文将详细介绍如何将DTLC-AEC(深度学习回声消

- 目标检测-YOLOv5

wydxry

深度学习目标检测YOLO人工智能深度学习

YOLOv5介绍YOLOv5是YOLO系列的第五个版本,由Ultralytics团队发布。虽然YOLOv5并非JosephRedmon原团队发布,但它在YOLOv4的基础上进行了重要的优化和改进,成为了深度学习目标检测领域中的热门模型之一。YOLOv5的优势不仅体现在其性能上,还包括其简洁易用、部署便捷的特点。相较于YOLOv4,YOLOv5对于代码框架的重构、推理速度的提升,以及模型的轻量化等方

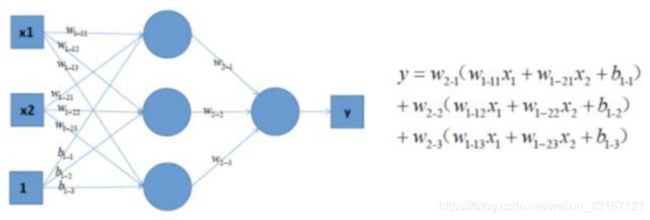

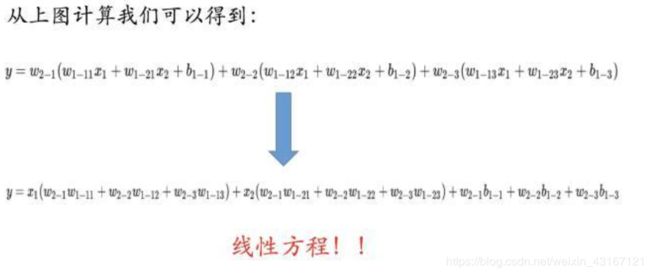

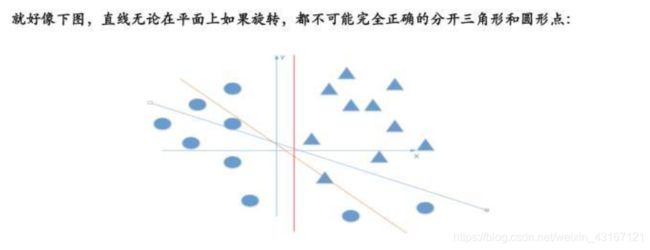

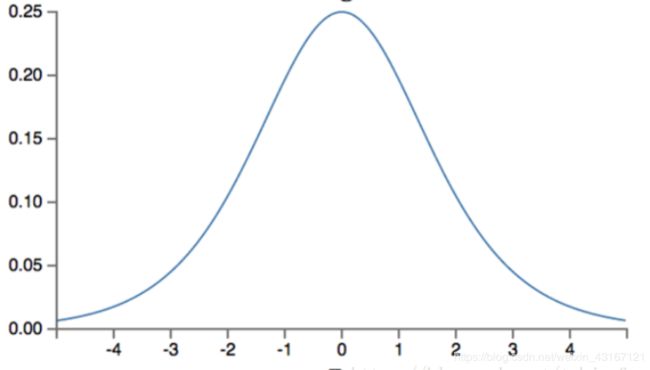

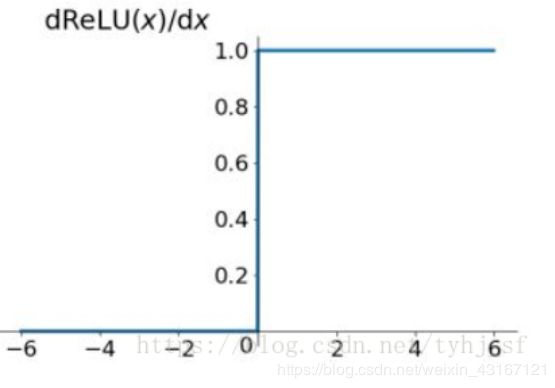

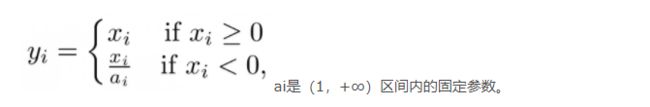

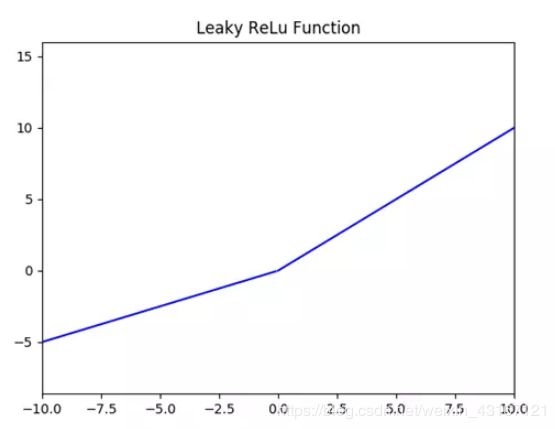

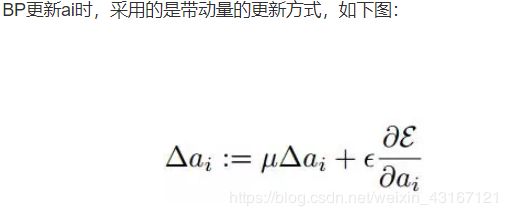

- 【DW11月-深度学习】Task03前馈神经网络

沫2021

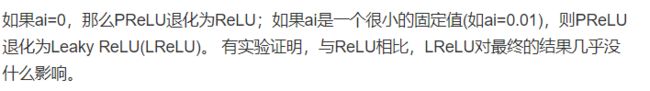

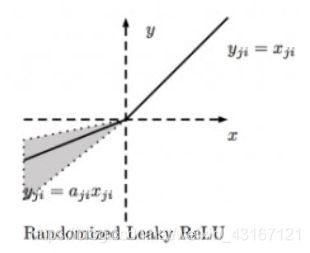

参考链接:https://datawhalechina.github.io/unusual-deep-learning/#/4.%E5%89%8D%E9%A6%88%E7%A5%9E%E7%BB%8F%E7%BD%91%E7%BB%9C一、神经元模型2.1神经元1943年,美国神经生理学家沃伦·麦卡洛克(WarrenMcCulloch)和数学家沃尔特·皮茨(WalterPitts)对生物神经元进行

- 仓库货物检测:基于YOLOv5的深度学习应用与UI界面开发

YOLO实战营

YOLO深度学习ui目标跟踪目标检测人工智能

一、引言随着电商和物流行业的快速发展,仓库货物管理已经成为企业运营中至关重要的环节。为了提高仓库管理的效率和准确性,越来越多的企业开始应用自动化技术来完成货物的盘点、分类、分拣等任务。传统的货物管理方式通常依赖人工检查,不仅效率低下,而且容易出现误差。为了克服这些问题,利用计算机视觉和深度学习技术来实现仓库货物的自动化检测成为了一种有效的解决方案。本博客将介绍如何使用YOLOv5进行仓库货物检测,

- Transformer:自注意力驱动的神经网络革命引擎

大千AI助手

人工智能Python#OTHERtransformer神经网络深度学习google人工智能机器学习大模型

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从语言理解到多模态智能的通用架构基石⚙️一、核心定义与历史意义Transformer是由Google团队在2017年论文《AttentionIsAllYouNeed》中提出的深度学习架构,其颠覆性创新在于:完全摒弃RNN/CNN:仅依赖自注意力机制(S

- [特殊字符] LLM(大型语言模型):智能时代的语言引擎与通用推理基座

大千AI助手

人工智能Python#OTHER语言模型人工智能自然语言处理LLM大模型Transformer

本文由「大千AI助手」原创发布,专注用真话讲AI,回归技术本质。拒绝神话或妖魔化。搜索「大千AI助手」关注我,一起撕掉过度包装,学习真实的AI技术!从千亿参数到人类认知的AI革命一、核心定义与核心特征LLM(LargeLanguageModel)是基于海量文本数据训练的深度学习模型,通过神经网络架构(尤其是Transformer)模拟人类语言的复杂规律,实现文本理解、生成与推理任务。其核心特征可概

- 深度学习模型开发部署全流程:以YOLOv11目标检测任务为例

你喜欢喝可乐吗?

deeplearningdeploy深度学习YOLO目标检测

深度学习模型开发部署全流程:以YOLOv11目标检测任务为例深度学习模型从开发到部署的完整流程包含需求分析、数据准备、模型训练、模型优化、模型测试和部署运行六大核心环节。YOLOv11作为新一代目标检测模型,不仅延续了YOLO系列的高效实时性能,还在检测精度和泛化能力上取得显著突破,使其成为工业质检、安防监控、自动驾驶等领域的理想选择。本文将详细阐述这一完整流程,并结合YOLOv11的具体实现,提

- 预测导管原位癌浸润性复发的深度学习:利用组织病理学图像和临床特征

浪漫的诗人

论文深度学习人工智能

文章目录研究内容目的方法数据集模型开发模型训练与评估外部验证统计分析研究结果模型性能风险分层外部验证特征重要性原文链接原文献:Deeplearningforpredictinginvasiverecurrenceofductalcarcinomainsitu:leveraginghistopathologyimagesandclinicalfeatures研究背景【DCIS与IBC的关联】乳腺导管

- 深度学习:让 AI 拥有 “思考” 能力的核心技术

田园Coder

人工智能科普人工智能科普

1.深度学习:突破传统的AI“进阶版”1.1什么是深度学习?深度学习是机器学习的一个分支,它通过模拟人脑神经网络的多层结构,让AI能够自动学习数据中的复杂特征,从而完成更高级的认知任务。例如,传统机器学习需要人类手动提取“猫有尖耳朵、胡须”等特征,而深度学习能直接从原始图片中,自主学习从像素到轮廓、再到整体形态的多层特征,最终实现更精准的识别。这种“自主提取特征”的能力,让深度学习突破了传统AI的

- PyTorch torch.no_grad() 指南(笔记)

拉拉拉拉拉拉拉马

pytorch人工智能python笔记深度学习

PyTorchtorch.no_grad()权威在PyTorch深度学习框架中,高效的显存管理对于训练复杂模型和执行大规模推理任务至关重要。显存不足(OutOfMemory,OOM)错误是开发者经常面临的挑战之一。torch.no_grad()作为PyTorch提供的一个核心工具,能够在推理(inference)和验证(validation)阶段显著优化显存使用并提升计算速度。本报告旨在全面、深入

- 【深度学习基础】PyTorch中model.eval()与with torch.no_grad()以及detach的区别与联系?

目录1.核心功能对比2.使用场景对比3.区别与联系4.典型代码示例(1)模型评估阶段(2)GAN训练中的判别器更新(3)提取中间特征5.关键区别总结6.常见问题与解决方案(1)问题:推理阶段显存爆掉(2)问题:Dropout/BatchNorm行为异常(3)问题:中间张量意外参与梯度计算7.最佳实践8.总结以下是PyTorch中model.eval()、withtorch.no_grad()和.d

- 探索OpenCV 3.2源码:计算机视觉的架构与实现

轩辕姐姐

本文还有配套的精品资源,点击获取简介:OpenCV是一个全面的计算机视觉库,提供广泛的功能如图像处理、对象检测和深度学习支持。OpenCV3.2版本包含了改进的深度学习和GPU加速特性,以及丰富的示例程序。本压缩包文件提供了完整的OpenCV3.2源代码,对于深入学习计算机视觉算法和库实现机制十分宝贵。源码的模块化设计、C++接口、算法实现、多平台支持和性能优化等方面的深入理解,都将有助于开发者的

- 院级医疗AI管理流程—基于数据共享、算法开发与工具链治理的系统化框架

Allen_Lyb

医疗高效编程研发人工智能算法时序数据库经验分享健康医疗

医疗AI:从“单打独斗”到“协同共进”在科技飞速发展的今天,医疗人工智能(AI)正以前所未有的速度改变着传统医疗模式。从最初在影像诊断、临床决策支持、药物发现等单一领域的“单点突破”,医疗AI如今已迈向“系统级协同”的新阶段。曾经,医疗AI的应用多集中在某一特定环节,比如利用深度学习算法分析医学影像,辅助医生进行疾病诊断。这种单点突破式的应用虽然在一定程度上提高了医疗效率,但随着医疗行业对AI技术

- jquery实现的jsonp掉java后台

知了ing

javajsonpjquery

什么是JSONP?

先说说JSONP是怎么产生的:

其实网上关于JSONP的讲解有很多,但却千篇一律,而且云里雾里,对于很多刚接触的人来讲理解起来有些困难,小可不才,试着用自己的方式来阐释一下这个问题,看看是否有帮助。

1、一个众所周知的问题,Ajax直接请求普通文件存在跨域无权限访问的问题,甭管你是静态页面、动态网页、web服务、WCF,只要是跨域请求,一律不准;

2、

- Struts2学习笔记

caoyong

struts2

SSH : Spring + Struts2 + Hibernate

三层架构(表示层,业务逻辑层,数据访问层) MVC模式 (Model View Controller)

分层原则:单向依赖,接口耦合

1、Struts2 = Struts + Webwork

2、搭建struts2开发环境

a>、到www.apac

- SpringMVC学习之后台往前台传值方法

满城风雨近重阳

springMVC

springMVC控制器往前台传值的方法有以下几种:

1.ModelAndView

通过往ModelAndView中存放viewName:目标地址和attribute参数来实现传参:

ModelAndView mv=new ModelAndView();

mv.setViewName="success

- WebService存在的必要性?

一炮送你回车库

webservice

做Java的经常在选择Webservice框架上徘徊很久,Axis Xfire Axis2 CXF ,他们只有一个功能,发布HTTP服务然后用XML做数据传输。

是的,他们就做了两个功能,发布一个http服务让客户端或者浏览器连接,接收xml参数并发送xml结果。

当在不同的平台间传输数据时,就需要一个都能解析的数据格式。

但是为什么要使用xml呢?不能使json或者其他通用数据

- js年份下拉框

3213213333332132

java web ee

<div id="divValue">test...</div>测试

//年份

<select id="year"></select>

<script type="text/javascript">

window.onload =

- 简单链式调用的实现技术

归来朝歌

方法调用链式反应编程思想

在编程中,我们可以经常遇到这样一种场景:一个实例不断调用它自身的方法,像一条链条一样进行调用

这样的调用你可能在Ajax中,在页面中添加标签:

$("<p>").append($("<span>").text(list[i].name)).appendTo("#result");

也可能在HQ

- JAVA调用.net 发布的webservice 接口

darkranger

webservice

/**

* @Title: callInvoke

* @Description: TODO(调用接口公共方法)

* @param @param url 地址

* @param @param method 方法

* @param @param pama 参数

* @param @return

* @param @throws BusinessException

- Javascript模糊查找 | 第一章 循环不能不重视。

aijuans

Way

最近受我的朋友委托用js+HTML做一个像手册一样的程序,里面要有可展开的大纲,模糊查找等功能。我这个人说实在的懒,本来是不愿意的,但想起了父亲以前教我要给朋友搞好关系,再加上这也可以巩固自己的js技术,于是就开始开发这个程序,没想到却出了点小问题,我做的查找只能绝对查找。具体的js代码如下:

function search(){

var arr=new Array("my

- 狼和羊,该怎么抉择

atongyeye

工作

狼和羊,该怎么抉择

在做一个链家的小项目,只有我和另外一个同事两个人负责,各负责一部分接口,我的接口写完,并全部测联调试通过。所以工作就剩下一下细枝末节的,工作就轻松很多。每天会帮另一个同事测试一些功能点,协助他完成一些业务型不强的工作。

今天早上到公司没多久,领导就在QQ上给我发信息,让我多协助同事测试,让我积极主动些,有点责任心等等,我听了这话,心里面立马凉半截,首先一个领导轻易说

- 读取android系统的联系人拨号

百合不是茶

androidsqlite数据库内容提供者系统服务的使用

联系人的姓名和号码是保存在不同的表中,不要一下子把号码查询来,我开始就是把姓名和电话同时查询出来的,导致系统非常的慢

关键代码:

1, 使用javabean操作存储读取到的数据

package com.example.bean;

/**

*

* @author Admini

- ORACLE自定义异常

bijian1013

数据库自定义异常

实例:

CREATE OR REPLACE PROCEDURE test_Exception

(

ParameterA IN varchar2,

ParameterB IN varchar2,

ErrorCode OUT varchar2 --返回值,错误编码

)

AS

/*以下是一些变量的定义*/

V1 NUMBER;

V2 nvarc

- 查看端号使用情况

征客丶

windows

一、查看端口

在windows命令行窗口下执行:

>netstat -aon|findstr "8080"

显示结果:

TCP 127.0.0.1:80 0.0.0.0:0 &

- 【Spark二十】运行Spark Streaming的NetworkWordCount实例

bit1129

wordcount

Spark Streaming简介

NetworkWordCount代码

/*

* Licensed to the Apache Software Foundation (ASF) under one or more

* contributor license agreements. See the NOTICE file distributed with

- Struts2 与 SpringMVC的比较

BlueSkator

struts2spring mvc

1. 机制:spring mvc的入口是servlet,而struts2是filter,这样就导致了二者的机制不同。 2. 性能:spring会稍微比struts快。spring mvc是基于方法的设计,而sturts是基于类,每次发一次请求都会实例一个action,每个action都会被注入属性,而spring基于方法,粒度更细,但要小心把握像在servlet控制数据一样。spring

- Hibernate在更新时,是可以不用session的update方法的(转帖)

BreakingBad

Hibernateupdate

地址:http://blog.csdn.net/plpblue/article/details/9304459

public void synDevNameWithItil()

{Session session = null;Transaction tr = null;try{session = HibernateUtil.getSession();tr = session.beginTran

- 读《研磨设计模式》-代码笔记-观察者模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.util.ArrayList;

import java.util.List;

import java.util.Observable;

import java.util.Observer;

/**

* “观

- 重置MySQL密码

chenhbc

mysql重置密码忘记密码

如果你也像我这么健忘,把MySQL的密码搞忘记了,经过下面几个步骤就可以重置了(以Windows为例,Linux/Unix类似):

1、关闭MySQL服务

2、打开CMD,进入MySQL安装目录的bin目录下,以跳过权限检查的方式启动MySQL

mysqld --skip-grant-tables

3、新开一个CMD窗口,进入MySQL

mysql -uroot

- 再谈系统论,控制论和信息论

comsci

设计模式生物能源企业应用领域模型

再谈系统论,控制论和信息论

偶然看

- oracle moving window size与 AWR retention period关系

daizj

oracle

转自: http://tomszrp.itpub.net/post/11835/494147

晚上在做11gR1的一个awrrpt报告时,顺便想调整一下AWR snapshot的保留时间,结果遇到了ORA-13541这样的错误.下面是这个问题的发生和解决过程.

SQL> select * from v$version;

BANNER

-------------------

- Python版B树

dieslrae

python

话说以前的树都用java写的,最近发现python有点生疏了,于是用python写了个B树实现,B树在索引领域用得还是蛮多了,如果没记错mysql的默认索引好像就是B树...

首先是数据实体对象,很简单,只存放key,value

class Entity(object):

'''数据实体'''

def __init__(self,key,value)

- C语言冒泡排序

dcj3sjt126com

算法

代码示例:

# include <stdio.h>

//冒泡排序

void sort(int * a, int len)

{

int i, j, t;

for (i=0; i<len-1; i++)

{

for (j=0; j<len-1-i; j++)

{

if (a[j] > a[j+1]) // >表示升序

- 自定义导航栏样式

dcj3sjt126com

自定义

-(void)setupAppAppearance

{

[[UILabel appearance] setFont:[UIFont fontWithName:@"FZLTHK—GBK1-0" size:20]];

[UIButton appearance].titleLabel.font =[UIFont fontWithName:@"FZLTH

- 11.性能优化-优化-JVM参数总结

frank1234

jvm参数性能优化

1.堆

-Xms --初始堆大小

-Xmx --最大堆大小

-Xmn --新生代大小

-Xss --线程栈大小

-XX:PermSize --永久代初始大小

-XX:MaxPermSize --永久代最大值

-XX:SurvivorRatio --新生代和suvivor比例,默认为8

-XX:TargetSurvivorRatio --survivor可使用

- nginx日志分割 for linux

HarborChung

nginxlinux脚本

nginx日志分割 for linux 默认情况下,nginx是不分割访问日志的,久而久之,网站的日志文件将会越来越大,占用空间不说,如果有问题要查看网站的日志的话,庞大的文件也将很难打开,于是便有了下面的脚本 使用方法,先将以下脚本保存为 cutlog.sh,放在/root 目录下,然后给予此脚本执行的权限

复制代码代码如下:

chmo

- Spring4新特性——泛型限定式依赖注入

jinnianshilongnian

springspring4泛型式依赖注入

Spring4新特性——泛型限定式依赖注入

Spring4新特性——核心容器的其他改进

Spring4新特性——Web开发的增强

Spring4新特性——集成Bean Validation 1.1(JSR-349)到SpringMVC

Spring4新特性——Groovy Bean定义DSL

Spring4新特性——更好的Java泛型操作API

Spring4新

- centOS安装GCC和G++

liuxihope

centosgcc

Centos支持yum安装,安装软件一般格式为yum install .......,注意安装时要先成为root用户。

按照这个思路,我想安装过程如下:

安装gcc:yum install gcc

安装g++: yum install g++

实际操作过程发现,只能有gcc安装成功,而g++安装失败,提示g++ command not found。上网查了一下,正确安装应该

- 第13章 Ajax进阶(上)

onestopweb

Ajax

index.html

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/

- How to determine BusinessObjects service pack and fix pack

blueoxygen

BO

http://bukhantsov.org/2011/08/how-to-determine-businessobjects-service-pack-and-fix-pack/

The table below is helpful. Reference

BOE XI 3.x

12.0.0.

y BOE XI 3.0 12.0.

x.

y BO

- Oracle里的自增字段设置

tomcat_oracle

oracle

大家都知道吧,这很坑,尤其是用惯了mysql里的自增字段设置,结果oracle里面没有的。oh,no 我用的是12c版本的,它有一个新特性,可以这样设置自增序列,在创建表是,把id设置为自增序列

create table t

(

id number generated by default as identity (start with 1 increment b

- Spring Security(01)——初体验

yang_winnie

springSecurity

Spring Security(01)——初体验

博客分类: spring Security

Spring Security入门安全认证

首先我们为Spring Security专门建立一个Spring的配置文件,该文件就专门用来作为Spring Security的配置