Shell脚本入门(二)cut&sed&awk&sort

目录

1、函数

2、Shell工具之cut

3、shell工具之sed

4、shell工具之awk

5、shell工具之sort

1、函数

(一)系统函数

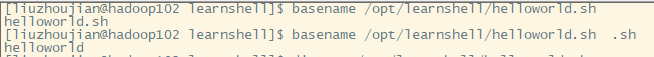

①basename: 将文件全路径中最后一个/(包括/)前的字符串去掉,然后将字符串显示出来。

语法: basename [pathname] [suffix]

其中pathname为文件全路径,[suffix]为文件后缀,要是加上[suffix],则会将文件后缀也会删掉。

②dirname:将文件全路径中包含文件名称的那部分去掉,仅显示出目录部分。

(二)自定义函数

注意:函数必须在使用之前声明,因为shell脚本是逐行执行的。

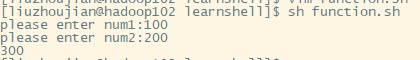

练习:使用函数计算两个数字之和。

#!/bin/bash

function sum() {

sum=$[$1+$2]

echo $sum

}

read -p "please enter num1:" NUM1

read -p "please enter num2:" NUM2

sum $NUM1 $NUM2

2、Shell工具之cut

cut命令:从文件的每一行剪切字节、字符和字段,并将这些字节、字符、字段等输出。

基本语法: cut [参数] [文件名]

参数: -f :提取第几列

-d: 以什么为分隔符

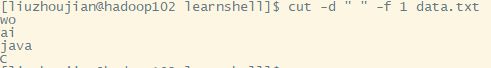

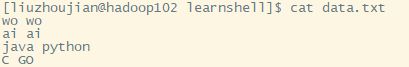

练习:1、准备数据文件

wo wo

ai ai

java python

C GO2、从数据文件中剪切第一列

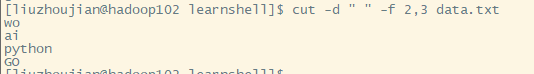

3、从数据文件中剪切第二、第三列

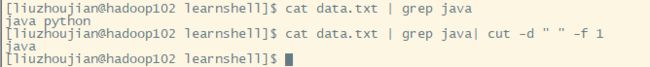

4、从数据文件中切割出Java

5、切割出系统变量PATH中第二个:后面的所有字符串

[liuzhoujian@hadoop102 learnshell]$ echo $PATH

/usr/lib64/qt-3.3/bin:/usr/local/bin:/bin:/usr/bin:/usr/local/sbin:/usr/sbin:/sbin:/opt/moudle/jdk1.7.0_79/bin:/opt/moudle/hadoop-2.7.2/bin:/opt/moudle/hadoop-2.7.2/sbin:/home/liuzhoujian/bin

[liuzhoujian@hadoop102 learnshell]$ echo $PATH | cut -d ":" -f 2-

/usr/local/bin:/bin:/usr/bin:/usr/local/sbin:/usr/sbin:/sbin:/opt/moudle/jdk1.7.0_79/bin:/opt/moudle/hadoop-2.7.2/bin:/opt/moudle/hadoop-2.7.2/sbin:/home/liuzhoujian/bin

[liuzhoujian@hadoop102 learnshell]$

其中-f 2-, 表示第二列后面所有字符串。

6、切割出ifconfig eth0中的ip地址

[liuzhoujian@hadoop102 learnshell]$ ifconfig eth0

eth0 Link encap:Ethernet HWaddr 00:0C:29:13:5E:72

inet addr:192.168.1.102 Bcast:192.168.1.255 Mask:255.255.255.0

inet6 addr: fe80::20c:29ff:fe13:5e72/64 Scope:Link

UP BROADCAST RUNNING MULTICAST MTU:1500 Metric:1

RX packets:5023 errors:0 dropped:0 overruns:0 frame:0

TX packets:2658 errors:0 dropped:0 overruns:0 carrier:0

collisions:0 txqueuelen:1000

RX bytes:521807 (509.5 KiB) TX bytes:549276 (536.4 KiB)

[liuzhoujian@hadoop102 learnshell]$ ifconfig eth0 | grep "inet addr"

inet addr:192.168.1.102 Bcast:192.168.1.255 Mask:255.255.255.0

[liuzhoujian@hadoop102 learnshell]$ ifconfig eth0 | grep "inet addr" | cut -d ":" -f 2

192.168.1.102 Bcast

[liuzhoujian@hadoop102 learnshell]$ ifconfig eth0 | grep "inet addr" | cut -d ":" -f 2 | cut -d " " -f 1

192.168.1.102

3、shell工具之sed

sed是一种流编辑器,一次处理一行内容。处理时,把当前处理的行存储在临时缓冲区中,称为“模式空间”,接着用sed命令处理缓冲区中内容,处理完后,把缓冲区中的内容送往屏幕。接着处理下一行,这样不断重复,直到文件末尾。文件内容并没有改变,除非使用重定向存储输出。

基本用法:

sed [选项参数] 'command' filename

选项参数说明:

-e 直接在指令列模式上进行sed的动作编辑

命令功能描述:

a 新增,a的后面可以接子串,在下一行出现

d 删除

s 查找并替换

练习:1、准备数据

[liuzhoujian@hadoop102 learnshell]$ cat data.txt

wo wo

ai ai

java python

C GO2、将“hello”这个词添加到data.txt的第二行并打印

[liuzhoujian@hadoop102 learnshell]$ sed '2a hello' data.txt

wo wo

ai ai

hello

java python

C GO其中2 代表第二行, a代表添加

注意:此时原文件并没有发生改变

3、删除data.txt中包含wo的行

[liuzhoujian@hadoop102 learnshell]$ sed '/wo/d' data.txt

ai ai

java python

C GO4、将data.txt中的wo替换成ni

[liuzhoujian@hadoop102 learnshell]$ sed 's/wo/ni/g' data.txt

ni ni

ai ai

java python

C GO

s替换 g代表global,全部替换5、将文件第二行删除并将wo替换成ni

[liuzhoujian@hadoop102 learnshell]$ sed -e '2d' -e 's/wo/ni/g' data.txt

ni ni

java python

C GO4、shell工具之awk

awk是一个强大的文本分析工具,把文本逐行读入,以空格为默认分隔符将每行切片,切开的部分再进行分析处理。

基本用法:

awk [可选参数] 'pattern1{action1} pattern2{action2} ... ' filename

pattern: 表示awk在数据中心查找的内容,就是匹配模式

action:在找到匹配内容时所执行的一系列命令

可选参数说明:

-F 指定输入文件分隔符

-v 赋值一个用户自定义变量

练习:1、数据准备 复制一份/etc/passwd文件作为数据文件

2、输出passwd文件中以root开头的所有行,并输出该行的第七列。

[liuzhoujian@hadoop102 learnshell]$ awk -F ":" '/^root/{print $7}' passwd

/bin/bash3、搜索passwd文件以root关键字开头的所有行,并输出该行的第1列和第7列,中间以“,”号分割

[liuzhoujian@hadoop102 learnshell]$ awk -F ":" '/^root/{print $1 "," $7}' passwd

root,/bin/bash4、只显示/etc/passwd的第一列和第七列,以逗号分割,且在所有行前面添加列名user,shell在最后一行添加"dahaige,/bin/zuishuai"

[liuzhoujian@hadoop102 learnshell]$ awk -F ":" 'BEGIN{print "user, shell"}{print $1 "," $7} END{print "dahaige,/bin/zuishuai"}' passwd

user, shell

root,/bin/bash

bin,/sbin/nologin

...........

dahaige,/bin/zuishuai注意:BEGIN 在所有数据读取行之前执行;END 在所有数据执行之后执行。

5、将passwd文件中的用户id增加数值1并输出

[liuzhoujian@hadoop102 learnshell]$ awk -v i=1 -F ":" '{print $3+i}' passwd

1

2

...awk内置变量

FILENAME 文件名

NR 已读的记录数

NR 切割后,域的个数

练习1:统计passwd文件名,每行的行号,每行的列数

[liuzhoujian@hadoop102 learnshell]$ awk -F: '{print "filename:" FILENAME ",linenumber:" NR ",columns:" NF}' passwd

filename:passwd,linenumber:1,columns:7

filename:passwd,linenumber:2,columns:7

filename:passwd,linenumber:3,columns:7

filename:passwd,linenumber:4,columns:7

filename:passwd,linenumber:5,columns:7练习2:切割IP

[liuzhoujian@hadoop102 learnshell]$ ifconfig eth0 | grep "inet addr" | awk -F: '{print $2}' | awk -F " " '{print $1}'

192.168.1.102练习3:查询data.txt中空行所在的行号

[liuzhoujian@hadoop102 learnshell]$ cat data.txt

wo wo

ai ai

java python

C GO

[liuzhoujian@hadoop102 learnshell]$ awk '/^$/{print NR}' data.txt

35、shell工具之sort

sort用于将文件进行排序,将排序结果标准输出。

基本语法: sort (选项)(参数)

-n 将按照数值排序

-r 以相反的顺序排序

-k 指定排序的列

-t 设置排序时所用的分隔符

练习:(1)数据准备

[liuzhoujian@hadoop102 learnshell]$ cat sort.txt

s:10:3.5

bb:40:5.4

bd:20:4.2

xz:50:2.3

cls:10:3.5

ss:30:1.6

(2)按照“:”分割后的第三列倒序排序

[liuzhoujian@hadoop102 learnshell]$ sort -t : -nrk3 sort.txt

bb:40:5.4

bd:20:4.2

s:10:3.5

cls:10:3.5

xz:50:2.3

ss:30:1.6补充真题:

问题:有文件add.txt内容如下:

张三 40

李四 50

王五 60

使用Linux命令计算第二列的和并输出?

[liuzhoujian@hadoop102 learnshell]$ cat add.txt | awk -F " " '{sum+=$2} END{print sum}'

150问题:请用shell脚本写出查找当前文件夹下所有的文本文件内容中包含有字符”wo”的文件名称

[liuzhoujian@hadoop102 learnshell]$ grep -r "wo" /opt/learnshell/

/opt/learnshell/data.txt:wo wo

/opt/learnshell/helloworld.sh:echo "helloworld"

[liuzhoujian@hadoop102 learnshell]$ grep -r "wo" /opt/learnshell/ | cut -d ":" -f 1

/opt/learnshell/data.txt

/opt/learnshell/helloworld.sh