centos6下搭建ELK-6.5.3

安装准备

内存最少4G

jdk环境1.8

关闭防火墙与内核机制

service iptables stop && setenforce 0

1. 配置java环境1.8

vim /etc/profile

#set java

export JAVA_HOME=/usr/local/jdk1.8.0_162

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jar

source /etc/profile

2. 编辑/etc/security/limits.conf 配置文件, 添加类似如下内容:

* soft nofile 65536

* hard nofile 131072

* soft nproc 2048

* hard nproc 4096

3. 编辑/etc/security/limits.d/90-nproc.conf配置文件, 添加类似如下内容:

* soft nproc 10240 (原为1024)

4. 编辑/etc/sysctl.conf 配置文件, 添加类似如下内容:

vm.max_map_count = 655360

加载命令: sysctl -p

1. 创建运行ELK的用户

[root@localhost local]# groupadd elk

[root@localhost local]# useradd -g elk elk

2、创建目录

mkdir /opt/elk/data

mkdir /opt/elk/logs

3、安装ELK

以下由elk用户操作

以elk用户登录服务器

解压命令:tar -xzvf elasticsearch-6.5.3.tar.gz (elk三个软件包的版本都要一致)

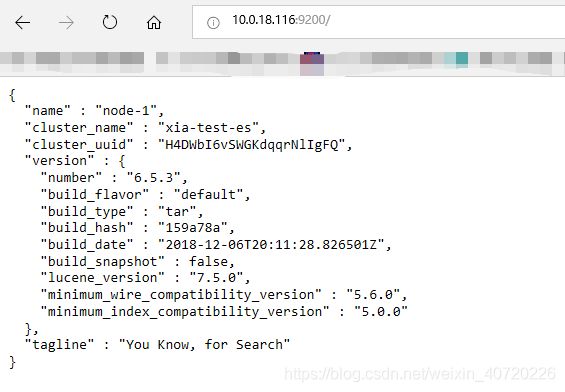

4. 配置Elasticsearch

vim /opt/elk/elasticsearch-6.5.3/config/elasticsearch.yml 新增以下内容

cluster.name: xia-test-es

node.name: node-1

path.data: /opt/elk/data

path.logs: /opt/elk/logs

bootstrap.memory_lock: false

bootstrap.system_call_filter: false

network.host: 10.0.18.116(本地ip)

http.port: 9200

5. 启动Elasticsearch

./bin/elasticsearch &

6. 查看端口号

netstat -ant

7. 访问

Elasticsearch安装完毕

安装logstash

logstash是ELK中负责收集和过滤日志的

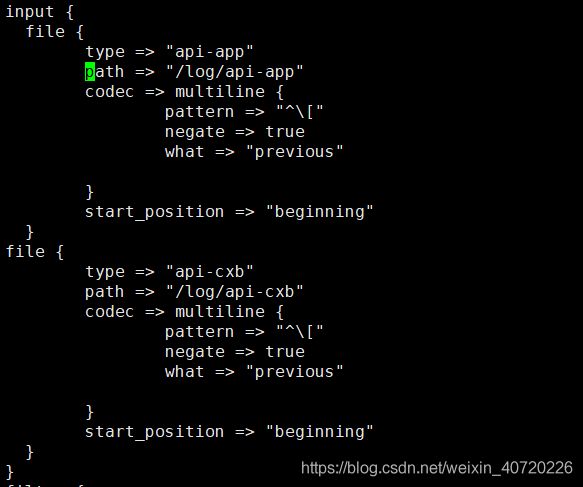

编写配置文件 如下:

解释:

logstash的配置文件须包含三个内容:

input{}:此模块是负责收集日志,可以从文件读取、从redis读取或者开启端口让产生日志的业务系统直接写入到logstash

filter{}:此模块是负责过滤收集到的日志,并根据过滤后对日志定义显示字段

output{}:此模块是负责将过滤后的日志输出到elasticsearch或者文件、redis等

本环境采用从文件读取日志,业务系统产生日志的格式如下:

[2016-11-05 00:00:03,731 INFO] [http-nio-8094-exec-10] [filter.LogRequestFilter] - /merchant/get-supply-detail.shtml, IP: 121.35.185.117, [device-dpi = 414*736, version = 3.6, device-os = iOS8.4.1, timestamp = 1478275204, bundle = APYQ9WATKK98V2EC, device-network = WiFi, token = 393E38694471483CB3686EC77BABB496, device-model = iPhone, device-cpu = , sequence = 1478275204980, device-uuid = C52FF568-A447-4AFE-8AE8-4C9A54CED10C, sign = 0966a15c090fa6725d8e3a14e9ef98dc, request = {

"supply-id" : 192

}]

[2016-11-05 00:00:03,731 DEBUG] [http-nio-8094-exec-10] [filter.ValidateRequestFilter] - Unsigned: bundle=APYQ9WATKK98V2EC&device-cpu=&device-dpi=414*736&device-model=iPhone&device-network=WiFi&device-os=iOS8.4.1&device-uuid=C52FF568-A447-4AFE-8AE8-4C9A54CED10C&request={

"supply-id" : 192

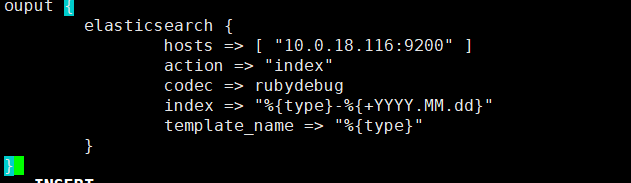

output直接输出到Elasticsearch

本环境需处理两套业务系统的日志

type:代表类型,其实就是将这个类型推送到Elasticsearch,方便后面的kibana进行分类搜索,一般直接命名业务系统的项目名

path:读取文件的路径

![]()

这个是代表日志报错时,将报错的换行归属于上一条message内容

start_position => "beginning"是代表从文件头部开始读取

filter{}中的grok是采用正则表达式来过滤日志,其中%{TIMESTAMP_ISO8601}代表一个内置获取2016-11-05 00:00:03,731时间的正则表达式的函数,%{TIMESTAMP_ISO8601:date1}代表将获取的值赋给date1,在kibana中可以体现出来

本环境有两条grok是代表,第一条不符合将执行第二条

其中index是定义将过滤后的日志推送到Elasticsearch后存储的名字

%{type}是调用input中的type变量(函数)

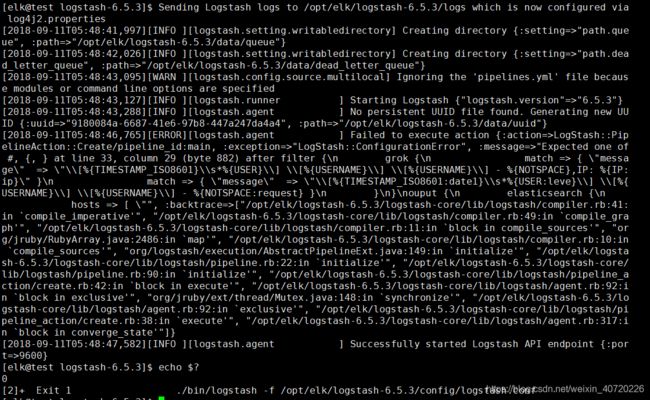

启动logstash

代表启动成功

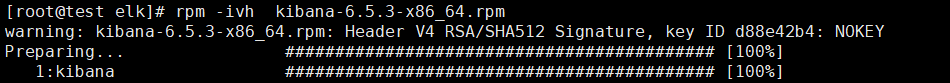

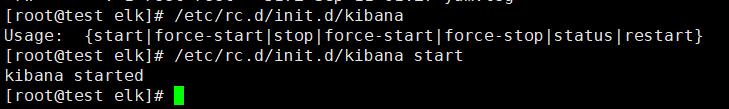

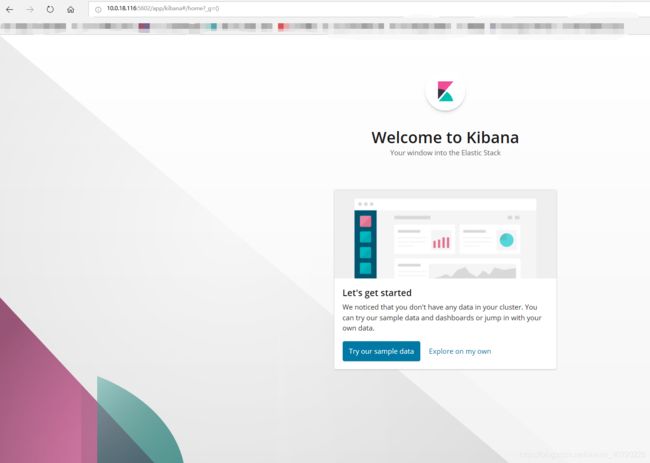

安装kibana

编辑配置文件 /etc/kibana/kibana.yml

启动kibana /etc/rc.d/init.d/kibana start

部分内容参考 https://www.cnblogs.com/onetwo/p/6059231.html