研究僧上了一年,虽说研究的是CV方面的东西,但基本还是处于小白阶段,忙来忙去不知道忙了些啥就这么荒废了一年(捂脸跑),最近接触了一些三维重建方面的内容,一直也对这方面的东西比较感兴趣,像什么建筑重建啦,医学影像重建啦etc,并不是对测绘遥感类的三维重建不感兴趣,而是感觉学不懂hhhhh,因为测绘方面的三维重建往往要考虑很多GIS(Geographic Information System) 的内容和地貌及一些地理专业知识,毕竟不是专业人士,所以做起来还是比较费劲的。此文是想分享一下自己入门三维重建的一些学习笔记,也引用了网上一些大牛的博客,讲的蛮清晰地,同时分享几篇论文供大家学习参考。

三维重建(3D Reconstruction)入门

1. 数学知识储备

不管哪门方向,感觉接触到CV领域,数学都是必不可少的东西(大实话)。想在CV领域有一番建树的话,数学当然是要研究的十分透彻的。对于这个领域来说,就目前而言最重要的可能还是矩阵方面(矩阵论这门课一定要好好学啊!学长没有好好学请引以为戒,所以现在备受折磨),所以需要有蛮好的线性代数基础,因为大部分是矩阵相乘及一些范数的运算。加上目前神经网络这么火,一个神经网络中大都包含一系列复杂的矩阵计算过程(因为图像通常用矩阵表示),So矩阵论算是三维重建的重中之重!务必学好数学。

2. 三维重建分类

在网络上其实可以搜到很多有关三维重建的分类,不过分类尺度不尽相同,分享一个比较细致的分类(主被动式分类)。在这篇博文中主要是分为了主动式重建和被动式重建,而在我接触目前,还主要是立体视觉重建(被动式重建中的一种方法),其主要包括直接利用测距器获取程距信息、通过一幅图像推测三维信息和利用不同视点上的两幅或多幅图像恢复三维信息等三种方式。第一种方法顾名思义,需要配合测距器获得信息;第二种方法目前为止还不成熟,因为由一幅图像想要恢复三维模型中的所有信息十分困难,一方面一幅图像包含的信息有限,另一方面推测出的信息可能会与原物体有误差。同时一般这类方法对图像要求较高,需要图像中最好本身具有深度信息,目前比较简单且能拍出深度图像的设备可以使用Kinect。第三种方法则是比较常用的重建方法,因为只需要普通的RGB图像,在原图像获取方面比较简单,但可想而知,对于仅用RGB图像恢复三维模型方法,必定会使用很多图像,且需要对图像两两匹配来达到较好的效果,所以大大延长了运算时间,导致效率不高,在下文中会进一步介绍。

3. 立体视觉法

传统的立体成像系统使用两个放在一起的摄像机,平行面向待重建的物体。此方法在概念上,类似人类借由双眼感知的图像相叠推算深度(当然实际上人脑对深度信息的感知历程会更加复杂),若已知两个摄影机的彼此间距与焦距长度,而截取的左右两张图片又能成功叠合,则深度信息可迅速推得。此方法必须依赖有效的图片像素匹配(correspondence analysis),一般使用模板比对(Block Matching)或对极几何(Epipolar Geometry)算法完成。使用两个摄影机的立体视觉法又称做双目立体视觉(Binocular Stereo Vision)。

4. 深度图像

在上文中提到过使用深度图像恢复三维模型的方法,在计算机视觉系统中,三维场景信息为图像分割、目标检测、物体跟踪等各类计算机视觉应用提供了更多的可能性,所以在此也介绍一下深度图像的概念。深度图像(Depth map)作为一种普遍的三维场景信息表达方式得到了广泛的应用,深度图像的每个像素点的灰度值可用于表征场景中某一点距离摄像机的远近。

在初步实践三维重建的过程中,由于我使用的是立体视觉法,所以对于深度图像的获取 及三维模型生成不做过于详细的介绍,只需了解深度图像的概念即可,但若能获取深度图像,则重建过程会更加方便获取位置信息,后续会进一步研究。

三维重建最主要的算法应该就是SfM了吧,使用这种方法的软件比较代表性的有 Pix4D mapper, Autodesk 123D Catch,PhotoModeler, VisualSFM。原谅po主只是初探所以只试了VisualSFM,并将介绍SfM的思想,之后可能会有更进一步的研究略略略。

SfM (Structure from Motion) 介绍

SfM是干嘛用的?关于SfM的具体介绍可以参考Wiki百科上的简介,从SfM的英文构成(运动恢复法)也可以看出,SfM采用的是通过一组图片恢复三维模型。

图片来自于Photo Tourism: Exploring Photo Collection In 3D,算是三维重建中比较出名的一篇论文了,被引量有2000+,文中比较详细的讲述了使用多幅图像重建三维建筑模型的过程,介绍了如何根据相机参数的变化确定对应点的相关关系,从而恢复三维信息,同时论文也给了short video演示。关于相机标定应用的提出应该是比较早的一篇论文Self-Calibration and Metric Reconstruction Inspite of Varying and Unknown Intrinsic Camera Parameters 。至于什么是相机标定,可以参考相机标定(Camera calibration)。成熟的SfM中最后会有Bundle Ajustment优化,中文翻译个人比较喜欢光束平差法,感觉这个翻译更贴合它的原理。关于BA优化的文章很多也很复杂,同时对BA优化的改进算法也有很多,一不小心可能会沉迷其中不能自拔,由于是初探,所以也还没有涉及那么深的内容,这篇文也只是想普及一下三维重建的一些知识而已,关于BA优化,推荐一篇讲的比较详细的论文Bundle Adjustment —A Modern Synthesis,同时也可以参考一个博主讲的BA优化原理。

讲完了一些先述知识之后,就讲一下SfM的具体流程。

SfM算法是基于无序图片的三维重建算法,在其核心算法之前首先需要挑选合适的图片来确定相机参数之后再进行核心计算。具体步骤主要有以下几步:

(1)特征提取

主要使用的是SIFT算子进行提取,SIFT 特征是基于物体上的一些局部外观的兴趣点而与影像的大小和旋转无关,具有尺度和旋转不变性,对光线、噪声、微视角改变的容忍度相当高,鲁棒性强,适合用来提取尺度变换和旋转角度的各种图片特征点信息,其准确性强。关于SIFT的详细介绍可以参考Wiki百科。

一个SIFT特征有四个部分(位置position, 大小scale, 方向direction, 描述向量descriptor)

(2)Match and Track

每个图片的特征点被提出来以后,就需要进行图片两两之间的特征点匹配并建立track:

使用K-d tree算法计算最近邻匹配。令最近邻的距离为d1,再找到第二近的匹配对点之间距离为d2,如果两个距离d1和d2之比小于一个阈值0.5,就可以判定为可接受的匹配对。

对于图片特征点的匹配和track一篇知乎问题写的蛮详细的,贴出链接https://www.zhihu.com/question/29885222大家可以去看一下算法实现,SIFT、ANN、RANSAC也有实现代码,并且后期的BA优化算法、稠密点云实现CMVS/PMVS也有实现,也有助于理解之后的操作。匹配关系建立后,需要生成track列表,指同名点的图像集合。

(3)三维点计算

首先图像中可能匹配多个特征点,就会出现多对一的情况,实际上特征点之间应该一一对应。所以还需要一个去除重复特征点匹配对的算法去解决这种多对一的情况 (对匹配点可采用采样一致性算法RANSC八点法计算基础矩阵,剔除不满足基础矩阵的匹配对)。

用RANSAC和八点算法可以将嘈杂的匹配结果稳定化

最终可以按照两幅图像中的匹配特征点数不少于一个阈值即为图像初选匹配对。但图像初选对有时并不可靠,所以需要使用几何约束检测其可靠性。几何约束是基于事实的,不是所有的特征点都符合物理规律,所以需要计算对极几何。对极几何在上文中有给出链接,可以参考其原理。

初始化匹配对的相对定向,根据RANSC八点法计算本征矩阵,通过对本征矩阵SVD分解得到第二个图像的R、T(旋转、平移矩阵),在这一步需要进行畸变校正,然后根据R、T和矫正后的像点坐标三角计算出三维点,这里用到的方法是直接线性变换DLT。最终需要将图片中的像素坐标信息联系起来,并包含相机内参信息。

描述摄像机的外参数用到3x3的旋转矩阵R和1x3的平移向量 (或者摄像机中心坐标向量),而摄像机的内参数用一个焦距f和两个径向畸变参数k1和k2描述。

(4)稀疏重建

加入更多的图像,与之前的图像进行匹配,然后计算R、T,推算出三维点信息,从而构成稀疏点云。

(5)Bundle Ajustment

光束法平差(Bundle Adjustment),是一个非线性优化的过程。目的是使重建误差降低到最小,通过调整三维点的旋转平移矩阵及三维点信息使反向投影差最小。

Bundle Adjustment是一个迭代的过程,在一次迭代过后,将所有三维点反向投影到相应图像的像素坐标并分别与初始坐标比对,如果大于某个阈值,则应将其从track列表中去掉,如果track中已小于2个,则整个track也去掉,一直优化到没有点可去为止。

(4)、(5)是稀疏点云的重建过程,实际上在之后一般会使用CMVS/PMVS进行稠密点云重建,恢复更多的三维信息,以便于更好地建立三维模型,至于CMVS/PMVS的实现,在上文提到的知乎问题中也有讲解和实现。

VisualSFM

前文提到过,使用SfM的软件有很多,我实验的是VisualSFM。这个软件是论文Towards Linear-Time Incremental Structure from Motion中给出的开源软件,具体内容也可以在作者提供的网站上看到http://ccwu.me/vsfm/。在论文中一方面详细的讨论了SfM的框架,另一方面也讲解了对于BA优化的一种改进,引入了preconditioned conjugate gradient(PCG),从而大大减少了时间复杂度,这也是在SfM算法提出后首先出现的比较完整的且可以开放使用的三维重建软件。在安装VisualSFM之前需要配置OpenCV环境,至于软件细致安装可以参考作者提供的网站或网络上其他的安装教程,叙述相对都比较全面,且讲述了操作流程。

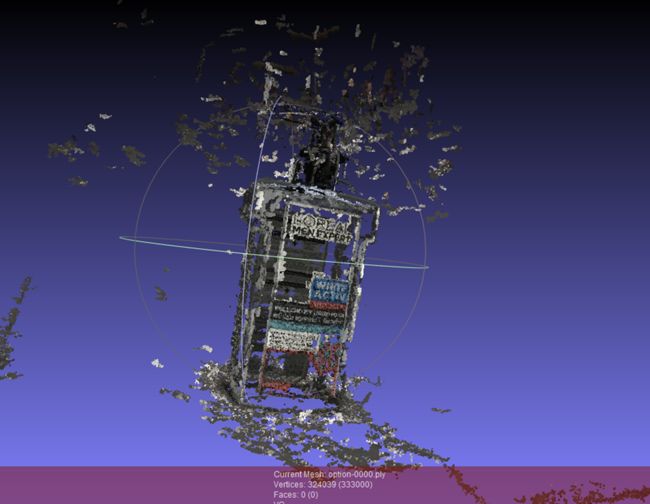

下面给出一些实验图,用的是LOREAL的洗面奶emmmm做了尝试,用iP7拍了58张照片,照片分辨率是3024*4032。重建稀疏点云的过程耗时并不长,但使用CMVS/PMVS进行稠密点云重建则要花费蛮长的时间。洗面奶的结构相对简单,且仅有58张照片,即使分辨率挺高的,但重建花的时间并没有很长,不过运行时间和物品的结构复杂度有关系,尝试过学校里的一个几何雕塑,用了6h左右,而且跑程序的时候电脑太卡了,一直在哀嚎,什么也做不了hhhhh

使用VisualSFM重建出来的点云数据一般需要模型软件进行操作,也有很多可供选择。我使用的是MeshLab,因为MeshLab提供源码,也可以看到一些代码的实现过程,且较为常用吧。很多人可能会问重建出来的这个也太丑了= =,讲真我也这么觉得,不过这种方法重建出来的模型,一般都需要进一步后期对模型进行优化,比如填充,圆角之类的操作,所以这也不是重建的最终态,只是出于太懒了所以还没有细化。

我觉得SfM方法三维重建中最复杂的应该是图像的特征提取与匹配、计算相机的内参外参,从而推算三维点坐标的过程。这种方法是利用点云数据堆而成的模型,所以一般在模型软件中也会先对点云的一些多余点进行去除,这样在后期的模型优化中也会更加便捷。

SfM算是三维重建的一种传统方法,因为现在的发展来看,如何分析物体的结构特征,不仅提取图像特征,还提取出图像中的结构和方位信息已经成为关注点,这样恢复出的三维模型可能会具有更精确的信息,且不用进行复杂的匹配工作,耗费时间且效率低下,根据物体的三维信息检索物体并对物体进行分析,目前也已经有一定的研究成果,在之后的研究中,可能也会关注些这方面的内容,并进行分析,blablabla~但新事物的产生并不能对传统方法全盘否定,所以对于SfM,我觉得他中间的一些步骤还是可以进行更进一步的优化的,在时间花费上可能能得到进一步的提升,或者考虑传统方法与前沿方法结合的方法可能也能达到意想不到的结果。