- Linux Media 子系统 V4l2

aningxiaoxixi

cameralinux服务器网络

一创建V4l2的entity在Linux内核的MediaController框架中,V4L2设备作为实体(entity)的注册过程涉及以下步骤:1.初始化MediaController结构驱动首先创建一个media_device实例,并与V4L2设备(如v4l2_device)关联。例如:structmedia_device*mdev=devm_kzalloc(dev,sizeof(*mdev),

- 【CXX】1 CXX主要概念概览

Source.Liu

CXXrustCXXc++

本文描述了CXX(一个用于在Rust和C++之间进行桥接的库)中的关键概念,特别是FFI(外部函数接口)边界所涉及的三种主要类型:共享结构体、不透明类型和函数。一、示例代码#[cxx::bridge]modffi{//任何共享结构,其字段对两种语言都是可见的。structBlobMetadata{size:usize,tags:Vec,}extern"Rust"{//两种语言都可以传递零个或多个不

- Express 中间件分类

yqcoder

vue.js前端javascript

一、按功能用途分类1.应用级中间件这类中间件应用于整个Express应用程序,会对每个进入应用的请求进行处理。通过`app.use()`方法挂载,可用于执行一些全局性的任务,像日志记录、请求预处理、设置响应头这类操作。constexpress=require("express");constapp=express();//记录请求日志的应用级中间件app.use((req,res,next)=>{

- git的基本操作

NeoFive

git使用git

教程地址:https://www.liaoxuefeng.com/wiki/0013739516305929606dd18361248578c67b8067c8c017b0001.安装linuxinstallgit:sudoapt-getinstallgitinstallwithsource:先从Git官网下载源码,然后解压,依次输入:./config,make,sudomakeinstall这几

- git bash常用命令

qq_37457269

gitbashelasticsearch

GitBash是一个用于在Windows上执行Git命令的命令行工具,它提供了一个类似于Linux的终端环境,允许用户执行各种Git操作。以下是一些常用的GitBash命令及其说明:配置相关gitconfig--globaluser.name“YourName”:设置全局用户名。gitconfig--globaluser.email“youremail@example.com”:设置全局用户邮箱。

- Uniswap V3:流动性提取和收集

OpenBuild.xyz

Uniswap人工智能智能合约web3区块链去中心化

作者:WongSSH引言本系列文章将带领读者从零实现UniswapV3核心功能,深入解析其设计与实现。主要参考了Constructor|UniswapV3CoreContractExplained系列教程、UniswapV3DevelopmentBook和Paco博客中的相关内容。所有示例代码可在clamm代码库中找到,以便实践和探索。流动性提取和收集进行流动性的提取实际上就是mint函数的反向操

- 博客之星2024年度总评选,期待您的支持!

IT枫斗者

JAVA基础工作中实际总结编程学习gitjava开发语言golang后端

博客之星2024年度总评选,期待您的支持!亲爱的读者朋友们:先投票:https://www.csdn.net/blogstar2024/detail/229大家好!时光荏苒,岁月如梭,转眼间,2024年已接近尾声。这一年,我在博客里的世界不断探索、成长,也收获了无数的感动与回忆。如今,我有幸参与博客之星2024年度总评选,内心满是期待与激动。在此,我想向一直以来陪伴我的每一位读者朋友说一声:感谢有

- pd虚拟机 [po] Parallels Desktop 20

甜于酸

虚拟机服务器centos

介绍ParallelsDesktop20,是一款Mac虚拟机软件,在搭载AppleM系列芯片的任何Mac上运行Windows,体验不同操作系统之间无缝集成。使用ParallelsDesktop20forMac体验macOS和Windows的双重最优性能,解锁强大性能和无缝交互,全新的ParallelsDesktop20forMac支持苹果macOSSequoia15,提升了应用在该系统效果下载●P

- Python基于Django的漏洞扫描系统【附源码、文档说明】

Java老徐

Python毕业设计pythondjango漏洞扫描系统漏洞扫描Python漏洞扫描系统PythonDjango

博主介绍:✌Java老徐、7年大厂程序员经历。全网粉丝12w+、csdn博客专家、掘金/华为云/阿里云/InfoQ等平台优质作者、专注于Java技术领域和毕业项目实战✌文末获取源码联系精彩专栏推荐订阅不然下次找不到哟2024-2025年Java毕业设计选题推荐Python基于Django的微博热搜、微博舆论可视化系统(V3.0)基于PythonDjango的北极星招聘数据可视化系统感兴趣的可以先收

- Zookeeper(21)Zookeeper的架构组成有哪些?

辞暮尔尔-烟火年年

微服务zookeeper架构分布式

Zookeeper是一个分布式协调服务,常用于分布式应用程序中,提供一致性、高可用性和可靠性。Zookeeper的架构主要由以下几个部分组成:客户端(Client):客户端是与Zookeeper服务器进行交互的实体。客户端通过ZookeeperAPI进行连接、读写数据和注册Watcher等操作。服务器(Server):Zookeeper集群中的每个节点都是一个服务器。服务器有三种角色:Leader

- MySQL调用存储过程和存储函数

夏天又到了

MySQL数据库技术mysqladbandroid

【图书推荐】《MySQL9从入门到性能优化(视频教学版)》-CSDN博客《MySQL9从入门到性能优化(视频教学版)(数据库技术丛书)》(王英英)【摘要书评试读】-京东图书(jd.com)MySQL9数据库技术_夏天又到了的博客-CSDN博客存储过程和存储函数已经定义好了,接下来需要知道如何调用这些过程和函数。存储过程和存储函数有多种调用方法:存储过程必须使用CALL语句调用,并且存储过程和数据库

- 【开发工具】开发一个类postman的idea插件

问道飞鱼

开发工具知识postmanintellij-idealua

类postman的idea插件开发开发过程1.环境准备2.创建插件项目3.项目结构4.编写`plugin.xml`5.创建ToolWindow6.设计UI7.处理HTTP请求8.构建和运行插件9.测试插件10.打包和发布总结相关文献开发过程开发一个类似Postman的IntelliJIDEA插件涉及多个步骤,包括插件项目初始化、UI设计、HTTP请求处理、响应展示等。以下是一个简化的开发过程和代码

- PlayerPrefs 各平台存储位置,包括分辨率、画质等信息存储,清除本地信息

春天花花幼稚园的程序员教孩子如何玩键盘

Unity

描述“PlayerPrefs”是一个在游戏会话之间存储玩家偏好的类。它可以将字符串,浮点数和整数值存储到用户的平台注册表中。Unity会根据应用程序在哪个操作系统上运行来不同地存储“PlayerPrefs”数据。在此页面上提供的文件路径中,公司名称和产品名称是您在Unity的播放器设置中设置(PlayerSettings)的名称。各平台的存储位置在macOS上,PlayerPrefs存储在中~/L

- 【Python爬虫①】专栏开篇:夯实Python基础

奔跑吧邓邓子

Python爬虫python爬虫开发语言基础知识

【Python爬虫】专栏简介:本专栏是Python爬虫领域的集大成之作,共100章节。从Python基础语法、爬虫入门知识讲起,深入探讨反爬虫、多线程、分布式等进阶技术。以大量实例为支撑,覆盖网页、图片、音频等各类数据爬取,还涉及数据处理与分析。无论是新手小白还是进阶开发者,都能从中汲取知识,助力掌握爬虫核心技能,开拓技术视野。目录一、引言二、Python语法基础2.1变量2.2数据类型2.3运算

- Blazor 组件库 BootstrapBlazor 中Editor组件介绍

虚幻私塾

python计算机

优质资源分享学习路线指引(点击解锁)知识定位人群定位Python实战微信订餐小程序进阶级本课程是pythonflask+微信小程序的完美结合,从项目搭建到腾讯云部署上线,打造一个全栈订餐系统。Python量化交易实战入门级手把手带你打造一个易扩展、更安全、效率更高的量化交易系统组件介绍Editor组件是对Summernote组件的二次封装。组件分为div模式和editor模式。默认状态下edito

- Python学习笔记 - 探索正则表达式re元字符

Mr数据杨

Python编程基础正则表达式python编程基础元字符

在Python编程中,正则表达式(RegularExpressions,简称re)是一种强大的工具,用于匹配字符串中的特定模式。无论是在数据清洗、文本解析,还是在日常脚本编写中,正则表达式都可以极高的效率完成复杂的字符串操作任务。然而,正则表达式的语法略显复杂,尤其是其中的元字符(Metacharacters),初学者在使用时往往感到困惑。本教程旨在通过详细的概念解释、操作指导以及实际应用示例,帮

- Python机器学习舆情分析项目案例分享

数澜悠客

数字化转型python机器学习开发语言

数据收集与准备1.数据收集多样化数据源:从社交媒体平台(如微博、Twitter)、新闻网站、论坛等多渠道收集数据,以获取更全面的舆情信息。可以使用Python的requests库和网页解析库(如BeautifulSoup)进行网页数据爬取,使用Tweepy库获取Twitter数据。数据标注:对于监督学习,需要对收集到的数据进行标注,标记为积极、消极或中性等类别。可以使用人工标注的方式,也可以利用半

- SAP-ABAP字符串处理总结

爱喝水的鱼丶

java数据库开发语言

在ABAP中,字符串处理是一项重要的操作,它允许开发者对字符串进行各种操作,如搜索、截取、合并、拆分、替换、转换大小写等。以下是对ABAP中字符串处理方法的详细介绍:搜索字符串在ABAP中,可以使用SEARCH语句来搜索一个字符串中是否包含另一个字符串。如果搜索成功,SY-SUBRC会返回0,SY-FDPOS会返回所查找的内容在字符串中的开始位置。例如:DATA:str(50)TYPEc.MOVE

- SAP-ABAP:SAPABAP开发屏幕GUI状态status设置及展示示例

爱喝水的鱼丶

ABAP开发之必须知道的SAP-ABAP开发基础详解VIP详情查看专栏SAPABAPERP企业软件开发运维

在SAP中,**GUI状态(GUIStatus)**是用于定义屏幕上的菜单栏、工具栏、功能键和快捷键的集合。GUI状态决定了用户在屏幕上可以执行的操作,并为用户提供直观的界面交互方式。以下是关于SAP屏幕GUI状态的设置及展示的详细说明:1.GUI状态的基本概念GUI状态是屏幕的一部分,用于定义用户界面的交互元素。它包括:菜单栏(MenuBar):屏幕顶部的菜单选项。标准工具栏(StandardT

- SAP-ABAP-RANGES的应用用例

爱喝水的鱼丶

ABAP开发之必须知道的SAP-ABAP开发基础详解SAPABAPERP企业级应用经验交流

SAP中的RANGES类型主要用于定义和处理数据区间或范围,它经常用于筛选、查询或其他数据处理场景中,特别是在ABAP开发中。以下是RANGES类型定义的关键点及详细解释:RANGES的组成结构:SIGN:表示区间值的包含或排除关系。通常有两种值:‘I’(Include):表示包含该值或区间。‘E’(Exclude):表示排除该值或区间。OPTION:定义了与LOW和HIGH字段结合使用的比较操作

- Stack(栈)

alien爱吃蛋挞

Javajava数据结构

定义:在Java编程语言中,栈(Stack)是一种非常重要的数据结构,具有后进先出的特性,即最后入栈的元素最先出栈。栈通常用于存储临时性的数据,如方法调用过程中的局部遍历、操作数栈等。图像理解:我们在这里要理解栈顶和栈底。这里的"顶"和"底"与我们常识中的顶端和底端是相反的。栈顶(Top):栈顶是栈中最后加入的元素的位置。在栈的操作中,所有入栈(push)和出栈(pop)的操作都是针对栈顶元素进行

- No.3十六届蓝桥杯备战|数据类型长度|sizeof|typedef|练习(C++)

ChoSeitaku

蓝桥杯备考c++算法开发语言

数据类型⻓度每⼀种数据类型都有⾃⼰的⻓度,使⽤不同的数据类型,能够创建出⻓度不同的变量,变量⻓度的不同,存储的数据范围就有所差异。sizeof操作符sizeof是⼀个关键字,也是操作符,专⻔是⽤来计算特定数据类型的⻓度的,单位是字节。sizeof操作符的操作数可以是类型,也可是变量名或者表达式,sizeof的操作数如果不是类型,是表达式的时候,可以省略掉后边的括号的。sizeof(类型)sizeo

- 【DuodooBMS】基于Odoo的开源制造执行系统——以开源之力,驱动智能制造

邹工转型手札

Duodoo开源Odoo企业信息化开源制造人工智能

以用户为中心的开放式智造平台DuodooMES的设计始终围绕“用户可编程、生态可生长”的核心思想,打破传统工业软件的封闭性,让制造企业真正成为系统的“主人”:1.用户可编程:生产流程由你定义界面可配置:无需代码即可拖拽生成车间看板、报表模板,适配不同岗位的操作习惯(如质检员聚焦缺陷统计,班组长关注工单进度)。逻辑可编排:通过低代码工具自定义业务规则,例如“当设备温度超限时,自动触发停机指令并通知维

- Oracle DBA 诊断及统计工具-2

数澜悠客

数据工具箱oracle数据库

Oracle数据表空间和索引表空间的资源分配比例总结在Oracle数据库中,数据表空间和索引表空间并没有固定的资源分配比例,其分配需要综合考虑多种因素,以下是详细分析不同场景下的分配建议以及具体的分配思路。影响分配比例的因素数据读写比例如果应用程序以读操作为主,那么索引的使用频率会较高,可能需要为索引表空间分配相对更多的资源,以提高查询性能。若写操作频繁,如大量的数据插入、更新和删除,数据表空间可

- 正则表达式(竞赛篇)

alien爱吃蛋挞

Javajava

为了更深入了解正则表达式,我们需要首先学习与正则表达式有关的类以及方法。如Pattern和Matcher类,以及部分字符串方法。我们这里先将简单的字符串方法(String类)进行讲解在Java中,String类提供了许多用于字符串操作的方法,其中matches()、split()和replaceAll()等方法是非常有用的几个。这些方法在进行字符串匹配、分割和替换操作时非常高效。同时,Java也提

- C#的async异步方法里如果使用了await,那么它跟同步方法有什么区别?

yuanpan

c#开发语言

在async异步方法中使用await时,虽然代码的写法看起来和同步方法类似,但它们的执行方式有本质的区别。以下是async/await异步方法与同步方法的主要区别:1.执行方式同步方法:同步方法会阻塞当前线程,直到方法中的所有操作完成。如果方法中有耗时的操作(如I/O操作、网络请求等),当前线程会被阻塞,无法执行其他任务。异步方法(使用await):异步方法不会阻塞当前线程。当遇到await时,方

- C#中的表达式树(Expression Trees)的原理及应用,动态编译并执行代码

yuanpan

c#开发语言

表达式树(ExpressionTrees)是C#中的一种数据结构,用于表示代码的逻辑结构。它将代码表示为树形结构,每个节点代表一个操作(如加法、减法、方法调用等)。表达式树的主要用途是动态生成代码、分析代码结构以及在运行时执行代码。1.表达式树的原理表达式树的结构:表达式树是一个树形结构,每个节点是一个表达式(Expression)。每个表达式节点可以是常量、变量、方法调用、运算符等。表达式树的根

- 目录文件变化监控和实时文件同步-SHELL脚本

Tech Vanguard

linux运维服务器

在日常的服务器管理或者数据处理工作中,我们常常需要对特定目录的变化进行监控并做出相应的操作。今天就来和大家分享一个简单的bash脚本实现的功能。我们首先使用inotifywait工具来监控一个目录,在这个脚本里,我们监控的是/opt目录(通过MON_DIR=/opt定义)。inotifywait以持续(-m)、安静(-q)和递归(-r)的模式运行,并且只关注文件创建(-ecreate)事件,输出格

- XX(北京)科技股份公司为啥需要购置服务器?

麦田上的字节

(精华帖)孙叫兽进阶之路系列服务器负载均衡创业

其实老板只是要一个量化的标准,只是没人能讲明白,我简单陈述一下:公司现在只有一台阿里的1核两G的1M带宽服务器40G,属于低配,买了3年的,打了三折花了2800元左右,为啥需要额外购置服务器呢?目前服务器上有,一个后台管理系统,一个小程序,一个APP,一个网站,目前就放了这4个产品,只有一个上述配置服务器产品,公司主营业务是打造一个共享办公平台,通过这种轻资产的线上产品运作,这就会涉及到成千万的图

- windows服务器系统巡检脚本,sql server 数据库巡检脚本

zq青

我司数据库一季度巡检一次,所以经常用到下面脚本--1.查看数据库版本信息select@@version--2.查看所有数据库名称及大小execsp_helpdb--3.查看数据库所在机器的操作系统参数execmaster..xp_msver--4.查看数据库启动的参数--5.查看数据库启动时间selectconvert(varchar(30),login_time,120)frommaster..

- Linux的Initrd机制

被触发

linux

Linux 的 initrd 技术是一个非常普遍使用的机制,linux2.6 内核的 initrd 的文件格式由原来的文件系统镜像文件转变成了 cpio 格式,变化不仅反映在文件格式上, linux 内核对这两种格式的 initrd 的处理有着截然的不同。本文首先介绍了什么是 initrd 技术,然后分别介绍了 Linux2.4 内核和 2.6 内核的 initrd 的处理流程。最后通过对 Lin

- maven本地仓库路径修改

bitcarter

maven

默认maven本地仓库路径:C:\Users\Administrator\.m2

修改maven本地仓库路径方法:

1.打开E:\maven\apache-maven-2.2.1\conf\settings.xml

2.找到

- XSD和XML中的命名空间

darrenzhu

xmlxsdschemanamespace命名空间

http://www.360doc.com/content/12/0418/10/9437165_204585479.shtml

http://blog.csdn.net/wanghuan203/article/details/9203621

http://blog.csdn.net/wanghuan203/article/details/9204337

http://www.cn

- Java 求素数运算

周凡杨

java算法素数

网络上对求素数之解数不胜数,我在此总结归纳一下,同时对一些编码,加以改进,效率有成倍热提高。

第一种:

原理: 6N(+-)1法 任何一个自然数,总可以表示成为如下的形式之一: 6N,6N+1,6N+2,6N+3,6N+4,6N+5 (N=0,1,2,…)

- java 单例模式

g21121

java

想必单例模式大家都不会陌生,有如下两种方式来实现单例模式:

class Singleton {

private static Singleton instance=new Singleton();

private Singleton(){}

static Singleton getInstance() {

return instance;

}

- Linux下Mysql源码安装

510888780

mysql

1.假设已经有mysql-5.6.23-linux-glibc2.5-x86_64.tar.gz

(1)创建mysql的安装目录及数据库存放目录

解压缩下载的源码包,目录结构,特殊指定的目录除外:

- 32位和64位操作系统

墙头上一根草

32位和64位操作系统

32位和64位操作系统是指:CPU一次处理数据的能力是32位还是64位。现在市场上的CPU一般都是64位的,但是这些CPU并不是真正意义上的64 位CPU,里面依然保留了大部分32位的技术,只是进行了部分64位的改进。32位和64位的区别还涉及了内存的寻址方面,32位系统的最大寻址空间是2 的32次方= 4294967296(bit)= 4(GB)左右,而64位系统的最大寻址空间的寻址空间则达到了

- 我的spring学习笔记10-轻量级_Spring框架

aijuans

Spring 3

一、问题提问:

→ 请简单介绍一下什么是轻量级?

轻量级(Leightweight)是相对于一些重量级的容器来说的,比如Spring的核心是一个轻量级的容器,Spring的核心包在文件容量上只有不到1M大小,使用Spring核心包所需要的资源也是很少的,您甚至可以在小型设备中使用Spring。

- mongodb 环境搭建及简单CURD

antlove

WebInstallcurdNoSQLmongo

一 搭建mongodb环境

1. 在mongo官网下载mongodb

2. 在本地创建目录 "D:\Program Files\mongodb-win32-i386-2.6.4\data\db"

3. 运行mongodb服务 [mongod.exe --dbpath "D:\Program Files\mongodb-win32-i386-2.6.4\data\

- 数据字典和动态视图

百合不是茶

oracle数据字典动态视图系统和对象权限

数据字典(data dictionary)是 Oracle 数据库的一个重要组成部分,这是一组用于记录数据库信息的只读(read-only)表。随着数据库的启动而启动,数据库关闭时数据字典也关闭 数据字典中包含

数据库中所有方案对象(schema object)的定义(包括表,视图,索引,簇,同义词,序列,过程,函数,包,触发器等等)

数据库为一

- 多线程编程一般规则

bijian1013

javathread多线程java多线程

如果两个工两个以上的线程都修改一个对象,那么把执行修改的方法定义为被同步的,如果对象更新影响到只读方法,那么只读方法也要定义成同步的。

不要滥用同步。如果在一个对象内的不同的方法访问的不是同一个数据,就不要将方法设置为synchronized的。

- 将文件或目录拷贝到另一个Linux系统的命令scp

bijian1013

linuxunixscp

一.功能说明 scp就是security copy,用于将文件或者目录从一个Linux系统拷贝到另一个Linux系统下。scp传输数据用的是SSH协议,保证了数据传输的安全,其格式如下: scp 远程用户名@IP地址:文件的绝对路径

- 【持久化框架MyBatis3五】MyBatis3一对多关联查询

bit1129

Mybatis3

以教员和课程为例介绍一对多关联关系,在这里认为一个教员可以叫多门课程,而一门课程只有1个教员教,这种关系在实际中不太常见,通过教员和课程是多对多的关系。

示例数据:

地址表:

CREATE TABLE ADDRESSES

(

ADDR_ID INT(11) NOT NULL AUTO_INCREMENT,

STREET VAR

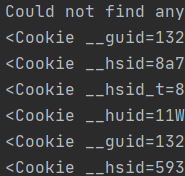

- cookie状态判断引发的查找问题

bitcarter

formcgi

先说一下我们的业务背景:

1.前台将图片和文本通过form表单提交到后台,图片我们都做了base64的编码,并且前台图片进行了压缩

2.form中action是一个cgi服务

3.后台cgi服务同时供PC,H5,APP

4.后台cgi中调用公共的cookie状态判断方法(公共的,大家都用,几年了没有问题)

问题:(折腾两天。。。。)

1.PC端cgi服务正常调用,cookie判断没

- 通过Nginx,Tomcat访问日志(access log)记录请求耗时

ronin47

一、Nginx通过$upstream_response_time $request_time统计请求和后台服务响应时间

nginx.conf使用配置方式:

log_format main '$remote_addr - $remote_user [$time_local] "$request" ''$status $body_bytes_sent "$http_r

- java-67- n个骰子的点数。 把n个骰子扔在地上,所有骰子朝上一面的点数之和为S。输入n,打印出S的所有可能的值出现的概率。

bylijinnan

java

public class ProbabilityOfDice {

/**

* Q67 n个骰子的点数

* 把n个骰子扔在地上,所有骰子朝上一面的点数之和为S。输入n,打印出S的所有可能的值出现的概率。

* 在以下求解过程中,我们把骰子看作是有序的。

* 例如当n=2时,我们认为(1,2)和(2,1)是两种不同的情况

*/

private stati

- 看别人的博客,觉得心情很好

Cb123456

博客心情

以为写博客,就是总结,就和日记一样吧,同时也在督促自己。今天看了好长时间博客:

职业规划:

http://www.iteye.com/blogs/subjects/zhiyeguihua

android学习:

1.http://byandby.i

- [JWFD开源工作流]尝试用原生代码引擎实现循环反馈拓扑分析

comsci

工作流

我们已经不满足于仅仅跳跃一次,通过对引擎的升级,今天我测试了一下循环反馈模式,大概跑了200圈,引擎报一个溢出错误

在一个流程图的结束节点中嵌入一段方程,每次引擎运行到这个节点的时候,通过实时编译器GM模块,计算这个方程,计算结果与预设值进行比较,符合条件则跳跃到开始节点,继续新一轮拓扑分析,直到遇到

- JS常用的事件及方法

cwqcwqmax9

js

事件 描述

onactivate 当对象设置为活动元素时触发。

onafterupdate 当成功更新数据源对象中的关联对象后在数据绑定对象上触发。

onbeforeactivate 对象要被设置为当前元素前立即触发。

onbeforecut 当选中区从文档中删除之前在源对象触发。

onbeforedeactivate 在 activeElement 从当前对象变为父文档其它对象之前立即

- 正则表达式验证日期格式

dashuaifu

正则表达式IT其它java其它

正则表达式验证日期格式

function isDate(d){

var v = d.match(/^(\d{4})-(\d{1,2})-(\d{1,2})$/i);

if(!v) {

this.focus();

return false;

}

}

<input value="2000-8-8" onblu

- Yii CModel.rules() 方法 、validate预定义完整列表、以及说说验证

dcj3sjt126com

yii

public array rules () {return} array 要调用 validate() 时应用的有效性规则。 返回属性的有效性规则。声明验证规则,应重写此方法。 每个规则是数组具有以下结构:array('attribute list', 'validator name', 'on'=>'scenario name', ...validation

- UITextAttributeTextColor = deprecated in iOS 7.0

dcj3sjt126com

ios

In this lesson we used the key "UITextAttributeTextColor" to change the color of the UINavigationBar appearance to white. This prompts a warning "first deprecated in iOS 7.0."

Ins

- 判断一个数是质数的几种方法

EmmaZhao

Mathpython

质数也叫素数,是只能被1和它本身整除的正整数,最小的质数是2,目前发现的最大的质数是p=2^57885161-1【注1】。

判断一个数是质数的最简单的方法如下:

def isPrime1(n):

for i in range(2, n):

if n % i == 0:

return False

return True

但是在上面的方法中有一些冗余的计算,所以

- SpringSecurity工作原理小解读

坏我一锅粥

SpringSecurity

SecurityContextPersistenceFilter

ConcurrentSessionFilter

WebAsyncManagerIntegrationFilter

HeaderWriterFilter

CsrfFilter

LogoutFilter

Use

- JS实现自适应宽度的Tag切换

ini

JavaScripthtmlWebcsshtml5

效果体验:http://hovertree.com/texiao/js/3.htm

该效果使用纯JavaScript代码,实现TAB页切换效果,TAB标签根据内容自适应宽度,点击TAB标签切换内容页。

HTML文件代码:

<!DOCTYPE html>

<html xmlns="http://www.w3.org/1999/xhtml"

- Hbase Rest API : 数据查询

kane_xie

RESThbase

hbase(hadoop)是用java编写的,有些语言(例如python)能够对它提供良好的支持,但也有很多语言使用起来并不是那么方便,比如c#只能通过thrift访问。Rest就能很好的解决这个问题。Hbase的org.apache.hadoop.hbase.rest包提供了rest接口,它内嵌了jetty作为servlet容器。

启动命令:./bin/hbase rest s

- JQuery实现鼠标拖动元素移动位置(源码+注释)

明子健

jqueryjs源码拖动鼠标

欢迎讨论指正!

print.html代码:

<!DOCTYPE html>

<html>

<head>

<meta http-equiv=Content-Type content="text/html;charset=utf-8">

<title>发票打印</title>

&l

- Postgresql 连表更新字段语法 update

qifeifei

PostgreSQL

下面这段sql本来目的是想更新条件下的数据,可是这段sql却更新了整个表的数据。sql如下:

UPDATE tops_visa.visa_order

SET op_audit_abort_pass_date = now()

FROM

tops_visa.visa_order as t1

INNER JOIN tops_visa.visa_visitor as t2

ON t1.

- 将redis,memcache结合使用的方案?

tcrct

rediscache

公司架构上使用了阿里云的服务,由于阿里的kvstore收费相当高,打算自建,自建后就需要自己维护,所以就有了一个想法,针对kvstore(redis)及ocs(memcache)的特点,想自己开发一个cache层,将需要用到list,set,map等redis方法的继续使用redis来完成,将整条记录放在memcache下,即findbyid,save等时就memcache,其它就对应使用redi

- 开发中遇到的诡异的bug

wudixiaotie

bug

今天我们服务器组遇到个问题:

我们的服务是从Kafka里面取出数据,然后把offset存储到ssdb中,每个topic和partition都对应ssdb中不同的key,服务启动之后,每次kafka数据更新我们这边收到消息,然后存储之后就发现ssdb的值偶尔是-2,这就奇怪了,最开始我们是在代码中打印存储的日志,发现没什么问题,后来去查看ssdb的日志,才发现里面每次set的时候都会对同一个key