论文与应用简介:基于DALL·E的Pokémon角色生成(平面图像)

版权声明:禁止转载。(首发时间:2022-02-22,更新时间:2022-02-26) | 个人笔记,仅供参考。所列出的论文大多尚处于研究阶段。

1. 基本信息

项目名称:ai-generated-pokemon-rudalle

基于微调ruDALL-E的Pokémon角色自动生成

提出时间:2021年12月

研究领域:计算机图形学,深度学习,图像生成

代码:github.com/minimaxir/ai-generated-pokemon-rudalle

(备注:作者另外在某娱乐资讯类网站buzz*上放了一个娱乐型的在线演示:让用户回答6个选择题,系统就能生成一个新的Pokémon角色。但实际上输出的图像只是从数组中随机选择一个,所选择的选项与输出图像无关。该演示仅供娱乐。研究请以代码为准。)

研究成熟程度:尚处于早期研究阶段。

2. 问题概述

详见笔者之前介绍的Pokémon生成问题。

3. 生成效果

(1)部分自动生成结果:

(训练集:使用898个Pokémon角色。)

(所有生成结果的版权,归Pokémon数据集版权方)

(所有生成结果的版权,归Pokémon数据集版权方)

(所有生成结果的版权,归Pokémon数据集版权方)

有画家选出部分效果较好的自动生成结果。然后,画家以此作为参考进行设计,并人工绘制出高质量的概念艺术设计图:

(2)问题:如果只使用初代151个Pokémon角色(另一个数据集,早期水彩绘制风格)作为训练集,网络会生成什么?

(所有生成结果的版权,归Pokémon数据集版权方)

4. 方法概述

DALL·E是一个跨模态生成模型,能够根据文本描述生成对应的图像。DALL·E由OpenAI于2021年1月提出。

DALL·E介绍:

(1)引燃AI社区,不用跨界也能从文本生成图像,OpenAI新模型打破自然语言与视觉次元壁(DALL·E和CLIP模型介绍)

(2)DALL·E: Creating Images from Text - OpenAI

(3)DALL·E论文:Zero-Shot Text-to-Image Generation(2021年2月)

该项目是在ruDALL-E模型(经过大规模文本-图像数据预训练)的基础上,使用Pokémon数据集进行微调(未使用CLIP模型)。ruDALL-E是DALL·E的非官方复现模型(直接使用ruDALL-E复现,是因为OpenAI没有公布DALL·E的所有代码,且复现DALL·E需要极大的GPU算力)。

该项目的主要特点为:使用大规模数据预训练之后,(相较于未预训练的模型)在小数据集上的生成效果有了显著的提升。

训练图像分辨率:256×256

训练时,文本描述为Pokémon的1个或2个属性,如:A Grass-type and Poison-type Pokémon。

备注:

该作者在实验中发现,测试阶段中,似乎更改输入文本描述中的类型,对生成结果影响不大。(笔者认为,可能是因为,相对于巨大参数量的模型,微调数据集太小了。)不过该实验至少能测试(ruDALL-E复现中的)VQGAN微调后的大致生成效果。

5. 生成结果简析

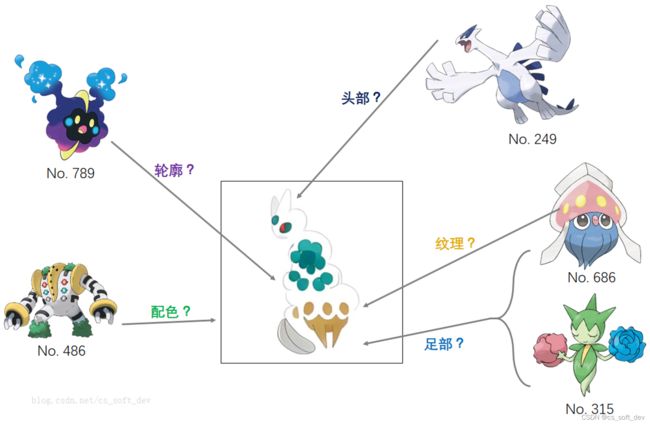

由于深度神经网络的黑盒特性,网络自动生成的结果中,很多结果难以分析其与训练数据集的关联性。以下,笔者尝试对少量生成结果,进行一个较粗略的分析。

6. 数据集与模型大小

预训练数据集大小:1.2亿个图像-文本对

微调Pokémon数据集:

数据集1:898 + 60张图像。(898个Pokémon角色,每个角色一张图像。加上少量具有多个形态的角色图像共60张。)每张图像均为Pokémon角色的平面概念艺术图。

数据集2:151张图像。(151个初代Pokémon角色,每个角色一张图像。)每张图像均为Pokémon角色的平面概念艺术图。

模型大小:2.44 GB (使用ruDALL-E Malevich (XL),参数量为13亿)

预训练时长:trained for 8 days on the 128 GPU TESLA V100, and then also for 15 more days on the 192 GPU TESLA V100, for a total of 3,904 GPU-days.