- 基于YOLOv8的火灾智能检测系统设计与实现

斟的是酒中桃

深度学习人工智能pyqtyolo

在各类安全事故中,火灾因其突发性强、破坏力大,一直是威胁人们生命财产安全的重大隐患。传统的火灾检测方式多依赖烟雾传感器、温度传感器等,存在响应滞后、易受环境干扰等问题。随着深度学习技术的飞速发展,基于计算机视觉的火灾检测方法凭借其实时性强、检测范围广等优势,逐渐成为研究热点。本文将简单介绍一款基于深度学习的火灾智能检测系统的设计与实现过程。一、系统整体设计本火灾智能检测系统旨在通过深度学习技术实现

- 人工智能入门指南:从基础概念到实际应用

前些天发现了一个巨牛的人工智能学习网站,通俗易懂,风趣幽默,忍不住分享一下给大家。点击跳转到网站。https://www.captainbed.cn/north文章目录1.**人工智能的基本概念**1.1什么是人工智能?1.2人工智能的分类2.**人工智能的核心技术**2.1机器学习(MachineLearning)2.1.1机器学习的类型2.1.2机器学习流程2.2深度学习(DeepLearni

- Java与机器学习的邂逅:Weka框架入门指南

墨夶

Java学习资料1java机器学习数据挖掘

在这个数据驱动的时代,机器学习已经成为各行业创新和优化的关键技术。而Java,作为一门成熟且广泛应用的编程语言,在企业级应用开发中占据着重要地位。将二者结合起来,利用Java实现机器学习算法,不仅可以充分发挥其强大的生态系统优势,还能为开发者提供一个高效、稳定的开发环境。今天,我们将带您走进Java与机器学习的世界,探索如何使用Weka这一著名的机器学习库来开启您的智能之旅。Weka简介及其优势什

- 机器学习基础:从数据到智能的入门指南

一、何谓机器学习在我们的日常生活中,机器学习的身影无处不在。当你打开购物软件,它总能精准推荐你可能喜欢的商品;当你解锁手机,人脸识别瞬间完成;当你使用语音助手,它能准确理解你的指令。这些背后,都离不开机器学习的支撑。机器学习是一门让计算机能够从数据中学习并改进的学科。随着传感器技术的飞速发展,我们身边充满了各种传感器,如手机中的摄像头、麦克风,交通监控中的传感器等,它们收集了海量的数据。这些数据就

- Sequential Thinking:AI深度思考的新范式及其与CoT、ReAct的对比分析

码字的字节

人工智能SequentialCoTReAct

引言:AI深度思考的演进与SequentialThinking的崛起在人工智能技术快速发展的今天,AI模型的思考能力正经历着从简单应答到深度推理的革命性转变。这一演进过程不仅反映了技术本身的进步,更体现了人类对机器智能认知边界的持续探索。早期的大语言模型虽然能够生成流畅的文本,但在处理复杂问题时往往表现出"浅思考"的局限性——答案可能看似合理,却缺乏严谨的推理过程和系统性考量。例如,2022年的一

- 2018-08-27

wuwenjuan

《新形势下的智慧新商业矩阵》,李洋老师《行形势下的智慧新商业矩阵》全新出炉,给你全新的颠覆性的智慧新零售商业模式新体验!

- Datawhale X 魔塔 Ai夏令营 --深度学习基础

一、局部极小值与全局极小值全局极小值:在损失函数的整个定义域内,损失值最小的点。这是我们在训练深度学习模型时希望找到的点,因为它代表着模型的最佳性能。局部极小值:在损失函数的一个局部区域内,损失值达到最小,但在整个函数定义域内可能不是最小的。当优化算法陷入局部极小值时,它可能会误以为已经找到了全局最优解,从而停止搜索。局部极小值的检测两种直观的方法来检测局部极小值:可视化方法:对于低维问题,我们可

- 19-养寇自重

樊登企业版王苏祥

养寇自重唐朝末年始终拥护唐朝统治的军阀李克用和不拥护唐政府的朱温展开生死搏击。最后的结果是朱温略胜一筹,李克用在抑郁寡欢中死去。他对儿子李存勖说,你要准备三只箭。一只箭射灭刘仁恭,一只箭射灭契丹,一只箭射灭朱温。李存勖大惑不解老爹自组织军团以来有很多次机会干掉刘仁恭,也有很多次机会与契丹来场决战。只不过是朱温势力强大,不好对付。所以他对老爹说,您真是留下个烂摊子给我,你怎么不用两只箭射灭刘仁恭和契

- 2021-04-22

四叶草_add9

中原焦点团队李金梅坚持分享第565天2021.4.22今天参加了曹慧老师的案例督导。首先是一位老师报个案,之后老师们根据信息各抒己见,最后曹慧老师与报个案老师进行交流。作为学校心理辅导老师,面对学生想改变原生家庭的问题,的确有些棘手。我们改变不了整个家庭,但仍然有很多可以工作的点。1.我们可以成为孩子拓宽视野的窗口,协助孩子看到事情不同的面向,帮助孩子打开视野,看到他的成功经验,使之拥有力量感。力

- Unet源码实现(pytorch)

wyn20001128

pytorch人工智能python

U-Net是一种用于生物医学图像分割的卷积神经网络架构。它通过引入一种新颖的网络结构和训练策略解决了传统方法在数据量不足时面临的挑战。U-Net的主要思想是利用数据增强技术来高效利用有限的标注样本,并通过独特的网络设计来提高分割精度。主要贡献U-Net的主要贡献包括:1、数据增强策略:使用随机弹性变形和其他形式的数据增强来增加训练数据的多样性,从而在有限的数据集上训练出更强大的模型。2、U形网络结

- 极品小农场 名窑 第1025章

龘龑文轩

第1025章夏威夷媒体公敌夏威夷旅游网被告了,佩雷斯和杨大笑举杯。“为了疯狂的汉,干一杯。为着panodra小岛干一杯。”两人大笑,大局已定啊,李汉疯狂的状告各大媒体,完全得罪了这些媒体人。“该埃米尔出手了。”“没错,中国人现在已经疯了,我们只用稍微动动手,就能把他赶出夏威夷。”佩雷斯,笑着说道。“米尔科觉着我们该和这个中国谈谈。”杨笑说道。“现在看来没有必要,或许可以和尼古拉斯聊聊。”“没错,尼

- 深度学习模块实践手册(第十二期)

加油吧zkf

目标检测目标检测模块解析与实践深度学习人工智能计算机视觉目标检测python

56、Ghost模块论文《GhostNet:MoreFeaturesfromCheapOperations》1、作用:Ghost模块是一种轻量级的特征提取模块,旨在通过廉价操作生成更多特征图,减少计算量的同时保持模型性能。传统卷积神经网络在生成特征图时存在大量冗余计算,Ghost模块通过将特征图生成过程分解为两个步骤,有效减少了计算复杂度,特别适合移动端和嵌入式设备部署。2、机制Ghost模块的机

- 算法工程师必看!个性化信息流推荐算法系统的架构设计与优化实战指南

注:此文章内容均节选自充电了么创始人,CEO兼CTO陈敬雷老师的新书《GPT多模态大模型与AIAgent智能体》(跟我一起学人工智能)【陈敬雷编著】【清华大学出版社】GPT多模态大模型与AIAgent智能体书籍本章配套视频课程【陈敬雷】推荐算法系统实战全系列精品课【陈敬雷】文章目录推荐算法系统系列二算法工程师必看!个性化信息流推荐算法系统的架构设计与优化实战指南更多技术内容总结推荐算法系统系列二算

- DETR革命:目标检测的Transformer时代

加油吧zkf

目标检测YOLOpython开发语言人工智能图像处理

《DETR从0到1:目标检测Transformer的崛起》为什么会有DETR?在深度学习目标检测发展史上,2014~2019年几乎被基于卷积神经网络(CNN)的检测器统治:两阶段:FasterR-CNN、MaskR-CNN单阶段:YOLO、SSD、RetinaNet这些检测器虽然效果强大,但背后依赖:✅Anchor(先验框)✅NMS(非极大值抑制)✅特征金字塔、手工设计问题:结构复杂、调参困难、不

- 基于探路者算法优化的正则化极限学习机(RELM)的分类问题求解

基于探路者算法优化的正则化极限学习机(RELM)的分类问题求解文章目录基于探路者算法优化的正则化极限学习机(RELM)的分类问题求解1.RELM原理2.分类问题求解3.基于探路者算法优化的RELM4.实验结果5.Matlab代码1.RELM原理极限学习机(ELM)具有训练速度快、泛化性能好的优点。极限学习机的结构是一种典型的单隐层前馈神经网络(SLFN)。极限学习机的结构见图RELM算法:若NNN

- 深度学习模块实践手册(第十一期)

加油吧zkf

目标检测目标检测模块解析与实践深度学习人工智能计算机视觉目标检测python

46、缩放点积注意力模块论文《AttentionIsAllYouNeed》1、作用:缩放点积注意力(ScaledDot-ProductAttention)是Transformer模型的核心组件,旨在解决序列建模中长距离依赖关系捕捉的问题。传统的循环神经网络(RNN)在处理长序列时存在梯度消失或爆炸的问题,且并行性较差。该模块通过计算查询(Query)、键(Key)和值(Value)之间的相似度,实

- 飘洒的诗絮(一O一)

诺鸫竹隐

图片发自App今读一首吴淑姬的词。吴淑姬,约公元一一八五年前后在世,失其本名,湖州人。生卒年均不详,约宋孝宗淳熙十二年前后在世。父为秀才。家贫,貌美,慧而能诗词。有《阳春白雪词》五卷。《花庵词选》中,黄升以为佳处不减李易安。长相思令宋代:吴淑姬烟霏霏,雪霏霏。雪向梅花枝上堆,春从何处回!醉眼开,睡眼开,疏影横斜安在哉?从教塞管催!注释霏霏:纷飞的样子。从教:任凭塞管:乐器。(古有《落梅花》笛曲。)

- 【I3D 2024】Deblur-GS: 3D Gaussian Splatting from Camera Motion Blurred Images

__星辰大海__

论文阅读计算机视觉算法人工智能

文章目录1.李群与李代数2.相机运动模糊建模3.相机运动轨迹近似3.1.线性插值3.2.三次样条插值3.3.K阶贝塞尔曲线插值1.李群与李代数参考博客:视觉SLAM十四讲-李群与李代数。2.相机运动模糊建模运动模糊产生的原因是:相机在曝光期间捕捉到了移动的物体或自身发生了移动,导致场景中某些像素在成像过程中不是来自单一点,而是多个位置的光线的混合。假设在时间[t0,t0+T][t_0,t_0+T]

- 梦想逛围城

文昌侍郎

梦想逛围城李自立在我童年的时候,我曾经拜读过一本书,这本书名叫《红楼梦》,第一次拜读这本惊世杰作大著,我是有的放矢,我是慕名而去,可当时的我乳臭未干,自不量力,实话告诉你吧,这本书我连第一章回都没读完,本僧就放弃了,原因就是那时候的我,梦想很丰满,现实很骨感,这种现像换种说法又叫自不量力。因为当时的自己是五年级学生,加上版本又全文文言文模式,再加上第一章回那题目“甄士隐梦幻识通灵贾雨村风尘怀闺秀”

- 2023-08-04

2023梦启支教团王耀民

发掘劳动之美,引领成功道路——中国矿业大学梦启支教团开展劳动教育课程7月19日下午,中国矿业大学梦启支教团在贵州省毕节市金沙县第九小学(彩虹小学)开展劳动教育课程,该课程旨在使同学们树立正确的劳动观点和劳动态度,热爱劳动和劳动人民,养成劳动习惯,课程由李洋老师主讲。李洋老师首先根据童话故事三只小猪,引起学生兴趣,同时也引出劳动的重要性,说明只有通过勤劳的双手务实才能实现目标。随后,他从整理与收纳、

- 银杏(李虹雨)

2020级1班

又入秋了,一片片银杏叶,渐渐黄了,看着看着在它那浓阴的。遮蔽下,有一个小女孩躺在草苹上,很努力的想知道她是谁?最后才反应过来这不就是我吗?微风抚过,树叶飘落,已经记不起是笫几回有这样享受的感觉了……记得二年级时,同伴一起来到了这银杏园,看着银杏叶飘落心中稀奇的不得了,然后就是一阵扩跑,开始追逐起来,嘴里发出银铃般的笑声,那样纯洁,那样天真。后来来到里,笑不出来,玩不起来了,就抱着书坐在树下,不时抬

- 【DL经典回顾】激活函数大汇总(四)(Softmax & Softplus附代码和详细公式)

夺命猪头

python机器学习人工智能神经网络numpy

激活函数大汇总(四)(Softmax&Softplus附代码和详细公式)更多激活函数见激活函数大汇总列表一、引言欢迎来到我们深入探索神经网络核心组成部分——激活函数的系列博客。在人工智能的世界里,激活函数扮演着不可或缺的角色,它们决定着神经元的输出,并且影响着网络的学习能力与表现力。鉴于激活函数的重要性和多样性,我们将通过几篇文章的形式,本篇详细介绍两种激活函数,旨在帮助读者深入了解各种激活函数的

- 神经网络项目--基于FPGA的AI简易项目(1-9图片数字识别)

霖12

深度学习pytorch神经网络fpga开发人工智能机器学习

1.训练MNIST模型importtorch#导入pytorch核心库importtorch.nnasnn#神经网络模块,如卷积层importtorch.optimasoptim#优化器fromtorchvisionimportdatasets,transforms#数据集与图像预处理工具#定义CNN模型classSimpleCNN(nn.Module):#PyTorch库中所有神经网络的“基础模

- 基于NanoDet的健身姿势纠正系统开发

YOLO实战营

人工智能NanoDet深度学习计算机视觉ui

1.引言在现代健身行业中,正确的运动姿势至关重要,不仅能提升训练效果,还能预防运动损伤。尤其是在进行一些高强度的力量训练时,如深蹲、俯卧撑等,错误的姿势可能导致肌肉不平衡或关节损伤。传统的健身姿势纠正方式依赖教练的人工指导,但随着人工智能技术的发展,使用计算机视觉和深度学习技术来进行姿势纠正,逐渐成为一种高效且可扩展的解决方案。本文将详细介绍如何基于NanoDet(一个轻量化目标检测模型)开发一个

- 大模型算法工程师技术路线全解析:从基础到资深的能力跃迁

Mr.小海

大模型算法数据挖掘人工智能机器学习深度学习机器翻译web3

文章目录大模型算法工程师技术路线全解析:从基础到资深的能力跃迁一、基础阶段(0-2年经验):构建核心知识体系与工程入门数学与机器学习基础编程与深度学习框架NLP与Transformer入门二、进阶阶段(2-4年经验):深化模型技术与工程落地能力大模型预训练与微调技术预训练原理:数据与任务的协同设计微调工具:参数高效适配与工程优化对齐实践:价值观优化与实证效果分布式训练与框架工具并行策略:多维度协同

- Go与Python在数据管道与分析项目中的抉择:性能与灵活性的较量

真智AI

人工智能pythongo

你正在设计一个全新数据管道或启动一个分析项目,此时你或许正在思考该选择Python还是Go。五年前,这甚至不是个值得讨论的问题——你会毫不犹豫地选择Python,故事到此为止。然而,近年来Go在数据领域,尤其是在数据基础设施和实时处理方面,正逐渐被更多人采用。实际上,这两种语言都已在现代数据技术栈中找到了各自的定位。Python依然非常适合机器学习和数据分析,而Go则逐步成为高性能数据基础设施的首

- Python爬虫实战:从新浪财经爬取股票新闻的完整实现

Python爬虫项目

python爬虫开发语言数据分析php

第一部分:爬虫概述1.1什么是爬虫?爬虫是指通过程序模拟浏览器的行为,自动化地抓取网络上的数据。通过爬虫技术,能够从各种网站上提取信息,广泛应用于数据采集、数据分析、机器学习等领域。1.2新浪财经简介新浪财经是中国最大的财经信息平台之一,提供股票、基金、债券、外汇等多方面的财经新闻和数据。在股票领域,新浪财经提供了大量的股票行情、实时数据、新闻报道等信息,因此爬取新浪财经的股票新闻对于投资分析和决

- 神经网络常见激活函数 13-Softplus函数

亲持红叶

神经网络常见激活函数神经网络人工智能深度学习

文章目录Softplus函数+导函数函数和导函数图像优缺点PyTorch中的Softplus函数TensorFlow中的Softplus函数Softplus函数+导函数Softplus函数Softplus(x)=ln(1+e x)\begin{aligned}\operatorname{Softplus}(x)&=\ln\bigl(1+e^{\,x}\bigr)\end{aligned}Sof

- AI 智能运维,重塑大型企业软件运维:从自动化到智能化的进阶实践

AI、少年郎

人工智能运维自动化

一、引言:企业软件运维的智能化转型浪潮在数字化转型加速的背景下,大型企业软件架构日益复杂,微服务、多云环境、分布式系统的普及导致传统运维模式面临效率瓶颈。AI技术的渗透催生了智能运维(AIOps)的落地,通过机器学习、大模型、智能Agent等技术,实现从"人工救火"到"智能预防"的范式转变。本文结合头部企业实践,解析AI在运维领域的核心应用场景、技术架构及未来趋势,特别针对基础运维中流程重构、技术

- Spring AI 概述与功能简介

drebander

AI编程spring人工智能java

SpringAI是一个由Spring团队开发的开源框架,旨在为人工智能(AI)和机器学习(ML)提供一个成熟且高效的开发平台。它将Spring生态系统的设计理念应用于AI开发,尤其强调模块化、可移植性以及简洁的集成。SpringAI提供了丰富的功能,涵盖从AI模型的调用到与数据库的集成等多个方面,帮助开发者构建和管理AI驱动的应用程序。1.SpringAI背景SpringAI的背景源于Spring

- LeetCode[Math] - #66 Plus One

Cwind

javaLeetCode题解AlgorithmMath

原题链接:#66 Plus One

要求:

给定一个用数字数组表示的非负整数,如num1 = {1, 2, 3, 9}, num2 = {9, 9}等,给这个数加上1。

注意:

1. 数字的较高位存在数组的头上,即num1表示数字1239

2. 每一位(数组中的每个元素)的取值范围为0~9

难度:简单

分析:

题目比较简单,只须从数组

- JQuery中$.ajax()方法参数详解

AILIKES

JavaScriptjsonpjqueryAjaxjson

url: 要求为String类型的参数,(默认为当前页地址)发送请求的地址。

type: 要求为String类型的参数,请求方式(post或get)默认为get。注意其他http请求方法,例如put和 delete也可以使用,但仅部分浏览器支持。

timeout: 要求为Number类型的参数,设置请求超时时间(毫秒)。此设置将覆盖$.ajaxSetup()方法的全局

- JConsole & JVisualVM远程监视Webphere服务器JVM

Kai_Ge

JVisualVMJConsoleWebphere

JConsole是JDK里自带的一个工具,可以监测Java程序运行时所有对象的申请、释放等动作,将内存管理的所有信息进行统计、分析、可视化。我们可以根据这些信息判断程序是否有内存泄漏问题。

使用JConsole工具来分析WAS的JVM问题,需要进行相关的配置。

首先我们看WAS服务器端的配置.

1、登录was控制台https://10.4.119.18

- 自定义annotation

120153216

annotation

Java annotation 自定义注释@interface的用法 一、什么是注释

说起注释,得先提一提什么是元数据(metadata)。所谓元数据就是数据的数据。也就是说,元数据是描述数据的。就象数据表中的字段一样,每个字段描述了这个字段下的数据的含义。而J2SE5.0中提供的注释就是java源代码的元数据,也就是说注释是描述java源

- CentOS 5/6.X 使用 EPEL YUM源

2002wmj

centos

CentOS 6.X 安装使用EPEL YUM源1. 查看操作系统版本[root@node1 ~]# uname -a Linux node1.test.com 2.6.32-358.el6.x86_64 #1 SMP Fri Feb 22 00:31:26 UTC 2013 x86_64 x86_64 x86_64 GNU/Linux [root@node1 ~]#

- 在SQLSERVER中查找缺失和无用的索引SQL

357029540

SQL Server

--缺失的索引

SELECT avg_total_user_cost * avg_user_impact * ( user_scans + user_seeks ) AS PossibleImprovement ,

last_user_seek ,

- Spring3 MVC 笔记(二) —json+rest优化

7454103

Spring3 MVC

接上次的 spring mvc 注解的一些详细信息!

其实也是一些个人的学习笔记 呵呵!

- 替换“\”的时候报错Unexpected internal error near index 1 \ ^

adminjun

java“\替换”

发现还是有些东西没有刻子脑子里,,过段时间就没什么概念了,所以贴出来...以免再忘...

在拆分字符串时遇到通过 \ 来拆分,可是用所以想通过转义 \\ 来拆分的时候会报异常

public class Main {

/*

- POJ 1035 Spell checker(哈希表)

aijuans

暴力求解--哈希表

/*

题意:输入字典,然后输入单词,判断字典中是否出现过该单词,或者是否进行删除、添加、替换操作,如果是,则输出对应的字典中的单词

要求按照输入时候的排名输出

题解:建立两个哈希表。一个存储字典和输入字典中单词的排名,一个进行最后输出的判重

*/

#include <iostream>

//#define

using namespace std;

const int HASH =

- 通过原型实现javascript Array的去重、最大值和最小值

ayaoxinchao

JavaScriptarrayprototype

用原型函数(prototype)可以定义一些很方便的自定义函数,实现各种自定义功能。本次主要是实现了Array的去重、获取最大值和最小值。

实现代码如下:

<script type="text/javascript">

Array.prototype.unique = function() {

var a = {};

var le

- UIWebView实现https双向认证请求

bewithme

UIWebViewhttpsObjective-C

什么是HTTPS双向认证我已在先前的博文 ASIHTTPRequest实现https双向认证请求

中有讲述,不理解的读者可以先复习一下。本文是用UIWebView来实现对需要客户端证书验证的服务请求,网上有些文章中有涉及到此内容,但都只言片语,没有讲完全,更没有完整的代码,让人困扰不已。但是此知

- NoSQL数据库之Redis数据库管理(Redis高级应用之事务处理、持久化操作、pub_sub、虚拟内存)

bijian1013

redis数据库NoSQL

3.事务处理

Redis对事务的支持目前不比较简单。Redis只能保证一个client发起的事务中的命令可以连续的执行,而中间不会插入其他client的命令。当一个client在一个连接中发出multi命令时,这个连接会进入一个事务上下文,该连接后续的命令不会立即执行,而是先放到一个队列中,当执行exec命令时,redis会顺序的执行队列中

- 各数据库分页sql备忘

bingyingao

oraclesql分页

ORACLE

下面这个效率很低

SELECT * FROM ( SELECT A.*, ROWNUM RN FROM (SELECT * FROM IPAY_RCD_FS_RETURN order by id desc) A ) WHERE RN <20;

下面这个效率很高

SELECT A.*, ROWNUM RN FROM (SELECT * FROM IPAY_RCD_

- 【Scala七】Scala核心一:函数

bit1129

scala

1. 如果函数体只有一行代码,则可以不用写{},比如

def print(x: Int) = println(x)

一行上的多条语句用分号隔开,则只有第一句属于方法体,例如

def printWithValue(x: Int) : String= println(x); "ABC"

上面的代码报错,因为,printWithValue的方法

- 了解GHC的factorial编译过程

bookjovi

haskell

GHC相对其他主流语言的编译器或解释器还是比较复杂的,一部分原因是haskell本身的设计就不易于实现compiler,如lazy特性,static typed,类型推导等。

关于GHC的内部实现有篇文章说的挺好,这里,文中在RTS一节中详细说了haskell的concurrent实现,里面提到了green thread,如果熟悉Go语言的话就会发现,ghc的concurrent实现和Go有点类

- Java-Collections Framework学习与总结-LinkedHashMap

BrokenDreams

LinkedHashMap

前面总结了java.util.HashMap,了解了其内部由散列表实现,每个桶内是一个单向链表。那有没有双向链表的实现呢?双向链表的实现会具备什么特性呢?来看一下HashMap的一个子类——java.util.LinkedHashMap。

- 读《研磨设计模式》-代码笔记-抽象工厂模式-Abstract Factory

bylijinnan

abstract

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

package design.pattern;

/*

* Abstract Factory Pattern

* 抽象工厂模式的目的是:

* 通过在抽象工厂里面定义一组产品接口,方便地切换“产品簇”

* 这些接口是相关或者相依赖的

- 压暗面部高光

cherishLC

PS

方法一、压暗高光&重新着色

当皮肤很油又使用闪光灯时,很容易在面部形成高光区域。

下面讲一下我今天处理高光区域的心得:

皮肤可以分为纹理和色彩两个属性。其中纹理主要由亮度通道(Lab模式的L通道)决定,色彩则由a、b通道确定。

处理思路为在保持高光区域纹理的情况下,对高光区域着色。具体步骤为:降低高光区域的整体的亮度,再进行着色。

如果想简化步骤,可以只进行着色(参看下面的步骤1

- Java VisualVM监控远程JVM

crabdave

visualvm

Java VisualVM监控远程JVM

JDK1.6开始自带的VisualVM就是不错的监控工具.

这个工具就在JAVA_HOME\bin\目录下的jvisualvm.exe, 双击这个文件就能看到界面

通过JMX连接远程机器, 需要经过下面的配置:

1. 修改远程机器JDK配置文件 (我这里远程机器是linux).

- Saiku去掉登录模块

daizj

saiku登录olapBI

1、修改applicationContext-saiku-webapp.xml

<security:intercept-url pattern="/rest/**" access="IS_AUTHENTICATED_ANONYMOUSLY" />

<security:intercept-url pattern=&qu

- 浅析 Flex中的Focus

dsjt

htmlFlexFlash

关键字:focus、 setFocus、 IFocusManager、KeyboardEvent

焦点、设置焦点、获得焦点、键盘事件

一、无焦点的困扰——组件监听不到键盘事件

原因:只有获得焦点的组件(确切说是InteractiveObject)才能监听到键盘事件的目标阶段;键盘事件(flash.events.KeyboardEvent)参与冒泡阶段,所以焦点组件的父项(以及它爸

- Yii全局函数使用

dcj3sjt126com

yii

由于YII致力于完美的整合第三方库,它并没有定义任何全局函数。yii中的每一个应用都需要全类别和对象范围。例如,Yii::app()->user;Yii::app()->params['name'];等等。我们可以自行设定全局函数,使得代码看起来更加简洁易用。(原文地址)

我们可以保存在globals.php在protected目录下。然后,在入口脚本index.php的,我们包括在

- 设计模式之单例模式二(解决无序写入的问题)

come_for_dream

单例模式volatile乱序执行双重检验锁

在上篇文章中我们使用了双重检验锁的方式避免懒汉式单例模式下由于多线程造成的实例被多次创建的问题,但是因为由于JVM为了使得处理器内部的运算单元能充分利用,处理器可能会对输入代码进行乱序执行(Out Of Order Execute)优化,处理器会在计算之后将乱序执行的结果进行重组,保证该

- 程序员从初级到高级的蜕变

gcq511120594

框架工作PHPandroidhtml5

软件开发是一个奇怪的行业,市场远远供不应求。这是一个已经存在多年的问题,而且随着时间的流逝,愈演愈烈。

我们严重缺乏能够满足需求的人才。这个行业相当年轻。大多数软件项目是失败的。几乎所有的项目都会超出预算。我们解决问题的最佳指导方针可以归结为——“用一些通用方法去解决问题,当然这些方法常常不管用,于是,唯一能做的就是不断地尝试,逐个看看是否奏效”。

现在我们把淫浸代码时间超过3年的开发人员称为

- Reverse Linked List

hcx2013

list

Reverse a singly linked list.

/**

* Definition for singly-linked list.

* public class ListNode {

* int val;

* ListNode next;

* ListNode(int x) { val = x; }

* }

*/

p

- Spring4.1新特性——数据库集成测试

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- C# Ajax上传图片同时生成微缩图(附Demo)

liyonghui160com

1.Ajax无刷新上传图片,详情请阅我的这篇文章。(jquery + c# ashx)

2.C#位图处理 System.Drawing。

3.最新demo支持IE7,IE8,Fir

- Java list三种遍历方法性能比较

pda158

java

从c/c++语言转向java开发,学习java语言list遍历的三种方法,顺便测试各种遍历方法的性能,测试方法为在ArrayList中插入1千万条记录,然后遍历ArrayList,发现了一个奇怪的现象,测试代码例如以下:

package com.hisense.tiger.list;

import java.util.ArrayList;

import java.util.Iterator;

- 300个涵盖IT各方面的免费资源(上)——商业与市场篇

shoothao

seo商业与市场IT资源免费资源

A.网站模板+logo+服务器主机+发票生成

HTML5 UP:响应式的HTML5和CSS3网站模板。

Bootswatch:免费的Bootstrap主题。

Templated:收集了845个免费的CSS和HTML5网站模板。

Wordpress.org|Wordpress.com:可免费创建你的新网站。

Strikingly:关注领域中免费无限的移动优

- localStorage、sessionStorage

uule

localStorage

W3School 例子

HTML5 提供了两种在客户端存储数据的新方法:

localStorage - 没有时间限制的数据存储

sessionStorage - 针对一个 session 的数据存储

之前,这些都是由 cookie 完成的。但是 cookie 不适合大量数据的存储,因为它们由每个对服务器的请求来传递,这使得 cookie 速度很慢而且效率也不

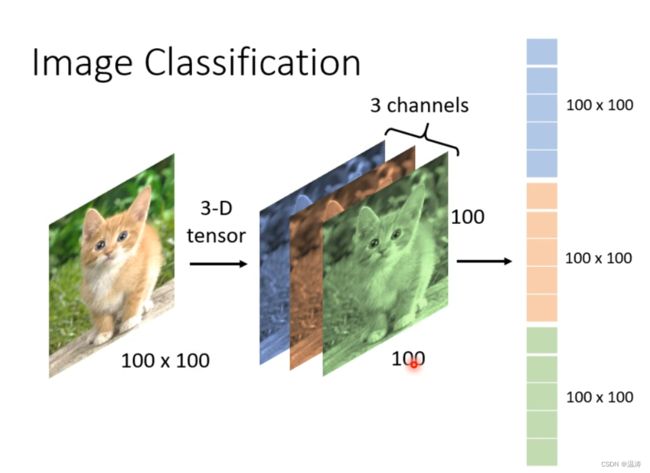

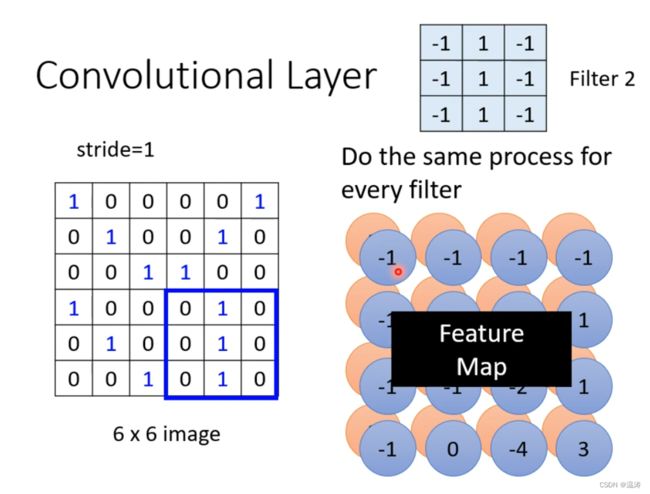

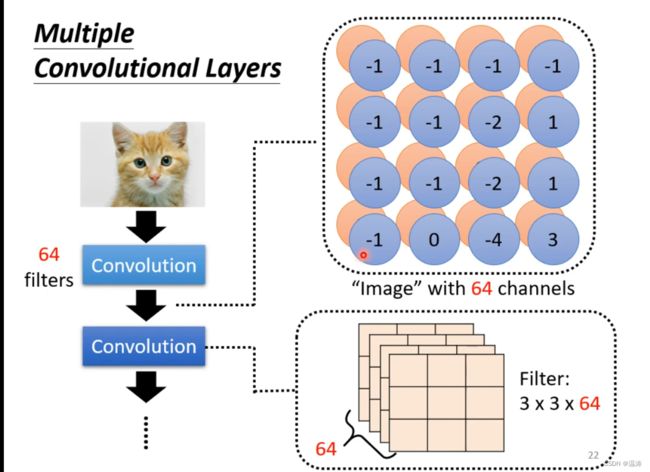

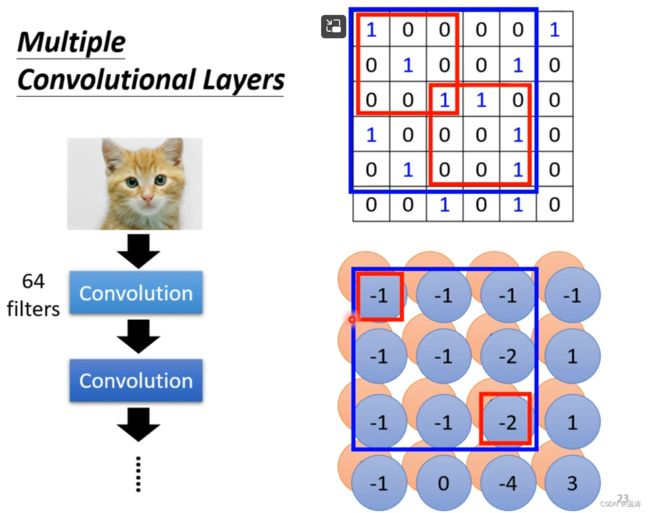

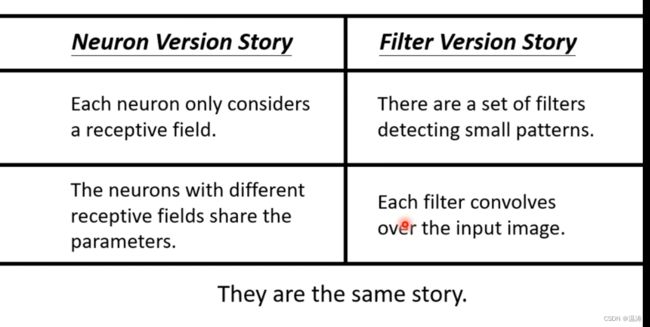

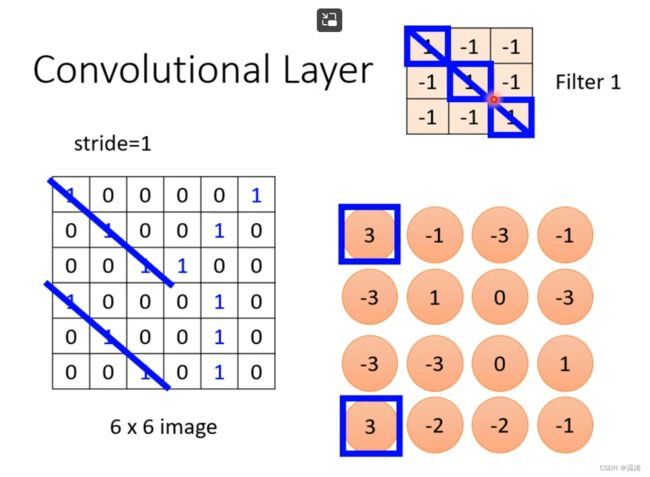

2.feature map

2.feature map