OpenVINO 的安装及配置

目录

1.安装外部软件依赖

2.安装OpenVINO工具套件

3.临时环境变量的配置

4.安装MovidiusDriver与验证

6.配置环境变量

7.编译inference engine 中的samples范例

8.运行演示程序

(1)demo_squeezenet_download_convert_run.bat

(2)demo_security_barrier_camera.bat

(3)demo_benchmark_app.bat -d DEVICE

1.安装外部软件依赖

①Visual Studio 2017或2019;(链接:https://visualstudio.microsoft.com/zh-hans/vs/older-downloads/)

②CMake(V>=3.4);(链接:Download | CMake)

③Python 64位(3.6 <= version >= 3.8)(链接:https://www.python.org/downloads/)

Tips:

①VS的版本就不用纠结啦,不过现在主流的VS是2017版的,所以就看你咯~

②在安装Python时建议小可爱们使用Anaconda,因为它是一种非常强大的管理python库以及虚拟环境的工具。如果现在你的系统已经存在python,但版本不符合openvino,这个时候就可以利用conda一键创建虚拟环境,而不是再去官网下载对应版本啦,非常好用

2.安装OpenVINO工具套件

进入官网:https://www.intel.com/content/www/us/en/developer/tools/openvino-toolkit-download.html

①选择对应操作系统(这里我用的是windows版滴 ,以后会尝试linux )

②发行版本选择推荐的就好啦(online&offline)

③版本选择latest最近发布(在其他条件保持不变的情况下,运行效率取决于有木有用openvino,而不是版本的高低,新版本和旧版本相差不大呀)

④安装类型:offline

Tips:选择完以上信息还要填个邮箱,然后就能完成安装啦!

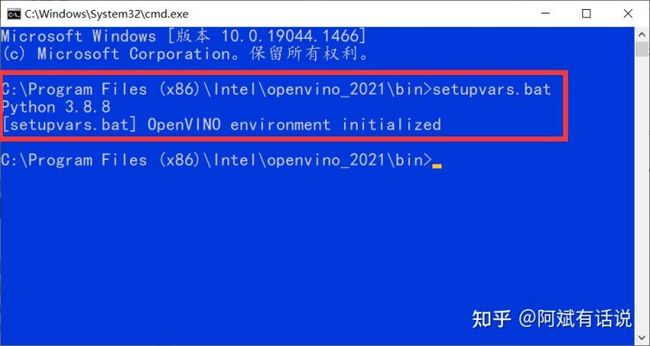

3.临时环境变量的配置

进入openvino安装路径中的bin文件夹,,使用cmd运行setupvars.bat脚本,可以看到OpenVINO的环境已成功初始化,如下:

Tips:

此环境变量为临时变量,只有在当前cmd命令行中起作用,一旦关闭窗口,该环境变量将被释放;如果要设置永久的环境变量,那就继续往下看啦;

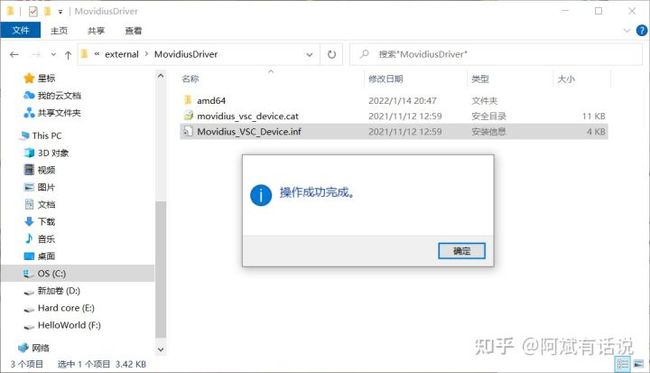

4.安装MovidiusDriver与验证

没有神经网络计算棒二代(NSC2)的小伙伴可以直接跳过哦

进入openvino推理引擎文件夹,我的是C:\Program Files (x86)\Intel\openvino_2021\inference_engine\external\MovidiusDriver,右击Movidius_VSC_Device.inf安装,看到“操作成功”的提示即可。

5.配置model optimizer

进入入C:\Program Files (x86)\Intel\openvino_2021\deployment_tools\model_optimizer\install_prerequisites文件夹,cmd执行install_prerequisites.bat以配置所有架构

Tips:

①如要单独配置,可以使用如install_prerequisites_onnx.bat、install_prerequisites_tf.bat等;

②因为各个架构内存占用不多,所以建议大家都安装啦~

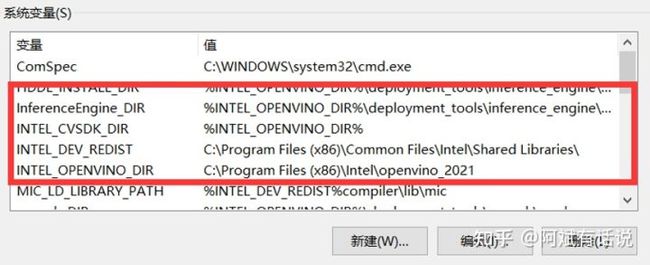

6.配置环境变量

参考博客:https://blog.csdn.net/weixin_39956356/article/details/106937210?spm=1001.2101.3001.6650.1&utm_medium=distribute.pc_relevant.none-task-blog-2%7Edefault%7ECTRLIST%7Edefault-1.pc_relevant_aa&depth_1-utm_source=distribute.pc_relevant.none-task-blog-2%7Edefault%7ECTRLIST%7Edefault-1.pc_relevant_aa&utm_relevant_index=2

Intel官网:https://www.intel.cn/content/www/cn/zh/support/articles/000033440/software/development-software.html?wapkw=000033440

这里没啥需要讲滴,大家参考博客以及Intel官方给出的教程配置就好啦~

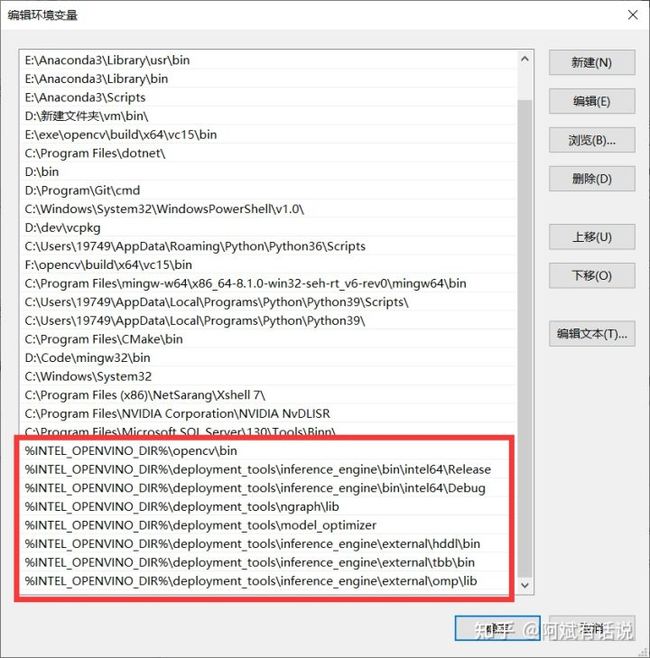

以下为系统变量中的Path值:

7.编译inference engine 中的samples范例

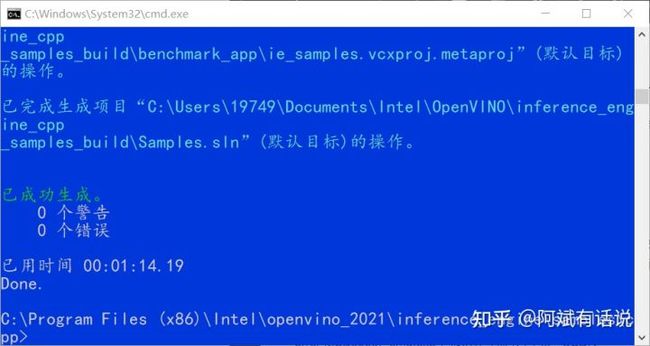

首先,进入C:\Program Files (x86)\Intel\openvino_2021\inference_engine\samples\cpp文件夹,cmd执行build_samples_msvc.bat,成功后截图如下:

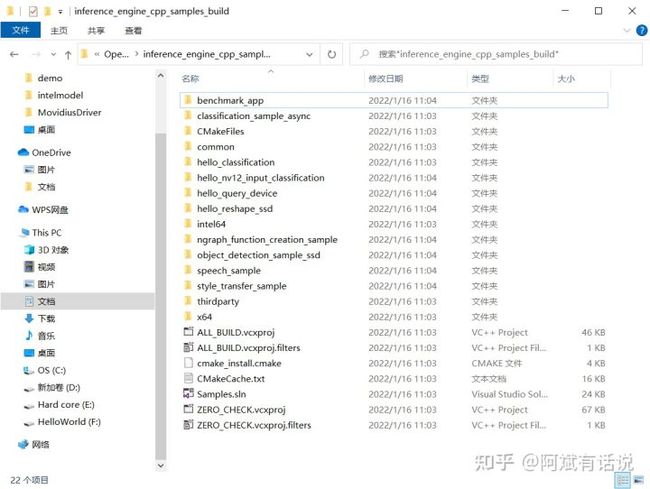

我们可以根据提示去对应位置找到生成的文件夹,如下:

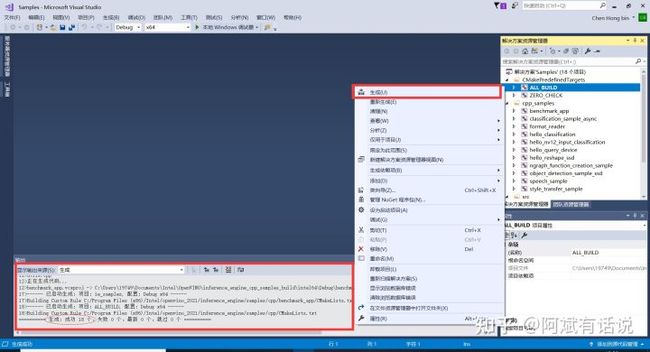

然后,打开Samples.sln解决方案文件,选择Debug模式,选择ALL_BUILD工程,右击生成。

接着,以同样的步骤编译并生成inference_engine文件夹下的demos演示程序。

如果以上范例和演示程序都能编译成功并生成,那么就证明你的OpenVINO开发编译环境配置成功啦~

8.运行演示程序

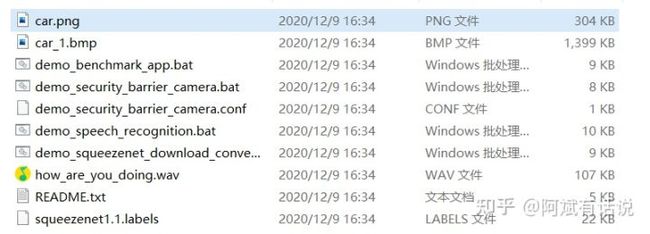

进入demo文件夹,可以看到这里有几个Intel官方提供的测试范例,如下:

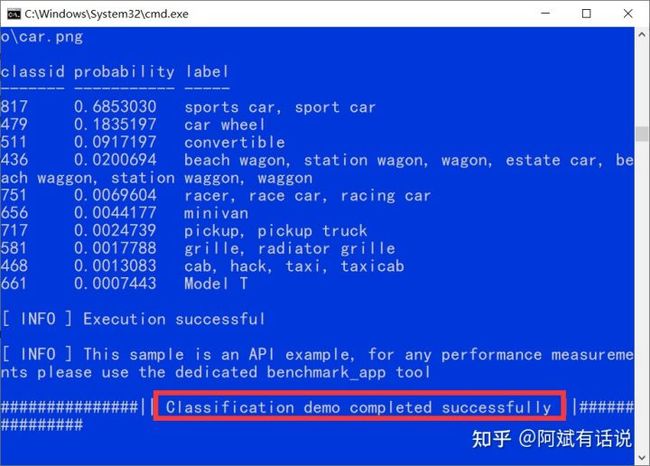

(1)demo_squeezenet_download_convert_run.bat

执行该脚本以后要稍等一会,可以喝杯咖啡提提神~

然后咧,简单讲一下这个脚本到底干了些啥。

首先在运行的时候该脚本会自动下载一个训练好的SqueezeNet model,然后使用Model Optimizer转化成IR格式的数据,用于推论,并且利用Inference Engine程序来对图片“car.png”做分类。

Tips:如果大家无法成功运行该脚本,一定要去看我专栏下的OpenVINO采坑经历呀~

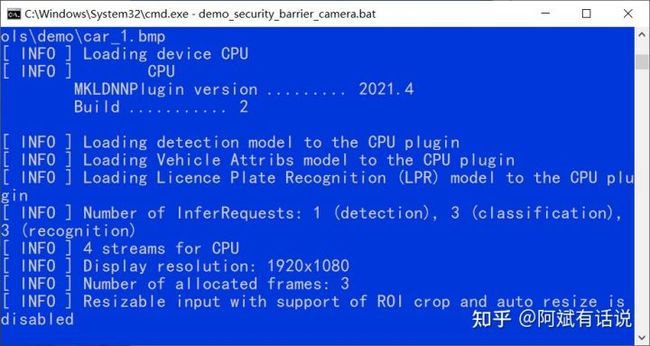

(2)demo_security_barrier_camera.bat

Tips

在执行脚本时,通过在命令后面加上“-d 设备名“就可以指定硬件设备来加速推理。

OpenVINO支持的设备包括CPU、GPU、MYRIAD、和HDDL。其中MYRIAD指利用Intel神经计算棒做加速推理;HDDL指利用Intel视觉计算加速卡来推理。

当然,如果执行demo_squeezenet_download_convert_run.bat -d MYRIAD成功的话,可以证明计算棒能够在MYRIAD上执行推论。但需要注意的是❗,Movidius Myriad插件支持的格式为FP16。换句话说,如果使用的模型格式与其不一致,则需要使用model optimize转换。

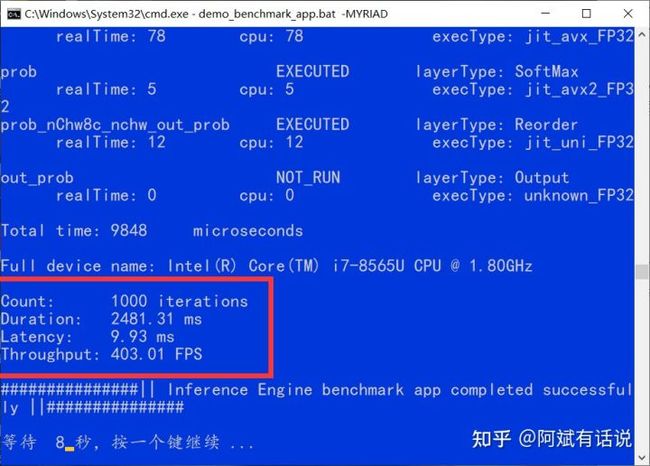

(3)demo_benchmark_app.bat -d DEVICE

通过执行该脚本并指定不同的硬件参数,我们可以比较AI加速在不同硬件设备上的效果。

这里我指定AI模型在NSC2上执行,运行结果如下:

各参数含义:

Count指迭代次数,Duration指运行时间,Latency指延时,Throughput指吞吐量。

其中,响应延时和吞吐量是评价AI推理计算性能的两个常用指标。具体来讲,前者指完成一次推理所需要的时间,后者指在单位时间内能够完成的推理次数。

很明显,一个低延时、高吞吐量的AI计算性能是我们奋斗的目标!