Ai-gan: Attack-inspired generation of adversarial examples-阅读札记

Ai-gan: Attack-inspired generation of adversarial examples

阅读笔记

文章信息:Bai, Tao, Zhao, Jun, Zhu, Jinjin, Han, Shoudong, Chen, Jiefeng, Li, Bo, & Kot, Alex. (2021, September). Ai-gan: Attack-inspired generation of adversarial examples. In 2021 IEEE International Conference on Image Processing (ICIP) (pp. 2543-2547). IEEE. (CCFA 被引:11)

Abstract

介绍提出了一种新的生成对抗样本的方法:Ai-gan,并且是此类问题第一个在比较复杂的数据集上进行实验的(Cifar10)。

1、Introdution

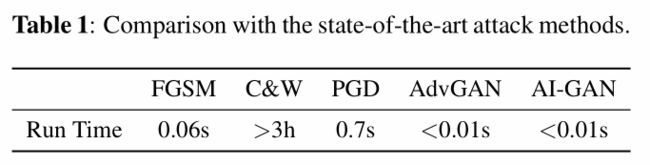

以前(传统的生成对抗样本的方法:FGSM、PGD等)存在的生成对抗样本的方法比较耗时,并且计算比较复杂。现在一些研究者用GAN来生成对抗样本,分为两类:1、生成一个扰动,然后加到原样本上;2、直接生成对抗样本。但是这些方法

**存在问题:

- 问题1:这个产生的能力是有限制的,一次只能生成一个特定的类,如果需要其他的类,就要重新训练。

- 问题2:很多之前的工作都只是在比较简单的数据集上进行实验的,如MNIST和CIFAR10。

解决问题:提出了AI-GAN生成对抗样本。

方法框架:

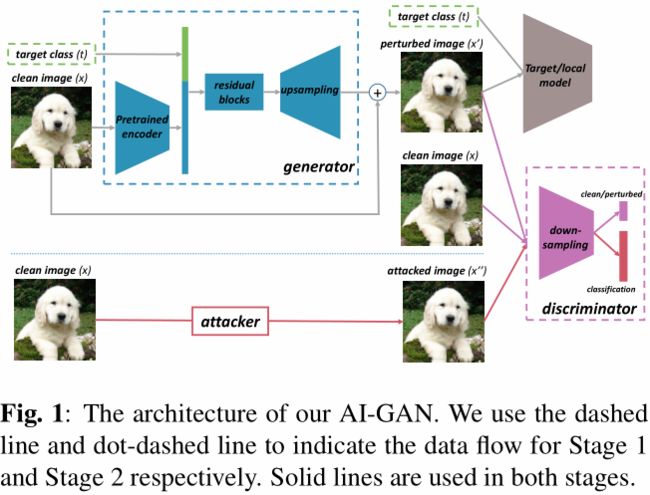

鉴别器:鉴别器用了AC-GAN,既可以分别真假图片,又可以分别具体类,并且为了提高生成器生成的对抗样本的攻击能力,添加了attacker进行对抗训练,attacker的添加也可以增加训练的稳定性。

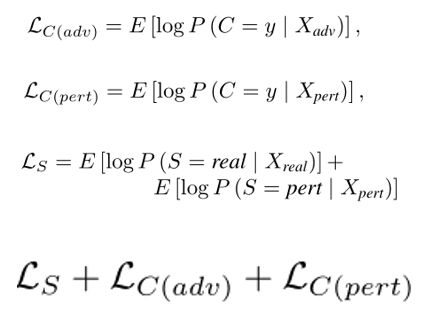

鉴别器训练的目标是最大化这个损失函数,LCadv损失是提高鉴别器鉴别attacker对抗样本的能力;Lcpert损失是提高鉴别器鉴别生成的对抗样本的能力;Ls是提高鉴别器分别图片真假的能力。

生成器:用干净样本和目标类作为输入,并且为了生成器的可拓展性,将预训练的编码器加入,可以使方法更接近于特征空间攻击从而增加了对抗样本的可转移性,生成器的损失函数为:

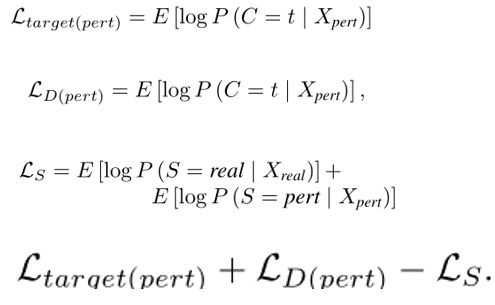

生成器训练的目标是最大化这个损失函数,Ltarget(pert)是在目标模型下提高生成器生成对应目标标签的扰动的能力,LD(pert)是在鉴别器下提高生成器生成对应目标标签的扰动的能力,LS是前面提到的。

Contribution:

⭐与以前的工作不同,提出一种称为AI-GAN的新型GAN框架,其中发生器、鉴别发生器和攻击者联合训练;

⭐ AI-GAN方法(作者提出的)是第一个将生成对抗样本的思想用在较为复杂数据集上的(CIFAR-100);

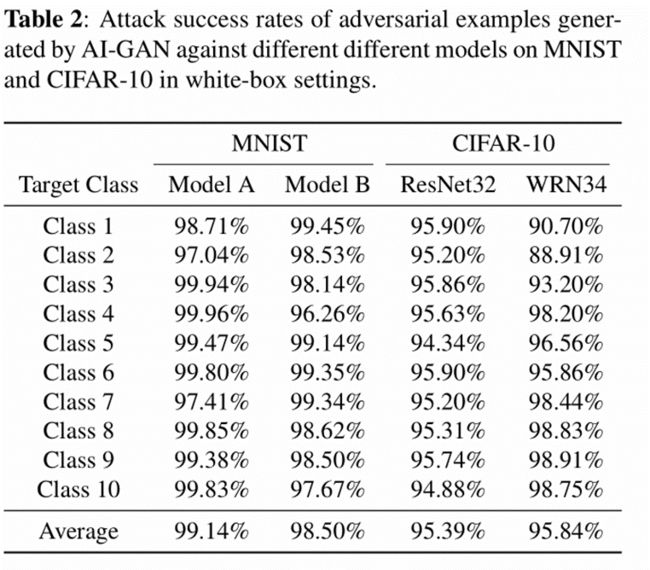

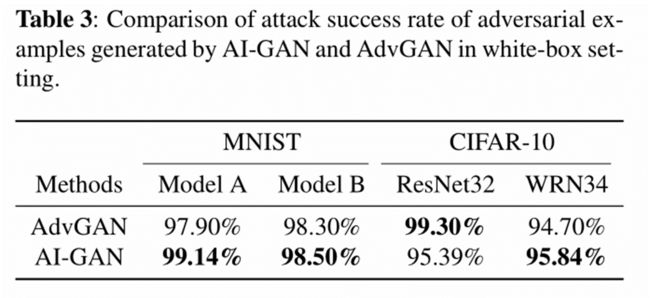

⭐ AI-GAN在不同数据集上表现出强大的攻击能力,并通过大量实验在不同环境下优于现有方法。

2、Related Work

一、生成扰动:

[1 Omid Poursaeed, Isay Katsman, Bicheng Gao, and Serge Belongie, “Generative adversarial perturbations,”

in Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, 2018, pp. 4422–4431.

第一次提出生成对抗扰动(四种扰动:通用的、依赖图片的、无目标、有目标)的概念。

[2] Xiaofeng Mao, Yuefeng Chen, Yuhong Li, Yuan He,and Hui Xue, “Gap++: Learning to generate target-

conditioned adversarial examples,” arXiv preprint arXiv:2006.05097, 2020.

在[1]的基础上增加了条件目标。

[3] Chaowei Xiao, Bo Li, Jun-Yan Zhu, Warren He,Mingyan Liu, and Dawn Song, “Generating Adversarial

Examples with Adversarial Networks,” in IJCAI, 2018. (advGAN)

用Gan的思想去生成接近真实世界的对抗样本。

二、直接生成对抗样本:

[4Yang Song, Rui Shu, Nate Kushman, and Stefano Ermon, “Constructing Unrestricted Adversarial Exam-

ples with Generative Models,” in NIPS, pp. 8312–8323.2018.

提出生成无限制的对抗样本。

个人补充:Zhou S, Zhang Y, Cao G, et al. Generating Adversarial Examples by Distributed Upsampling[C]//International Conference on Neural Information Processing. Springer, Cham, 2021: 177-189.(CCF C)

3、Experiments

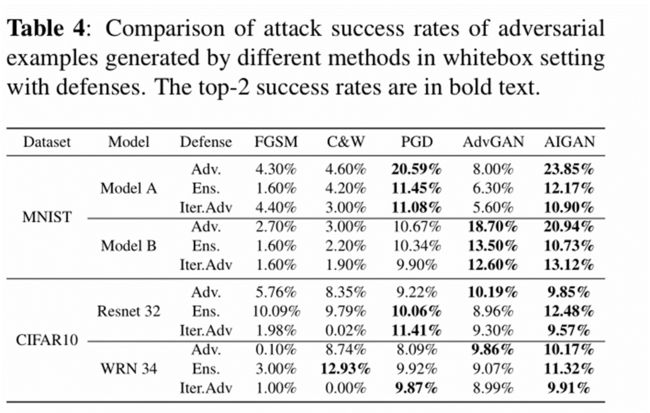

在有防御的情况下,与各个攻击方法的性能比较,排名前2的加粗显示。

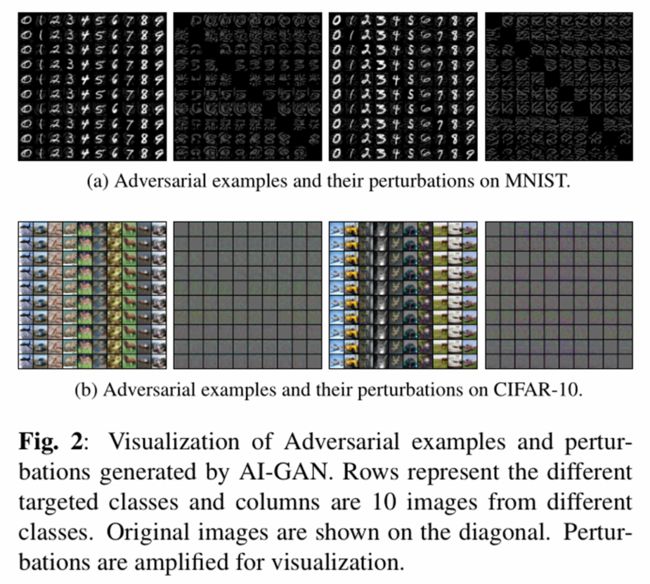

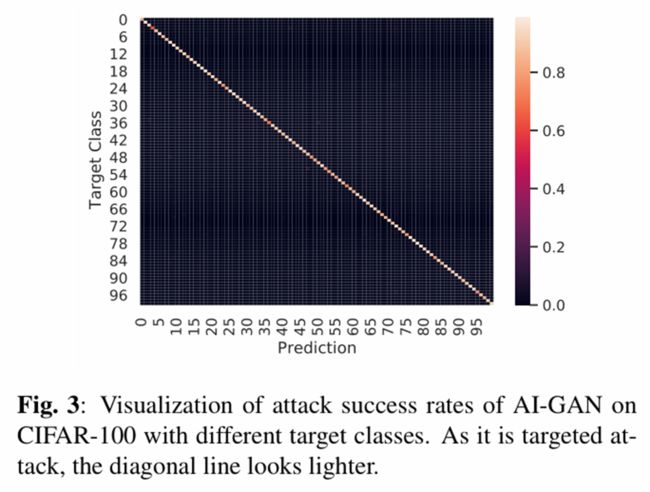

在CIfar100上的实验图片,这张图是在Cifar100上面的攻击成功率,这是通过混淆矩阵表示的,这个图的意思是对角线表示攻击成功的概率,其他的表示失败的概率,一般的混淆矩阵是直接在矩阵中用数字表示,比如,对角线上写的是500,就表示正确的个数有500个,但是这里坐标太密集了,用数字不好表示,作者就用色卡来表示:

7、Conclusion

突出创新点我认为在于:一、加入了attacker进行对抗训练;二、第一次在复杂的数据集上测试效果(Cifar-100)。