yolov5训练自己数据集(ultralytics版本)

0 准备工作

- 环境配置,参考这里

- 下载一个官方yolov5s.pt模型,放置在yolov5根目录下,下载链接这里或者这里

- 准备数据集,格式如下所示,每个图片有其对应的xml格式标注文件。

yolov5

├── models

├── runs

├── utils

├── data

│ ├── project01

│ │ ├── images

│ │ │ ├── 1.jpg

│ │ │ ├── 2.jpg

│ │ │ ├── ...

│ │ ├── xml

│ │ │ ├── 1.xml

│ │ │ ├── 2.xml

│ │ │ ├── ...

1 划分数据集

修改代码中的 --xml_path 和data/project01/labels ,这里是’data/project01/xml’,如果是和我一样在yolov5的data目录下新建的文件夹,那么直接把project01替换为你的文件夹名称。随后运行代码即可

train_percent 为训练集比例,一般训练集:验证集 ,9:1或者8:2,这里使用的是9:1

注:这个split.py放置在yolov5根目录,和data文件夹同级。

# split.py

import os

import random

import argparse

parser = argparse.ArgumentParser()

parser.add_argument('--xml_path', default='data/project01/xml', type=str, help='input xml label path')

parser.add_argument('--txt_path', default='data/project01/labels', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 1.0

train_percent = 0.9

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

file_test.close()

2 转换标签

- 这里修改的有4个地方

classes = [‘plane’, ‘ship’] ,这里引号中为你的类别名称

def convert_annotation函数中 in_file 和 out_file 的路径,如果是和我一样在yolov5的data目录下新建的文件夹,那么直接把project01替换为你的文件夹名称。

文件末尾有5个路径,,如果是和我一样在yolov5的data目录下新建的文件夹,那么直接把project01替换为你的文件夹名称。

重要 :末尾第五个路径末端为 .jpg\n,如果你的图片格式是bmp,那么修改为 .bmp\n ,其他格式类似。

随后直接运行代码即可

# txt2yolo_label.py

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

from tqdm import tqdm

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ['plane', 'ship']

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

# try:

in_file = open('data/project01/xml/%s.xml' % (image_id), encoding='utf-8')

out_file = open('data/project01/labels/%s.txt' % (image_id), 'w', encoding='utf-8')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

# difficult = obj.find('difficult').text

cls = obj.find('name').text

# if cls not in classes or int(difficult) == 1:

if cls not in classes :

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " +

" ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('data/project01/labels/'):

os.makedirs('data/project01/labels/')

image_ids = open('data/project01/labels/%s.txt' %

(image_set)).read().strip().split()

list_file = open('data/project01/%s.txt' % (image_set), 'w')

for image_id in tqdm(image_ids):

list_file.write('data/project01/images/%s.jpg\n' % (image_id))

convert_annotation(image_id)

list_file.close()

3 创建yaml文件

在data目录下新建project01.yaml文件

train: data/dat/train.txt

val: data/dat/val.txt

test: data/dat/test.txt

# Classes

nc: 2 # number of classes

names: ['plane', 'ship'] #注,这里的顺序和txt2yolo_label.py文件中的classes保持一致

4 开始训练

方式1:

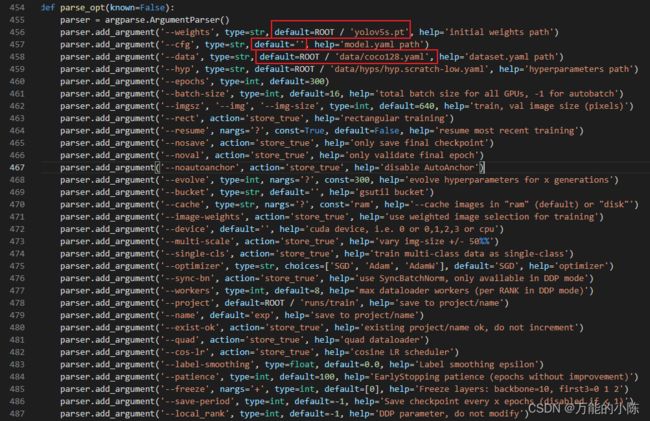

- 打开yolov5根目录下train.py文件,找到如下图所示位置

- 第一个红色框是模型位置,如果已经下载yolov5s.pt并且放置在根目录,则此处无需修改,否则修改为你模型所在位置。

- 第二个红色框是模型对应.yaml位置,一般在model文件夹中,需和模型对应,因此处用的yolov5s.pt,故这里应为

default=ROOT / 'models/yolov5s.yaml'. - 第三个红色框是咱们数据集对应的yaml位置,也就是咱们第三步时候创建的yaml文件位置,这里应为

default=ROOT / 'data/project01.yaml'

然后就可以直接运行train.py文件进行训练了

这里解释一下几个参数

–epoch #模型训练总轮数,默认300

–batch-size:批次大小

–imgsz --img-size:输入图片分辨率大小

–resume:恢复训练,接着上次被打断的结果继续训练

更多的参数解释,可以参考这篇博客,很详细

方式2:

在终端执行 python train.py --weights yolov5s.pt --cfg models/yolov5s.yaml --data data/project01.yaml

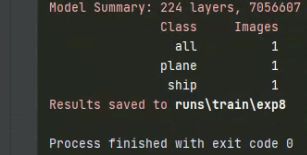

所有训练结果都保存在runs/train/递增的运行目录中,例如runs/train/exp2,runs/train/exp3等等。

5 使用训练好的模型进行检测

打开detect.py文件,

修改 --weights default = ‘runs/train/exp/weights/best.pt’ (这里有的可能是exp xx,根据自己保存位置修改)

修改 --source, default = ‘mypath’ # mypath为你测试图片存放的路径,可以相对路径或绝对路径

然后运行detece.py即可,检测完毕后去runs\detect\exp目录即可看到检测结果。

![]()