hadoop学习日记与资料整理

hadoop文件分布式系统的三大组成部分

1、HDFS

2、MR

3、YARN

一、HDFS

1. HDFS原理了解

2.hdfs文件读取过程

![]()

过程描述:

(1)客户端调用FileSyste对象的open()方法在分布式文件系统中打开要读取的文件。

(2)分布式文件系统通过使用RPC(远程过程调用)来调用namenode,确定文件起始块的位置。

(3)分布式文件系统的DistributedFileSystem类返回一个支持文件定位的输入流FSDataInputStream对象,FSDataInputStream对象接着封装DFSInputStream对象(存储着文件起始几个块的datanode地址),客户端对这个输入流调用read()方法。

(4)DFSInputStream连接距离最近的datanode,通过反复调用read方法,将数据从datanode传输到客户端。

(5) 到达块的末端时,DFSInputStream关闭与该datanode的连接,寻找下一个块的最佳datanode。

(6)客户端完成读取,对FSDataInputStream调用close()方法关闭连接。

3.hdfs文件写入过程

![]()

- 过程描述:

写文件过程分析:

(1) 客户端通过对DistributedFileSystem对象调用create()函数来新建文件。

(2) 分布式文件系统对namenod创建一个RPC调用,在文件系统的命名空间中新建一个文件。

(3)Namenode对新建文件进行检查无误后,分布式文件系统返回给客户端一个FSDataOutputStream对象,FSDataOutputStream对象封装一个DFSoutPutstream对象,负责处理namenode和datanode之间的通信,客户端开始写入数据。

(4)FSDataOutputStream将数据分成一个一个的数据包,写入内部队列“数据队列”,DataStreamer负责将数据包依次流式传输到由一组namenode构成的管线中。

(5)DFSOutputStream维护着确认队列来等待datanode收到确认回执,收到管道中所有datanode确认后,数据包从确认队列删除。

(6)客户端完成数据的写入,对数据流调用close()方法。

(7)namenode确认完成

4.Block的副本放置策略

![]()

第一个副本:放置在上传文件的DN;如果是集群外提交,则随机挑选一台磁盘不太满,CPU不太忙的节点。

第二个副本:放置在于第一个副本不同的 机架的节点上。

第三个副本:与第二个副本相同机架的节点。

更多副本:随机节点

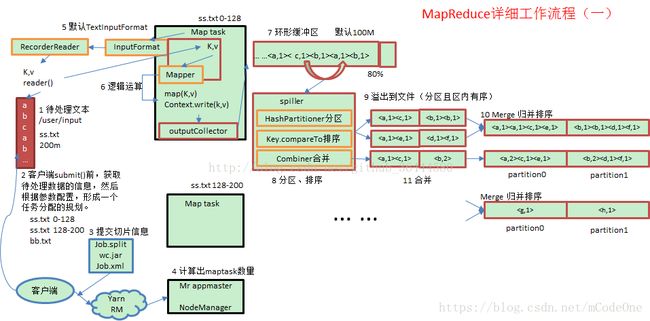

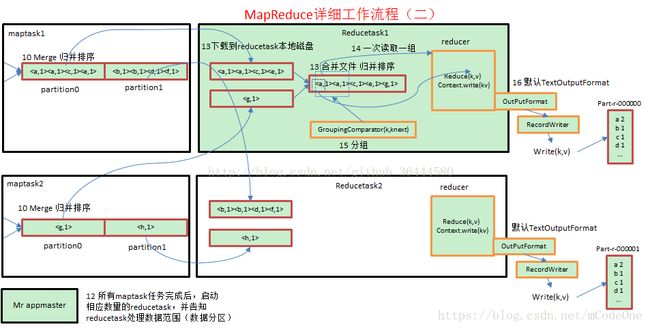

二、MR

1.MR过程

文件从HDFS通过split过程写入maptask。文件中maptask中被处理为

过程详解:

1)maptask收集我们的map()方法输出的kv对,放到内存缓冲区中

2)从内存缓冲区不断溢出本地磁盘文件,可能会溢出多个文件

3)多个溢出文件会被合并成大的溢出文件

4)在溢出过程中,及合并的过程中,都要调用partitoner进行分组和针对key进行排序

5)reducetask根据自己的分区号,去各个maptask机器上取相应的结果分区数据

6)reducetask会取到同一个分区的来自不同maptask的结果文件,reducetask会将这些文件再进行合并(归并排序)

7)合并成大文件后,shuffle的过程也就结束了,后面进入reducetask的逻辑运算过程(从文件中取出一个一个的键值对group,调用用户自定义的reduce()方法)

3)注意

Shuffle中的缓冲区大小会影响到mapreduce程序的执行效率,原则上说,缓冲区越大,磁盘io的次数越少,执行速度就越快。

缓冲区的大小可以通过参数调整,参数:io.sort.mb 默认100M

combiner合并

1)combiner是MR程序中Mapper和Reducer之外的一种组件

2)combiner组件的父类就是Reducer

3)combiner和reducer的区别在于运行的位置:

Combiner是在每一个maptask所在的节点运行

Reducer是接收全局所有Mapper的输出结果;

4)combiner的意义就是对每一个maptask的输出进行局部汇总,以减小网络传输量

6)combiner能够应用的前提是不能影响最终的业务逻辑,而且,combiner的输出kv应该跟reducer的输入kv类型要对应起来

Mapper

三、YARN

–YARN:Yet Another Resource Negotiator;

–Hadoop 2.0新引入的资源管理系统,直接从MRv1演化而来的;

•核心思想:将MRv1中JobTracker的资源管理和任务调度两个功能分开,分别由ResourceManager和ApplicationMaster进程实现

•ResourceManager:负责整个集群的资源管理和调度

•ApplicationMaster:负责应用程序相关的事务,比如任务调度、任务监控和容错等

–YARN的引入,使得多个计算框架可运行在一个集群中

•每个应用程序对应一个ApplicationMaster

•目前多个计算框架可以运行在YARN上,比如MapReduce、Spark、Storm等

–MapReduce On YARN:MRv2

–将MapReduce作业直接运行在YARN上,而不是由JobTracker和TaskTracker构建的MRv1系统中

–基本功能模块

•YARN:负责资源管理和调度

•MRAppMaster:负责任务切分、任务调度、任务监控和容错等

•MapTask/ReduceTask:任务驱动引擎,与MRv1一致

–每个MapRduce作业对应一个MRAppMaster

•MRAppMaster任务调度

•YARN将资源分配给MRAppMaster

•MRAppMaster进一步将资源分配给内部的任务

–MRAppMaster容错

•失败后,由YARN重新启动

•任务失败后,MRAppMaster重新申请资源

MR1.0的版本中存在的角色包括:

JobTracker

核心,主,单点

调度所有的作业

监控整个集群的资源负载

TaskTracker

从,自身节点资源管理

和JobTracker心跳,汇报资源,获取Task

Client

作业为单位

规划作业计算分布

提交作业资源到HDFS

最终提交作业到JobTracker

存在的弊端有:

JobTracker:负载过重,单点故障

资源管理与计算调度强耦合,其他计算框架需要重复实现资源管理

不同框架对资源不能全局管理

处理1.0出现的问题 在2.0中角色如下

YARN:解耦资源与计算

ResourceManager

–主,核心

–集群节点资源管理

NodeManager

–与RM汇报资源

–管理Container生命周期

–计算框架中的角色都以Container表示

Container:【节点NM,CPU,MEM,I/O大小,启动命令】

–默认NodeManager启动线程监控Container大小,超出申请资源额度,kill

–支持Linux内核的Cgroup

•MR-ApplicationMaster-Container

–作业为单位,避免单点故障,负载到不同的节点

–创建Task需要和RM申请资源(Container /MR 1024MB)

•Task-Container

–Client:

•RM-Client:请求资源创建AM

•AM-Client:与AM交互