[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022

AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time

- 论文信息

- 背景

- AlphaPose

-

- 全身的多人姿态估计

-

- 对称积分回归Symmetric Integral Keypoints Regression

-

- 先来看第(1)个问题

- 再来看第(2)个问题

- pose NMS

- 多域Knowledge distillation

- 多人跟踪Multi-person tracking

-

- PGA

- MSIM

- AlphaPose整体框架

- 总结

- References

论文信息

论文题目:AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time

发表:IEEE TPAMI,2022

作者:Hao-Shu Fang∗, Jiefeng Li∗, Hongyang Tang, Chao Xu , H a o y i Z h u , Haoyi Zhu ,HaoyiZhu, Yuliang Xiu, Yong-Lu Li, and Cewu Lu

背景

传统的姿态估计与跟踪主要利用躯干的信息,然而为了捕捉人类的细微动作以进行复杂的行为分析,全身姿势估计(包括面部、身体、手和脚在内)比传统的仅身体姿势估计更为重要。

这篇文章提出了一个新的框架AlphaPose****能够用于全身的姿多人态估计与跟踪。所提的多人姿态估计方法属于自上而下的两阶段方法:即先检测人体的边界框,然后在分别估计每个边界框内的人体姿态。后面的跟踪实际上就是在多人姿态估计的基础上加上了人体身份识别。

AlphaPose

给定一个输入图像,我们首先使用YoloV3或EfficientDet等现成的物体检测器获得(i)人类检测的边界框。 对于每一个检测到的人类,我们对其进行裁剪和调整大小,并将其通过姿势估计和跟踪网络以获得全身人类姿势和Re-ID特征。

整个过程中涉及到的技术点有:

(a)对称积分回归被用于精细级别的关键点定位。(b)采用pose NMS来消除多余的姿势。©姿势引导的对齐(PGA)模块被应用于预测的人类再识别特征,以获得姿势对齐的人类再识别特征。(d)多阶段身份匹配(MSIM)利用人类的姿势、Re-id特征和检测到的边界框来产生最终的跟踪身份。并且,(e)在训练过程中,建议生成器和知识蒸馏被用来进一步提高网络的泛化能力。

下面主要介绍框架的两大块: 全身的多人姿态估计, 多人跟踪, 然后再介绍整体框架。

全身的多人姿态估计

全身的多人姿态估计框架图如下。

下面对包含的技术点进行介绍。

对称积分回归Symmetric Integral Keypoints Regression

热图Heatmap是人体姿态估计领域中联合定位的主要表示, 然而它不可避免的带来量化误差,作者认为基于soft-argmax的积分回归更适合全身关键点定位, 然而它也存在问题,具体表现在: (1)不对称梯度问题 (2)大小相关的关键点评分问题。

先来看第(1)个问题

积分回归操作:

其中 p x p_{x} px表示像素在heatmap上归一化之后的似然。

基于L1范数的回归损失定义为:

L r e g = ∣ ∣ μ − μ ^ ∣ ∣ 1 L_{reg}=|| \mu - \hat{\mu} ||_{1} Lreg=∣∣μ−μ^∣∣1

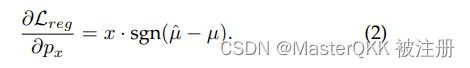

每个像素的梯度:

可以发现:梯度的振幅是不对称的,给定相同的距离误差,当关键点位于不同位置时,梯度变得不同。这显然有问题。

进一步通过Lipschitz分析展示ASG可以提供更稳定的梯度用于训练:

对于ASG, 我们设置 A g r a d A_{grad} Agrad=W/8,以使梯度的平均范数与积分回归相同, 最终可得:

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第3张图片](http://img.e-com-net.com/image/info8/72dbfbfd41d4475c8472618c212ac3d7.jpg)

这表明: ASG的Lipschitz常数是原始积分回归的1/4倍,表示梯度空间更平滑,并且可以更容易地优化模型。

再来看第(2)个问题

在以前的方法中,heatmap的最大值被视为联合置信度,该置信度依赖于heatmap大小且不准确: 大关节(例如左髋关节)将产生比小关节(例如鼻子)更小的置信值,这会损害预测置信值的可靠性,显然是有问题的。

因此作者提出了Two-step Heatmap Normalization来克服这个问题:

首先对于Logits Z, 通过逐元素进行归一化:

然后再获取最大值作为置信度值:

这样一来置信度的计算就摆脱了heatmap尺寸的限制。

pose NMS

对于自上而下的两阶段方法,一个主要的缺点是早期承诺问题, 如果人类检测器未能检测到一个人,那么姿态估计器就没有办法恢复它。

以往的方法往往设置了一个很高的阈值导致往往出现该问题。

在这里,相反,作者设置了很小的阈值来确保高检测召回率。 这样一来,human detections不可避免存在冗余, 因此作者提出了pose NMS来消除这些冗余: 首先,选择最有把握的姿态pose作为参考,然后应用消除标准elimination criterion对与之接近的一些姿势进行消除。这个过程在剩余的姿势集上重复进行,直到多余的姿势被消除.

下面来看elimination criterion:

如果pose i 与参考pose j之间的距离小于指定阈值,则人定pose i为冗余,

那么如何定义两个pose之间的距离呢?

由于每个pose实际上就是一些点组成的边界框和 置信度, 因此distance的定义也是利用置信度信息,和位置信息, 如下:

第一部分计算两个pose的置信度的相关性,只有当两个pose对应点的置信度都很高时,值才会接近1; 第二部分基于高斯核计算两个pose之间的距离。

这里涉及到4个参数: θ 1 , θ 2 , λ , η \theta_{1}, \theta_{2}, \lambda, \eta θ1,θ2,λ,η, 如何优化呢? 作者提出每次固定两个参数,然后去优化另外两个参数,迭代直至收敛。

多域Knowledge distillation

除了标注新的数据集以外,作者v采用多域知识蒸馏来寻来训练网络。三个额外的数据集包括:namely 300Wface [61], FreiHand [62] and InterHand [63], 训练的每个Batch由来自不同数据集的样本组成,每个样本采用了特定数据集的数据增广策略。

尽管这些特定领域的数据集能够提供准确的中间监督,但它们的数据分布与野外图像有很大不同。为了解决这个问题,作者将姿势引导建议生成器pose-guided proposal generator扩展到全身场景,并以统一的方式进行数据扩充。

下面来看这个Part-Guided Proposal Generator:

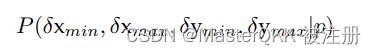

对于具有紧密包围边界框的不同身体部位,建议生成器生成一个与人体检测器输出分布一致的新框。由于我们已经有了每个部分的地面真实边框,我们把这个问题简化为对检测到的边界框和地面真实边界框之间的相对偏移量的分布进行建模,不同部分的偏移量不同。更具体地说,存在着一个分布:

由于水平和垂直方向的边界框的方差时独立的,因此可以分开简化建模:

其中:

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第5张图片](http://img.e-com-net.com/image/info8/9df8c8230b6542dca1a21e7a412d9d70.jpg)

为了求解这个问题, 作者基于自行标注的数据集alpe-FullBody, 首先把每个样本的标注信息(f face, body and hand.)分开,然后分别计算偏移。在处理完Halpe-FullBody中的所有实例后,偏移量形成了一个频率分布,将数据拟合为一个高斯混合分布。对于不同的身体部位,我们有不同的高斯混合参数。

这样一来, 在训练阶段,对于属于不同部位的samples, 可以根据上述拟合的相应分布来得到相应的偏移量, 从而把不同部位的数据集的数据增广整合到一个统一的框架用于训练。

多人跟踪Multi-person tracking

多人跟踪实际上就是在姿态估计器额基础上再加了一个人的重新识别分支网络。因此,网络可以同时估计人类的姿势和重新识别特征。最后, 通过多阶段身份匹配(MSIM)算法,人类的提议信息(身份嵌入、箱体和姿势)被整合起来,从而实现在线实时姿势跟踪。

这里主要涉及两个技术点: 一个是Pose-Guided Attention Mechanism (PGA) 模块,用于进一步提升人的身份特征, 另一个是MSIM, 下面对这连个技术分别介绍。

PGA

人的re-ID特征可以用来从大量的人的提议中识别同一个人。在我们自上而下的框架中,我们从物体检测器产生的每个边界框中提取re-ID特征。然而,re-ID特征的质量会被边界框中的背景所降低,尤其是当边界框中存在其他人的身体时。为了解决这个问题,我们提出了姿势引导注意(PGA),强制提取的特征集中在感兴趣的人体上而忽略背景的影响。

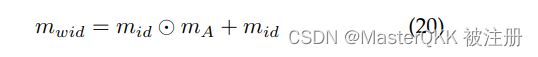

对于每个人,pose estimator产生一个包含有k个关键点的轮廓,对应k个heatmap。记re-ID特征为 m i d m_{id} mid., 注意力权重为 m A m_{A} mA, 则加权后的re-ID特征为:

最后再通过一个全连接层得到128维的身份嵌入特征。

MSIM

记第t帧的第i个人的提议proposal为 H t i H_{t}^{i} Hti, 其总共包含三方面的特征信息: 姿态 P t i P_{t}^{i} Pti, 边界框 B t i B_{t}^{i} Bti, 上一步获得的身份特征嵌入 E t i E_{t}^{i} Eti。 MSIM算法的作用就是利用这些信息来为每个 H t i H_{t}^{i} Hti分配相应的ID。

假定前t-1帧的检测与跟踪结果保存在跟踪池Pl中, 首先利用kalman滤波器来平滑这些特征,匹配国策灰姑娘分为两步。

第一个阶段主要是计算第t帧的身份嵌入和池Pl中的嵌入之间的亲和矩阵Affinity Matrix M e m b i M_{emb}^{i} Membi,匹配规定定义如下:

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第7张图片](http://img.e-com-net.com/image/info8/26693526bd2543d985cd4768438fc87e.jpg)

link(p, q)表示 H t p H_{t}^{p} Htp与Pl中的第q个human proposal的轨迹相同。

第二个阶段,作者考虑那些未被跟踪的人类提议的位置和形状约束

形状和位置的融合距离矩阵可写为:

为了匹配那些与前几帧不是很相似的小轨道,我们适当地降低阈值,并重复上述阶段。如果仍然没有匹配的提议,作者认为这是一个新的追踪器,所以会给它分配一个新的ID。

.

AlphaPose整体框架

系统的整体框架分为5个部分:

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第8张图片](http://img.e-com-net.com/image/info8/c475724a326c4d999fe3d24b408eb02c.jpg)

通过FIFO队列,作者并行实现这5各部分,前一部分的输出作为后一部分的输入,这几大提升了运行效率。

网络结构这块, 对于human detector, 作者直接借用了经典的检测器, 比如: YOLOV3,

对于pose estimator, 作者设计了新的网络, 如下图:

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第9张图片](http://img.e-com-net.com/image/info8/1d5b032bb8fb4b3b95df613534a83953.jpg)

总结

很好的系统,借鉴吸收了很多文章的思想和成果, 没有相关经验积累很难搞出来…

References

1.Fang H S, Li J, Tang H, et al. AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time[J]. arXiv preprint arXiv:2211.03375, 2022.

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第1张图片](http://img.e-com-net.com/image/info8/11c4b7b3d535420fab3bb6554b72d3c5.jpg)

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第2张图片](http://img.e-com-net.com/image/info8/ef2b60de5e3e4678887085818398559c.jpg)

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第4张图片](http://img.e-com-net.com/image/info8/9df6f08354664a4baaa242e57703d613.jpg)

![[论文评析]AlphaPose: Whole-Body Regional Multi-Person Pose Estimation and Tracking in Real-Time2022_第6张图片](http://img.e-com-net.com/image/info8/186699634c894dc6ba602b925ed0b25d.jpg)