NNDL 实验七 循环神经网络(2)梯度爆炸实验

文章目录

-

- 6.2 梯度爆炸实验

-

- 6.2.1 梯度打印函数

- 6.2.2 复现梯度爆炸现象

- 6.2.3 使用梯度截断解决梯度爆炸问题

- 总结

- 参考

6.2 梯度爆炸实验

造成简单循环网络较难建模长程依赖问题的原因有两个:梯度爆炸和梯度消失。

梯度爆炸问题:比较容易解决,一般通过权重衰减或梯度截断可以较好地来避免;

梯度消失问题:更加有效的方式是改变模型,比如通过长短期记忆网络LSTM来进行缓解。

本节将首先进行复现简单循环网络中的梯度爆炸问题,然后尝试使用梯度截断的方式进行解决。

采用长度为20的数据集进行实验,

训练过程中将进行输出W,U,b的梯度向量的范数,以此来衡量梯度的变化情况。

6.2.1 梯度打印函数

在训练过程中打印梯度

分别定义W_list, U_list和b_list,用于分别存储训练过程中参数W,U和b的梯度范数。

W_list = []

U_list = []

b_list = []

# 计算梯度范数

def custom_print_log(runner):

model = runner.model

W_grad_l2, U_grad_l2, b_grad_l2 = 0, 0, 0

for name, param in model.named_parameters():

if name == "rnn_model.W":

W_grad_l2 = torch.norm(param.grad, p=2).numpy()

if name == "rnn_model.U":

U_grad_l2 = torch.norm(param.grad, p=2).numpy()

if name == "rnn_model.b":

b_grad_l2 = torch.norm(param.grad, p=2).numpy()

print(f"[Training] W_grad_l2: {W_grad_l2:.5f}, U_grad_l2: {U_grad_l2:.5f}, b_grad_l2: {b_grad_l2:.5f} ")

W_list.append(W_grad_l2)

U_list.append(U_grad_l2)

b_list.append(b_grad_l2)

【思考】什么是范数,什么是L2范数,这里为什么要打印梯度范数?

- 范数

范数,是具有“距离”概念的函数。我们知道距离的定义是一个宽泛的概念,只要满足非负、自反****、三角不等式就可以称之为距离。范数是一种强化了的距离概念,它在定义上比距离多了一条数乘的运算法则。有时候为了便于理解,我们可以把范数当作距离来理解。

在数学上,范数包括向量范数和矩阵范数,向量范数表征向量空间中向量的大小,矩阵范数表征矩阵引起变化的大小。一种非严密的解释就是,对应向量范数,向量空间中的向量都是有大小的,这个大小如何度量,就是用范数来度量的,不同的范数都可以来度量这个大小,就好比米和尺都可以来度量远近一样;对于矩阵范数,学过线性代数,我们知道,通过运算AX=B,可以将向量X变化为B,矩阵范数就是来度量这个变化大小的。

- L2范数

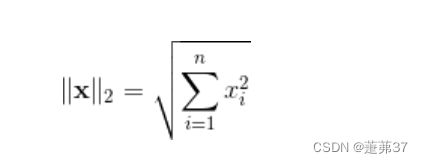

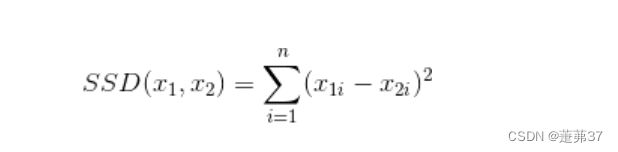

L2范数是我们最常见最常用的范数了,我们用的最多的度量距离欧氏距离就是一种L2范数,L2范数是指向量各元素的平方和然后求平方根,它的定义如下:

表示向量元素的平方和再开平方。

表示向量元素的平方和再开平方。

像L1范数一样,L2也可以度量两个向量间的差异,如平方差和(Sum of Squared Difference):

对于L2范数,它的优化问题如下:

L2范数通常会被用来做优化目标函数的正则化项,防止模型为了迎合训练集而过于复杂造成过拟合的情况,从而提高模型的泛化能力。

L2范数通常会被用来做优化目标函数的正则化项,防止模型为了迎合训练集而过于复杂造成过拟合的情况,从而提高模型的泛化能力。 - 为什么要打印梯度范数

函数在某一点处的方向导数在其梯度方向上达到最大值,此最大值即梯度的范数。 而模型的学习过程是通过使用训练数据来最小化损失函数,从而确定参数的值。而最小化损失函数,即通过求导求损失函数的极值。打印梯度范数值可以帮助我们更直观地了解模型训练情况的好坏,梯度过大或过小都有可能导致模型的训练效果变差,因此打印梯度范数有利于我们更快地对模型作出修改。

6.2.2 复现梯度爆炸现象

为了更好地复现梯度爆炸问题,使用SGD优化器将批大小和学习率调大,学习率为0.2,同时在计算交叉熵损失时,将reduction设置为sum,表示将损失进行累加。

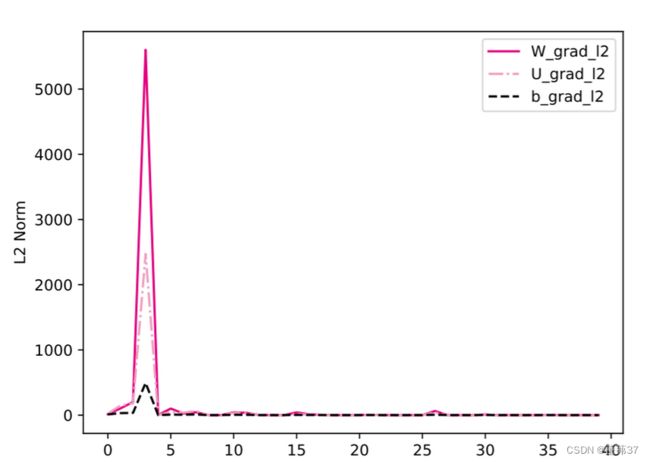

获取训练过程中关于W,U和b参数梯度的L2范数,并将其绘制为图片以便展示。

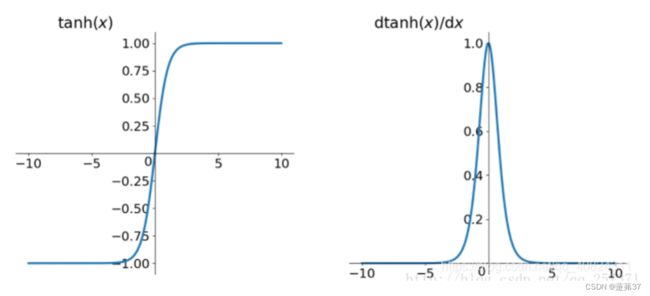

因为Tanh为Sigmoid型函数,其饱和区的导数接近于0,

由于梯度的急剧变化,参数数值变的较大或较小,容易落入梯度饱和区,导致梯度为0,模型很难继续训练.

代码如下:

代码如下:

import os

import random

import torch

import numpy as np

np.random.seed(0)

random.seed(0)

torch.seed()

# 训练轮次

num_epochs = 50

# 学习率

lr = 0.2

# 输入数字的类别数

num_digits = 10

# 将数字映射为向量的维度

input_size = 32

# 隐状态向量的维度

hidden_size = 32

# 预测数字的类别数

num_classes = 19

# 批大小

batch_size = 64

# 模型保存目录

save_dir = "./checkpoints"

# 可以设置不同的length进行不同长度数据的预测实验

length = 20

print(f"\n====> Training SRN with data of length {length}.")

# 加载长度为length的数据

data_path = f"./datasets/{length}"

train_examples, dev_examples, test_examples = load_data(data_path)

train_set, dev_set, test_set = DigitSumDataset(train_examples), DigitSumDataset(dev_examples),DigitSumDataset(test_examples)

train_loader = DataLoader(train_set, batch_size=batch_size)

dev_loader = DataLoader(dev_set, batch_size=batch_size)

test_loader = DataLoader(test_set, batch_size=batch_size)

# 实例化模型

base_model = SRN(input_size, hidden_size)

model = Model_RNN4SeqClass(base_model, num_digits, input_size, hidden_size, num_classes)

# 指定优化器

optimizer = torch.optim.SGD(lr=lr, params=model.parameters())

# 定义评价指标

metric = Accuracy()

# 定义损失函数

loss_fn = nn.CrossEntropyLoss(reduction="sum")

# 基于以上组件,实例化Runner

runner = RunnerV3(model, optimizer, loss_fn, metric)

# 进行模型训练

model_save_path = os.path.join(save_dir, f"srn_explosion_model_{length}.pdparams")

runner.train(train_loader, dev_loader, num_epochs=num_epochs, eval_steps=100, log_steps=1,

save_path=model_save_path, custom_print_log=custom_print_log)

获取训练过程中关于W,U和b参数梯度的L2范数,并将其绘制为图片以便展示。

import matplotlib.pyplot as plt

def plot_grad(W_list, U_list, b_list, save_path, keep_steps=40):

# 开始绘制图片

plt.figure()

# 默认保留前40步的结果

steps = list(range(keep_steps))

plt.plot(steps, W_list[:keep_steps], "r-", color="#e4007f", label="W_grad_l2")

plt.plot(steps, U_list[:keep_steps], "-.", color="#f19ec2", label="U_grad_l2")

plt.plot(steps, b_list[:keep_steps], "--", color="#000000", label="b_grad_l2")

plt.xlabel("step")

plt.ylabel("L2 Norm")

plt.legend(loc="upper right")

plt.show()

plt.savefig(save_path)

print("image has been saved to: ", save_path)

save_path = f"./images/6.8.pdf"

plot_grad(W_list, U_list, b_list, save_path)

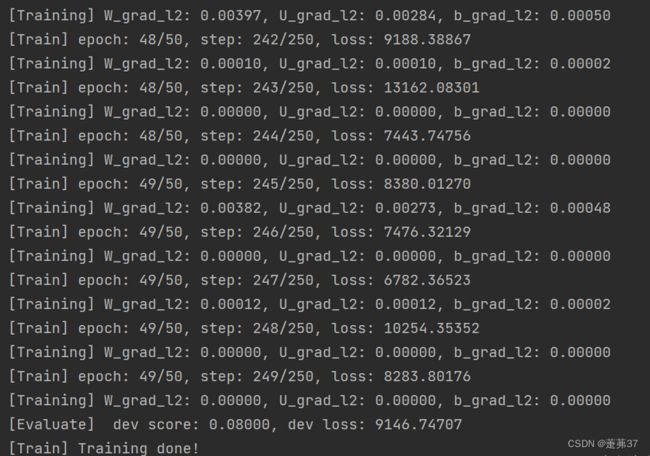

运行结果:

接下来,使用梯度截断策略的模型在测试集上进行测试。

# 加载训练过程中效果最好的模型

model_path = os.path.join(save_dir, "srn_explosion_model_20.pdparams")

runner.load_model(model_path)

# 使用测试集评价模型,获取测试集上的预测准确率

score, _ = runner.evaluate(test_loader)

print(f"[SRN] length:{length}, Score: {score: .5f}")

6.2.3 使用梯度截断解决梯度爆炸问题

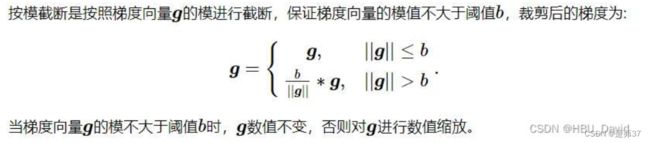

梯度截断是一种可以有效解决梯度爆炸问题的启发式方法,

当梯度的模大于一定阈值时,就将它截断成为一个较小的数。

一般有两种截断方式:按值截断和按模截断.

本实验使用按模截断的方式解决梯度爆炸问题。

将RunnerV3修改如下:

将RunnerV3修改如下:

class RunnerV3(object):

def __init__(self, model, optimizer, loss_fn, metric, **kwargs):

self.model = model

self.optimizer = optimizer

self.loss_fn = loss_fn

self.metric = metric # 只用于计算评价指标

# 记录训练过程中的评价指标变化情况

self.dev_scores = []

# 记录训练过程中的损失函数变化情况

self.train_epoch_losses = [] # 一个epoch记录一次loss

self.train_step_losses = [] # 一个step记录一次loss

self.dev_losses = []

# 记录全局最优指标

self.best_score = 0

def train(self, train_loader, dev_loader=None, **kwargs):

# 将模型切换为训练模式

self.model.train()

# 传入训练轮数,如果没有传入值则默认为0

num_epochs = kwargs.get("num_epochs", 0)

# 传入log打印频率,如果没有传入值则默认为100

log_steps = kwargs.get("log_steps", 100)

# 评价频率

eval_steps = kwargs.get("eval_steps", 0)

# 传入模型保存路径,如果没有传入值则默认为"best_model.pdparams"

save_path = kwargs.get("save_path", "best_model.pdparams")

custom_print_log = kwargs.get("custom_print_log", None)

# 训练总的步数

num_training_steps = num_epochs * len(train_loader)

if eval_steps:

if self.metric is None:

raise RuntimeError('Error: Metric can not be None!')

if dev_loader is None:

raise RuntimeError('Error: dev_loader can not be None!')

# 运行的step数目

global_step = 0

# 进行num_epochs轮训练

for epoch in range(num_epochs):

# 用于统计训练集的损失

total_loss = 0

for step, data in enumerate(train_loader):

X, y = data

# 获取模型预测

logits = self.model(X)

loss = self.loss_fn(logits, y.long()) # 默认求mean

total_loss += loss

# 训练过程中,每个step的loss进行保存

self.train_step_losses.append((global_step, loss.item()))

if log_steps and global_step % log_steps == 0:

print(

f"[Train] epoch: {epoch}/{num_epochs}, step: {global_step}/{num_training_steps}, loss: {loss.item():.5f}")

# 梯度反向传播,计算每个参数的梯度值

loss.backward()

if custom_print_log:

custom_print_log(self)

# 小批量梯度下降进行参数更新

nn.utils.clip_grad_norm_(parameters=model.parameters(), max_norm=20, norm_type=2)

self.optimizer.step()

# 梯度归零

self.optimizer.zero_grad()

# 判断是否需要评价

if eval_steps > 0 and global_step > 0 and \

(global_step % eval_steps == 0 or global_step == (num_training_steps - 1)):

dev_score, dev_loss = self.evaluate(dev_loader, global_step=global_step)

print(f"[Evaluate] dev score: {dev_score:.5f}, dev loss: {dev_loss:.5f}")

# 将模型切换为训练模式

self.model.train()

# 如果当前指标为最优指标,保存该模型

if dev_score > self.best_score:

self.save_model(save_path)

print(

f"[Evaluate] best accuracy performence has been updated: {self.best_score:.5f} --> {dev_score:.5f}")

self.best_score = dev_score

global_step += 1

# 当前epoch 训练loss累计值

trn_loss = (total_loss / len(train_loader)).item()

# epoch粒度的训练loss保存

self.train_epoch_losses.append(trn_loss)

print("[Train] Training done!")

# 模型评估阶段,使用'torch.no_grad()'控制不计算和存储梯度

@torch.no_grad()

def evaluate(self, dev_loader, **kwargs):

assert self.metric is not None

# 将模型设置为评估模式

self.model.eval()

global_step = kwargs.get("global_step", -1)

# 用于统计训练集的损失

total_loss = 0

# 重置评价

self.metric.reset()

# 遍历验证集每个批次

for batch_id, data in enumerate(dev_loader):

X, y = data

# 计算模型输出

logits = self.model(X)

# 计算损失函数

loss = self.loss_fn(logits, y.long()).item()

# 累积损失

total_loss += loss

# 累积评价

self.metric.update(logits, y)

dev_loss = (total_loss / len(dev_loader))

dev_score = self.metric.accumulate()

# 记录验证集loss

if global_step != -1:

self.dev_losses.append((global_step, dev_loss))

self.dev_scores.append(dev_score)

return dev_score, dev_loss

# 模型评估阶段,使用'torch.no_grad()'控制不计算和存储梯度

@torch.no_grad()

def predict(self, x, **kwargs):

# 将模型设置为评估模式

self.model.eval()

# 运行模型前向计算,得到预测值

logits = self.model(x)

return logits

def save_model(self, save_path):

torch.save(self.model.state_dict(), save_path)

def load_model(self, model_path):

state_dict = torch.load(model_path)

self.model.load_state_dict(state_dict)

from torch.utils.data import Dataset,DataLoader

class DigitSumDataset(Dataset):

def __init__(self, data):

self.data = data

def __getitem__(self, idx):

example = self.data[idx]

seq = torch.tensor(example[0], dtype=torch.int64)

label = torch.tensor(example[1], dtype=torch.int64)

return seq, label

def __len__(self):

return len(self.data)

引入按模截断的策略之后,模型训练时参数梯度的变化情况。可以看到,随着迭代步骤的进行,梯度始终保持在一个有值的状态,表明按模截断能够很好地解决梯度爆炸的问题。

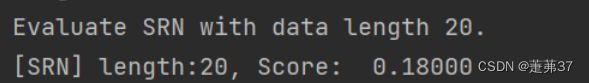

接下来,使用梯度截断策略的模型在测试集上进行测试:

print(f"Evaluate SRN with data length {length}.")

# 加载训练过程中效果最好的模型

model_path = os.path.join(save_dir, "srn_explosion_model_20.pdparams")

runner.load_model(model_path)

# 使用测试集评价模型,获取测试集上的预测准确率

score, _ = runner.evaluate(test_loader)

print(f"[SRN] length:{length}, Score: {score: .5f}")

运行结果:

由于为复现梯度爆炸现象,改变了学习率,优化器等,因此准确率相对比较低。但由于采用梯度截断策略后,在后续训练过程中,模型参数能够被更新优化,因此准确率有一定的提升。

【思考题】梯度截断解决梯度爆炸问题的原理是什么?

将梯度约束在某一个区间之内,在训练的过程中,在优化器更新之前进行梯度截断操作解决梯度爆炸问题。

梯度裁剪是解决梯度爆炸的一种技术,其出发点是非常简明的:如果梯度变得非常大,那么我们就调节它使其保持较小的状态。精确的说,如果 ∥ g ∥ ≥ c,则

g←c⋅g/∥g∥

此处的c指超参数, g 指梯度, ∥ g ∥ 为梯度的范数, g / ∥ g ∥ 必然是个单位矢量,因此在进行调节后新的梯度范数必然等于c,注意到如果 ∥ g ∥ ≤ c 则不需要进行调节。

梯度裁剪确保了梯度矢量的最大范数(本文中规定为c)。即使在模型的损失函数不规则时,这一技巧也有助于梯度下降保持合理的行为。下面的图片展示了损失函数的陡崖。不采用裁剪,参数将会沿着梯度下降方向剧烈变化,导致其离开了最小值范围;而使用裁剪后参数变化将被限制在一个合理范围内,避免了上面的情况。

总结

本次实验主要学习神经网络梯度爆炸众多解决办法中的梯度截断。了解了梯度截断解决梯度爆炸问题的原理,了解了梯度裁剪是解决梯度爆炸的一种简单高效的方法,并且梯度裁剪可以应用于所有神经网络的训练中(任何可能发生梯度爆炸的训练过程都适用)。

参考

什么是范数(norm)?以及L1,L2范数的简单介绍

解决 “梯度爆炸” 的方法 - 梯度裁剪