生物特征识别中手静脉模式的主体内相似性研究

文章目录

- 摘要

- 一、引言

- 二、一个人的左右生物特征的相似性

-

- 1.引入库

- 三、手静脉生物识别

-

- 3.1. 传统方法

- 3.2. 基于深度学习的方法

- 四、二采用基于cnn的识别系统

-

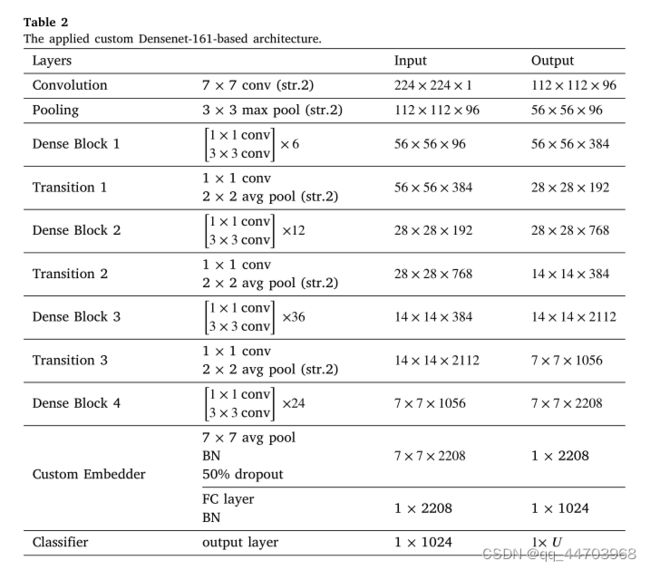

- 4.1. 网络拓扑结构

- 4.2. 网络初始化与优化

- 五、实验分析与讨论

-

- 5.1 使用的数据库

- 5.2 实验框架

- 5.3.交叉手模板的相似性

- 总结

摘要

近年来,基于手静脉模式的生物特征识别正受到业界和学术界越来越多的关注,这是因为它与传统的方法(如依赖指纹、虹膜或面部的方法)相比具有优势。然而,仍有一些性质的静脉性状需要研究和充分了解。在这篇论文中,我们在这里分析了相似的水平,评估生物识别系统的识别率,在手指,手掌和一个人的左手和右手的背静脉模式。换句话说,我们分析一个被试者,用一只手的静脉模式,手指静脉,手掌静脉,背静脉,是否可以用另一只手的对应模式来识别。我们的研究使用基于深度学习的特征提取方法、三种不同的静脉模式和四个不同的数据库进行。实验结果表明,同一受试者不同手的手指、手掌和背侧区域相对于不同人同一手的特征具有更多的相似性。此外,我们的研究结果指出,相应手指静脉模式的相似性可以用于识别目的,但这仍不能应用于手掌和背静脉模式。

一、引言

在现实生活中应用生物特征识别技术的需求正以越来越快的速度增长,从消费设备到边境控制,从监视到访问控制和金融服务,举几个例子。人脸、指纹、虹膜和声音是目前用来自动识别人的最成熟的生物特征。在新兴的模式中,业界和学术界都对开发手静脉模式表现出越来越大的兴趣,因为这种特性相对于更成熟的生物特征模式具有一些优势。事实上,在没有公开暴露的情况下,手指、手掌和手背等静脉模式比其他生物识别标识更容易受到攻击。此外,它们的获取可以使用非接触的方法,从而增加了用户的便利性。

尽管在现实应用中使用的一些系统已经将手静脉模式用于自动生物特征识别,但这些特征仍有一些特性需要适当分析。具体而言,在本文中,我们在生物特征识别框架内,研究了同一受试者的右手和左手静脉模式是否存在相似特征。更详细地说,本研究源于我们之前的分析(Piciucco, Kuzu, Maiorana, & Campisi, 2019),并提供了以下内容:

在这篇文章中,我们对piiciucco等人(2019)的研究进行了更深入的分析,在picucco等人的研究中,我们初步评估了一个人的右手和左手对应手指的静脉模式中存在类似的特征。更具体地说,在这篇论文中,我们检查了右手和左手手掌、右手和左手背以及相应的右手和左手手指的静脉模式的相似程度;

这里利用了四个不同的数据库来评估左手和右手静脉中相似模式的存在,从而提供了比Piciucco等人(2019)中更具有统计学意义的分析,其中考虑了单个数据集;

Piciucco等人(2019)主要考虑了手工制作的特征,以推测左右手指静脉模式的相似性。另一方面,我们在这里求助于深度学习方法来自动处理考虑的特征。具体来说,我们使用最近引入的损失函数(Deng, Guo, Xue, & Zafeiriou, 2019)来提高提取特征的可辨别性,即使在执行开集训练过程时也是如此。此外,采用了两种不同的学习策略来推导我们进行分析的鉴别特征。其中一个是专门设计来寻找实验对象右手和左手的静脉图案。如下所示,所采用的方法能够在对应的静脉模式对之间定位相似的特征,这与picucco等人(2019)提出的方法不同。

值得注意的是,就我们所知,还没有任何解剖学研究专门调查过一个人的左手和右手静脉模式之间是否存在相似性。目前的研究,在生物识别框架内,通过使用深度学习策略来阐明这个主题,专门设计来寻找这种相似性。

二、一个人的左右生物特征的相似性

1.引入库

在过去的生物识别场景中,人类身体左右两侧的生物特征之间的潜在相似性已经被研究过。登记的生物特征的潜在互换性可能会在现实世界的系统中带来一些好处,比如避免在某个特征不再可用时重新登记,从而增加用户的便利性和灵活性。

此外,清楚地了解这种相似性的存在,有助于优化实验方案的设计,决定是否从用于估计冒名顶替者识别分数分布的样本中排除属于身体另一侧的特征,而不是被考虑纳入真正的受试者。事实上,作为预防措施,ISO/IEC 19795标准的建议(信息技术-生物特征测试和报告)建议避免使用,作为冒名顶替者的尝试,在一个主体的相同生物特征的左右实例之间进行比较,因为个体内部的差异可能低于个体间的差异(国际标准化组织,2006,第7.6.1.3段)。

Bowyer、Lagree和Fenker(2010)报道了关于受试者左右生物特征之间可能的相似性的首次探索,其中每个用户的左虹膜与所有考虑的受试者的右虹膜进行比较,依赖于道格曼(2004)提出的二元虹膜模板表示。通过比较同一受试者和不同受试者的数据,得到的距离分布基本重合,证实了同一个人的左右虹膜并不比不同人的虹膜匹配得更紧密。尽管如此,Bowyer等人(2010)也报道了依赖人类观察者的测试,他们被要求判断一对左右眼图像是否来自同一个人。

有趣的是,在没有任何虹膜解剖知识的情况下,参与实验的观察者对所呈现的图像对进行了超过86%的正确分类,如果只显示了虹膜区域或只显示了眼周区域,则这个比例略低至83%。这样的结果支持了这样一个假设,即左右虹膜之间确实存在类似的图案,但采用的自动虹膜生物识别技术无法像人类那样有效地识别它们,这表明人们对虹膜纹理的理解与虹膜生物识别系统截然不同。作为题外话,Hollingsworth, Bowyer, Lagree, Fenker和Flynn(2011)也报道了类似的结果,其中根据标准虹膜生物识别算法,人类也能正确匹配同卵双胞胎的虹膜,尽管后者与不相关的人一样不同。

Claes et al(2015)对同一受试者的左右耳相似度进行了调查。测试依赖于从3D样本中提取的特征,并通过比较左耳和右耳进行,来自同一受试者的实例产生真实分数,来自不同受试者的样本产生冒名尝试,结果表明,有可能达到11%的同等错误率(EER)。这一结果是通过在可用的特征空间中手动选择耳朵的特定子结构得到的,结果表明个体之间的差异比同一主题的左右实例之间的差异更大。

Xu、Fei和Zhang(2015)也利用了生物特征识别框架来推断左右掌纹的相似性。同样在这种情况下,在考虑的数据库中,每个左掌纹都与每个受试者的右掌纹进行比较,如果计算出的分数来自同一个人的样本,则认为是真实的,否则认为是冒名顶替的。在两个不同的数据集上获得的EERs分别为24.22%和35.82%,这也表明同一个人的左右掌纹的相似性一般高于不同受试者的掌纹。Kumar、Wang等人(2016)开展了与Xu等人(2015)的实验类似的实验,但除了依靠手工制作特征的最先进方法外,还利用了深度学习策略来推导所执行测试中使用的掌纹表示。通过给同一用户的左右掌纹分配相同的标签来训练网络,将同一个人的不同手的样本和不同人的样本进行比较,得到的EER = 9.25%。已经取得的结果表明,深度学习策略在寻找同一主题的左、右生物特征实例之间的相似性方面,优于手工制作的方法。需要注意的是,Kumar等人(2016)采用了一种封闭集测试程序,即对用于网络训练的相同主题进行测试,以评估所使用的卷积神经网络(CNN)作为特征提取器的有效性,因此影响了获得结果的可靠性和可泛化性。

最近在比斯瓦斯、罗丹、姆莫克乌克和Drahanský(2019年)进行了视网膜测试。采用只进行降维训练的CNN进行特征提取,将同一个人的两个视网膜的模板进行比较生成的分数与不同用户的样本进行比较得到的分数进行比较。观察到的行为也证明,一个人的左右视网膜比两个不同的人的视网膜有更多的相似性。正如Bowyer等人(2010)所述,主观测试依赖于人类志愿者对两个视网膜相似度的判断。在这种情况下,人类似乎拥有比目前可用的算法更高的能力,以检测同一个人的左右特征之间的相似性。

如第1节所述,我们在之前的工作中初步研究了左右手指静脉模式的相似性(Piciucco et al, 2019),我们观察到,尽管来自同一受试者不同手的对应手指比来自不同人的手指显示出更多的相似性,但通过手工制作的特征发现的相似性不足以在生物特征识别系统中利用。事实上,piiciucco等人(2019)使用左右手指静脉模式作为真正的比较,估计EERs高于30%。

因此,文献表明,尽管手工制作的特征允许执行标准的生物特征识别,但可能并不适合捕捉同一个人的左右特征之间的相似性,即使这些相似性确实存在,而且对人类观察者来说是显而易见的。相反,利用深度学习策略反而有助于模仿人类的学习和辨别能力,特别是寻找所需的相似性,就像Kumar等人(2016)对掌纹所显示的那样。

在此框架下,本文扩展了我们之前的研究(Piciucco et al, 2019),不仅考虑了手指静脉之外的手掌和背静脉模式,而且采用基于cnn的方法寻找被试右手和左手静脉模式之间的相似性,而不是依靠手工制作的特征,以更好地模拟人类的评估能力。以下部分给出了关于考虑的生物特征和利用的处理策略的更多细节。

三、手静脉生物识别

在20世纪80年代末,血管图案被引入作为一种潜在的生物特征标识(Rice, 1987),利用近红外(NIR)光的特性穿过人体皮肤,并被静脉血管中的血红蛋白吸收。图1所示的光吸收窗和治疗窗描述了这些特性:

光吸收窗口:含氧血红蛋白和脱氧血红蛋白达到光吸收峰值(脱氧血红蛋白:760 nm;OxyHb: 900 nm);

治疗窗口:波长间隔,[650,1350]nm,光在人体组织中穿透的最大深度。

因此,血红蛋白的近红外光吸收能力使血管呈现较暗的颜色,而身体其余部分则在特定的近红外光波长窗口反射光线。因此,可以使用配备了以透射或反射方式工作的近红外照明器的近红外相机获取血管图案。

下面简要概述了利用手指、手和背静脉模式的生物特征识别系统的技术现状,并在表1中总结了以验证方式运行的系统的主要特征。Uhl、Busch、Marcel和Veldhuis(2020)最近对静脉生物特征识别的技术现状进行了更深入的评估。

3.1. 传统方法

在生物特征识别系统中处理静脉模式的方法通常分为基于轮廓的方法和基于特征的方法。前者专注于图像中静脉横断面轮廓的提取。例如,最大曲率方法(Miura, Nagasaka, & Miyatake, 2007)可以在不同的手指静脉数据库上获得健壮的性能。相反,基于特征的方法依赖于这样一个假设,即静脉区域区域比手掌的其他部分颜色更深,而线状形状被解释为静脉轮廓中的静脉图案

更详细地说,早期使用手掌静脉生物特征识别技术的尝试依赖于基于数据集的基于特征的方法,即理工大学手掌静脉数据库,该数据库由可见光和近红外子带的RGB图像组成(Zhang等,2009)。利用基于纹理的编码算法和6个不同方向的Gabor滤波器提取了RGB子带中的掌纹特征和NIR子带中的掌纹静脉特征。将每个通道获得的分数进行融合后,得到了0.012%的等错误率(EER)。

Zhou和Kumar(2011)使用邻域拉东变换生成模板,并使用修正的汉明距离进行比较。在polyp数据集上进行的测试表明,当分别使用每个用户6个或1个注册样本时,EERs为0.004%和0.21%。在CASIA数据集的图像上,当每个用户使用一个或三个注册样本时,EERs分别为1.37%和0.51% (Hao, Sun, Tan, & Ren, 2008)。在mit - f手指静脉数据集上进行的实验(Zhang等,2009)通过融合食指和中指特征提供了等于0.08%的EER (Kumar & Zhou, 2011)。还有人指出,在比较同一届会议期间采集的静脉样本时,估计的业绩可能会产生偏差,因此需要在可能的情况下比较在不同场合采集的静脉样本。

通过使用基于解剖结构分析的静脉提取(ASAVE)和弹性匹配(Yang et al, 2018), SDUMLA (Yin, Liu, & Sun, 2011)和uc - f的测试分别产生了1.39%和0.38%的EERs。在UTFVP指静脉数据库上,通过特征级融合也获得了0.19%的EER (Ton & Veldhuis, 2013)。

手背静脉的分析采用评分级融合方法,依赖于线边图提取的特征、非负矩阵分解和独立成分分析(Yuksel et al, 2011)。在博斯普鲁斯数据集上,实现单样本注册的初始测试和实现8个样本注册阶段的测试报告的EERs分别为8.18%和2.25%。值得注意的是,在上述研究中,为了推断潜在的性能退化,已经实现了真实的条件。

3.2. 基于深度学习的方法

深度学习的最新进展正积极影响着生物识别领域。Radzi、Khalil-Hani和Bakhteri(2016)提出的方法是利用卷积神经网络(CNNs)进行手指静脉识别的先驱方法之一。

具体来说,所采用的体系结构是一个4层CNN和一个子采样层,同时对来自50名受试者的记录数据进行了测试。在最初的努力之后,将深度学习应用于基于静脉的识别系统的贡献已经大量涌现。

轻量级cnn也被用于从MMCBNU (Lu, Xie, Yoon, Wang, & Park, 2013)和SDUMLA数据集(Fang等人,2018)中提取手指静脉样本模板。利用具有线性核的支持向量机(SVM)进行匹配,构建了一个能够根据类内特征变化自动选择其中一个特征的选择网络。

虽然已经报告了有希望的结果,EERs在MMCBNU上为0.10%,在SDUMLA上为0.47%,但这些结果是有偏见的,因为在训练和测试中考虑相同的受试者,除了实现这些率计算分数的平均值5次比较之外。

在PolyU和SDUMLA手指静脉数据集上也使用Densenet-161架构进行了测试(Song等人,2019)。

作者最初通过将静脉图像移动到不同的方向来构建复合样本,然后使用Densenet-161提取特征。实验将现有数据划分为两个不相交集,在poly -f和SDUMLA数据集上使用2倍交叉验证分别获得0.33%和2.35%的EERs。我们必须指出,这些测试只考虑了第一届理大- f的情况,因此得出的结果应该被认为是有偏差的。

Jalilian和Uhl(2018)研究了不同的深度图像分割算法,依赖于U-Net、RefineNet和SegNet框架,使用人类注释的像素标签作为ground-truth创建二进制模板。SDUMLA和UTFVP指静脉数据集的EERs分别为2.63%和0.64%。

Wang等人(2020)考虑了不同卷积滤波器之间的特征共现。为了测试他们的方法的鲁棒性,作者考虑了不同的静脉形态,即背静脉、手掌静脉和手指静脉。最近提出了一种执行动态手指静脉采集的创新方法,以及一种使用长短期记忆网络和卷积神经网络的新型深度学习架构(Kuzu, Piciucco, Maiorana, & Campisi, 2020)。

生成对抗网络(GANs)也被用于分析手指静脉模式(Yang等,2019)。虽然GANs最初代表数据合成的生成模型,但它们已被用于从静脉模式生成鉴别模板(Yang等,2019)。THU-FVFDT2 (Yang, Yu, & Liao, 2009)和SDUMLA数据集分别包含610和106个不同受试者的多个手指静脉数据,用于测试目的。

具体地说,前一个数据集被划分为不同的子集,用于训练、验证和测试目的,而后者仅用于重新验证所提议的系统。两个数据集的EERs识别率分别为1.12%和0.94%。

四、二采用基于cnn的识别系统

4.1. 网络拓扑结构

4.2. 网络初始化与优化

所采用的CNN被训练用于分类目的,由所提出的定制嵌入器产生的特征被作为生成的模板。用于训练的损失函数是交叉熵(CE),而反向传播是借助于随机梯度下降(SGD)来执行的,并且使用(I)每批中的32个样本,(ii) 0.01作为初始学习率,在每30个时期之后减少10倍,(iii)0.9的动量,(iv)最多120个训练时期,在验证损失最小化的情况下停止训练。

在搜索AAMP的最佳超参数时,惩罚裕度在푚 ∈ [0.3,0.7]范围内选取,而比例参数在푠 ∈ [16,96]范围内确定。

对于Densenet-161框架的初始化,使用Imagenet预训练模型的权重。此外,修改后的Densenet-161中定义的自定义层(见表2)通过(I)BN层的单位重量初始化,(ii)FC层的Glorot统一初始化进行初始化。

五、实验分析与讨论

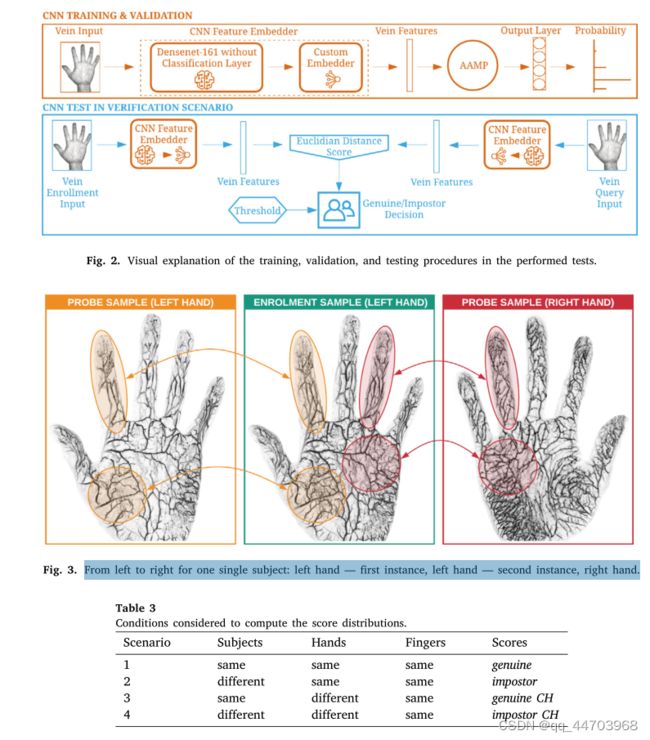

我们的分析旨在验证受试者一只手的静脉图案是否与同一受试者另一只手的类似特征具有更大的相似性,而不是与不同人的同一只手的类似特征具有更大的相似性。为此,在执行的测试中考虑了几种静脉模式,即手指、手掌和手背静脉。具体而言,如表3中所总结的,我们已经根据以下场景估计了不同的分数分布,其中一些示例在图3中以图形方式描绘:

通过比较从同一对象的同一只手的同一根手指提取的静脉图案来计算真实分数。作为一个例子,给定一个特定的对象,在属于同一个右手食指的图案的不同实例之间进行比较。对于手掌和手背静脉识别,通过比较来自同一个人的同一只手的静脉图案来计算真实分数;

通过比较从不同对象的同一只手的同一根手指提取的静脉图案,为手指静脉识别计算冒名顶替者分数。例如,来自一个人的右食指的静脉与不同的人的右食指的静脉进行比较。对于手掌和手背静脉识别,通过比较不同个体的同一只手的静脉来计算冒名顶替者分数;

对于手指静脉识别和给定的特定对象,计算真正的跨手(CH)分数,比较来自不同手的相应手指的模式。例如,将同一个人的右食指中的静脉与左食指中的静脉进行比较。对于手掌和背静脉识别,通过比较来自同一对象的不同手的模式来计算真实的CH分数;

通过比较从不同对象的不同手的同一手指提取的静脉图案,为手指静脉识别计算冒名顶替者CH分数。例如,将一个人右食指的静脉与另一个人左食指的静脉进行比较。对于手掌和手背静脉识别,通过比较来自不同个体的不同手的静脉来计算冒名顶替者CH分数。

5.1 使用的数据库

为了提供关于跨手静脉模式相似性的综合分析,已经对手指、手掌和手背特征进行了测试。为此,我们开发了手指静脉样本取自SDUMLA数据集(Yin等人,2011年),手掌静脉数据取自PolyU-P多光谱数据集(Zhang等人,2009年),手背静脉图像取自Bosphorus数据集(Yuksel等人,2011年),以及在Roma Tre大学采集的多次曝光手指静脉数据集,即R3静脉(Kuzu,Piciucco等人,2020年)。对于PolyU-P数据集,仅考虑近红外通道图像。类似地,当在我们的实验中使用R3静脉数据集时,色调映射的高动态范围(HDR)样本从以不同曝光率拍摄的4幅图像中生成(Kuzu,Piciucco等人,2020)。表4总结了所考虑的数据集的主要属性。在将所考虑的数据集的所有图像用作所考虑的网络的输入之前,将其重新调整为224 × 224的格式,并进行归一化,以便具有零均值和酉方差。

5.2 实验框架

在所考虑的数据集上采用两种不同的CNN训练策略:训练策略-1:在训练和验证期间,所有不同的手和手指被视为单独的类;训练策略-2:在网络训练和验证期间,相同用户的不同手以及来自相同用户的不同手的相应手指被认为属于相同的类别。执行该训练策略以明确地尝试提取同一个人的不同手中的静脉结构所共有的区别特征。

一旦使用的网络已经根据上述策略之一被训练,属于表3中提到的类别的相似性分数已经通过在测试阶段考虑的样本被计算。一旦生成了这样的分布,就已经估计了与以下场景相关联的错误拒绝率(FRR)和错误接受率(FAR ):标准比较:如在生物识别测试中通常所做的,对象的每个手指或每个手被认为是一个类别。因此,FRR和FAR是根据先前定义的真实和冒名顶替者分数来计算的;交叉比较:基于提取的静脉图案,通过根据真实CH和冒名顶替者的分数计算FRR和FAR,或者考虑真实CH和冒名顶替者的CH分数,来分析可互换地使用不同的手进行识别的可能性。

在进行实验时,所考虑的数据集已经被分成具有相同大小的两个子集,并且分别用于训练和测试,选择用于训练的20%的数据保留用于验证目的。在所有执行的测试中都考虑了一个开放集场景,用一半的可用类进行训练,剩下的一半用于测试。当考虑具有多个会话的数据库时,来自不同会话的数据被用于登记和验证,目的是避免任何偏差效应。

使用配备128Gb RAM、四个NVIDIATM Tesla V100图形卡、在Ubuntu 18.04 LTE操作系统下运行并使用PyTorch 1.4.0的双处理器系统进行了实验。

5.3.交叉手模板的相似性

计算出的分数分布如图4所示。考虑到采用训练策略-1时获得的值,可以观察到真实CH分数通常低于冒名顶替者和冒名顶替者CH分布的分数。这一发现已经证实了同一个人的左手和右手静脉模式比不相关的人更相似的假设。这一点对于手指静脉模式尤其明显,如SDUMLA和R3静脉数据库上的结果所示。

此外,使用训练策略-2获得的分数的特征在于真实CH和冒名顶替者分数之间的大得多的分离,证明了所采用的训练过程在发现左手和右手静脉模式的共同特征方面的有效性,同时保持了它们的主体间的可区分性。

还可以注意到,对于所有考虑的数据库和所采用的训练策略,冒名顶替者和冒名顶替者CH分布几乎重叠。当使用Training-Strategy-1时,只有PolyU-P和Bosphorus数据库的差别很小。使用训练-策略-2,专门设计来寻找左手和右手的相似之处,即使是这样的细微差别也会消失。这种行为意味着不同人的静脉图案是如此不同,以至于攻击者使用哪只手来进行冒名顶替的尝试并不重要(假设系统比较镜像图像,以防左右手被比较)。

总结

在这项研究中,我们在生物识别框架内研究了不同手指、手掌和背侧区域静脉结构的相似性。利用对几种生物特征进行类似分析的文献研究,我们采用了深度学习策略,以更好地模拟人类的学习和辨别能力。采用标准的网络训练策略,即将每个手指、手掌或背部的静脉模式视为一个独立的类别,得到的结果表明,不同手对应的静脉模式之间存在显著的相似性。尽管如此,使用注册时使用的手以外的手的特征来实现表演识别的效果相当差。

相反,当所采用的训练策略将手指、手掌和左右手背的静脉模式视为同一类,并通过比较不同手的静脉模式计算真实分数时,成绩有显著提高。得到的结果与给出的结果相似在Claes等人(2015)和Kumar等人(2016)关于掌纹的研究中:在这两篇论文中,发现了左右生物特征的相似性,因此可以计算出10%量级的EER,这与我们从SDUMLA报告的手指静脉数据相似。在我们对R3VEIN数据集(包含四个手指的图像)的测试中,获得了更低的EER。

而对于来自哈佛大学的掌静脉数据和来自博斯普鲁斯岛的背静脉样本,相似度较低,EERs分别为25.3%和23.9%。因此,进一步的研究可能有助于评估不同的方法是否能在保持受试者间差异的同时,发现更多的左右手手掌和背静脉模式的相似性。例如,可以利用生成对抗网络(GAN)或自动编码器等深度生成模型实现这一目标。后者实际上可以用来评估一只手的静脉模式表示是否可以从另一只手提取的特征中检索,同时保留辨别能力。