MapReduce的Partition 分区

一、Partitioner分区位置

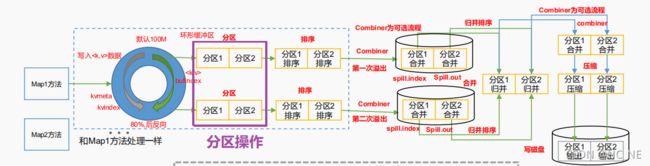

从MapRedece框架原理里面我们发现在进入环形缓冲区有一个分区的操作,如图

二、Partitioner分区机制

源码默认采用HashPartitioner,源码如下

public class HashPartitioner implements Partitioner {

public void configure(JobConf job) {}

/** Use {@link Object#hashCode()} to partition. */

public int getPartition(K2 key, V2 value,

int numReduceTasks) {

return (key.hashCode() & Integer.MAX_VALUE) % numReduceTasks;

}

} 默 认分区是根据key的hashCode对ReduceTasks个数取模得到的。用户没法控制哪个key存储到哪个分区。

三、自定义Partitioner分区

3.1 重点步骤:

(1)自定义类继承Partitioner,重写getPartition()方法

(2)在Job驱动中,设置自定义Partitioner

(3)自定义Partition后,要根据自定义Partitioner的逻辑设置相应数量的ReduceTask

3.2 Partition 分区案例实操

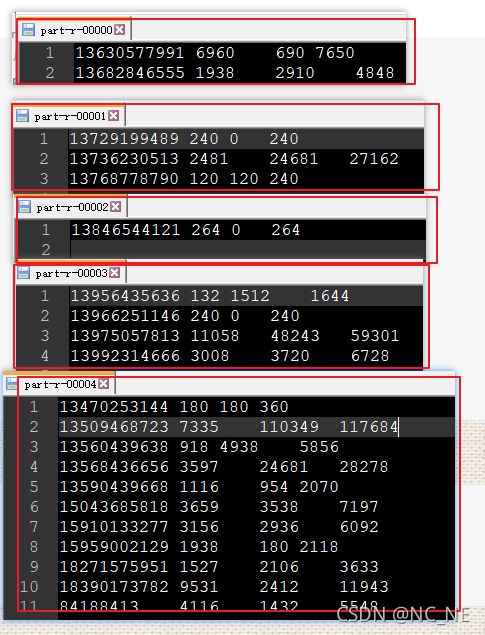

(1)需求:mapReduce序列化文章中我们统计了手机上行流量和下行流量和总流量,这次我们要进行分区那就按照手机号 136、137、138、139 和其它开头都分别放到一个独立的 5 个分区中

(2)准备数据

13736230513 192.196.100.1 www.atguigu.com 2481 24681 200

13846544121 192.196.100.2 264 0 200

13956435636 192.196.100.3 132 1512 200

13966251146 192.168.100.1 240 0 404

18271575951 192.168.100.2 www.atguigu.com 1527 2106 200

84188413 192.168.100.3 www.atguigu.com 4116 1432 200

13590439668 192.168.100.4 1116 954 200

15910133277 192.168.100.5 www.hao123.com 3156 2936 200

13729199489 192.168.100.6 240 0 200

13630577991 192.168.100.7 www.shouhu.com 6960 690 200

15043685818 192.168.100.8 www.baidu.com 3659 3538 200

15959002129 192.168.100.9 www.atguigu.com 1938 180 500

13560439638 192.168.100.10 918 4938 200

13470253144 192.168.100.11 180 180 200

13682846555 192.168.100.12 www.qq.com 1938 2910 200

13992314666 192.168.100.13 www.gaga.com 3008 3720 200

13509468723 192.168.100.14 www.qinghua.com 7335 110349 404

18390173782 192.168.100.15 www.sogou.com 9531 2412 200

13975057813 192.168.100.16 www.baidu.com 11058 48243 200

13768778790 192.168.100.17 120 120 200

13568436656 192.168.100.18 www.alibaba.com 2481 24681 200

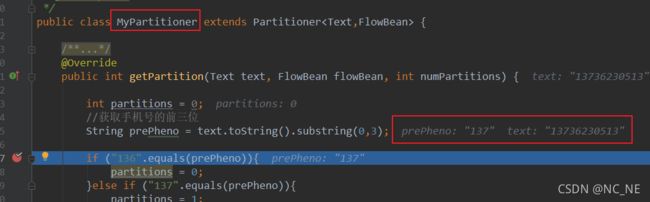

13568436656 192.168.100.19 1116 954 200(3) 自定义一个分区类MyPartitioner

public class MyPartitioner extends Partitioner {

/**

*

* @param text map方法输出的key

* @param flowBean map方法输出的value

* @param numPartitions

* @return

*/

@Override

public int getPartition(Text text, FlowBean flowBean, int numPartitions) {

int partitions = 0;

//获取手机号的前三位

String prePheno = text.toString().substring(0,3);

if ("136".equals(prePheno)){

partitions = 0;

}else if ("137".equals(prePheno)){

partitions = 1;

}else if ("138".equals(prePheno)){

partitions = 2;

}else if ("139".equals(prePheno)){

partitions = 3;

}else{

partitions = 4;

}

return partitions;

}

} (4) Dirver代码设置设置自定义Partitioner和分区个数

//8 指定自定义分区器

job.setPartitionerClass(MyPartitioner.class);

//9 同时指定相应数量的 ReduceTask

job.setNumReduceTasks(5);其余代码和Mapreduce序列化文章完全一致

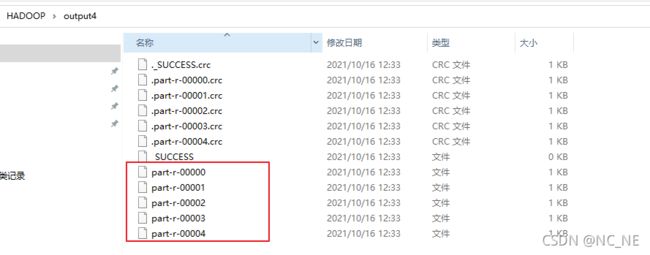

(5)运行结果

五个文件,说明有五个分区,数据也是按照了我们的要求进行了分区

通过日志我们也可发现是有五个reduce执行,所以最终会产生五个文件

四、源码执行流程分析

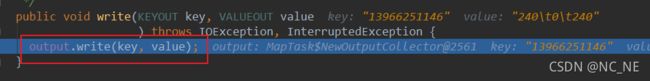

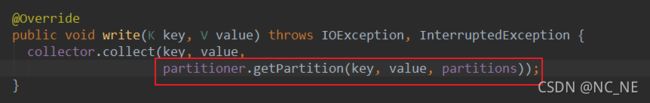

我们知道分区是在进入到环形缓冲区开始分区的,所以肯定在MapTask阶段的Collect阶段

1、读取文件,进入map处理

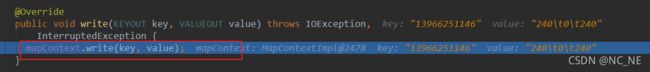

2、Map端处理,开始数据写入到环形缓冲区

3、一系列写准备,最终调用collector.collect()方法

4、进入到自定义分区