【交通流预测】《Spatio-Temporal Graph Convolutional Networks: A Deep Learning Framework for Traffic For》论文详解

《STGCN》文章目录

- 文章总结

- Abstract

- 一、Introduction

- 二、Preliminary

-

- 1. Traffic Prediction on Road Graphs

- 2. Convolutions on Graphs

- 三、Proposed Model

-

- 1. Network Architecture

- 2. Graph CNNs for Extracting Spatial Features

- 3. Gated CNNs for Extracting Temporal Features

- 4. Spatio-temporal Convolutional Block

- 四、Experiments

-

- 1. 数据集

- 2. Data Preprocessing

- 3. Experimental Settings

- 3. Experiment Results

- 五、 Conclusion

点击论文下载链接:https://arxiv.org/abs/1709.04875v4

点击代码下载链接:https://github.com/VeritasYin/STGCN_IJCAI-18

文章总结

-

- 现存问题:

① 时空关系:传统的方法不能满足中长期预测任务的要求,往往忽略了空间和时间的相关性。

-

- 文章贡献点:

① 较早提出时空关系(GCN): 采用一般图来建模交通网络,而不是将其单独处理(如网格或分段)。将交通问题用图形的形式表达出来,这是第一次在交通研究中应用纯卷积结构同时从图结构时间序列中提取时空特征。

② 提出新的模型框架:STGCN。由于这个架构中是纯卷积操作,它比基于RNN的模型的训练速度快10倍以上,而且需要的参数更少。这个架构可以让我们更有效地处理更大的路网。

Abstract

及时准确的交通预测是城市交通控制和引导的关键。由于交通流的高度非线性和复杂性,传统的方法不能满足中长期预测任务的要求,往往忽略了空间和时间的相关性。本文提出了一种新的深度学习框架——时空图卷积网络(STGCN)来解决交通领域的时间序列预测问题。我们没有使用常规的卷积和递归单位,而是将问题用图形的形式表达出来,用完整的卷积结构构建模型,这样可以在参数更少的情况下提高训练速度。实验表明,我们的模型STGCN通过建模多尺度交通网络有效地捕获了综合的时空相关性,并在各种真实交通数据集上始终优于最先进的基线。

一、Introduction

预测背景:交通在每个人的日常生活中扮演着重要的角色。根据2015年的一项调查,美国司机平均每天开车的时间为48分钟在这种情况下,准确的实时交通状况预测对于道路使用者、私营部门和政府来说至关重要。广泛应用的交通服务,如流量控制、路线规划和导航,也在很大程度上依赖于高质量的交通状况评价。一般来说,多尺度交通预测是城市交通控制和引导的前提和基础,也是智能交通系统(ITS)的主要功能之一。在交通研究中,通常选择交通流量的基本变量,即速度、流量和密度作为监测当前交通状况和交通流量的指标。根据预测时间长短,交通预测一般分为短期(5 ~ 30分钟)、中长期(30分钟以上)两个尺度。大多数流行的统计方法(如线性回归)都能很好地进行短时预测。然而,由于交通流的不确定性和复杂性,这些方法对于较长期的预测效果较差。

预测分类:以往对中长期流量预测的研究大致可以分为两大类:动态建模和数据驱动方法。动力学建模使用数学工具(如微分方程)和物理知识,通过计算模拟来表述交通问题[Vlahogianni, 2015]。为了达到稳态,仿真过程不仅需要复杂的系统编程,而且需要消耗大量的计算能力。模型的假设不实际和模型的简化也降低了预测的精度。因此,随着交通数据采集和存储技术的快速发展,越来越多的研究者开始关注数据驱动方法。

经点模型:经典的统计模型和机器学习模型是数据驱动方法的两个主要代表。在时间序列分析中,自回归综合移动平均(ARIMA)及其变量是基于经典统计的最统一的方法之一[Ahmed和Cook, 1979;威廉姆斯和霍尔,2003年。然而,这种模型受时间序列平稳假设的限制,没有考虑时空相关性。因此,这些方法对高度非线性的交通流具有约束可表征性。近年来,经典的统计模型在交通预测任务中受到了机器学习方法的有力挑战。这些模型如k近邻算法(KNN)、支持向量机(SVM)和神经网络(NN)可以实现更高的预测精度和更复杂的数据建模。

深度学习:最近,深度学习已经被广泛且成功地应用于各式各样的交通任务中,在最近的工作中已经取得了很显著的成果,比如,深度置信网络(DBN)[Jia et al., 2016; Huang et al., 2014]和层叠自编码器(stacked autoencoder)(SAE)[Lv et al., 2015; Chen et al., 2016]。然而,这些全连接神经网络很难从输入中提取空间和时间特征。而且,空间属性的严格限制甚至完全缺失,这些网络的表示能力被限制的很严重。

为了充分利用空间特征,一些研究者使用了卷积神经网络来捕获交通网络中的临近信息,同时也在时间轴上部署了循环神经网络。通过组合长短期记忆网络[Hochreiter and Schmidhuber, 1997]和1维卷积,Wu和Tan[2016]首先提出一个特征层面融合的架构CLTFP来预测短期交通状况。尽管它采取了一个很简单的策略,CLTFP仍然是第一个尝试对时间和空间规律性对齐的方法。后来,Shi et al.[2015]提出了卷积LSTM,这是一个带有嵌入卷积层的全连接LSTM的扩展。然而,常规的卷积操作限制了模型只能处理常规的网格结构(如图像或视频),而不是其他的大部分领域(比如Graph)。与此同时,循环神经网络对于序列的学习需要迭代训练,这会导致误差的积累。更进一步地说,循环神经网络(包括基于LSTM的RNN)的难以训练和计算量大是众所周知的。

为了克服这些问题,我们介绍了几种策略来有效地建模交通流的时间动态和空间依赖性。为了充分利用空间信息,我们采用一般图来建模交通网络,而不是将其单独处理(如网格或分段)。为了克服递归网络固有的缺陷,我们在时间轴上采用了一种全卷积结构。首先,我们提出了一种新颖的深度学习体系结构——时空图卷积网络,用于交通预测任务。该架构由多个时空卷积块组成,这些块是图形卷积层[Defferrard等人,2016]和卷积序列学习层的组合,用于建模空间和时间相关性。据我们所知,这是第一次在交通研究中应用纯卷积结构同时从图结构时间序列中提取时空特征。我们在两个真实世界的交通数据集上评估了我们提出的模型。实验表明,在多个预设长度和网络规模的预测任务中,该框架的性能优于现有的基线。

二、Preliminary

1. Traffic Prediction on Road Graphs

交通预测是一个典型的时间序列预测问题,即根据之前的M个交通观测值,预测下一个H个时间步中最可能的交通度量值(如速度或车流量):

v ^ t + 1 , … , v ^ t + H = arg max v t + 1 , … , v t + H log P ( v t + 1 , … , v t + H ∣ v t − M + 1 , … , v t ) , \begin{array}{l}\hat{v}_{t+1}, \ldots, \hat{v}_{t+H}= \\\underset{v_{t+1}, \ldots, v_{t+H}}{\arg \max } \log P\left(v_{t+1}, \ldots, v_{t+H} \mid v_{t-M+1}, \ldots, v_{t}\right),\end{array} v^t+1,…,v^t+H=vt+1,…,vt+HargmaxlogP(vt+1,…,vt+H∣vt−M+1,…,vt),

这里 v t ∈ R n v_t \in \mathbb{R}^n vt∈Rn是 n n n个路段在时间戳 t t t观察到的一个向量,每个元素记录了一条路段的历史观测数据。

在这项工作中,我们定义了一个图上的交通网络,重点关注结构化交通时间序列。数据点 v t \mathbf{v_{t}} vt可被视为在无向图(或有向图)G上定义的图信号,其权重为 W i , j \mathbf{W_{i,j}} Wi,j,如图1所示。在第t个时间步,在图 G t = ( V t , ε , W ) \mathcal{G_t}=(\mathcal{V_t}, \mathcal{\varepsilon}, W) Gt=(Vt,ε,W), V t \mathcal{V_t} Vt是当顶点的有限集,对应在交通网络中 n n n个监测站; ϵ \epsilon ϵ是边集,表示观测站之间的连通性; W ∈ R n × n W \in \mathbb{R^{n \times n}} W∈Rn×n表示 G t \mathcal{G_t} Gt的邻接矩阵。

2. Convolutions on Graphs

频/空域卷积:规则网格的标准卷积显然不适用于一般图。目前有两种基本方法正在探索如何将CNN推广到结构化数据形式。一种是扩展卷积的空间定义[Niepert等人,2016年],另一种是利用图形傅里叶变换在光谱域中进行操作[Bruna等人,2013年]。前一种方法将顶点重新排列成特定的网格形式,这些网格形式可以通过正常的卷积运算进行处理。后者引入了谱框架,将卷积应用于谱域,通常称为谱图卷积。一些后续研究通过将计算复杂度从 O ( n 2 ) O(n^2) O(n2)降低到线性,使图卷积更有希望[Defferard等人,2016;Kipf和Welling,2016]。

我们基于谱图卷积的定义引入图卷积操作“ ∗ G \ast_{\mathcal{G}} ∗G”的符号,也就是一个核 Θ \Theta Θ和信号 x ∈ R n x \in \mathbb{R}^n x∈Rn的乘法:

Θ ∗ G x = Θ ( L ) x = Θ ( U Λ U T ) x = U Θ ( Λ ) U T x , \Theta *_{\mathcal{G}} x=\Theta(L) x=\Theta\left(U \Lambda U^{T}\right) x=U \Theta(\Lambda) U^{T} x, Θ∗Gx=Θ(L)x=Θ(UΛUT)x=UΘ(Λ)UTx,

这里图的傅里叶基 U ∈ R n × n U \in \mathbb{R}^{n \times n} U∈Rn×n是归一化的拉普拉斯矩阵 L = I n − D − 1 / 2 W D − 1 / 2 = U Λ U T ∈ R n × n L=I_n-D^{-1/2}WD^{-1/2}= U \Lambda U^T \in \mathbb{R}^{n \times n} L=In−D−1/2WD−1/2=UΛUT∈Rn×n的特征向量组成的矩阵,其中 I n I_n In是单位阵, D ∈ R n × n D \in \mathbb{R}^{n \times n} D∈Rn×n是对角的度矩阵 D i i = ∑ j W i j D_{ii}=\sum_j{W_{ij}} Dii=∑jWij; Λ ∈ R n × n \Lambda \in \mathbb{R}^{n \times n} Λ∈Rn×n是 L L L的特征值组成的矩阵,卷积核 Θ ( Λ ) \Theta(\Lambda) Θ(Λ)是一个对角矩阵。通过这个定义,一个图信号 x x x是被一个核 Θ \Theta Θ通过 Θ \Theta Θ和图傅里叶变换 U T x U^Tx UTx[Shuman et al., 2013]过滤的。

三、Proposed Model

1. Network Architecture

在本节中,我们详细介绍了时空图卷积网络(STGCN)的拟议体系结构。如图2所示,STGCN由多个时空卷积块组成,每个时空卷积块形成“三明治”结构,中间有两个选通顺序卷积层和一个空间图卷积层。每个模块的详细信息如下所述。

2. Graph CNNs for Extracting Spatial Features

交通网络通常以图形结构组织。用数学方法将道路网络表示为图形是自然和合理的。然而,以往的研究忽略了交通网络的空间属性:网络的连通性和全局性被忽略,因为它们被分割成多个段或网格。即使使用网格上的二维卷积,由于数据建模的折衷,它也只能粗略地捕获空间局部性。因此,在我们的模型中,图卷积直接用于图形结构数据,以提取空间域中具有高度意义的模式和特征。集是在图卷积中由式2可以看出核 Θ \Theta Θ的计算的时间复杂度由于傅里叶基的乘法可以达到 O ( n 2 ) O(n^2) O(n2),两个近似的策略可以解决这个问题。

[1] Chebyshev Polynomials Approximation(切比雪夫多项式逼近 ):

为了局部化过滤器并且减少参数,核 Θ \Theta Θ可以被一个关于 Λ \Lambda Λ的多项式限制起来,也就是 Θ ( Λ ) = ∑ k = 0 K − 1 θ k Λ k \Theta(\Lambda)=\sum_{k=0}^{K-1} \theta_k \Lambda^k Θ(Λ)=∑k=0K−1θkΛk,其中 θ ∈ R K \theta \in \mathbb{R}^K θ∈RK是一个多项式系数的向量。 K K K是图卷积核的大小,它决定了卷积从中心节点开始的最大半径。一般来说,切比雪夫多项式 T k ( x ) T_k(x) Tk(x)被用于近似核,作为 K − 1 K-1 K−1阶展开的一部分,也就是 Θ ( Λ ) ≈ ∑ k = 0 K − 1 θ k T k ( Λ ~ ) \Theta(\Lambda) \approx \sum_{k=0}^{K-1} \theta_k T_k(\widetilde{\Lambda}) Θ(Λ)≈∑k=0K−1θkTk(Λ ),其中 Λ ~ = 2 Λ / λ m a x − I n \widetilde{\Lambda}=2\Lambda/\lambda_{max}-I_n Λ =2Λ/λmax−In( λ m a x \lambda_{max} λmax表示 L L L的最大特征值)[Hammond et al., 2011]。图卷积因此可以被写成

Θ ∗ G x = Θ ( L ) x ≈ ∑ k = 0 K − 1 θ k T k ( L ~ ) x \Theta *_{\mathcal{G}} x=\Theta(L) x \approx \sum_{k=0}^{K-1} \theta_{k} T_{k}(\tilde{L}) x Θ∗Gx=Θ(L)x≈k=0∑K−1θkTk(L~)x

其中 T k ( L ~ ) ∈ R n × n T_k(\widetilde{L}) \in \mathbb{R}^{n \times n} Tk(L )∈Rn×n是k阶切比雪夫多项式对缩放后(scaled)的拉普拉斯矩阵 L ~ = 2 L / λ m a x − I n \widetilde{L}=2L/\lambda_{max}-I_n L =2L/λmax−In。通过递归地使用趋近后的切比雪夫多项式计算K阶卷积操作,式2的复杂度可以被降低至 O ( K ∣ ε ∣ ) O(K\vert \varepsilon \vert) O(K∣ε∣),如式所示[Defferrard et al., 2016]。

[2] 1st-order Approximation(一阶近似):

一个针对层的线性公式可以由堆叠多个使用拉普拉斯矩阵的一阶近似的局部图卷积层[Kipf and Welling, 2016]。结果就是,这样可以构建出一个深的网络,这个网络可以深入地恢复空间信息并且不需要指定多项式中的参数。由于在神经网络中要缩放和归一化,我们可以进一步假设 λ m a x ≈ 2 \lambda_{max} \approx 2 λmax≈2。因此,式3可以简写为

Θ ∗ G x ≈ θ 0 x + θ 1 ( 2 λ max L − I n ) x ≈ θ 0 x − θ 1 ( D − 1 2 W D − 1 2 ) x \begin{aligned} \Theta * \mathcal{G} x & \approx \theta_{0} x+\theta_{1}\left(\frac{2}{\lambda_{\max }} L-I_{n}\right) x \\ & \approx \theta_{0} x-\theta_{1}\left(D^{-\frac{1}{2}} W D^{-\frac{1}{2}}\right) x \end{aligned} Θ∗Gx≈θ0x+θ1(λmax2L−In)x≈θ0x−θ1(D−21WD−21)x

其中, θ 0 \theta_0 θ0, θ 1 \theta_1 θ1是核的两个共享参数。为了约束参数并为稳定数值计算, θ 0 \theta_0 θ0和 θ 1 \theta_1 θ1用一个参数 θ \theta θ来替换, θ = θ 0 = − θ 1 \theta=\theta_0=-\theta_1 θ=θ0=−θ1; W W W和 D D D是通过 W ~ = W + I n \widetilde{W}=W+I_n W =W+In和 D ~ i i = ∑ j W ~ i j \widetilde{D}_{ii}=\sum_j\widetilde{W}_{ij} D ii=∑jW ij重新归一化得到的。之后,图卷积就可以表达为

Θ ∗ G x = θ ( I n + D − 1 2 W D − 1 2 ) x = θ ( D ~ − 1 2 W ~ D ~ − 1 2 ) x . \begin{aligned} \Theta *_{\mathcal{G}} x &=\theta\left(I_{n}+D^{-\frac{1}{2}} W D^{-\frac{1}{2}}\right) x \\ &=\theta\left(\tilde{D}^{-\frac{1}{2}} \tilde{W} \tilde{D}^{-\frac{1}{2}}\right) x . \end{aligned} Θ∗Gx=θ(In+D−21WD−21)x=θ(D~−21W~D~−21)x.

竖直地堆叠一阶近似的图卷积可以获得和平行的K阶卷积相同的效果,所有的卷积可以从一个顶点的 K − 1 K-1 K−1阶邻居中获取到信息。这里, K K K是连续卷积操作的次数或是模型中的卷积层数。进一步说,针对层的线性结构是节省参数的,并且对大型的图来说是效率很高的,因为多项式趋近的阶数为1。

[3] Generalization of Graph Convolutions(图卷积的泛化):

图卷积操作 ∗ G \ast_{\mathcal{G}} ∗G也可以被扩展到多维张量上。对于一个有着 C i C_i Ci个通道的信号 X ∈ R n × C i X \in \mathbb{R}^{n \times C_i} X∈Rn×Ci,图卷积操作可以扩展为

y j = ∑ i = 1 C i Θ i , j ( L ) x i ∈ R n , 1 ≤ j ≤ C o y_{j}=\sum_{i=1}^{C_{i}} \Theta_{i, j}(L) x_{i} \in \mathbb{R}^{n}, 1 \leq j \leq C_{o} yj=i=1∑CiΘi,j(L)xi∈Rn,1≤j≤Co

其中, C i × C o C_i \times C_o Ci×Co个向量是切比雪夫系数 Θ i , j ∈ R K \Theta_{i,j} \in \mathbb{R}^K Θi,j∈RK( C i C_i Ci, C o C_o Co分别是feature map的输入和输出大小)。针对二维变量的图卷积表示为 Θ ∗ G X \Theta \ast_{\mathcal{G}} X Θ∗GX,其中 Θ ∈ R K × C i × C o \Theta \in \mathbb{R}^{K \times C_i \times C_o} Θ∈RK×Ci×Co。需要注意的是,输入的交通预测是由 M M M帧路网组成的,如图1所示。每帧 v t v_t vt可以被视为一个矩阵,它的第 i i i列是图 G t \mathcal{G_t} Gt中第 i i i个顶点的一个为 C i C_i Ci维的值,也就是 X ∈ R n × C i X \in \mathbb{R}^{n \times C_i} X∈Rn×Ci(在这个例子中, C i = 1 C_i=1 Ci=1)。对于 M M M中的每个时间步 t t t,相同的核与相同的图卷积操作是在 X t ∈ R n × C i X_t \in \mathbb{R}^{n \times C_i} Xt∈Rn×Ci中并行进行的。因此,图卷积操作也可以泛化至三维,记为 Θ ∗ G X \Theta \ast_{\mathcal{G}} \mathcal{X} Θ∗GX,其中 X ∈ R M × n × C i \mathcal{X} \in \mathbb{R}^{M \times n \times C_i} X∈RM×n×Ci

3. Gated CNNs for Extracting Temporal Features

尽管基于RNN的模型在时间序列分析中得到了广泛应用,但用于流量预测的递归网络仍然存在耗时的迭代、复杂的门机制以及对动态变化的缓慢响应等问题。与之相反,CNN具有训练速度快、结构简单、与前几步无依赖约束等优点。受[Gehring et al.,2017]的启发,我们采用时间轴上的整个卷积结构来捕捉交通流的时间动态行为。这种特殊的设计允许通过多层卷积结构形成分层表示,从而实现并行和可控的训练过程。

如图2右侧所示,时间卷积层包含了一个一维卷积,核的宽度为 K t K_t Kt,之后接了一个门控线性单元(GLU)作为激活。对于图 G \mathcal{G} G中的每个顶点,时间卷积对输入元素的 K t K_t Kt个邻居进行操作,导致每次将序列长度缩短 K t − 1 K_t-1 Kt−1。因此,每个顶点的时间卷积的输入可以被看做是一个长度为 M M M的序列,有着 C i C_i Ci个通道,记作 Y ∈ R M × C i Y \in \mathbb{R}^{M \times C_i} Y∈RM×Ci。卷积核 Γ ∈ R K t × C i × 2 C o \Gamma \in \mathbf{R}^{K_t \times C_i \times 2C_o} Γ∈RKt×Ci×2Co是被设计为映射 Y Y Y到一个单个的输出 [ P Q ] ∈ R ( M − K t + 1 ) × ( 2 C o ) [P Q] \in \mathbb{R}^{(M-K_t+1) \times (2C_o)} [PQ]∈R(M−Kt+1)×(2Co)( P P P, Q Q Q是通道数的一半)。作为结果,时间门控卷积可以定义为:

Γ ∗ T Y = P ⊙ σ ( Q ) ∈ R ( M − K t + 1 ) × C o , \Gamma * \mathcal{T} Y=P \odot \sigma(Q) \in \mathbb{R}^{\left(M-K_{t}+1\right) \times C_{o}}, Γ∗TY=P⊙σ(Q)∈R(M−Kt+1)×Co,

其中, P P P, Q Q Q分别是GLU的输入门, ⊗ \otimes ⊗表示哈达玛积,sigmoid门 σ ( Q ) \sigma(Q) σ(Q)控制当前状态的哪个输入 P P P对于发现时间序列中的组成结构和动态方差是相关的。非线性门通过堆叠时间层对挖掘输入也有贡献。除此以外,在堆叠时间卷积层时,实现了残差连接。相似地,通过在每个节点 Y i ∈ R M × C i \mathcal{Y_i} \in \mathbb{R}^{M \times C_i} Yi∈RM×Ci(比如监测站)上都使用同样的卷积核 Γ \Gamma Γ,时间卷积就可以泛化至3D变量上,记作 Γ ∗ τ Y \Gamma \ast_\tau \mathcal{Y} Γ∗τY,其中 Y ∈ R M × n × C i \mathcal{Y} \in \mathbb{R}^{M \times n \times C_i} Y∈RM×n×Ci。

4. Spatio-temporal Convolutional Block

为了融合时空域的特征,构造时空卷积块(ST-Conv块)来联合处理图形结构的时间序列。区块本身可以根据特定案例的规模和复杂性进行堆叠或扩展。如图2(MID)所示,中间的空间层是桥接两个时间层,它可以通过时间卷积实现从图卷积的快速空间状态传播。“三明治”结构也有助于网络充分应用瓶颈策略,通过图卷积层对通道 C 进行降尺度和升尺度,实现尺度压缩和特征压缩。此外,在每个ST Conv块中使用层规范化以防止过度拟合。

ST-Conv块的输入和输出都是3D张量。对于块 l l l的输入 v l ∈ R M × n × C l v^l \in \mathbb{R}^{M \times n \times C^l} vl∈RM×n×Cl,输出 v l + 1 ∈ R ( M − 2 ( K t − 1 ) ) × n × C l + 1 v^{l+1} \in \mathbb{R}^{(M-2(K_t-1)) \times n \times C^{l+1}} vl+1∈R(M−2(Kt−1))×n×Cl+1通过以下式子计算得到:

v l + 1 = Γ 1 l ∗ T ReLU ( Θ l ∗ G ( Γ 0 l ∗ T v l ) ) v^{l+1}=\Gamma_{1}^{l} *_{\mathcal{T}} \operatorname{ReLU}\left(\Theta^{l} *_{\mathcal{G}}\left(\Gamma_{0}^{l} * \mathcal{T} v^{l}\right)\right) vl+1=Γ1l∗TReLU(Θl∗G(Γ0l∗Tvl))

其中 Γ 0 l \Gamma^l_0 Γ0l, Γ 1 l \Gamma^l_1 Γ1l是块 l l l的上下两个时间层; Θ l \Theta^l Θl是图卷积谱核; R e L U ( ⋅ ) \rm ReLU(·) ReLU(⋅)表示ReLU激活函数。我们在堆叠两个ST-Conv块后,加了一个额外的时间卷积和全连接层作为最后的输出层(图2左侧)。时间卷积层将最后一个ST-Conv块的输出映射到一个最终的单步预测上。之后,我们可以从模型获得一个最后的输出 Z ∈ R n × c Z \in \mathbb{R}^{n \times c} Z∈Rn×c,通过一个跨 c c c个通道的线性变换 v ^ = Z w + b \hat{v} = Zw+b v^=Zw+b来预测 n n n个节点的速度,其中 w ∈ R c w \in \mathbb{R}^c w∈Rc是权重向量, b b b是偏置。对交通预测的STGCN的损失函数可以写成:

L ( v ^ ; W θ ) = ∑ t ∥ v ^ ( v t − M + 1 , … , v t , W θ ) − v t + 1 ∥ 2 L\left(\hat{v} ; W_{\theta}\right)=\sum_{t}\left\|\hat{v}\left(v_{t-M+1}, \ldots, v_{t}, W_{\theta}\right)-v_{t+1}\right\|^{2} L(v^;Wθ)=t∑∥v^(vt−M+1,…,vt,Wθ)−vt+1∥2

其中, W θ W_\theta Wθ是模型中所有的训练参数; v t + 1 v_{t+1} vt+1是ground truth, v ^ ( ⋅ ) \hat{v}(·) v^(⋅)表示模型的预测。

STGCN的主要特征:

- STGCN是处理结构化时间序列的通用框架。它不仅能够解决交通网络建模和预测问题,而且可以应用于更一般的时空序列学习任务。

- 时空块结合了图卷积和选通时间卷积,可以提取出最有用的空间特征,并连贯地捕获最基本的时间特征 。

- 该模型完全由卷积结构组成,因此能够以较少的参数和较快的训练速度实现对输入的并行化。更重要的是,这种经济体系结构允许模型以更高的效率处理大规模网络。

四、Experiments

1. 数据集

① BJER4:是通过双环路探测器从北京市东环四号线主要区域采集的,选择了12条道路进行实验。流量数据每5分钟聚合一次。所用时间段为2014年7月1日至8月31日,周末除外。选择历史速度记录的第一个月作为训练集,其余分别作为验证集和测试集;

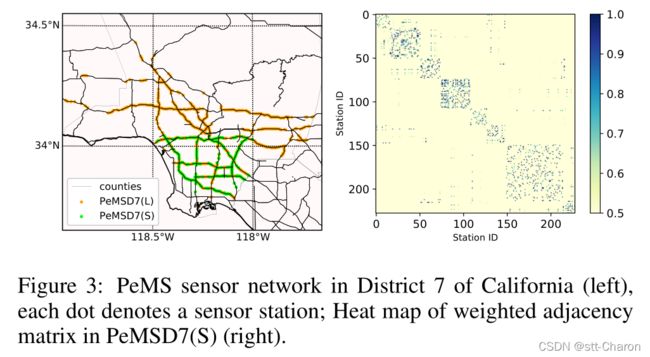

② PeMSD7: 由部署在加利福尼亚州公路系统主要大都市地区的39000多个传感器站实时从加州运输局性能测量系统(PeMS)收集。数据集也从30秒的数据样本聚合为5分钟的间隔。我们在加利福尼亚州第七区随机选择了一个中等规模和一个大型的区域,包括228个和1026个 站,分别标记为PeMSD7(M)和PeMSD7(L),作为数据源(如图3左侧所示)。PeMSD7数据集的时间范围为2012年5月和6月的工作日。我们根据上述相同的原则分割训练集和测试集。

2. Data Preprocessing

两个数据集中的标准时间间隔设置为5分钟。因此,道路图的每个节点每天包含288个数据点。数据清理后,使用线性插值方法填充缺失值。此外,数据输入通过Z-评分法进行规范化。

- 在BJER4中,北京东四环路系统的道路图拓扑是由传感器站的部署图构建的。通过整理每条道路的从属关系、方向和起点-终点,环形路线系统可以数字化为有向图。

- 在PeMSD7中,道路图的邻接矩阵是根据交通网络中站点之间的距离计算的。加权邻接矩阵W可形成如下:

w i j = { exp ( − d i j 2 σ 2 ) , i ≠ j and exp ( − d i j 2 σ 2 ) ≥ ϵ 0 , otherwise. w_{i j}=\left\{\begin{array}{ll} \exp \left(-\frac{d_{i j}^{2}}{\sigma^{2}}\right), & i \neq j \text { and } \exp \left(-\frac{d_{i j}^{2}}{\sigma^{2}}\right) \geq \epsilon \\ 0, & \text { otherwise. } \end{array}\right. wij={exp(−σ2dij2),0,i=j and exp(−σ2dij2)≥ϵ otherwise.

其中 w i j w_{ij} wij是边的权重,通过 d i j d_{ij} dij得到,也就是 i i i和 j j j之间的距离。 σ 2 \sigma^2 σ2和 ϵ \epsilon ϵ是来控制矩阵 W W W的分布和稀疏性的阈值,我们用了10和0.5。 W W W的可视化在图3的右侧。

3. Experimental Settings

设备:所有实验都在Linux集群上编译和测试(CPU:Intel(R)Xeon(R)CPU E5-2620 [email protected],GPU:NVIDIA GeForce GTX 1080)。为了消除非典型流量,我们的实验只采用了工作日流量数据[Li等人,2015]。我们执行网格搜索策略来定位验证中的最佳参数。所有测试均使用60分钟作为历史时间窗口,即12个观测数据点 ( M = 12 ) (M=12) (M=12)用于预测未来15、30和45分钟 ( H = 3 、 6 、 9 ) (H=3、6、9) (H=3、6、9)的交通状况。

评价指标:平均绝对误差(MAE),平均绝对百分比误差(MAPE), 采用均方根误差(RMSE)。

基线:

- Historical Average (HA);

- Linear Support Victor Regression (LSVR);

- Auto-Regressive Integrated Moving Average (ARIMA);

- Feed-Forward Neural Network (FNN);

- Full-Connected LSTM (FC-LSTM) [Sutskever et al., 2014];

- Graph Convolutional GRU (GCGRU) [Li et al., 2018].

STGCN Model:对于BJER4和PeMSD7(M/L),ST Conv块中三层的通道分别为64、16和64。在该模型中,图卷积核大小K和时间卷积核大小Kt都设置为3 ;

**STGCN (Cheb) **:使用切比雪夫多项式近似,而在使用一阶近似模型中,K设置为1。我们通过使用RMSprop最小化均方误差来训练我们的模型,使用50个时间段,批量大小为50。初始学习率为10−3每5个时代后衰减率为0.7。

3. Experiment Results

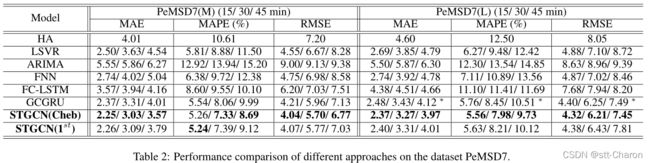

表1和表2展示了数据集BJER4和PeMSD7(M/L)上的STGCN和基线结果。我们提出的模型在所有三个评估指标中都达到了具有统计显著性的最佳性能(双尾T检验, α = 0.01 , P < 0.01 α=0.01,P<0.01 α=0.01,P<0.01)。我们可以很容易地观察到,传统的统计和机器学习方法可能在短期预测中表现良好,但由于误差累积、记忆问题和缺乏空间信息,它们的长期预测并不准确。ARIMA模型由于无法处理复杂的时空数据而表现最差。深度学习方法通常比传统的机器学习模型取得更好的预测结果。

空间拓扑的好处 :以前的方法没有结合空间拓扑,而是以粗粒度的方式对时间序列进行建模。不同的是,通过对传感器的空间拓扑进行建模,我们的STGCN模型在短期、中期和长期预测方面取得了显著的改进。与BJER4相比,STGCN在数据集PeMSD7上的优势更为明显,因为PeMS的传感器网络更为复杂和结构化(如图3所示),并且我们的模型可以有效地利用空间结构进行更精确的预测。

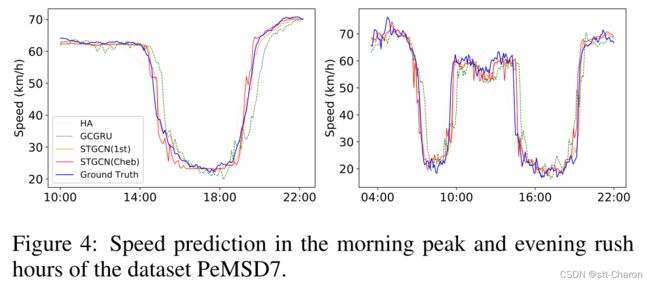

为了比较基于图卷积的三种方法:GCGRU、STGCN(Cheb)和STGCN(1st),很容易观察到,我们的提案STGCN比其他方法更准确地捕捉高峰时间的趋势;而且它比其他系统更早地检测到高峰时间的结束。基于高效的图卷积和堆叠时间卷积结构,我们的模型能够快速响应交通网络之间的动态变化,而不会像大多数循环网络那样过度依赖历史平均值。

训练效率和泛化性 :为了在我们的提案中看到沿时间轴卷积的好处,我们在表3中总结了STGCN和GCGRU之间的训练时间比较。就公平性而言,在PeMSD7(M)的实验中,GCGRU由三层组成,分别为64、64和128个单元,STGCN使用第4.3节所述的默认设置。我们的STGCN型仅消耗272秒,而RNN型GCGRU型在PeMSD7(M)上花费3824秒。这14倍的训练速度主要得益于应用时间卷积而不是递归结构,它可以实现完全并行训练,而不是完全依赖于链结构作为RNN 。对于PeMSD7(L),GCGRU必须使用批处理大小的一半,因为其GPU消耗超过了单个卡的内存容量(表2中标记为“*”的结果);而STGCN只需要在ST CONV块的中间加倍通道。尽管在这种情况下,我们的模型仍然消耗不到GCGRU模型训练时间的十分之一。同时,由于一阶近似不局限于多项式的参数化,它的优点也显现出来。与STGCN(Cheb)相比,模型STGCN(1st)在较大数据集上的速度提高了约20%,性能令人满意。

为了进一步研究比较的深度学习模型的性能,我们在培训过程中绘制了PeMSD7(M)测试集的RMSE和MAE,见图5。这些数据还表明,我们的模型可以实现更快的训练过程和更容易的收敛。由于ST Conv模块的特殊设计,我们的模型在平衡时间消耗和参数设置方面具有优异的性能。具体而言,STGCN中的参数数量(4.54×105)仅占GCGRU的三分之二左右,与FC-LSTM相比节省了95%以上的参数。

五、 Conclusion

在本文中,我们提出了一种新的用于流量预测的深度学习框架STGCN,它通过时空卷积块集成了图卷积和门时间卷积。实验表明,在两个真实数据集上,我们的模型优于其他最先进的方法,表明它在从输入探索时空结构方面具有巨大的潜力。它还实现了更快的训练、更容易的收敛和更少的参数,具有灵活性和可扩展性。这些特性对于学术开发和大规模行业部署是非常有前景和实用的。今后,我们将进一步优化网络结构和参数设置。此外,我们提出的框架可以应用于更一般的时空结构化序列预测场景,如社会网络的演化、推荐系统中的偏好预测等。

【其他论文阅读:交通流预测】《Graph WaveNet for Deep Spatial-Temporal Graph Modeling》论文详解