论文翻译:2021_DeepFilterNet: A Low Complexity Speech Enhancement Framework for Full-Band Audio based on

Python微信订餐小程序课程视频

https://edu.csdn.net/course/detail/36074

Python实战量化交易理财系统

https://edu.csdn.net/course/detail/35475

目录

摘要2 DeepfilterNet2.1 信号模型2.2 Deep Filtering2.3 框架概述2.4 DNN模型2.5 数据处理2.6 损失函数3 实验3.1 训练步骤3.2 结果4 结论

论文地址:DeepFilterNet:基于深度滤波的全频带音频低复杂度语音增强框架

论文代码:https://github.com/ Rikorose/DeepFilterNet

引用:Schröter H, Rosenkranz T, Maier A. DeepFilterNet: A Low Complexity Speech Enhancement Framework for Full-Band Audio based on Deep Filtering[J]. arXiv preprint arXiv:2110.05588, 2021.

摘要

复值处理将基于深度学习的语音增强和信号提取提升到一个新的水平。通常,该过程基于应用于噪声频谱图的时频 (TF) 掩膜,而复数掩模(CM)通常比实值掩模更受青睐,因为它们能够修改相位。最近的工作提出用一个复数的滤波器代替带掩码的逐点乘法。这允许利用每个频带内的局部相关性,合并来自以前和未来时间步长的信息。

在这项工作中,我们提出了DeepFilterNet,一个利用深度过滤的两阶段语音增强框架。首先,我们使用模拟人类频率感知的 ERB 缩放增益来增强频谱包络。第二阶段采用Deep filtering 增强语音的周期性成分。除了利用语音的感知特性之外,我们还通过可分离的卷积和线性和循环层中的广泛分组来强制网络稀疏性,以设计一个低复杂度的架构。

我们进一步表明,我们的两阶段深度过滤方法在各种频率分辨率和延迟上都优于复杂的掩码,并且与其他最先进的模型相比,表现出令人信服的性能。

关键词:复数域

2 DeepfilterNet

2.1 信号模型

设x(k)x(k)x(k)为在嘈杂房间中录制的混合信号。

公式1:x(t)=s(t)∗h(t)+z(t)

公式1:x(t)=s(t)*h(t)+z(t)

式中,s(t)s(t)为纯语音信号,h(t)h(t)为扬声器对麦克风的室内脉冲响应,z(t)z(t)为已包含混响环境的加性噪声信号。通常,降噪是在频域进行的

公式2:X(k,f)=S(k,f)·H(k,f)+Z(k,f)

公式2:X(k,f)=S(k,f)·H(k,f)+Z(k,f)

其中X(k,f)X(k,f)是时域信号x(t)x(t)的STFT结果,tt和ff分别是时间和频率bin。

2.2 Deep Filtering

Deep Filtering被定义为 TF域的 复数滤波器:

公式3:Y(k,f)=N∑i=0C(k,i,f)⋅X(k−i+l,f)

公式3:Y(k, f)=\sum_{i=0}^{N} C(k, i, f) \cdot X(k-i+l, f)

其中CC为应用于输入频谱XX的滤波器阶NN的复数系数,YY为增强频谱。在我们的框架中,深度滤波器应用于增益增强频谱YGY^G。ll是一个可选的lookahead(前瞻),如果l≥1l\geq 1,它允许将非因果抽头合并到线性组合中。此外,还可以在频率轴上进行过滤,允许合并相关性,例如 由于重叠频带。

为了进一步保证深度滤波只影响周期部分,我们引入了一个学习的加权因子α\alpha来生成最终输出频谱。

公式4:YDF(k,f)=α(k)⋅YDF′(k,f)+(1−α(k))⋅YG(k,f)

公式4:Y^{D F}(k, f)=\alpha(k) \cdot Y^{D F^{\prime}}(k, f)+(1-\alpha(k)) \cdot Y^{G}(k, f)

2.3 框架概述

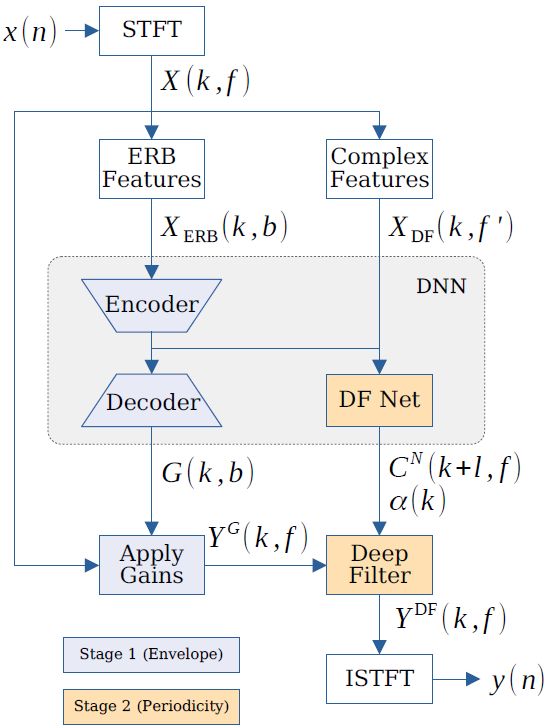

图1所示。DeepFilterNet算法概述。第1阶段用蓝色表示,第2阶段用黄色表示

DeepFilterNet 算法的概述如图 1 所示。给定一个嘈杂(noisy)的音频信号x(t)x(t),我们使用短时傅立叶变换 (STFT) 将信号转换到频域。 该框架设计用于高达 48 kHz 的采样率,以支持高分辨率 VoIP 应用程序和介于 4 ms 和 30 ms 之间的 STFT 窗口大小NFFTN_FFT。 默认情况下,我们使用Nov=50N_{ov} = 50%的重叠,但也支持低延迟场景的更高重叠。 我们为深度神经网络 (DNN) 使用两种输入特征。对于 ERB 编码器/解码器特征XERB(k,b)X_{ERB}(k,b),b∈[0,NERB]b\in [0, N_{ERB}],我们计算对数功率谱,使用衰减为 1 s 的指数均值归一化 [12] 对其进行归一化,并应用一个可配置的频段数NERB的矩形ERB滤波器组(FB)N_{ERB}的矩形 ERB 滤波器组 (FB)。 对于深度滤波器网络特征$X_{DF}(k,f’), f’\in [0, f_{DF}],我们使用复谱作为输入,并使用具有相同衰减的指数单位归一化 [9] 对其进行归一化。

编码器/解码器体系结构用于预测ERBscale增益。利用逆ERB滤波器组将增益变换回频域,然后与噪声谱进行点向相乘。为了进一步增强周期分量,DeepFilterNet预测每频带滤波器系数CN的阶数。我们只使用频率fDFf_{DF}的深度滤波,假设周期分量包含较低频率的大部分能量。

再加上卷积层的DNN前向和深度滤波器前向,得到整体延迟为lNFT+lNov+max(lDNN,lDF)l_{N_{FT}}+l_{N_{ov}}+max(l_{DNN}, l_{DF})导致的最小延迟为5毫秒。

2.4 DNN模型

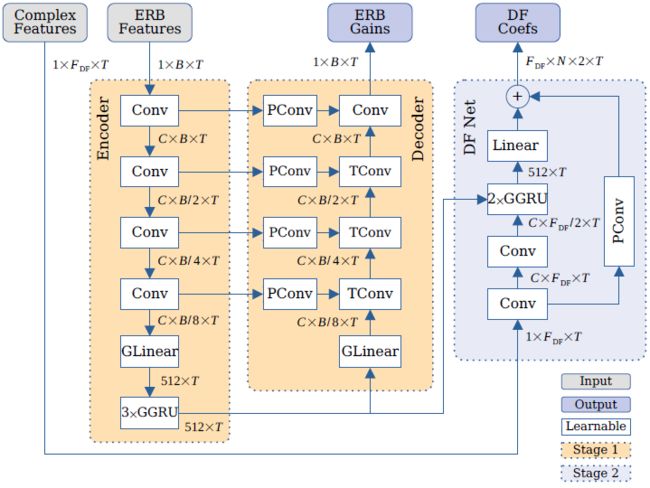

我们专注于设计一个只使用标准DNN层(如卷积、批处理归一化、ReLU等)的高效DNN,这样我们就可以利用层融合以及推理框架的良好支持。我们采用类似于[13,7]的UNet架构,如图2所示。我们的卷积块包含一个可分离的卷积(深度卷积后是1x1卷积),核大小为(3x2), C = 64个通道,然后是批归一化和ReLU激活。卷积层在时间上对齐,这样第一层可以引入一个整体的lookkaahead lDNNl_{DNN}。我们在线性和GRU层中大量使用分组[14,13]。也就是说,将层输入分成P = 8组,产生P个较小的GRUs/线性层,隐藏大小为512/P = 64。输出被shuffle以恢复组间相关性,并再次concatenated到完全隐藏的大小。带有addskip的卷积pathways(通路)[13,7]用于保持频率分辨率。我们为DF Net使用了一个全局路径跳过连接,以在输出层提供原始噪声相位的良好表示。

图2所示。DeepFilterNet架构概述

我们使用1x1路径卷积(PConv)作为add-skip连接和转置卷积块(TConv),类似于编码器块

利用分组线性和GRU (GLinear, GGRU)引入稀疏性

2.5 数据处理

DeepFilterNet框架利用了大量的动态增强。我们在信噪比(SNR)为{5,0,5,10,20,40}dB的情况下,将一个纯净的语音信号与多达5个噪声信号混合。为了进一步增加变量,我们使用[1]、EQs和{6,0,6}dB的二阶滤波器增强语音和噪声信号。随机重采样增加了音高的变化,采用室内脉冲响应(RIR)模拟混响环境。如果语音信号的采样率低于当前模型的采样率,则在混合前对噪声信号应用低通滤波器。例如,这也允许在全频带音频(48 kHz)上训练的模型在较低采样率的输入信号上表现同样良好。我们进一步支持训练衰减有限模型。因此,我们生成一个噪声目标信号ss,它的信噪比 比 噪声信号xx高6到20 dB。在训练过程中,我们对预测增益G进行钳子,并有一个噪声目标ss,DF Net将学会不去除比指定更多的噪声。这对可穿戴设备很有用,因为我们想让用户保持一定的环境意识(识别自己身处的环境)。

2.6 损失函数

提供理想的DF系数CNCN并非易事,因为有无限多的可能性[8]。相反,我们使用压缩谱损失来隐式学习ERB增益GG和滤波器系数CNCN[15,13]。相反,我们使用压缩(compressed)频谱损失来隐式学习ERB增益GG和滤波器系数CNC^N[15,13]。

公式5:Lspec=∑k,f‖|Y|c−|S|c‖2+∑k,f‖|Y|cejφY−|S|cejφS‖2

公式5:\mathcal{L}_{s p e c}=\sum_{k, f}\left||Y|{c}-|S|{c}\right|^{2}+\sum_{k, f}\left||Y|^{c} e^{j \varphi_{Y}}-|S|^{c} e^{j \varphi_{S}}\right|^{2}

其中,c=0.6c=0.6是建模感知响度的压缩因子[16]。由于具有幅值和相位感知项,使得该损失既适用于建模实值增益,也适用于复数DF系数预测。为了使幅值接近于零的TF bin的梯度变硬(例如,对于采样率较低的输入信号),我们计算φX的向后角度方法,如下所示:

公式6:δφδX=δX⋅(−ℑ{X}|Xh|2,ℜ{X}|Xh|2)

公式6:\frac{\delta \varphi}{\delta X}=\delta X \cdot\left(\frac{-\Im{X}}{\left|X_{h}\right|^{2}}, \frac{\Re{X}}{\left|X_{h}\right|^{2}}\right)

式中ℜ{X}\Re{X}和ℑ{X}\Im{X}表示频谱X的实部和虚部,|Xh|2=max(ℜ{X}2+ℑ{X}2,1e−12)|X_h|2=max(\Re{X}2+\Im{X}2,1e{-12})平方数量级以避免被0除。

作为额外的损失项,我们强制DF分量只增强信号的周期性部分。动机如下。对于只有噪音的部分,DF不提供任何优于ERB增益的好处。DF甚至可能通过对周期性噪声(如发动机噪声或巴布噪声)进行建模而产生伪影,这在衰减受限模型中最为明显。此外,对于只有随机成分的语音,如摩擦音或爆破音,DF没有任何好处。假设,这些部分包含大部分的高频率能量,我们计算低于fDFf_{DF}频率的局部SNR。因此,LαL_{\alpha}由下式给出:

公式7:Lα=∑k‖α⋅1LSNR<−10 dB‖2+∑k‖(1−α)⋅1LSNR>−5 dB‖2,

公式7:\mathcal{L}_{\alpha}=\sum_{k}\left|\alpha \cdot \mathbb{1}_{\mathrm{LSNR}<-10 \mathrm{~dB}}\right|^{2}+\sum_{k}\left|(1-\alpha) \cdot \mathbb{1}_{\mathrm{LSNR}>-5 \mathrm{~dB}}\right|^{2},

其中,当局部信噪比(LSNR)小于10 dB时,ILSNR <−10 dB\mathbb{I}_{\text {LSNR }}<-10 \mathrm{~dB}为值为1的特征函数;当局部信噪比大于-5 dB时,ILSNR >−5 dB\mathbb{I}_{\text {LSNR }}>-5 \mathrm{~dB}为1。在20ms窗口范围内,在频域中计算LSNR。综合损失由

公式8:L=λspec ⋅Lspec (Y,S)+λα⋅Lα

公式8:\mathcal{L}=\lambda_{\text {spec }} \cdot \mathcal{L}_{\text {spec }}(Y, S)+\lambda_{\alpha} \cdot \mathcal{L}_{\alpha}

3 实验

3.1 训练步骤

我们基于深度噪声抑制(DNS)挑战数据集[10]训练我们的模型,该数据集包含超过750小时的全频带纯净语音和180小时的各种噪声类型。除了提供的在16 kHz采样的RIR外,我们使用image source模型[17]模拟了另外10 000个在48 kHz采样的RIR。我们将数据集分为train/validation/test(70/15/15%)。根据验证损失应用早期停止,结果在测试集中报告。Voice Bank/DEMAND测试集[18]用于比较DeepFilterNet与相关工作,如DCCRN(+)[11,7]和PercepNet[2]。

所有实验都使用采样率为48khz的全频带信号。我们取NNRBN_{NRB}= 32,fDFf_{DF} = 5 kHz,DF阶数N = 5,对DF和DNN卷积都取l=1l=1帧。我们用一个初始学习率为1∗10−31*10^{-3}的adam优化器,训练我们的模型在3 s样本和32个batch的30个epoch。学习率每3个epoch衰减0.9。损耗参数为λspec=1\lambda_{spec} = 1和λα=0.05\lambda_\alpha = 0.05。框架的源代码可以在 https://github.com/Rikorose/DeepFilterNet 获得。

3.2 结果

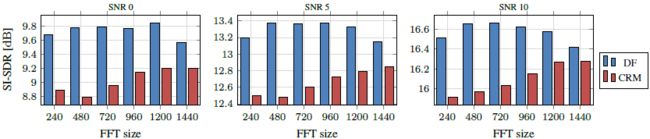

我们评估了我们的框架在多种FFT大小上的性能,并基于尺度不变的信号失真率(SI-SDR)比较了DF和CRM的性能[19]。CRM是DF的特例,阶数N=1N=1,look-ahead l=0l=0。DNN前瞻对于CRM模型保持不变。

图3显示,在5 ms到30 ms的所有FFT大小中,DF都优于CRM。由于受到频率分辨率的限制,当FFT窗口大小为20 ms时,CRMs的性能会下降。另一方面,由于相邻帧间的相关性较小,DF相对恒定的性能下降了约30 ms。对于低延迟场景,将FFT重叠提高到75%会使DF和CRM的性能略有提高(输入SNR为0时,性能为+0.6 dB SI-SNR)。这种性能的提高可以解释为更高的帧内相关性,以及DNN更新RNN隐藏状态的步骤增加了一倍,但计算复杂度增加了一倍。图4给出了一个定性的例子,说明了DF重构噪声谱图中难以区分的语音谐波的能力。

图3所示。深度滤波(DF)和常规复比掩模(CRM)在5 ~ 30 ms的多个FFT尺寸上的比较

图4所示 来自Voice Bank测试集的样本。噪声(a), CRM增强(b), DF增强© (CRM和DF的NFFT = 960)

我们比较了使用NFFT=960 (20 ms)的DeepFilterNet和相关的工作,如PercepNet[2],它使用类似的感知方法,以及DCRNN+[7],它也使用深度滤波器。我们使用WB-PESSQ[20]评估语音增强的质量,并比较每秒乘法和累积(MACS)的计算复杂度。表1显示,DeepFilterNet优于PercepNet,性能与DCRNN+相当,同时具有更低的计算复杂度,使DeepFilterNet能够用于实时使用。

表1 Voice Bank/REMAND测试集的客观结果

4 结论

在这项工作中,我们提出了DeepFilterNet,一个低复杂度的语音增强框架。我们证明了深度过滤网的性能与其他算法相当,而计算量要求要低得多。我们进一步提供了深度过滤优于CRM的证据,特别是在较小的STF窗口大小的情况下。

5 参考文献

[1] Jean-Marc Valin, A hybrid DSP/deep learning approach to real-time full-band speech enhancement, in 2018 IEEE 20th International Workshop on Multimedia Signal Processing (MMSP). IEEE, 2018, pp. 1 5.

[2] Jean-Marc Valin, Umut Isik, Neerad Phansalkar, Ritwik Giri, Karim Helwani, and Arvindh Krishnaswamy, A Perceptually-Motivated Approach for Low-Complexity, Real-Time Enhancement of Fullband Speech, in INTERSPEECH 2020, 2020.

[3] Xu Zhang, Xinlei Ren, Xiguang Zheng, Lianwu Chen, Chen Zhang, Liang Guo, and Bing Yu, Low-Delay Speech Enhancement Using Perceptually Motivated Target and Loss, in Proc. Interspeech 2021, 2021, pp. 2826 2830.

[4] Donald S Williamson, Monaural speech separation using a phase-aware deep denoising auto encoder, in 2018 IEEE 28th International Workshop on Machine Learning for Signal Processing (MLSP). IEEE, 2018, pp. 1 6.

[5] Ke Tan and DeLiang Wang, Complex spectral mapping with a convolutional recurrent network for monaural speech enhancement, in ICASSP 2019-2019 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2019, pp. 6865 6869.

[6] Jonathan Le Roux, Gordon Wichern, Shinji Watanabe, Andy Sarroff, and John R Hershey, Phasebook and friends: Leveraging discrete representations for source separation, IEEE Journal of Selected Topics in Signal Processing, vol. 13, no. 2, pp. 370 382, 2019.

[7] Shubo Lv, Yanxin Hu, Shimin Zhang, and Lei Xie, DCCRN+: Channel-wise Subband DCCRN with SNR Estimation for Speech Enhancement, in INTERSPEECH, 2021.

[8] Wolfgang Mack and Emanu el AP Habets, Deep Filtering: Signal Extraction and Reconstruction Using Complex Time-Frequency Filters, IEEE Signal Processing Letters, vol. 27, pp. 61 65, 2020.

[9] Hendrik Schr oter, Tobias Rosenkranz, Alberto Escalante Banuelos, Marc Aubreville, and Andreas Maier, CLCNet: Deep learning-based noise reduction for hearing aids using complex linear coding, in ICASSP 2020-2020 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), 2020.

[10] Chandan KA Reddy, Harishchandra Dubey, Kazuhito Koishida, Arun Nair, Vishak Gopal, Ross Cutler, Sebastian Braun, Hannes Gamper, Robert Aichner, and Sriram Srinivasan, INTERSPEECH 2021 Deep Noise Suppression Challenge, in INTERSPEECH, 2021.

[11] Yanxin Hu, Yun Liu, Shubo Lv, Mengtao Xing, Shimin Zhang, Yihui Fu, Jian Wu, Bihong Zhang, and Lei Xie, DCCRN: Deep complex convolution recurrent network for phase-aware speech enhancement, in INTERSPEECH, 2020.

[12] Hendrik Schr oter, Tobias Rosenkranz, Alberto N. Escalante-B. , Pascal Zobel, and Andreas Maier, Lightweight Online Noise Reduction on Embedded Devices using Hierarchical Recurrent Neural Networks, in INTERSPEECH 2020, 2020.

[13] Sebastian Braun, Hannes Gamper, Chandan KA Reddy, and Ivan Tashev, Towards efficient models for real-time deep noise suppression, in ICASSP 2021-2021 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2021, pp. 656 660.

[14] Ke Tan and DeLiangWang, Learning complex spectral mapping with gated convolutional recurrent networks for monaural speech enhancement, IEEE/ACM Transactions on Audio, Speech, and Language Processing, vol. 28, pp. 380 390, 2019.

[15] Ariel Ephrat, Inbar Mosseri, Oran Lang, Tali Dekel, Kevin Wilson, Avinatan Hassidim, William T Freeman, and Michael Rubinstein, Looking to Listen at the Cocktail Party: A Speaker-Independent Audio-Visual Model for Speech Separation, ACM Transactions on Graphics (TOG), vol. 37, no. 4, pp. 1 11, 2018.

[16] Jean-Marc Valin, Srikanth Tenneti, Karim Helwani, Umut Isik, and Arvindh Krishnaswamy, Low- Complexity, Real-Time Joint Neural Echo Control and Speech Enhancement Based On PercepNet, in 2021 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2021.

[17] Emanu el AP Habets and Sharon Gannot, Generating sensor signals in isotropic noise fields, The Journal of the Acoustical Society of America, vol. 122, no. 6, pp. 3464 3470, 2007.

[18] Cassia Valentini-Botinhao, Xin Wang, Shinji Takaki, and Junichi Yamagishi, Investigating RNN-based speech enhancement methods for noise-robust Text-to- Speech, in SSW, 2016, pp. 146 152.

[19] Jonathan Le Roux, Scott Wisdom, Hakan Erdogan, and John R Hershey, SDR half-baked or well done? , in ICASSP 2019-2019 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP). IEEE, 2019, pp. 626 630.

[20] ITU, Wideband extension to Recommendation P.862 for the assessment of wideband telephone networks and speech codecs, ITU-T Recommendation P.862.2, 2007.

作者:凌逆战欢迎任何形式的转载,但请务必注明出处。限于本人水平,如果文章和代码有表述不当之处,还请不吝赐教。本文章不做任何商业用途,仅作为自学所用,文章后面会有参考链接,我可能会复制原作者的话,如果介意,我会修改或者删除。