NNDL 实验七 循环神经网络(2)梯度爆炸实验

目录

6.2 梯度爆炸实验

6.2.1 梯度打印函数

6.2.2 复现梯度爆炸现象

6.2.3 使用梯度截断解决梯度爆炸问题

思考题

梯度截断解决梯度爆炸问题的原理是什么?

参考文献

6.2 梯度爆炸实验

造成简单循环网络较难建模长程依赖问题的原因有两个:梯度爆炸和梯度消失。一般来讲,循环网络的梯度爆炸问题比较容易解决,一般通过权重衰减或梯度截断可以较好地来避免;对于梯度消失问题,更加有效的方式是改变模型,比如通过长短期记忆网络LSTM来进行缓解。

本节将首先进行复现简单循环网络中的梯度爆炸问题,然后尝试使用梯度截断的方式进行解决。这里采用长度为20的数据集进行实验,训练过程中将进行输出![]() ,

,![]() ,

,![]() 的梯度向量的范数,以此来衡量梯度的变化情况。

的梯度向量的范数,以此来衡量梯度的变化情况。

6.2.1 梯度打印函数

使用custom_print_log实现了在训练过程中打印梯度的功能,custom_print_log需要接收runner的实例,并通过model.named_parameters()获取该模型中的参数名和参数值. 这里我们分别定义W_list, U_list和b_list,用于分别存储训练过程中参数W,U和b的梯度范数。

import torch

W_list = []

U_list = []

b_list = []

# 计算梯度范数

def custom_print_log(runner):

model = runner.model

W_grad_l2, U_grad_l2, b_grad_l2 = 0, 0, 0

for name, param in model.named_parameters():

if name == "rnn_model.W":

W_grad_l2 = torch.norm(param.grad, p=2).numpy()

if name == "rnn_model.U":

U_grad_l2 = torch.norm(param.grad, p=2).numpy()

if name == "rnn_model.b":

b_grad_l2 = torch.norm(param.grad, p=2).numpy()

print(f"[Training] W_grad_l2: {W_grad_l2:.5f}, U_grad_l2: {U_grad_l2:.5f}, b_grad_l2: {b_grad_l2:.5f} ")

W_list.append(W_grad_l2)

U_list.append(U_grad_l2)

b_list.append(b_grad_l2)【思考】什么是范数,什么是L2范数,这里为什么要打印梯度范数?

范数(Norm)是具有度量性质的函数,它经常使用来衡量矢量函数的长度或大小,是泛函分析中的一个基本概念。

L2 范数:就是通常意义上的模;L2范数通常会被用来做优化目标函数的正则化项,防止模型为了迎合训练集而过于复杂造成过拟合的情况,从而提高模型的泛化能力。

为什么要打印梯度范数:

打印梯度范数值可以帮助我们更直观地了解模型训练情况的好坏,梯度过大或过小都有可能导致模型的训练效果变差,因此打印梯度范数有利于我们更快地对模型作出修改。

6.2.2 复现梯度爆炸现象

为了更好地复现梯度爆炸问题,使用SGD优化器将批大小和学习率调大,学习率为0.2,同时在计算交叉熵损失时,将reduction设置为sum,表示将损失进行累加。 代码实现如下:

import os

import random

import torch

import numpy as np

np.random.seed(0)

random.seed(0)

torch.manual_seed(0)

# 训练轮次

num_epochs = 50

# 学习率

lr = 0.2

# 输入数字的类别数

num_digits = 10

# 将数字映射为向量的维度

input_size = 32

# 隐状态向量的维度

hidden_size = 32

# 预测数字的类别数

num_classes = 19

# 批大小

batch_size = 64

# 模型保存目录

save_dir = "./checkpoints"

# 可以设置不同的length进行不同长度数据的预测实验

length = 20

print(f"\n====> Training SRN with data of length {length}.")

# 加载长度为length的数据

data_path = f"D:/datasets/{length}"

train_examples, dev_examples, test_examples = load_data(data_path)

train_set, dev_set, test_set = DigitSumDataset(train_examples), DigitSumDataset(dev_examples),DigitSumDataset(test_examples)

train_loader = torch.utils.data.DataLoader(train_set, batch_size=batch_size)

dev_loader = torch.utils.data.DataLoader(dev_set, batch_size=batch_size)

test_loader = torch.utils.data.DataLoader(test_set, batch_size=batch_size)

# 实例化模型

base_model = SRN(input_size, hidden_size)

model = Model_RNN4SeqClass(base_model, num_digits, input_size, hidden_size, num_classes)

# 指定优化器

optimizer = torch.optim.SGD(model.parameters(),lr)

# 定义评价指标

metric = Accuracy()

# 定义损失函数

loss_fn = nn.CrossEntropyLoss(reduction="sum")

# 基于以上组件,实例化Runner

runner = RunnerV3(model, optimizer, loss_fn, metric)

# 进行模型训练

model_save_path = os.path.join(save_dir, f"srn_explosion_model_{length}.pdparams")

runner.train(train_loader, dev_loader, num_epochs=num_epochs, eval_steps=100, log_steps=1,

save_path=model_save_path, custom_print_log=custom_print_log)运行结果:

![]()

接下来,可以获取训练过程中关于W,U和b参数梯度的L2范数,并将其绘制为图片以便展示,相应代码如下:

import matplotlib.pyplot as plt

def plot_grad(W_list, U_list, b_list, save_path, keep_steps=40):

# 开始绘制图片

plt.figure()

# 默认保留前40步的结果

steps = list(range(keep_steps))

plt.plot(steps, W_list[:keep_steps], "r-", color="#e4007f", label="W_grad_l2")

plt.plot(steps, U_list[:keep_steps], "-.", color="#f19ec2", label="U_grad_l2")

plt.plot(steps, b_list[:keep_steps], "--", color="#000000", label="b_grad_l2")

plt.xlabel("step")

plt.ylabel("L2 Norm")

plt.legend(loc="upper right")

plt.show()

plt.savefig(save_path)

print("image has been saved to: ", save_path)

save_path = f"./images/6.8.pdf"

plot_grad(W_list, U_list, b_list, save_path)运行结果:

![]()

上图展示了在训练过程中关于,和参数梯度的L2范数,可以看到经过学习率等方式的调整,梯度范数急剧变大,而后梯度范数几乎为0. 这是因为TanhTanh为SigmoidSigmoid型函数,其饱和区的导数接近于0,由于梯度的急剧变化,参数数值变的较大或较小,容易落入梯度饱和区,导致梯度为0,模型很难继续训练.

接下来,使用该模型在测试集上进行测试。

print(f"Evaluate SRN with data length {length}.")

model_path = os.path.join(save_dir, "srn_explosion_model_20.pdparams")

torch.load(model_path)

# 使用测试集评价模型,获取测试集上的预测准确率

score, _ = runner.evaluate(test_loader)

print(f"[SRN] length:{length}, Score: {score: .5f}")运行结果:

Evaluate SRN with data length 20.

[SRN] length:20, Score: 0.06000

6.2.3 使用梯度截断解决梯度爆炸问题

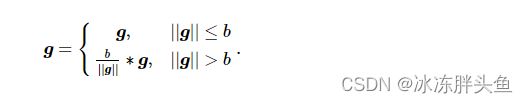

梯度截断是一种可以有效解决梯度爆炸问题的启发式方法,当梯度的模大于一定阈值时,就将它截断成为一个较小的数。一般有两种截断方式:按值截断和按模截断.本实验使用按模截断的方式解决梯度爆炸问题。

按模截断是按照梯度向量![]() 的模进行截断,保证梯度向量的模值不大于阈值

的模进行截断,保证梯度向量的模值不大于阈值![]() ,裁剪后的梯度为:

,裁剪后的梯度为:

当梯度向量的模不大于阈值时,数值不变,否则对进行数值缩放。

在飞桨中,可以使用paddle.nn.ClipGradByNorm进行按模截断.— pytorch中用什么?

pytorch 用 torch.nn.utils.clip_grad_norm_ 进行梯度截断

在引入梯度截断之后,将重新观察模型的训练情况。这里我们重新实例化一下:模型和优化器,然后组装runner,进行训练。代码实现如下:

# 清空梯度列表

W_list.clear()

U_list.clear()

b_list.clear()

# 实例化模型

base_model = SRN(input_size, hidden_size)

model = Model_RNN4SeqClass(base_model, num_digits, input_size, hidden_size, num_classes)

# 定义clip,并实例化优化器

optimizer = torch.optim.SGD(lr=lr, params=model.parameters())

# 定义评价指标

metric = Accuracy()

# 定义损失函数

loss_fn = nn.CrossEntropyLoss(reduction="sum")

# 实例化Runner

runner = RunnerV3(model, optimizer, loss_fn, metric)

# 训练模型

model_save_path = os.path.join(save_dir, f"srn_fix_explosion_model_{length}.pdparams")

runner.train(train_loader, dev_loader, num_epochs=num_epochs, eval_steps=100, log_steps=1, save_path=model_save_path, custom_print_log=custom_print_log)

# 进行模型训练

model_save_path = os.path.join(save_dir, f"srn_explosion_model_{length}.pdparams")在引入梯度截断后,获取训练过程中关于![]() ,

,![]() 和

和![]() 参数梯度的L2范数,并将其绘制为图片以便展示,相应代码如下:

参数梯度的L2范数,并将其绘制为图片以便展示,相应代码如下:

save_path = f"D:/images/6.9.pdf"

plot_grad(W_list, U_list, b_list, save_path, keep_steps=100)运行结果:

![]()

接下来,使用梯度截断策略的模型在测试集上进行测试。

print(f"Evaluate SRN with data length {length}.")

# 加载训练过程中效果最好的模型

model_path = os.path.join(save_dir, f"srn_fix_explosion_model_{length}.pdparams")

torch.load(model_path)

# 使用测试集评价模型,获取测试集上的预测准确率

score, _ = runner.evaluate(test_loader)

print(f"[SRN] length:{length}, Score: {score: .5f}")运行结果:

Evaluate SRN with data length 20.

[SRN] length:20, Score: 0.05000

由于为复现梯度爆炸现象,改变了学习率,优化器等,因此准确率相对比较低。但由于采用梯度截断策略后,在后续训练过程中,模型参数能够被更新优化,因此准确率有一定的提升。

思考题

梯度截断解决梯度爆炸问题的原理是什么?

设置梯度剪切阈值。在更新梯度时,如果梯度超过这个阈值,那么就将其强制限制在这个范围之内。

参考文献

NNDL 实验6(上) - HBU_DAVID - 博客园邱锡鹏,神经网络与深度学习,机械工业出版社,https://nndl.github.io/, 2020. https://github.com/nndl/practice-in-paddle/ 第6章https://www.cnblogs.com/hbuwyg/p/16617681.html范数及其意义_未央&袅袅的博客-CSDN博客_范数的几何意义什么是范数?范数(Norm)是具有度量性质的函数,它经常使用来衡量矢量函数的长度或大小,是泛函分析中的一个基本概念。要更好的理解范数,就要从函数、几何与矩阵的角度去理解,我尽量讲的通俗一些。我们都知道,函数与几何图形往往是有对应的关系,这个很好想象,特别是在三维以下的空间内,函数是几何图像的数学概括,而几何图像是函数的高度形象化,比如一个函数对应几何空间上若干点组成的图形。但当函数与几何超出三维空间时,就难以获得较好的想象,于是就有了映射的概念,映射表达的就是一个集合通过某种关系转为另外一个集合。通https://blog.csdn.net/WXLLOVESX/article/details/107344685?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522166945279916782390558891%2522%252C%2522scm%2522%253A%252220140713.130102334..%2522%257D&request_id=166945279916782390558891&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduend~default-2-107344685-null-null.142%5Ev66%5Econtrol,201%5Ev3%5Eadd_ask,213%5Ev2%5Et3_control1&utm_term=%E4%BB%80%E4%B9%88%E6%98%AF%E8%8C%83%E6%95%B0&spm=1018.2226.3001.4187

(19条消息) 梯度弥散、梯度爆炸及解决方案_褚骏逸的博客-CSDN博客![]() https://blog.csdn.net/weixin_41171061/article/details/106264239

https://blog.csdn.net/weixin_41171061/article/details/106264239