远程GPU服务器运行Python

目录

前言

一、服务器登录

1.1 下载安装putty

1.2 putty远程登录

1.3 查看GPU、显卡常用命令

1.4 Linux常用命令

二、Anaconda创建虚拟环境并安装pytorch

2.1 安装Anaconda

2.2 安装Pytorch

三、使用FileZilla拷贝文件至服务器

3.1 下载安装FileZilla

3.2 使用FileZilla传输文件

四、运行JupyterNotebook

4.1 安装 jupyter

4.2 生成密码

4.3 生成配置文件

4.4 打开jupyter server

4.5 切换虚拟环境

五、运行py文件

5.1 激活虚拟环境

5.2 运行py文件

前言

众所周知,使用本地电脑的CPU跑深度学习代码非常慢,而GPU内在架构做矩阵运算和深度学习的神经网络有着先天的优势,近期本人找到一台安装linux系统的GPU服务器,现将使用过程中摸索的经验分享给大家。

一、服务器登录

1.1 下载安装putty

首先我们要下载putty等软件进行登录服务器

下载连接:https://pan.baidu.com/s/1LZ5jl6Sk3-A3lmnDEdZmVA

提取码:xuof

1.2 putty远程登录

双击之后出现如下界面,然后输入服务器的地址(端口号选22),然后点击open进入登录界面

进入服务器linux操作界面,如下图,输入密码(输入的具体内容不显示,输入完点击Enter即可)

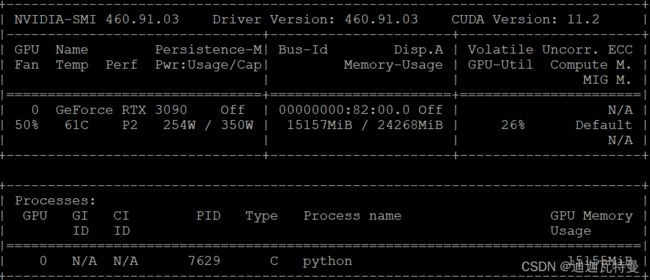

查看显卡详情命令:nvidia-smi

从上图可以看到我们GPU的基本配置,内存为24G,当前有1.5G左右在运行pyton代码

从上图可以看到我们GPU的基本配置,内存为24G,当前有1.5G左右在运行pyton代码

1.3 查看GPU、显卡常用命令

可参考下方博文

查看gpu、显卡常用命令_heituzii的博客-CSDN博客

1.4 Linux常用命令

可参考下方博文

Linux常用命令大全(非常全!!!)_木头大左的博客-CSDN博客_linux常用命令

二、Anaconda创建虚拟环境并安装pytorch

2.1 安装Anaconda

通过下方连接选择需要的Anaconda版本

https://repo.anaconda.com/archive/

然后输入

wget+下载链接

若成功会出现如下界面

![]()

具体过程可以参考下方博客

如何在Linux服务器上安装Anaconda(超详细)_あなたを待って-CSDN博客_服务器安装anaconda

2.2 安装Pytorch

首先进入Anaconda安装目录

输入ls查看目录列表

ls

输入cd+文件夹名,进入指定目录,我在自己本地操作目录如下

cd anaconda3/envs/

创建一个叫做 'dir1' 的目录'

mkdir dir1

激活创建的虚拟环境

source activate dir1

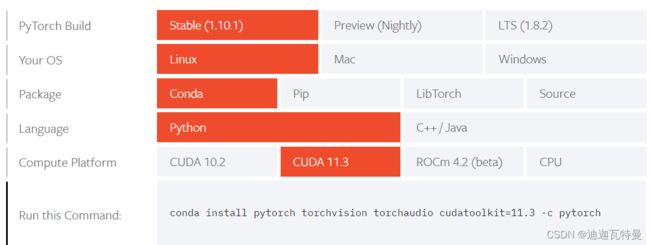

安装pytorch,进入pytorch官网, 如下链接

Start Locally | PyTorch

选择自己需要的版本,并获取相关命令

nvidia-smi查看当前GPU版本,可以看到我使用的GPU版本是11.2![]() 安装11.3版本最契合

安装11.3版本最契合

conda install pytorch torchvision torchaudio cudatoolkit=11.3 -c pytorch

然后我们需要什么package就在已激活的Anaconda虚拟环境envs中pip安装即可

putty软件可同时登录多个窗口,我们可以在一个窗口中运行代码,过程中报错什么package没有安装,在另一个窗口中进行虚拟环境安装相应的package即可

关闭虚拟环境

conda deactivate dir1

三、使用FileZilla拷贝文件至服务器

3.1 下载安装FileZilla

链接:https://pan.baidu.com/s/1lsoALuEKZkej58ov6bbL2Q

提取码:31yg

3.2 使用FileZilla传输文件

安装好FileZilla之后将下载好的文件拷贝到服务器指定目录 ,具体操作步骤比较简单,可参照这篇博文FileZilla使用ssh连接linux_破阵的专栏-CSDN博客_filezilla ssh链接

四、运行JupyterNotebook

4.1 安装 jupyter

pip install jupyter

4.2 生成密码

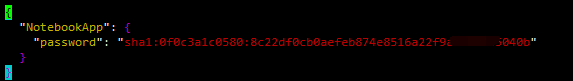

jupyter-notebook password

这将会在 ‘~/.jupyter/jupyter_notebook_config.json’ 文件中生成一个哈希键

vi .jupyter/jupyter_notebook_config.json

4.3 生成配置文件

jupyter lab --generate-config

4.4 打开jupyter server

jupyter lab

通过cd命令,进入自己的文件夹(先创建自己的工作文件夹),然后输入

jupyter lab

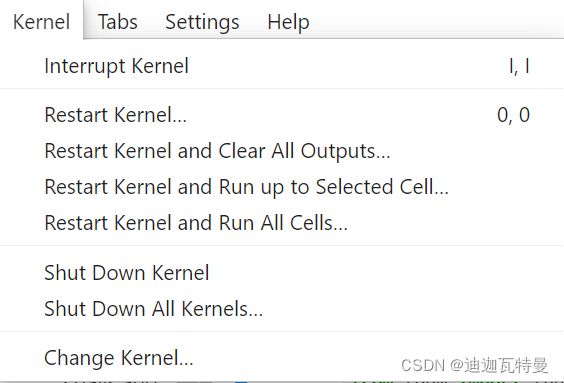

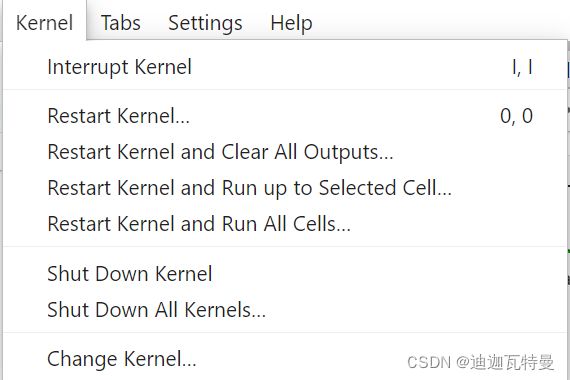

前面加上nohup可以保证在与服务器断开连接的情况下任然运行代码,当代码结果处理是,或者运行过程中可以去output.out文件中查看日志,此过程中服务器计算资源保持占用,结束之后输入 Kernel——Restart Kernel..解除占用,或者通过鼠标箭头移动到代码上,右键Clear Outputs

输入上述命令,可以生成相应的password和一个端口号,JupyterNotebook,

在本地电脑打开任意浏览器,输入http://(服务器IP):(生成的端口号)/

进如JupyterNotebook,然后输入相应的password即可完成登录

4.5 切换虚拟环境

选择Kernel——Change Kernel..可以选择自己搭建的环境,或者切换环境,然后在此环境下运行.pynb文件

五、运行py文件

5.1 激活虚拟环境

source activate+虚拟环境名称

5.2 运行py文件

在自己想要使用的虚拟环境激活的情况下,cd命令访问py文件所在目录,然后输入命令

python+文件名.py

以上就是我当前使用GPU服务器的经验,分享给大家,希望可以有所帮助。