算法笔记(24)波士顿房价回归及Python代码实现

数据集介绍

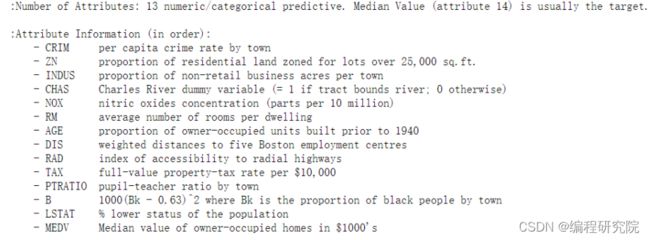

波士顿房价数据集中有4个键,分别是数据、目标、特征名称和描述。数据集中共有506个样本,每个样本有

13个特征变量,后面还有一个叫做中位数的第14个变量,这个变量是业主自住房屋价格的中位数,以千美元为单位,这个变量就是该数据集中的target。

数据集介绍

使用SVR进行建模

先制作训练数据集和测试数据集,用SVR进行建模,用两种核函数Linear和rbf进行对比分析。

X, y = boston.data, boston.target

X_train, X_test, y_train, y_test = train_test_split(X, y, random_state=8)

print(X_train.shape)

print(X_test.shape)

for kernel in ['linear','rbf']:

svr = SVR(kernel=kernel)

svr.fit(X_train, y_train)

print(kernel,'核函数的模型训练集得分:{:.3f}'.format(

svr.score(X_train, y_train)))

print(kernel,'核函数的模型测试集得分:{:.3f}'.format(

svr.score(X_test, y_test)))linear 核函数的模型训练集得分:0.709

linear 核函数的模型测试集得分:0.696

rbf 核函数的模型训练集得分:0.192

rbf 核函数的模型测试集得分:0.222

结果分析:从结果中看到,两种核函数的模型得分都不能令人满意,使用rbf核函数的模型更糟糕,在训练数据集的得分只有0.192。这是因为数据集的各个特征之间的量级差的比较大,SVM算法对于数据预处理的要求是比较高的,数据特征量级差异较大,需要对数据进行预处理。

数据预处理

预处理前,第一个特征最小值在10^-2 ,最大值在10^2,经过预处理后,不管是训练集还是测试集,基本上所有的特征最大值都不会超过10,最小值也都趋近于0,以至于我们在图中已经看不到它们了。

scaler = StandardScaler()

scaler.fit(X_train)

X_train_scaled = scaler.transform(X_train)

X_test_scaled = scaler.transform(X_test)

plt.plot(X_train_scaled.min(axis=0),'v',label='train set min')

plt.plot(X_train_scaled.max(axis=0),'^',label='train set max')

plt.plot(X_test_scaled.min(axis=0),'v',label='test set min')

plt.plot(X_test_scaled.max(axis=0),'^',label='test set max')

plt.yscale('log')

plt.legend(loc='best')

plt.xlabel('scaled features')

plt.ylabel('scaled feature magnitude')

plt.show()各个特征的量级分布

经过预处理的数据特征量级分布

重新训练模型

经过预处理后,linear内核的SVR得分变化不大,而rbf内核的SVR得分有巨大的提升。

for kernel in ['linear','rbf']:

svr = SVR(kernel=kernel)

svr.fit(X_train_scaled, y_train)

print('数据预处理后',kernel,'核函数的模型训练集得分:{:.3f}'.format(

svr.score(X_train_scaled, y_train)))

print('数据预处理后',kernel,'核函数的模型测试集得分:{:.3f}'.format(

svr.score(X_test_scaled, y_test)))数据预处理后 linear 核函数的模型训练集得分:0.706

数据预处理后 linear 核函数的模型测试集得分:0.698

数据预处理后 rbf 核函数的模型训练集得分:0.665

数据预处理后 rbf 核函数的模型测试集得分:0.695

调节参数后模型

和SVC一样,SVR模型也有gamma和C两个参数,调整rbf内核的SVR模型参数,对这两个参数进行修改模型得分提升。

svr = SVR(C=100, gamma=0.1)

svr.fit(X_train_scaled, y_train)

print('调节参数后的模型在训练集得分:{:.3f}'.format(

svr.score(X_train_scaled, y_train)))

print('调节参数后的模型在测试集得分:{:.3f}'.format(

svr.score(X_test_scaled, y_test)))调节参数后的模型在训练集得分:0.966

调节参数后的模型在测试集得分:0.894

想要完整代码的朋友,可toutiao搜索“编程研究坊”关注后s信我,回复“算法笔记24“获取