YOLOv5:yolov5s.yaml文件解读

我的环境:

● 语言环境:Python 3.8

● 编译器:Pycharm

● 数据集:coco128

● 深度学习环境:Pytorch

一.参数配置:

# Parameters

nc: 80 # number of classes

depth_multiple: 0.33 # model depth multiple

width_multiple: 0.50 # layer channel multiple·depth_multiple:控制子模块数量=int(number*depth)(该参数与任务有关)

·width_multiple:控制卷积核的数量=int(number*width)

二.anchors:

anchors:

- [10,13, 16,30, 33,23] # P3/8

- [30,61, 62,45, 59,119] # P4/16

- [116,90, 156,198, 373,326] # P5/32YOLOv5初始化了9个anchors,在三个Detect层使用(3个feature map)中使用,每个feature map的每个grid_cell 都有三个anchor进行预测。

规则:

1.尺度越大的feature map越靠前,相对原图的下采样率越小,感受野越小,所以相对可以预测一些尺度比较小的物体,所有分配到的anchors越小;

2.尺度越小的feature map 越靠后,相对原图的下采样率越大,感受野越大,所以相对可以预测一些尺度比较大的物体,所有分配到的anchors 越大。

即可以在小特征图(feature map)上检测大目标,也可以在大特征图上检测小目标。

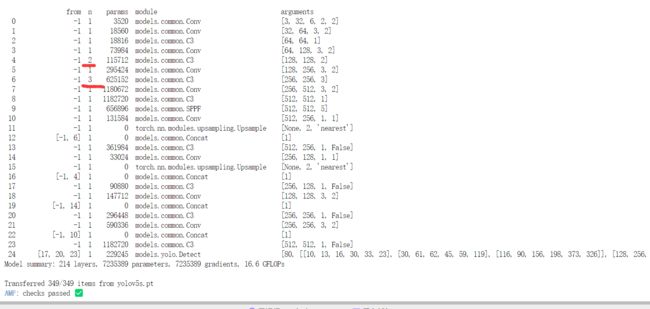

三.backbone:

backbone:

# [from, number, module, args]

[[-1, 1, Conv, [64, 6, 2, 2]], # 0-P1/2

[-1, 1, Conv, [128, 3, 2]], # 1-P2/4

[-1, 3, C3, [128]],

[-1, 1, Conv, [256, 3, 2]], # 3-P3/8

[-1, 3, C3, [256]],

[-1, 1, Conv, [512, 3, 2]], # 5-P4/16

[-1, 6, C3, [512]],

[-1, 1, Conv, [1024, 3, 2]], # 7-P5/32

[-1, 3, C3, [1024]],

[-1, 1, SPPF, [1024, 5]], # 9

]这是yolov5s的backbone,可以看到每一个模块算一行,每行都由四个参数构成。分别是:

·from:表示当前模块的输入来自那一层的输出,-1表示来自上一层的输出。

·number:表示当前模块的理论重复次数,实际的重复次数还要由上面的参数depth_multiple共同决定,决定网络模型的深度。

·module:模块类名,通过这个类名去common.py中寻找相应的类,进行模块化的搭建网络。

·args:是一个1ist,模块搭建所需参数,channe1,kernel_size,stride,padding,bias等,会在网络搭建过程中根据不同层进行改变。

四.head:

# YOLOv5 v6.0 head

head:

[[-1, 1, Conv, [512, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 6], 1, Concat, [1]], # cat backbone P4

[-1, 3, C3, [512, False]], # 13

[-1, 1, Conv, [256, 1, 1]],

[-1, 1, nn.Upsample, [None, 2, 'nearest']],

[[-1, 4], 1, Concat, [1]], # cat backbone P3

[-1, 3, C3, [256, False]], # 17 (P3/8-small)

[-1, 1, Conv, [256, 3, 2]],

[[-1, 14], 1, Concat, [1]], # cat head P4

[-1, 3, C3, [512, False]], # 20 (P4/16-medium)

[-1, 1, Conv, [512, 3, 2]],

[[-1, 10], 1, Concat, [1]], # cat head P5

[-1, 3, C3, [1024, False]], # 23 (P5/32-large)

[[17, 20, 23], 1, Detect, [nc, anchors]], # Detect(P3, P4, P5)

]

同backbone

任务:修改第四层的C3*2为C3*1,第六层的C3*3为C3*2

修改YOLOv5.yaml文件