Hadoop 综合训练:文件内容的显示与排序

文章目录

- 一,显示文件内容

-

- (一)启动hadoop服务

- (二)创建并上传本地文件

-

- (1)创建students.txt文件

- (2)上传文件到HDFS

- (三)创建Maven项目:DisplayFile

-

- (1)添加相关依赖

- (2)创建日志属性文件

- (四)创建读取文件类:ReadFileOnHDFS

- (五)运行ReadFileOnHDFS类,查看结果

- 二,完成数据排序

-

- (一)启动hadoop服务

- (二)创建Maven项目:SortByAge

-

- (1)创建:SortByAge

- (2)添加相关依赖

- (3)创建日志文件

- (三)创建实体类:FlowBean

- (四)创建年龄排序映射器类:SortByAgeMapper

- (五)创建年龄排序归并器类:SortByAgeReducer

- (六)创建年龄排序驱动器类:SortByAgeDriver

- (七)运行SortByAgeDriver类,查看结果

一,显示文件内容

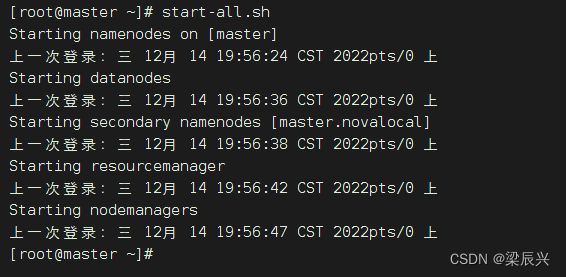

(一)启动hadoop服务

(二)创建并上传本地文件

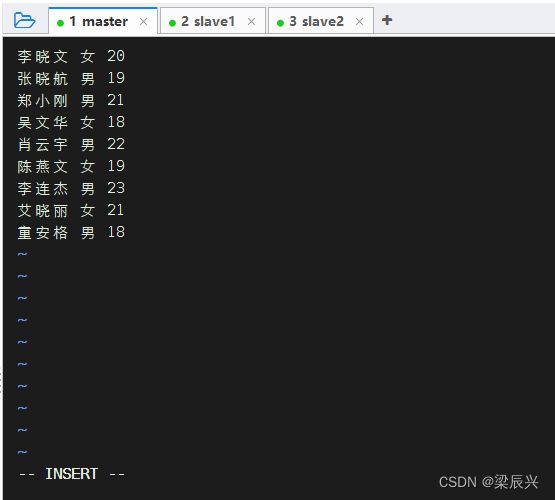

(1)创建students.txt文件

1.在master虚拟机上创建/export/task目录,输入命令:mkdir /export/task

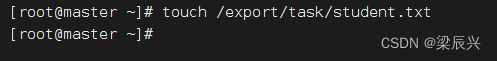

2.在/export/task目录下创建文件students.txt,输入命令:touch /export/task/student.txt

3.向student.txt文件添加如下内容:

李晓文 女 20

张晓航 男 19

郑小刚 男 21

吴文华 女 18

肖云宇 男 22

陈燕文 女 19

李连杰 男 23

艾晓丽 女 21

童安格 男 18

(2)上传文件到HDFS

1.创建/student/input目录,输入命令:hdfs dfs -mkdir -p /student/input

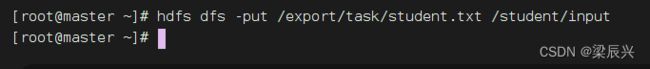

2.上传student.txt文件到HDFS上,输入命令:hdfs dfs -put /export/task/student.txt /student/input

3.在hadoop webui界面查看文件是否上传成功

(三)创建Maven项目:DisplayFile

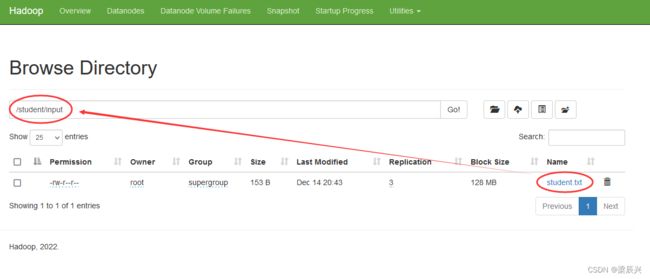

1.设置为下图所示,单击【Create】按钮

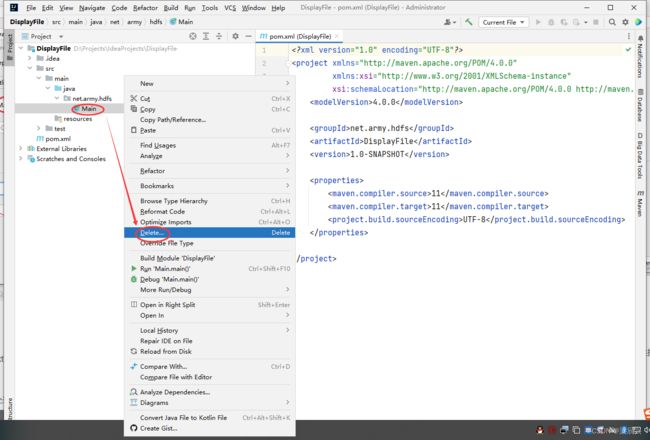

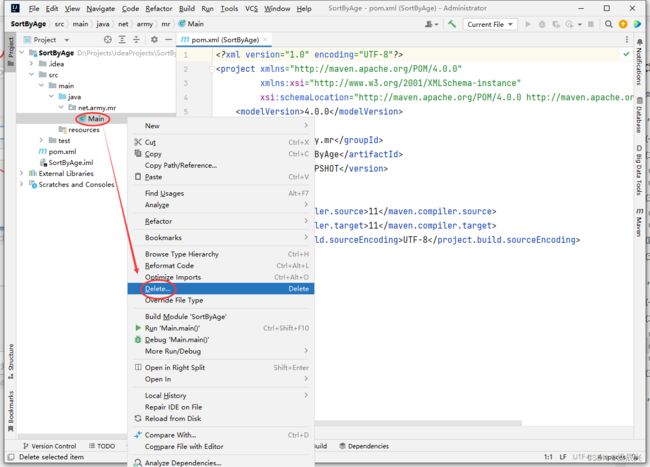

2.删除【Main】主类:右击【Main】类,单击【Delete】

(1)添加相关依赖

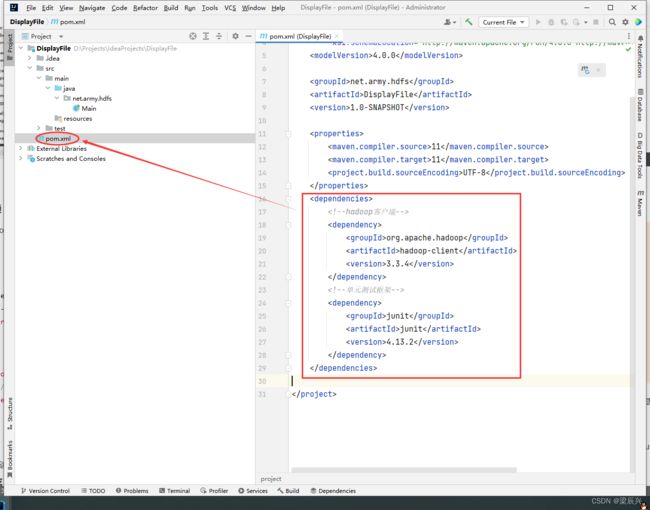

1.在pom.xml文件里添加hadoop和junit依赖,内容如下:

<dependencies>

<dependency>

<groupId>org.apache.hadoopgroupId>

<artifactId>hadoop-clientartifactId>

<version>3.3.4version>

dependency>

<dependency>

<groupId>junitgroupId>

<artifactId>junitartifactId>

<version>4.13.2version>

dependency>

dependencies>

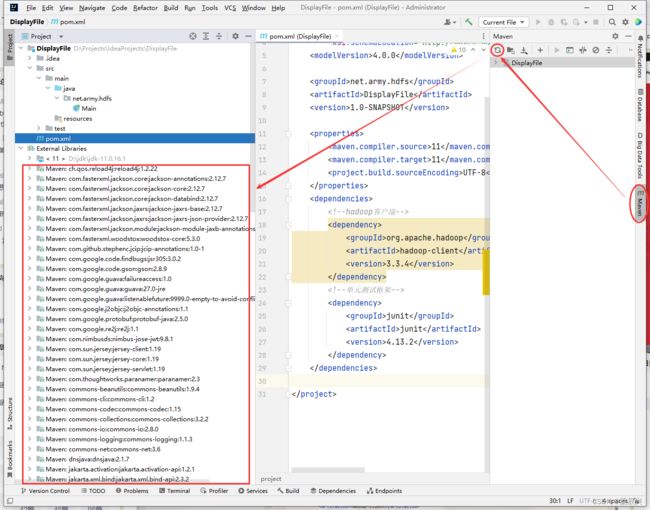

2.单击【maven】,单击那个刷新按钮,它会自动下载相关依赖

2.单击【maven】,单击那个刷新按钮,它会自动下载相关依赖

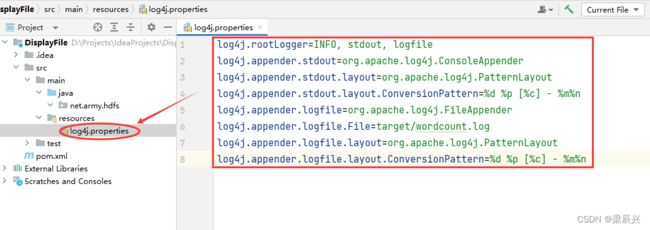

(2)创建日志属性文件

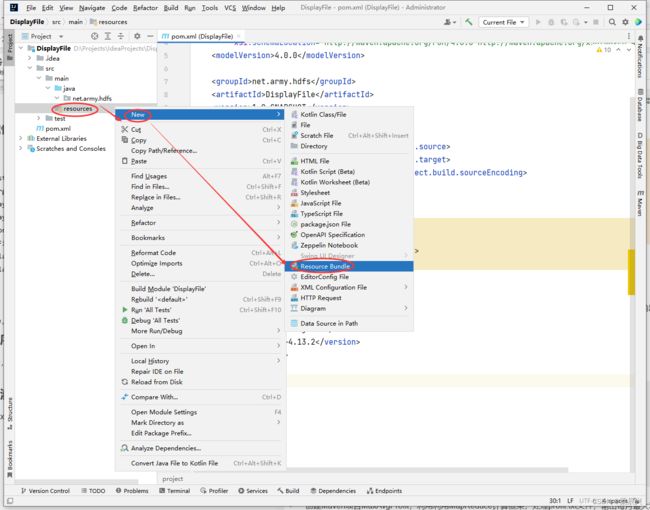

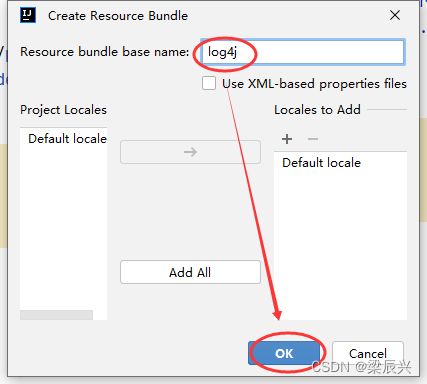

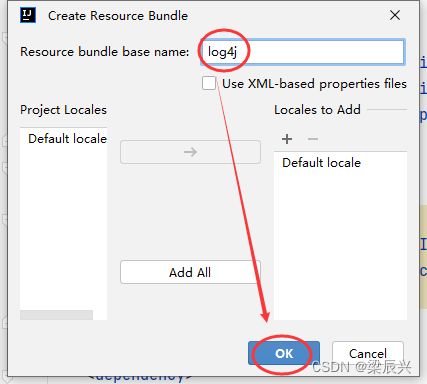

1.右击resources目录,单击【new】选择【resources bundle】,弹出下图界面输入log4j,单击【ok】按钮

2.在弹出的【Create Resource Bundle】对话框中输入:log4j,单击【OK】按钮

2.在弹出的【Create Resource Bundle】对话框中输入:log4j,单击【OK】按钮

3.log4j.properties文件添加如下内容:

log4j.rootLogger=INFO, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/wordcount.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

(四)创建读取文件类:ReadFileOnHDFS

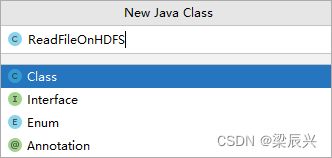

1.右击【net.army.mr】包,选择【new】,单击【java class】

2.在弹出的对话框输入ReadFileOnHDFS,按下回车键

2.在弹出的对话框输入ReadFileOnHDFS,按下回车键

3.编写代码

package net.army.hdfs;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import java.io.BufferedReader;

import java.io.InputStreamReader;

import java.net.URI;

/**

* 作者:梁辰兴

* 日期:2022/12/14

* 功能:读取HDFS上的文件

*/

public class ReadFileOnHDFS {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 定义统一资源标识符(uri: uniform resource identifier)

String uri = "hdfs://master:9000";

// 创建文件系统对象(基于HDFS的文件系统)

FileSystem fs = FileSystem.get(new URI(uri), conf, "root");

// 创建路径对象(指向文件)

Path path = new Path(uri + "/student/input/student.txt");

// 创建文件系统数据字节输入流(进水管:数据从文件到程序)

FSDataInputStream in = fs.open(path);

// 创建缓冲字符输入流,提高读取效率(字节流-->字符流-->缓冲流)

BufferedReader br = new BufferedReader(new InputStreamReader(in));

// 定义行字符串变量

String nextLine = "";

// 通过循环遍历缓冲字符输入流

while ((nextLine = br.readLine()) != null) {

// 在控制台输出读取的行

System.out.println(nextLine);

}

// 关闭缓冲字符输入流

br.close();

// 关闭文件系统数据字节输入流

in.close();

// 关闭文件系统

fs.close();

}

}

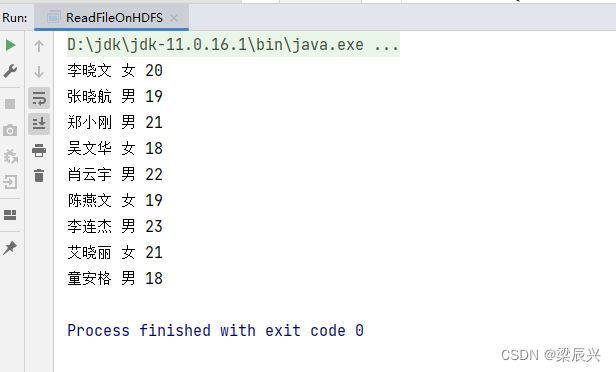

(五)运行ReadFileOnHDFS类,查看结果

二,完成数据排序

(一)启动hadoop服务

(二)创建Maven项目:SortByAge

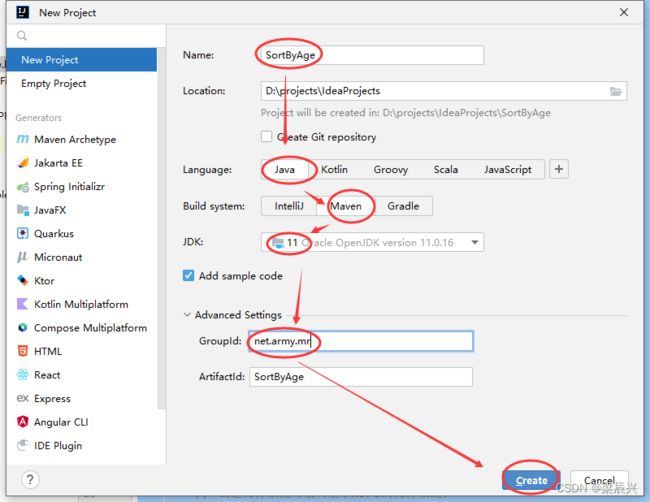

(1)创建:SortByAge

1.配置为如下图所示,单击【Create】按钮

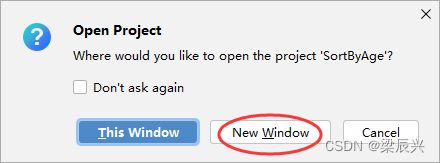

2.如果不想关闭当前项目,就单击【New Window】

2.如果不想关闭当前项目,就单击【New Window】

3.成功创建并打开了项目,然后删除【Main】类,如下图操作即可

(2)添加相关依赖

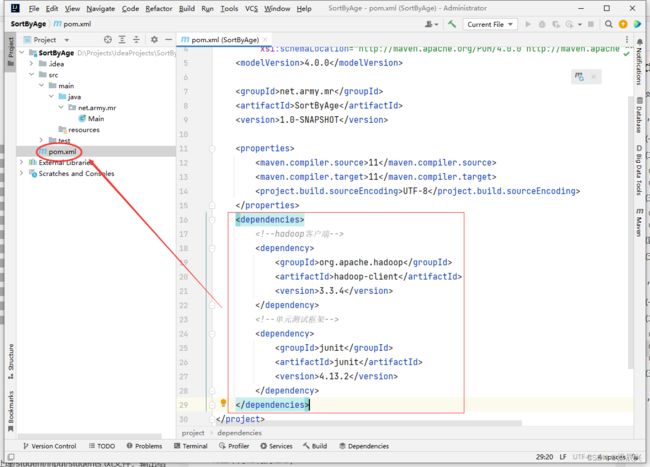

1.向pom.xml文件里添加hadoop和junit依赖,内容如下:

<dependencies>

<dependency>

<groupId>org.apache.hadoopgroupId>

<artifactId>hadoop-clientartifactId>

<version>3.3.4version>

dependency>

<dependency>

<groupId>junitgroupId>

<artifactId>junitartifactId>

<version>4.13.2version>

dependency>

dependencies>

2.添加完成后的示例图

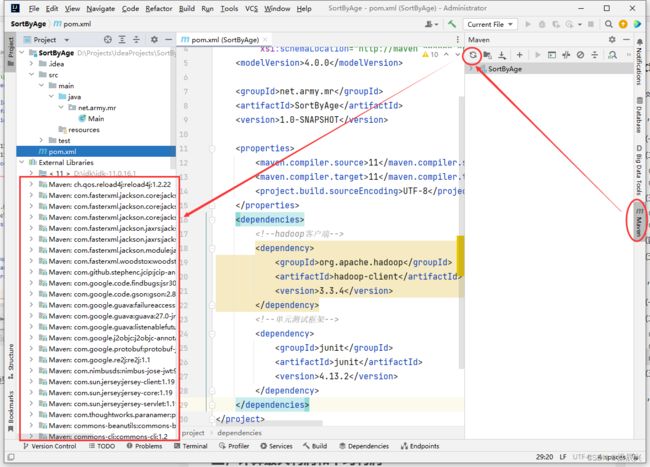

3.刷新本地的maven仓库,如果没有下载,会自动下载依赖到本地:单击【Maven】,单击【刷新】按钮

(3)创建日志文件

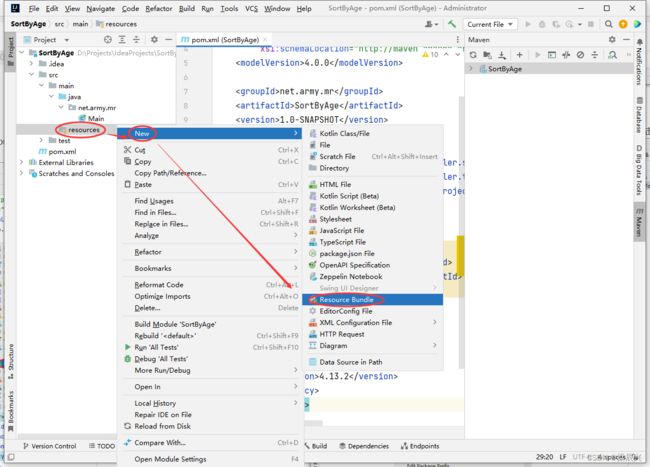

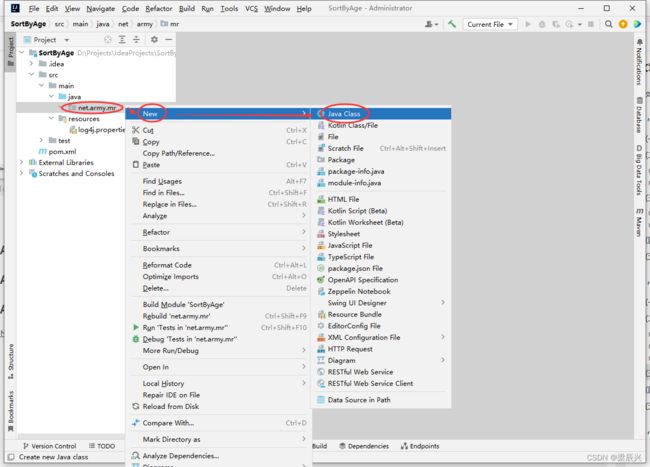

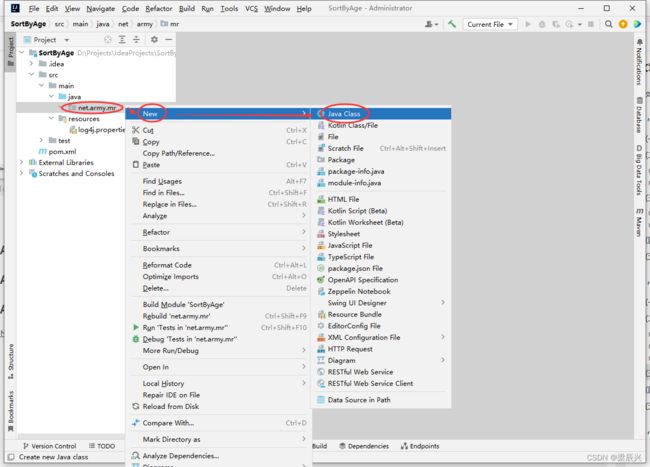

1.在resources目录里创建log4j.properties文件,右击【resources】,选择【New】,单击【Resource Bundle】

2.在弹出的对话框中输入:log4j,按【OK】按钮,成功创建

2.在弹出的对话框中输入:log4j,按【OK】按钮,成功创建

3.向log4j.properties文件添加如下内容:

log4j.rootLogger=INFO, stdout, logfile

log4j.appender.stdout=org.apache.log4j.ConsoleAppender

log4j.appender.stdout.layout=org.apache.log4j.PatternLayout

log4j.appender.stdout.layout.ConversionPattern=%d %p [%c] - %m%n

log4j.appender.logfile=org.apache.log4j.FileAppender

log4j.appender.logfile.File=target/topnscore.log

log4j.appender.logfile.layout=org.apache.log4j.PatternLayout

log4j.appender.logfile.layout.ConversionPattern=%d %p [%c] - %m%n

(三)创建实体类:FlowBean

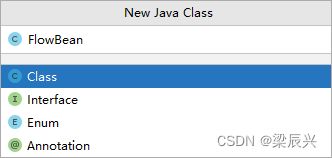

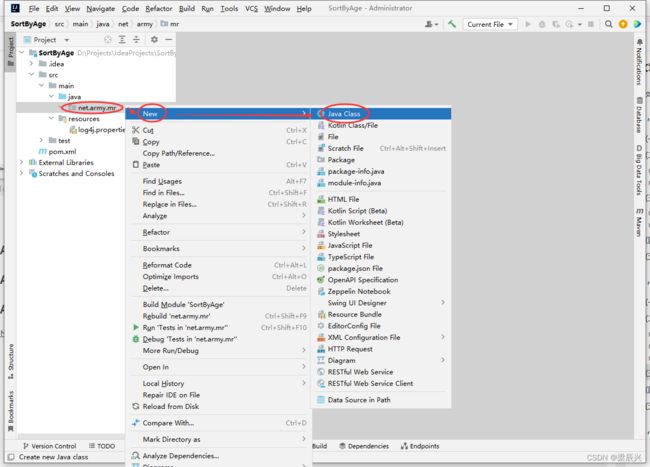

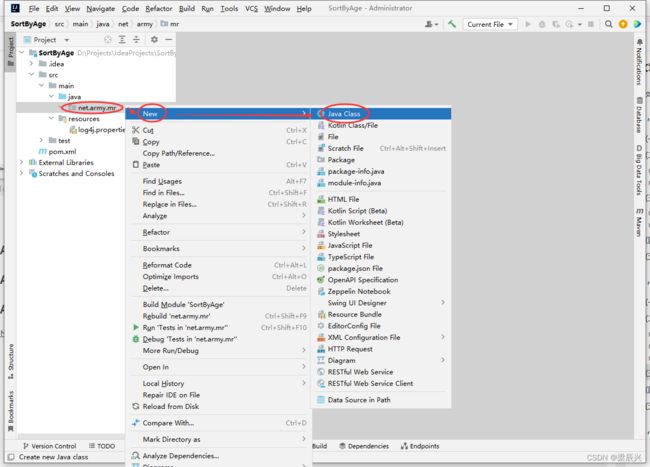

1.右击【net.army.mr】,选择【New】,单击【Java Class】

2.在弹出的对话框中输入:FlowBean,按下回车键,成功创建

2.在弹出的对话框中输入:FlowBean,按下回车键,成功创建

3.编写代码

package net.army.mr;

import org.apache.hadoop.io.WritableComparable;

import java.io.DataInput;

import java.io.DataOutput;

import java.io.IOException;

/**

* 作者:梁辰兴

* 日期:2022/12/17

* 功能:序列化方法

*/

public class FlowBean implements WritableComparable<FlowBean> {

String name;

String sex;

int age;

@Override

public String toString() {

return "FlowBean{" +

"name='" + name + '\'' +

", sex='" + sex + '\'' +

", age=" + age +

'}';

}

public String getSex() {

return sex;

}

public void setSex(String sex) {

this.sex = sex;

}

public int getAge() {

return age;

}

public void setAge(int age) {

this.age = age;

}

public String getName() {

return name;

}

public void setName(String name) {

this.name = name;

}

public int compareTo(FlowBean o) {

return o.getAge() - this.getAge();

}

@Override

public void write(DataOutput dataOutput) throws IOException {

dataOutput.writeUTF(name);

dataOutput.writeUTF(sex);

dataOutput.writeInt(age);

}

@Override

public void readFields(DataInput dataInput) throws IOException {

name = dataInput.readUTF();

sex = dataInput.readUTF();

age = dataInput.readInt();

}

}

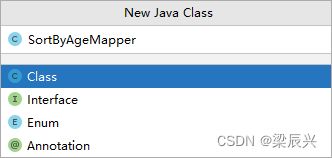

(四)创建年龄排序映射器类:SortByAgeMapper

1.右击【net.army.mr】,选择【New】,单击【Java Class】

2.在弹出的对话框中输入:SortByAgeMapper,按下回车键,成功创建

2.在弹出的对话框中输入:SortByAgeMapper,按下回车键,成功创建

3.编写代码

package net.army.mr;

import org.apache.hadoop.io.LongWritable;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Mapper;

import java.io.IOException;

/**

* 作者:梁辰兴

* 日期:2022/12/16

* 功能:年龄排序映射器类

*/

public class SortByAgeMapper extends Mapper<LongWritable, Text, FlowBean, NullWritable> {

public void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 获取行

String line = value.toString();

// 拆分

String[] nums = line.split(" ");

// 抓取数据

String name = nums[0];

String sex = nums[1];

int age = Integer.parseInt(nums[2]);

// 创建flowbean对象

FlowBean flowBean = new FlowBean();

flowBean.setName(name);

flowBean.setSex(sex);

flowBean.setAge(age);

// 传出

context.write(flowBean, NullWritable.get());

}

}

(五)创建年龄排序归并器类:SortByAgeReducer

1.右击【net.army.mr】,选择【New】,单击【Java Class】

2.在弹出的对话框中输入:SortByAgeReducer,按下回车键,成功创建

3.编写代码

package net.army.mr;

import org.apache.hadoop.io.NullWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

import java.io.IOException;

/**

* 作者:梁辰兴

* 日期:2022/12/16

* 功能:年龄排序归并器类

*/

public class SortByAgeReducer extends Reducer<FlowBean, NullWritable, Text, NullWritable> {

@Override

protected void reduce(FlowBean key, Iterable<NullWritable> values, Reducer<FlowBean, NullWritable, Text, NullWritable>.Context context) throws IOException, InterruptedException {

for (NullWritable value : values) {

// 拼接数据

String StudentInfo = key.getName() + "\t" + key.sex + "\t" + key.age;

// 传出

context.write(new Text(StudentInfo), NullWritable.get());

}

}

}

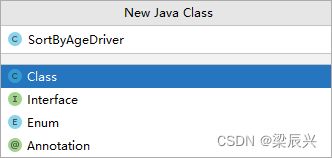

(六)创建年龄排序驱动器类:SortByAgeDriver

1.右击【net.army.mr】,选择【New】,单击【Java Class】

2.在弹出的对话框中输入:SortByAgeDriver,按下回车键,成功创建

2.在弹出的对话框中输入:SortByAgeDriver,按下回车键,成功创建

3.编写代码

package net.army.mr;

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataInputStream;

import org.apache.hadoop.fs.FileStatus;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.*;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

import java.net.URI;

/**

* 作者:梁辰兴

* 日期:2022/12/16

* 功能:年龄排序驱动器类

*/

public class SortByAgeDriver {

public static void main(String[] args) throws Exception {

// 创建配置对象

Configuration conf = new Configuration();

// 设置数据节点主机名属性

conf.set("dfs.client.use.datanode.hostname", "true");

// 获取作业实例

Job job = Job.getInstance(conf);

// 设置作业启动类

job.setJarByClass(SortByAgeDriver.class);

// 设置Mapper类

job.setMapperClass(SortByAgeMapper.class);

// 设置map任务输出键类型

job.setMapOutputKeyClass(FlowBean.class);

// 设置map任务输出值类型

job.setMapOutputValueClass(NullWritable.class);

// 设置Reducer类

job.setReducerClass(SortByAgeReducer.class);

// 设置reduce任务输出键类型

job.setOutputKeyClass(Text.class);

// 设置reduce任务输出值类型

job.setOutputValueClass(NullWritable.class);

// 定义uri字符串

String uri = "hdfs://master:9000";

// 创建输入目录

Path inputPath = new Path(uri + "/student/input");

// 创建输出目录

Path outputPath = new Path(uri + "/student/output");

// 获取文件系统

FileSystem fs = FileSystem.get(new URI(uri), conf);

// 删除输出目录

fs.delete(outputPath, true);

// 给作业添加输入目录

FileInputFormat.addInputPath(job, inputPath);

// 给作业设置输出目录

FileOutputFormat.setOutputPath(job, outputPath);

// 等待作业完成

job.waitForCompletion(true);

// 输出统计结果

System.out.println("======统计结果======");

FileStatus[] fileStatuses = fs.listStatus(outputPath);

for (int i = 1; i < fileStatuses.length; i++) {

// 输出结果文件路径

System.out.println(fileStatuses[i].getPath());

// 获取文件输入流

FSDataInputStream in = fs.open(fileStatuses[i].getPath());

// 将结果文件显示在控制台

IOUtils.copyBytes(in, System.out, 4096, false);

}

}

}