Linux version 4.19.90-2003.4.0.0036.oe1.aarch64安装carbonData

先决条件

thrift

maven

java

文章目录

- 先决条件

- 一、安装java、maven

- 二、thrift安装

- 三、获取CarbonData

- 四、编译方式

- 五、spark集成

- 未完,待更新

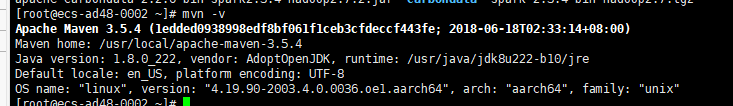

一、安装java、maven

java请安装适配版本,本机X86架构安装jdk版本不一样,用jdk1.8.0_131

- 创建java目录,下载openjdk。

cd /usr

mkdir java

cd java wget https://github.com/AdoptOpenJDK/openjdk8-binaries/releases/download/jdk8u222-b10/OpenJDK8U-jdk_aarch64_linux_hotspot_8u222b10.tar.gz

- 解压

tar -zxvf OpenJDK8U-jdk_aarch64_linux_hotspot_8u222b10.tar.gz

- 给解压的包授权。

chown -R root:root jdk8u222-b10/

chmod -R 755 jdk8u222-b10/

- 配置环境变量。

vi /etc/profile

shift+g 在最后添加如下内容

#java环境

export JAVA_HOME=/usr/java/jdk8u222-b10

export PATH=$PATH:$JAVA_HOME/bin

#刷新检查

source /etc/profile

java -version

- 安装maven

#将maven放在/usr/local中

cd /usr/local

wget https://mirrors.cnnic.cn/apache/maven/maven-3/3.5.4/binaries/apache-maven-3.5.4-bin.tar.gz --no-check-certificate

tar -zxvf apache-maven-3.5.4-bin.tar.gz

vi /etc/profile

同样是shift+g 在最后添加如下内容

#maven环境

export MAVEN_HOME=/usr/local/apache-maven-3.5.4

export PATH=$MAVEN_HOME/bin:$PATH

source /etc/profile

mvn -v

二、thrift安装

依赖环境

yum -y install automake libtool flex bison pkgconfig gcc-c++ boost-devel libevent-devel zlib-devel python-devel ruby-devel openssl-devel

安装

wget http://archive.apache.org/dist/thrift/0.15.0/thrift-0.15.0.tar.gz

tar -zxf thrift-0.15.0.tar.gz

cd thrift-0.15.0/

./configure --with-boost=/usr/local

make -j24

make install

# 验证

thrift -version

三、获取CarbonData

请选择与看文章相符时间的最新稳定版本,可以避免许多bug

wget https://dist.apache.org/repos/dist/release/carbondata/2.2.0/apache-carbondata-2.2.0-bin-spark2.3.4-hadoop2.7.2.jar

四、编译方式

# 1 clone源码

# 也可以直接下载对应版本的源码包

git clone https://github.com/apache/carbondata.git

cd carbondata/

# 2 选择版本。这里选择我们安装的版本2.2.0

git tag

git checkout tags/apache-carbondata-2.2.0-rc2

# 3 编译。指定Spark版本为2.3.4,Hadoop版本为 2.7.2

mvn -DskipTests -Pspark-2.3 -Dspark.version=2.3.4 -Dhadoop.version=2.7.2 clean package

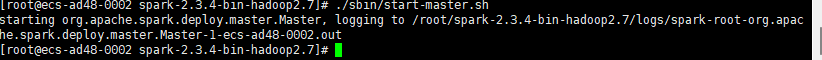

五、spark集成

和Spark集成比较简单,官方已经提供了这个编译后的jar包,因此可以直接下载官方提供的apache-carbondata-2.2.0-bin-spark2.3.4-hadoop2.7.2.jar包在第二步中我们已经下载,所以现在我们只需要下载spark即可

#依旧是要选择合适的版本下载

wget http://archive.apache.org/dist/spark/spark-2.3.4/spark-2.3.4-bin-hadoop2.7.tgz

tar -xzvf spark-2.3.4-bin-hadoop2.7.tgz

./sbin/start-master.sh

- 将上一步下载获得的

apache-carbondata-2.2.0-bin-spark2.3.4-hadoop2.7.2.jar包(carbonlib文件夹需要手动创建)$SPARK_HOME/carbonlib下。

mv apache-carbondata-2.2.0-bin-spark2.3.4-hadoop2.7.2.jar spark-2.3.4-bin-hadoop2.7/carbonlib/

- 在Spark类路径中添加carbonlib文件夹路径

# $SPARK_HOME/conf/spark-env.sh,配置或添加

SPARK_CLASSPATH=$SPARK_HOME/carbonlib/*

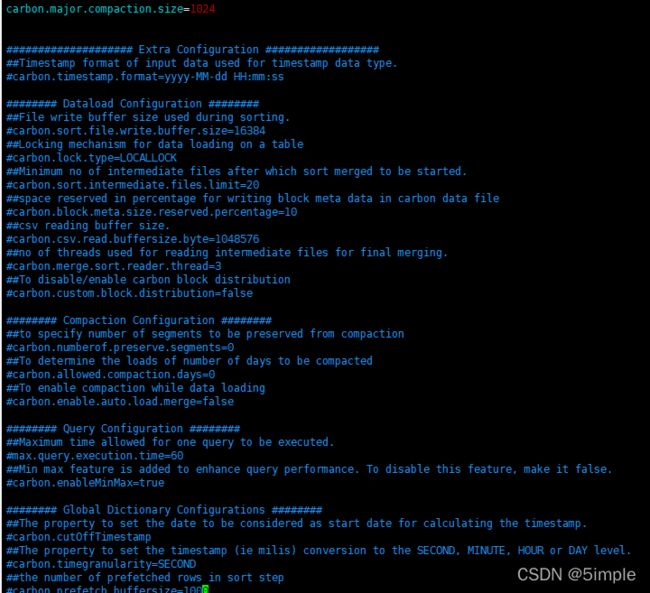

- 在$SPARK_HOME/conf/中vim carbon.properties,并复制GitHub对应版本的配置文件carbon.properties.template 到文件中

cd ~/spark-2.3.4-bin-hadoop2.7/conf

vim carbon.properties

-

将上面几步添加的包和配置文件同样的方式复制到Spark其它节点上

-

在Spark节点master节点中,配置conf/spark-defaults.conf文件中下表中提到的属性

#CarbonData配置项

## 要传递给驱动程序的一串额外JVM选项。例如,GC设置或其他日志记录。

spark.driver.extraJavaOptions -Dcarbon.properties.filepath=$SPARK_HOME/conf/carbon.properties

## 要传递给执行程序的一串额外JVM选项。例如,GC设置或其他日志记录。注意:您可以输入以空格分隔的多个值。

spark.executor.extraJavaOptions -Dcarbon.properties.filepath=$SPARK_HOME/conf/carbon.properties