tensorflow使用正则化和不使用正则化的区别(模型对比加个人分析)

最近有学一些机器学习的相关知识,就来讲一些tensorflow使用正则化和不使用正则化的区别

简介

——搭建一个简单的神经网络

——前向传播

——反向传播过程

——八股之正则化

什么是正则化呢?

正则化的概念及原因

简单来说,正则化是一种为了减小测试误差的行为(有时候会增加训练误差)。我们在构造机器学习模型时,最终目的是让模型在面对新数据的时候,可以有很好的表现。当你用比较复杂的模型比如神经网络,去拟合数据时,很容易出现过拟合现象,这会导致模型的泛化能力下降,这时候,我们就需要使用正则化,让训练出来的模型没有那么复杂。

(以上是正则化的概念)

我个人理解是:

机器在学习的过程中如果对一方面的处理(如图像识别)等方面做的非常的好,但是如果出现了新的情况却不能正确的响应,这就是过拟合现象——但是使用了正则化的方法,就可以在损失函数模型中引入复杂度指标,从而有效缓解过拟合现象。

|所以正则化是用来优化训练模型的一个方式

——来举个例子

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

# coding:utf-8

# 0导入模块 , 生成模拟数据集合

BATCH_SIZE = 30

seed = 2

# 基于seed产生随机数

rdm = np.random.RandomState(seed)

# 随机数返回300行2列的矩阵, 表示300组坐标点 (x0,x1) 座位输入数据集

X = rdm.randn(300, 2)

# 从X这个矩阵中取出一行,判断如果两个坐标的平方和小于2,给Y赋值1, 其余赋值0

# 作为输入数据集的表情 (正确答案)

Y_ = [int(x0 * x0 + x1 * x1 < 2) for (x0, x1) in X]

Y_c = [['red' if y else 'blue'] for y in Y_]

# 对数据集合X和标签Y进行shape整理, 第一个元素为 -1表示,随第二个参数计算得到,第二个元素

# 表示多少列, 把X整理为n行2列, 把Y整理为n行1列

X = np.vstack(X).reshape(-1, 2)

Y_ = np.vstack(Y_).reshape(-1, 1)

print(X)

print(Y_)

print(Y_c)

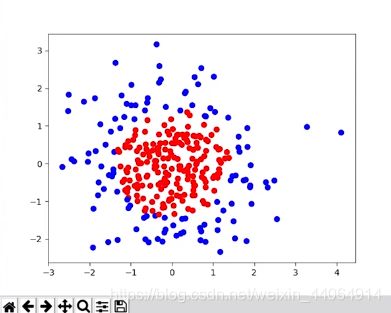

# 用plt.scatter画出数据集X各行中第0列元素和第1列元素的点即各行的(x0, x1),用各行Y_c对应

# 的值表示颜色(c是color的缩写) X[:, 0]的意思是取出横坐标x的第一列元素x0,后面的就是取出第二列x1

plt.scatter(X[:, 0], X[:, 1], c=np.squeeze(Y_c))

plt.show()

# 定义神经网络的输入、参数和输出,定义前向传播过程 (shape, regularizer—正则化权重—)

def get_weight(shape, regularizer):

w = tf.Variable(tf.random_normal(shape), dtype=tf.float32)

tf.add_to_collection('losses', tf.contrib.layers.l2_regualrizer(regularizer)(w))

return w

# 生成的偏置b

def get_bias(shape):

b = tf.Variable(tf.constant(0.01, shape=shape))

return b

# 占位

x = tf.placeholder(tf.float32, shape=(None, 2))

y_ = tf.placeholder(tf.float32, shape=(None, 1))

# w1: b1:获得偏值 y1:实现矩阵乘法

w1 = get_weight([2, 11], 0.01)

b1 = get_bias([11])

y1 = tf.nn.relu(tf.matmul(x, w1) + b1)

w2 = get_weight([11, 1], 0.01)

b2 = get_bias([1])

# 输出层不过激活

y = tf.matmul(y1, w2) + b2

# 定义损失函数

# mse是均方误差的损失函数

# total是计算 均方误差的损失函数加上每一个正则化w的损失

loss_mse = tf.reduce_mean(tf.square(y - y_))

loss_total = loss_mse + tf.add_n(tf.get_collection('losses'))

# 定义反向传播方法: 不含正则化 ->表示Adam优化器沿着均方误差最小的函数的方向上优化(不包含正则化)

train_step = tf.train.AdamOptimizer(0.0001).minimize(loss_mse)

with tf.Session() as sess:

init_op = tf.global_variables_initializer()

sess.run(init_op)

STEPS = 40000

for i in range(STEPS):

start = (i * BATCH_SIZE) % 300

end = start + BATCH_SIZE

sess.run(train_step, feed_dict={x: X[start:end], y_: Y_[start, end]})

if i % 2000 == 0:

loss_mse_v = sess.run(loss_mse, feed_dict={x: X, y_: Y_})

print("After %d steps, loss is: %f" % (i, loss_mse_v))

# xx在 -3到3之间以步长为0.01, yy在-3之间以步长0.01,生成二维网络坐标点

xx, yy = np.mgrid[-3:3:.01, -3:3:, .01]

# 将xx ,yy拉直,并合并成一个2列的矩阵,得到一个网络坐标点的集合

grid = np.c_[xx.ravel(), yy.ravel()]

# 将网络坐标点喂入神经网络,probs为输出

probs = sess.run(y, feed_dict={x: grid})

# probs = probs.reshape(xx.shape)

print("w1:\n", sess.run(w1))

print("b1:\n", sess.run(b1))

print("w2:\n", sess.run(w2))

print("b2:]n", sess.run(b2))

plt.scatter(X[:, 0], X[:, 1], c=np.squeeze(Y_c))

plt.contour(xx, yy, probs, levels=[.5])

plt.show()

# 定义反向传播方法:包含正则化

train_step = tf.train.AdamOptimizer(0.0001).minimize(loss_total)

with tf.Session() as sess:

init_op = tf.global_variables_initializer()

sess.run(init_op)

STEPS = 40000

for i in range(STEPS):

start = (i * BATCH_SIZE) % 300

end = start + BATCH_SIZE

sess.run(train_step, feed_dict={x: X[start:end], y_: Y_[start:end]})

if i % 20000 == 0:

loss_v = sess.run(loss_total, feed_dict={x: X, y_: Y_})

print("After %d steps, loss is: %f" % (i, loss_v))

xx, yy = np.mgrid[-3:3:.01, -3:3:.01]

grid = np.c_[xx.ravel(), yy.ravel()]

probs = sess.run(y, feed_dict={x: grid})

probs = probs.reshape(xx.shape)

print("w1:\n", sess.run(w1))

print("b1:\n", sess.run(b1))

print("w2:\n", sess.run(w2))

print("b2:\n", sess.run(b2))

plt.scatter(X[:, 0], X[:, 1], c=np.squeeze(Y_c))

plt.contour(xx, yy, probs, levels=[.5])

plt.show()

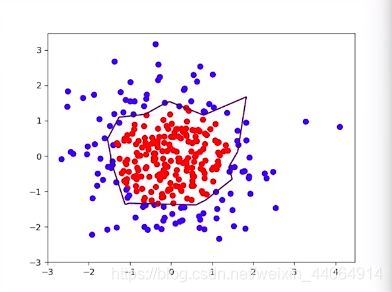

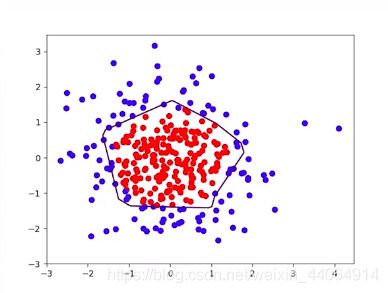

如图所示

运行无正则化的模型 ?

运行有正则化的模型 ?

我们发现,相对于无正则化方法的模型来说,有正则化的模型过拟合程度更低(如图,更收敛了一些)

我github上有相关代码https://github.com/snfet

如果没有可能是我删了