2.Cycle-Dehaze: Enhanced CycleGAN for Single Image Dehazing论文阅读

Cycle-Dehaze: Enhanced CycleGAN for Single Image Dehazing

作者:Deniz Engin, Anıl Genc ,Hazım Kemal Ekenel

土耳其伊斯坦布尔技术大学 SiMiT Lab

Abstract

该文章提出了端到端的网络称为Cycle Dehaze,用于解决单幅图像去雾问题。

优点:

- 1.不需要对模糊图像和相应的真实自然图像来训练网络。

- 2.同时不依赖大气散射模型参数的估计。

结合 周 期 一 致 性 和 感 知 损 失 \color{#FF0000}{周期一致性和感知损失} 周期一致性和感知损失来增强 C y c l e G A N 公 式 \color{#FF0000}{CycleGAN公式} CycleGAN公式,提高纹理信息恢复的质量,并生成视觉上更好的无雾图像。先用去雾的深度学习模型用于低分辨率图像作为输入,产生低分辨率的输出。然后采用 双 三 次 降 尺 度 \color{#FF0000}{双三次降尺度} 双三次降尺度。在从网络获得低分辨率输出后,并利用 拉 普 拉 斯 金 字 塔 \color{#FF0000}{拉普拉斯金字塔} 拉普拉斯金字塔将输出图像放大到原始分辨率。

Conclusion

基本和Abstract一样

Figure and Table

Figure:

1.2018年NTIRE挑战单图像去雾数据集的模糊和干净示例:I-HAZE和O-HAZE数据集。

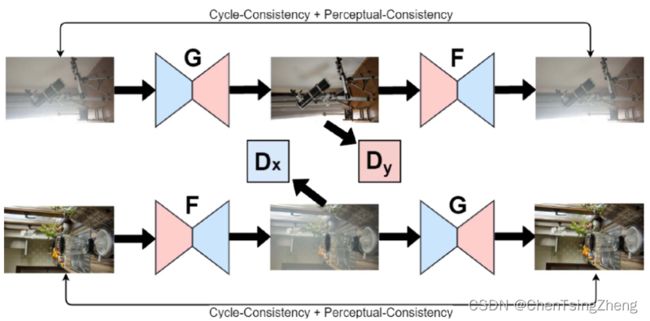

2.循环Dehaze网络的体系结构

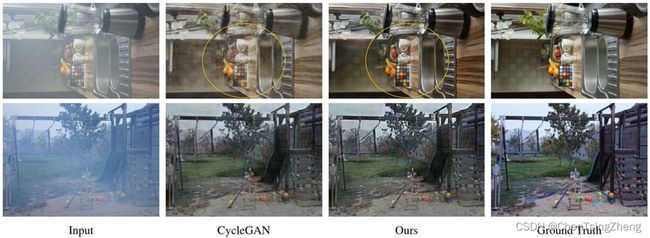

3.在I-HAZE和O-HAZE数据集的定性结果。

4.与当时最先进的结果进行比较,自然模糊图像进行定性分析。

5.比较单数据集和交叉数据集实验的定性结果。Table:

Table部分一般都是对比试验了

Introduce

与经典的dehaze论文差不多,开局一个恶劣天气,介绍全靠计算机视觉应用的影响。例如目标检测、跟踪和分割。

单图像去雾方法分为基于先验信息的方法[3,5,12,16,20,32]和基于学习的方法[10,24,30,34,35]。基于先验信息的方法主要是基于大气散射模型的参数估计,利用先验信息,如暗通道先验[16]、颜色衰减先验[38]、雾线先验[8,9]。另一方面,这些参数是通过基于学习的方法从训练数据中获得的,这些方法主要依赖于深度学习方法。深度神经网络的扩散增加了大规模数据集的使用,因此,研究人员倾向于创建合成的去雾数据集,如FRIDA[33]和D-HAZY[2],其创建过程比真实的去雾数据集更实际。尽管大多数深度学习方法都使用中间参数的估计,例如透射图和大气光[10,24],但也有其他基于生成性对抗网络(GAN)的方法,它们在不受益于这些中间参数的情况下构建模型[30]。

主要贡献:

1.通过在循环一致性损失的基础上增加循环感知一致性损失,增强了CycleGAN[37]的单图像去噪架构。

2.既不需要模糊和地面真实图像的配对样本,也不需要大气散射模型的任何参数

3.利用拉普拉斯金字塔,提出了一种简单有效的方法来处理高比例的去模糊图像。

4.由于其循环结构,可以提供了一个可推广的模型,并通过跨数据集场景的实验进行了验证。

Related work

图像去雾方法的目的是从输入的模糊图像中恢复清晰的场景反射、大气光颜色和透射图。需要知道场景的几个参数,这使得这个问题具有挑战性。图像去雾方法可以根据其输入进行分类:

- (i)多图像去雾

- (ii)基于偏振滤波器的去雾

- (iii)通过利用附加信息(例如深度或几何信息方法)的单图像去雾

- (iv)单图像去雾。

为什么着眼于单幅图像去雾的原因

基于多幅图像的方法通过从多幅图像中获取变化的大气条件,克服了去雾问题。换言之,需要等待天气条件或雾霾水平发生变化;因此,它不适用于实际应用。提出了基于偏振滤波器的方法,以消除天气条件变化的要求。在这种方法中,对不同的图像应用不同的过滤器来模拟变化的天气条件。然而,只有在使用基于偏振滤波器的方法时,才会考虑静态场景。因此,这种方法仍然不适用于实时场景。为了解决这些方法的必要性,建议通过使用附加信息(如深度信息)和场景的3D模型的近似值来对单个图像进行去雾。由于现实世界中通常只有一张模糊场景的捕获图像,因此获取场景的附加信息非常困难。由于以往方法存在的问题,研究人员主要集中在单幅图像的去雾方法上。

简单概括为以下几点:

1.多幅图像去雾需要等待天气条件和雾霾水平的变化,就是要基于多幅图像不同的大气条件,使用条件要求比较高;不适用实际应用。

2只有使用基于偏振滤光器的方法的时候才会去考虑静态场景。至于这个偏振滤光器就涉及到硬件了,而这个偏振滤光器使用需要用到静态场景,导致它并不适用于实时场景。

3.为了解决这些方法的必要性,建议通过使用附加信息(如深度信息)和场景的3D模型的近似值来对单个图像进行去雾。但是由于现实世界中通常只有一张模糊场景的捕获图像,因此获取场景的附加信息非常困难。研究人员主要集中在单幅图像的去杂方法上。

总结一点:就是单幅图像去雾的方法是既符合实际场景应用又符合条件简单的原则。

然后就是去雾领域内的大神之作的介绍,DCP yyds了。前人的研究讲一下,然后又是算是Deep Learning的去雾的大神之作DehazeNet介绍了。接着是说了同样是使用GANs进行实现的方法,但是他们的方法需要在训练阶段估计大气散射模型的参数。

Proposed Method

Cycle-Dehaze是CycleGAN体系的一个增强版本,用于单图像去雾。为了增加视觉质量指标、PSNR、SSIM,利用了EnhanceNet中的 感 知 损 失 \color{#FF0000}{感知损失} 感知损失。

感知损失:这种损失的主要思想是在特征空间而不是像素空间中比较图像。

Cycle Dehaze架构的表示。然后CycleGAN体系中引入了循环一致性损失。计算未配对图像到图像的转换任务的原始图像和循环图像的L1范数。但是原始图像和循环图像之间的计算损失不足以恢复所有的纹理信息。因为有雾图像大多是严重受损。循环感知损失的目的是通过观察从VGG16体系中的第二层和第五层池化层中提取的f高低层特征的组合来保持原始图像结构。 ϕ \phi ϕ就是抽取出来的特征

损失函数如下:

L P e r c e p t u a l = ∥ ϕ ( x ) − ϕ ( F ( G ( x ) ) ) ∥ 2 2 + ∥ ϕ ( y ) − ϕ ( G ( F ( y ) ) ) ∥ 2 2 L_{Perceptual}=\parallel \phi(x)-\phi(F(G(x))) \parallel_2^2 \\ + \parallel \phi(y)-\phi(G(F(y))) \parallel^2_2 LPerceptual=∥ϕ(x)−ϕ(F(G(x)))∥22+∥ϕ(y)−ϕ(G(F(y)))∥22

该网络是基于CycleGAN,数据集与往常不一样的他可以需要雾图和无雾图像,但是不需要成对的(例如一个相同场景的有雾和无雾的图片这就是成对的)。看该模型他有一个训练器G和另一个生成器F,G是希望吃入一个有雾模糊图像,吐出一个无雾清晰图,然后另外一个生成器F输入一个无雾清晰图将其复原回有雾模糊图像。上图中y是无雾图像,通过G来转换,这里可以得知 y = G ( x ) y=G(x) y=G(x),但是CycleGAN的原理需要复原 x ′ = F ( y ) x'=F(y) x′=F(y),让 x ′ x' x′与 x x x尽可能接近,即 x ′ ≈ x x'≈x x′≈x有点类似于函数与反函数的概念,只不过如果说数学中的 f ( x ) f(x) f(x)的反函数是 g ( x ) g(x) g(x),那么 x = f ( g ( x ) ) x=f(g(x)) x=f(g(x))而不是 x ≈ f ( g ( x ) ) x≈f(g(x)) x≈f(g(x))

我们还需要训练两个判别器Dx和Dy,判断像无雾图像的相似度,如果y=g(x)这个生成器生成的图像不像真实图像就给他低分,反之则高分。如果x=f(y)这个生成器生成的图像不像有雾图像就给他低分。这么反复循环对抗。

Experiments and Results

首先是数据集从纽约大学和Middlebury中选择纽约大学深度数据集。但是并没有完全使用每个场景的图像。

作者的训练过程。数据扩充采用了数据增强技术,采用随机作物作为训练阶段前的预处理步骤,进行数据增强。这一过程使模型在不同的尺度和纹理上具有鲁棒性。

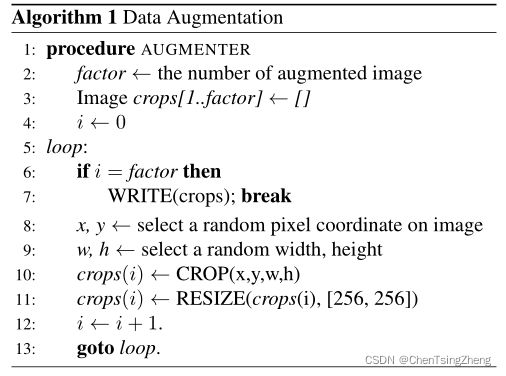

算法如下:

- 该算法先设定一个加强图像的数量,然后设置一个关于图像的空数组,数组大小为设定的数量

- 接着开始循环,x,y,w,h分别是一张图像的随机x,y的像素和选择一个随机的高宽,对每一张图片进行裁剪和修复到该图像为 [ 256 , 256 ] [256,256] [256,256],并写入Image的Crop数组

- 重复操作,直到达到指定的数量。

操作之后为数据集中的每个图像运行增强函数。 在这里也使用拉普拉斯金字塔进行采样和恢复分辨率。

基于以上数据集选取的算法,放入模型进行操作后的结果如下:

视觉效果:

但是视觉效果是偏主观的一个东西,还是需要用数据来证明好坏

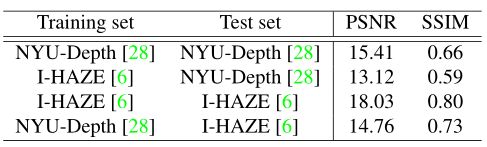

- 在NYU-Depth Dataset上的结果

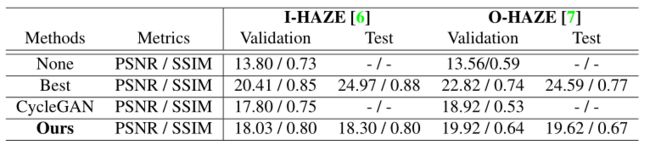

算是可以看出,虽然CycleGAN在峰值信噪比和结构相似性上都比不上最好的效果,但是作为使用GAN方法去雾也是一种不同的创新。比CycleGAN好也可以证明在CycleGAN上添加感知一致性损失可以进一步改善PSNR和SSIM度量的体系结构。- 在NTIRE关于单图像去雾数据集的结果。

分析了拉普拉斯金字塔和周期性知觉损失的影响。根据在I-HAZE和O-HAZE最后输出的更好的PSNR和SSIM可以知道额外的循环感知一致性损失和拉普拉斯金字塔提高了CycleGAN体系的性能。

定性分析——视觉效果:去噪图像具有更少的噪声和更锐利的边缘,其中循环感知一致性损失降低了去噪图像的噪声,拉普拉斯金字塔导致更锐利的边缘。- 交叉数据集的表现

先表达了CNN的缺点——倾向于过度适应特定的数据集而不是学习目标任务。最后说了自己的方法可以学习到什么是雾霾而不用考虑图像去雾霾问题。从交叉数据集实验结果来看,CycleDehaze可以被认为是一种在实际情况下对单个图像进行去雾的实用方法。

单数据集和跨数据集都可以用来去雾,但是单数据集的效果优于跨数据集。因为雾霾会在图像某些地方部分变厚,所以如果数据集不同将无法估计实际的地面真彩色。

我再去看看源码,可能目前还不是特别了解,这一篇工作做的不是特别好。。

建议:该论文看完后继续看CycleGAN和EnhanceNet两篇了解————周期一致性和感知损失